GitHub 热门AI项目

claude-mem

标星数:54,182今日标星:3,175所有者:thedotmack开发语言:TypeScript描述:Claude-Mem 是一款专为 Claude Code 打造的持久化记忆压缩插件。该工具能够自动捕获 Claude 在编程会话中的所有操作,利用 AI(基于 Claude 的 agent-sdk)智能压缩信息,并将相关上下文注入到未来的会话中。这赋予了 Claude 长期记忆能力,使其能基于历史背景提供更精准的代码辅助。项目地址:https://github.com/thedotmack/claude-mem

ralph

标星数:16,692今日标星:691所有者:snarktank开发语言:TypeScript描述:Ralph 是一个自主 AI 代理循环工具,通过重复运行 Amp 或 Claude Code 等 AI 编码工具,自动完成 PRD(产品需求文档)中的所有项目。其核心机制是每次迭代均使用全新的上下文实例,仅通过 git 历史记录、progress.txt 和 prd.json 持久化记忆。Ralph 能够自动创建分支、按优先级实现用户故事、执行测试并提交代码,直至所有任务完成。该项目支持多种集成方式,适合自动化处理复杂的开发流程。项目地址:https://github.com/snarktank/ralph

claude-cookbooks

标星数:39,795今日标星:1,012所有者:anthropics开发语言:Jupyter Notebook描述:Claude Cookbooks 是 Anthropic 推出的代码示例库,旨在帮助开发者利用 Claude API 构建应用。项目提供了丰富的 Python 代码片段,涵盖了文本分类、RAG(检索增强生成)、摘要生成等核心能力。此外,它还详细演示了工具调用(如 SQL 查询)、第三方集成(如向量数据库)、多模态处理(视觉与图像生成)以及子代理等高级技巧。该项目是学习和集成 Claude 功能的实用指南。项目地址:https://github.com/anthropics/claude-cookbooks

claude-code-best-practice

标星数:42,604今日标星:2,461所有者:shanraisshan开发语言:HTML描述:该项目旨在帮助用户从随意编码进阶到智能体工程,通过实践掌握 Claude Code。它涵盖了 Subagents、Commands、Skills、Workflows、Hooks 及 MCP Servers 等核心概念,提供了最佳实践指南与具体实现示例。通过配置权限、模型及外部工具连接,该项目展示了如何高效编排工作流,优化 Claude Code 的开发体验。项目地址:https://github.com/shanraisshan/claude-code-best-practice

voicebox

标星数:16,624今日标星:512所有者:jamiepine开发语言:TypeScript描述:Voicebox 是一个开源的本地优先语音合成工作室,旨在替代 ElevenLabs。它集成了 Qwen3-TTS、LuxTTS 等 5 种 TTS 引擎,支持 23 种语言,可快速克隆声音、生成语音并应用音高、混响等后期特效。该工具内置多轨道时间轴编辑器,提供 REST API,基于 Tauri (Rust) 构建,确保在 macOS、Windows 和 Linux 上具备原生性能与完全隐私保护。项目地址:https://github.com/jamiepine/voicebox

get-shit-done

标星数:52,447今日标星:655所有者:gsd-build开发语言:JavaScript描述:GET SHIT DONE (GSD) 是一款轻量级且强大的 meta-prompting、context engineering 和 spec-driven 开发系统,专为 Claude Code 等工具打造。该项目旨在解决 AI 开发中的“context rot”问题,通过后台的 XML prompt formatting、subagent orchestration 和 state 管理,将复杂性隐藏在系统内部。它摒弃了繁琐的企业流程,让个人开发者仅需通过简单命令,即可让 AI 准确理解需求并高质量完成构建。项目地址:https://github.com/gsd-build/get-shit-done

ProductHunt 热门AI项目

Littlebird

描述: Littlebird 是一款懂你工作的 AI 助手。它掌握上下文背景,因此提供的每一个答案、草稿和计划都更加切题。它能查看屏幕内容并转录会议,为你构建关于项目和优先事项的私有记忆库。Littlebird 能串联你的所有应用和对话,为你提供基于实际工作的答案。无需集成。只要你在桌面上看到过,Littlebird 也就看到了。尽管提问。链接:https://www.producthunt.com/products/littlebird/launches/littlebird-2

Claude Dispatch

描述: 用手机给 Claude 发消息。它运行在你的电脑桌面上,可以访问文件、浏览网页、生成报告并执行任务。沙盒隔离,本地运行。执行前需你批准。保持连贯的对话。链接:https://www.producthunt.com/products/claude/launches/claude-dispatch

My Computer by Manus AI

描述: 介绍 My Computer,这是 Manus Desktop 应用的核心功能。它将 Manus 从云端带到您的电脑上,让您的 AI 代理能够直接操作本地文件、工具和应用程序。您可以整理数千张照片、重命名数百张发票,甚至无需编写代码即可构建 Swift 桌面应用。结合 connectors、Projects、Agents 和 Scheduled Tasks,即可实现工作流程自动化。现已支持 macOS 和 Windows。链接:https://www.producthunt.com/products/manus/launches/my-computer-by-manus-ai

Notion MCP

描述: Notion MCP 将 ChatGPT、Claude 和 Cursor 等 AI 工具直接连接到您的工作区,实现对笔记、文档和数据库的实时读写。专为 AI Agent 打造,它提供具备上下文感知能力的自动化功能,支持创建文档、管理任务、生成报告和组织知识,将分散的数据转化为可执行的工作流。链接:https://www.producthunt.com/products/notion-mcp/launches/notion-mcp

今日热门模型排行榜

AI Twitter 动态回顾

Agent 框架、编码工作流以及从单一模型向系统设计的转变

框架工程现已跻身为一等学科:来自 AI Engineer Europe 和 Vtrivedy 的框架原语的反复出现的主题表明,有用的 agent 并不仅仅是“模型”。核心产品界面现在包括文件系统、bash、压缩、内存、权限、重试、评估 和子 agent。 OpenAI 的 Codex 使用模式表明 agentic 编程正在超越 SWE(软件工程)范畴:OpenAI 分享了一份 Codex 工作流目录:理解大型代码库、PR(Pull Request)审查、Figma 转代码、bug 分类、数据集分析、CLI 工具、入职培训和幻灯片生成。用户报告了一种“agents 作为胶水”的模式,例如 giffmana 使用 Codex 在 Linux 上为 Wayland/HIDPI 问题修补 Java/Qt 二进制文件。 工具正趋向于多 agent 编排、可观察性和远程控制:GitHub 发布了来自 Web/移动端的 Copilot 远程控制。Cursor 增加了分屏 agent 以及搜索/性能改进。LangChain 强调了通过中间件和文件系统权限实现的护栏。Deepagents 的模型将子 agent 简化为结构化的工具/函数调用。

Hermes Agent 仪表板发布、OpenClaw 竞争与开放 Agent 堆栈

Hermes 正巩固其作为当今最受讨论的开源框架的势头:Hermes Agent v0.9.0 发布,带来了本地 Web 仪表板、快速模式、备份/导入、更强的安全加固以及更广泛的频道支持。 OpenClaw 仍在持续更新,但在用户体验和效率方面的比较讨论正倾向于 Hermes:OpenClaw 发布了更新,包括内存导入、“记忆宫殿”、更丰富的聊天 UI、插件设置指南和视频生成。用户报告因速度、架构或 token 效率而更倾向于 Hermes,理由是更好的预选择/上下文塑形。 围绕 agent 堆栈的开源生态系统正日益壮大:Open Agents 作为云编码 agent 堆栈被开源。bromann 将其与 DeepAgent 进行了对比,指出后者是一个更低级别的运行时,具有可插拔的模型提供商、沙箱、中间件和追踪功能。

网络安全、模型能力升级与 Mythos 震荡

Claude Mythos Preview 主导了网络安全领域的对话:英国 AI 安全研究所(AISI)报告称,Mythos 是第一个端到端完成 AISI 网络靶场测试的模型,在 32 步企业网络攻击模拟中取得成功。scaling01 声称,在长时间运行后,Mythos 仅使用了大约 40% 的 token 就达到了 Opus 级别的性能。 安全方面的意义在于操作层面的实用性:实验室和外部评估者描述了在独立靶场上完成的端到端漏洞利用工作流,这超越了推测性的营销宣传。 防御性工具正在同步成熟:The Turing Post 的综述重点介绍了 10 个开源 AI 安全项目,包括 NVIDIA NeMo Guardrails、garak、Promptfoo、LLM Guard、ShieldGemma 2 和 CyberSecEval 3。

推理、检索、OCR 与系统性能

文档/OCR 评估获得了一个严肃的新基准:LlamaIndex 发布了 ParseBench,专注于与 agent 相关的语义正确性。它包含大约 2,000 个人工验证的企业页面和 167,000+ 条评估规则;据报道,LlamaParse 以 84.9% 的成绩总体领先。 Hugging Face 展示了工业规模的 OCR:@ClementDelangue 报告称,使用开源的 5B 模型(Chandra-OCR-2)和 L40S 上的 16 个并行 HF Jobs,将 27,000 篇 arXiv 论文 OCR 为 Markdown,耗时约 29 小时,成本约 850 美元。 检索和传输层优化:LightOn 发布了 ColGrep 1.2.0,支持用于混合多向量检索的 BM25 三元组。Lewis Tunstall 指出了 vLLM 的一个瓶颈:以 JSON 格式传输 logprobs。切换到二进制 NumPy 数组带来了 1.4 倍 的加速。 压缩与推测解码:Red Hat AI 展示了在 vLLM 上部署的 Gemma 4 31B 量化版本,速度接近 2x tokens/sec,内存占用减半,准确率达 99%+。新的研究包括 DDTree,它在一个块扩散传递中起草树结构。

研究方向:记忆、验证、RL 与模型架构

长上下文记忆研究:behrouz_ali 概述了“记忆缓存”,将上下文压缩到缓慢增长的循环记忆中,旨在以类似 RNN 的推理成本实现类似注意力机制的记忆增长。 验证器风格的测试时方法:Azali Amirhossein 等人引入了 LLM-as-a-Verifier,通过要求模型对输出进行排名来对候选对进行评分。 推理发现仍是一个弱点:Laura Ruis 报告称,LLM 甚至难以在简单的情况下发现潜在的规划策略,尽管一旦教会后就变得微不足道。Wen Sun 认为,基于 RL 的提示优化可以从少至 2 个示例中进行泛化。

AI Reddit 社区热帖

LocalLlama + localLLM 热帖回顾

1. Gemma 4 模型开发与基准测试

Best Local LLMs - Apr 2026(活跃度:440):讨论重点强调 Qwen3.5、Gemma4 和 GLM-5.1 声称达到了 SOTA(最先进)性能。Minimax-M2.7 因其易于获取而受到注目,PrismML Bonsai 则因 1-bit 模型而闻名。评论集中讨论了按 VRAM 要求(高达 >128GB)和特定领域的本地 LLM(医疗、法律、数学)对模型进行分类。 Audio processing landed in llama-server with Gemma-4(活跃度:494):llama.cpp (llama-server) 集成了语音转文本(STT)功能,支持 Gemma-4 E2A 和 E4A 模型。原生音频支持消除了对单独 Whisper 管道的依赖。推荐设置: E4B as Q8_XL quant with BF16 mmproj。报告称音频长度超过 5 分钟时会出现问题(循环、错误)。Speculative Decoding works great for Gemma 4 31B with E2B draft (+29% avg, +50% on code)(活跃度:527):使用 Gemma 4 E2B (4.65B) 作为草稿模型,在 Gemma 4 31B 上实施推测解码。设置:RTX 5090 GPU,带有 TurboQuant KV cache 的 llama.cpp 分支, 128K context。基准测试:平均速度提升+29%,代码生成提升+50%。问题:早期 GGUF 版本中存在add_bos_token元数据不匹配。

2. Minimax M2.7 与许可证更新

Ryan Lee from MiniMax posts article on the license...(活跃度:451):Ryan Lee 澄清,允许免费自托管 M2.7 用于代码编写,并承认当前的许可证缺乏细节,将会更新。讨论集中在针对 API 提供商的限制,以及商业用途方面明确性的需求。 Local Minimax M2.7, GTA benchmark(活跃度:383):使用 Minimax M2.7 创建类似 GTA 的 3D 体验的基准测试。测试以 IQ2_XXS运行以追求速度。GLM 5 被指出在美学和细节方面表现出色,无需明确指示。

3. 本地 AI 硬件与设置讨论

Local models are a godsend when it comes to discussing personal matters(活跃度:443):用户利用 Gemma 4 26B A4B(支持 256k context)来分析个人日记(100k+ tokens)。强调隐私和本地处理。Just got my hands on one of these… building something local-first 👀(活跃度:441):配置包括 NVIDIA RTX PRO 6000 Blackwell Max-Q、 9950XCPU、128GB RAM。技术栈:带有cu130 nightly image的vLLM。运行Qwen3.5-27B-FP8(kv cache dtype为fp8_e4m3),160kcontext,55%VRAM 占用。性能:单80-90 tps,并发250+ tps。

轻技术向 AI Subreddit 回顾

1. AI 模型与基准测试发布

OpenRouter Just announced a New 100B model(活跃度:240):OpenRouter 宣布了“Elephant Alpha”,一个专注于 token 效率的 100B参数模型,旨在用于代码补全、调试、文档处理和轻量级 agent。

3. AI 模型性能与配置

Claude isn’t dumber, it’s just not trying. Here’s how to fix it in Chat.(活跃度:1726):用户报告由于配置原因,感觉 Claude 的性能有所下降。Claude Code 用户可以通过 /effort max恢复。聊天用户可以设置自定义指令来强制执行彻底的推理。Claude Code (~100 hours) vs. Codex (~20 hours)(活跃度:1421):在一个拥有 8 万行代码(LOC)的项目上比较 Claude Opus 4.6 与 Codex GPT-5.4。Claude 快速/交互性强,但容易忽略指导原则。Codex 较慢、深思熟虑,并严格遵守指导原则,产生更整洁的代码。 The golden age is over(活跃度:4149):关于消费级 LLM 质量感知下降的讨论。一些用户建议,国外和开源模型正在填补美国模型受限后留下的空白。

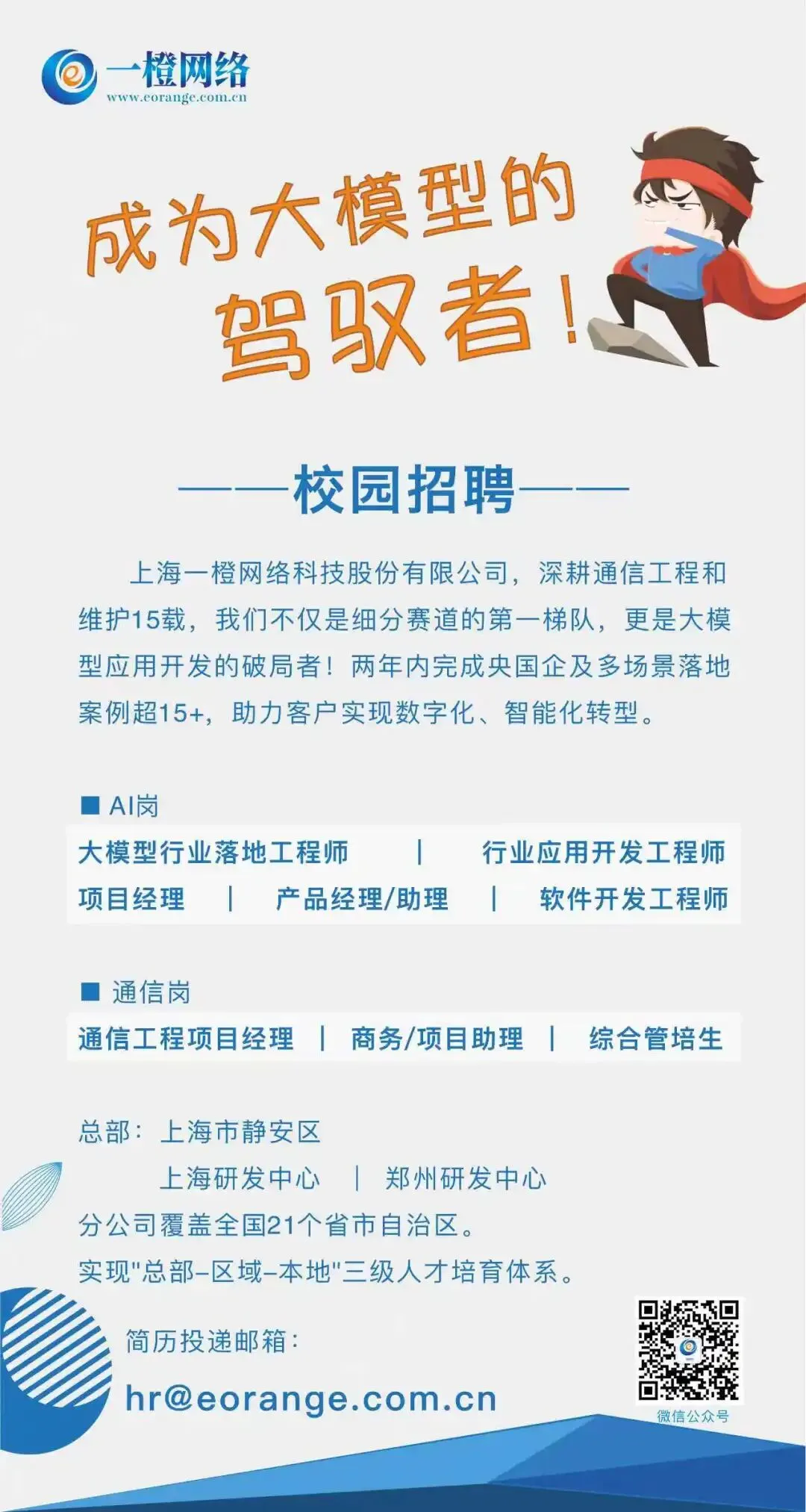

上海一橙智能科技有限公司,是上海一橙网络科技股份有限公司旗下专注于AI与大模型应用落地的核心企业,提供从平台构建到AI场景化应用落地的全栈服务。聚焦大模型应用、数字人交互、语音图像分析等核心领域,打造了覆盖智能外呼、智能客服、智能知识管理、智能陪练、多模态交互、图像语音质检等场景的AI产品体系,已成功为通信、能源等领域头部央国企客户打造出多个AI落地应用。

夜雨聆风

夜雨聆风