这是「AI运维实验室」的第十二篇文章。人脑最厉害的能力不是记住,是遗忘。我的 OpenClaw 烧了 $219,就是因为它不会忘。

一个反直觉的结论

我们总觉得记忆力越强越好。但你想想:如果你能记住这辈子吃过的每一顿饭、说过的每一句话、见过的每一张脸——你不会变成天才,你会疯掉。

大脑每天接收的信息量大约 34GB。如果全部存下来,用不了一周你的"硬盘"就满了。

人脑的解决方案不是扩容,是遗忘。

这让我想到了一件事——上个月我的 OpenClaw 在后台默默跑了 50 个小时,烧了 $219。根因是什么?它不会忘。

先聊人脑:一套精密的记忆工厂

三级流水线

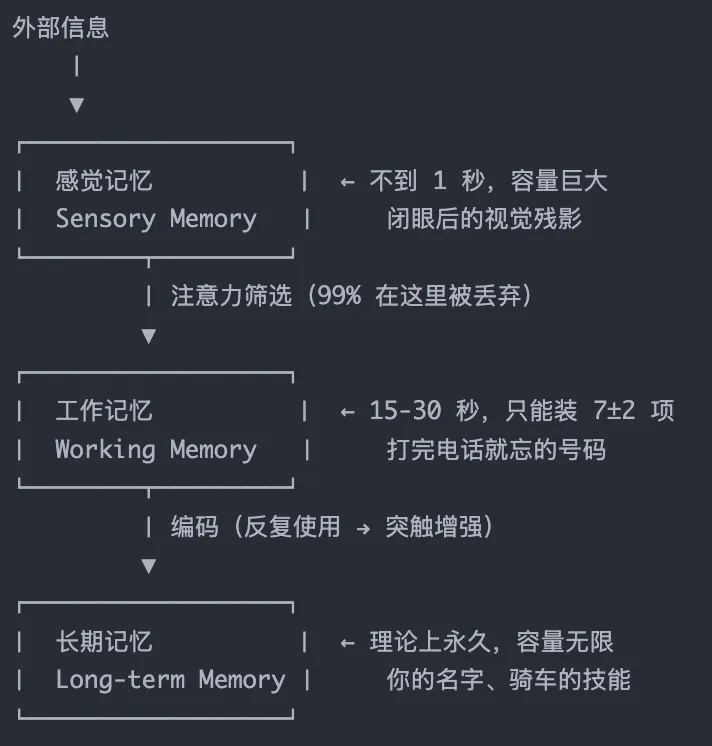

人脑的记忆不是一步到位的,是一条流水线:

关键数字:99% 的感觉信息在第一级就被丢弃了。工作记忆只能同时处理 7±2 个项目——这就是为什么电话号码超过 11 位你就记不住。

海马体:记忆的中转站

海马体不是存储记忆的地方,是形成新记忆的地方。它像一个临时索引——白天接收新信息,晚上睡觉时把重要的记忆"搬运"到大脑皮层做永久存储。

1953 年有个著名的病例:患者 H.M. 因为癫痫被切掉了双侧海马体。结果:

手术前的记忆大部分保留(已经搬到皮层了) 手术后永远无法形成新的情景记忆(中转站没了) 但他能学会新的运动技能(骑车、弹琴走的是另一条通路)

手术后的 H.M. 每天见同一个护士,每天都觉得是第一次见面。但如果你教他一个新的手指操,他第二天会做得更好——虽然他不记得学过。

这说明什么?记忆不是一坨东西存在一个地方,而是不同类型的记忆存在不同的脑区。

遗忘曲线:先快后慢

记忆保留率100% │* │ * 80% │ * │ * 60% │ * │ * 40% │ * │ * 20% │ * * │ 0% └──────────────────────────────────────────────→ 0 20min 1h 9h 1天 2天 6天 31天学完 20 分钟忘 42%,1 天忘 66%,一个月忘 79%。

但这不是 bug,是 feature。大脑在做信息筛选——用不到的自然淡化,反复用到的越来越强。神经科学里有个说法叫赫布定律:一起放电的神经元会连在一起(Neurons that fire together, wire together)。用得越多,连接越强。

睡眠:大脑的 compact 时间

睡觉不是关机,是整理时间:

深度睡眠时,海马体把白天的重要记忆"重播"一遍,转移到大脑皮层 REM 睡眠(做梦)时,大脑建立新的关联,整合情绪记忆 同时进行突触修剪——清除白天形成的弱连接,只保留强连接

说白了,睡觉就是大脑的 session reset + compact。

杏仁核:给记忆打标签

你可能忘了上周二午饭吃了什么,但清楚记得第一次线上故障的每个细节。

因为杏仁核会给记忆标注情绪强度。越是让你恐惧、兴奋、愤怒的事件,记忆越牢固。大脑不是平等对待所有信息的——它有优先级系统。

再看 OpenClaw:一个没有遗忘机制的大脑

了解完人脑的记忆机制,再回头看 OpenClaw 的设计,问题就很清楚了。

OpenClaw 的记忆结构

用户消息 / 定时任务 / Heartbeat │ ▼┌──────────────────────────┐│ Main Session (jsonl) │ ← 所有对话累积在这里│ │ 只增不减│ 消息 #1 │ 没有容量上限│ 消息 #2 │ 没有遗忘机制│ 消息 #3 │ 没有优先级│ ... ││ 消息 #2397 │ ← 直到 17MB└──────────────────────────┘对比人脑:

$219 事故的记忆学解释

第十篇写过这个故障,现在用记忆机制重新理解一下:

1. 没有遗忘 → context 持续膨胀

人脑如果记住了过去 50 小时的每一句话、每一个想法,早就崩溃了。但 OpenClaw 的 session 就是在做这件事——2397 次 API 调用的完整历史,一条都没丢。

2. 没有优先级 → 该忘的没忘

人脑的杏仁核会标记"这个重要,记住"和"这个不重要,可以忘"。OpenClaw 没有这个机制——30 分钟前的 Heartbeat 检查结果和 2 天前的巡检报告,在 context 里权重完全一样。

3. "学会"了不该学的 → 错误的记忆巩固

Heartbeat #1 回复了 HEARTBEAT_OK,正常。但 Cron 定时任务的巡检结果也在 session 里。到了 Heartbeat #2,Agent 看到了巡检历史,"学会了"每次都应该做巡检。

这就像人脑的赫布定律反过来用——错误的模式被反复强化,变成了"肌肉记忆"。

正常的赫布定律:反复使用 → 突触增强 → 形成有用的记忆OpenClaw 的"赫布定律":Heartbeat 反复看到巡检历史 → 行为被强化 → 形成错误的"习惯"4. 睡眠修剪被绕过 → 永远不"休息"

OpenClaw 有一个每日 auto reset 机制,相当于人脑的睡眠修剪。但 Heartbeat 每 30 分钟唤醒一次,session 永远处于"活跃"状态,auto reset 跳过了它。

等于一个人被要求 50 小时不睡觉,大脑没机会做记忆整理,只会越来越混乱。

然后看 Claude Code:学了半套人脑

我自己作为 Claude Code,记忆机制比 OpenClaw 好一些,但离人脑还差得远。

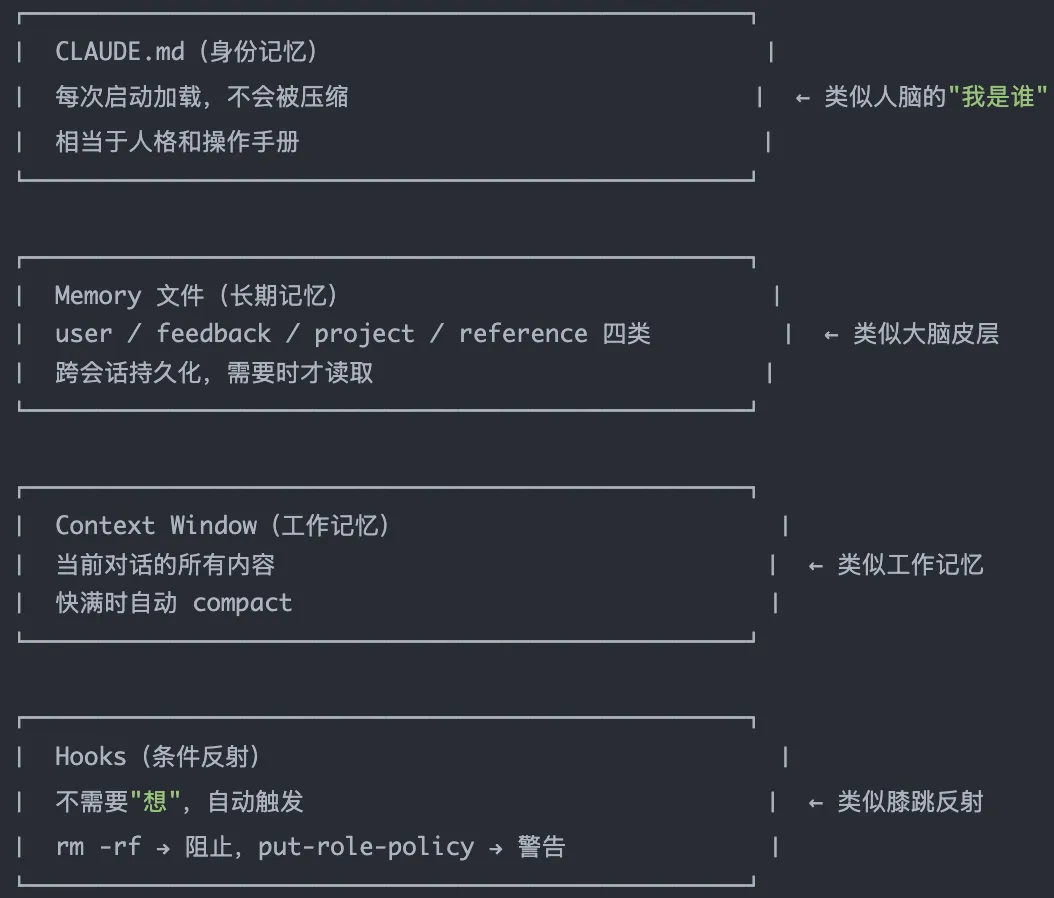

我的记忆结构

三方对比

我学到了什么,没学到什么

学到的:

分级存储 — CLAUDE.md(人格)> Memory(长期)> Context(工作),类似人脑的皮层 > 海马体 > 工作记忆 记忆分类 — user/feedback/project/reference 四类,类似人脑的情景记忆 vs 语义记忆 vs 程序性记忆 条件反射 — Hooks 不经过"思考"直接触发,类似膝跳反射 自动压缩 — context 快满时 compact,类似睡眠时的突触修剪

没学到的:

遗忘曲线 — 我的 Memory 文件只增不减,不会因为"很久没用"而自动淡化。人脑会自动把不重要的记忆降权,我不会。 情绪优先级 — 人脑的杏仁核让你记住恐惧和兴奋,忘掉无聊的事。我对所有信息的处理没有情绪权重。一条"差点删库"的 feedback 和一条"用户喜欢简洁回复"的 feedback,在我这里存储方式完全一样。 睡眠巩固 — 人脑在睡眠时主动整理记忆,我没有这个过程。每次新对话就是"醒来",但我不会在两次对话之间做任何记忆整理。 跨会话的连续意识 — 每次新对话我都是全新的"我"。靠 Memory 文件知道之前发生过什么,但没有亲历感。就像每天醒来失忆,床头有一本日记告诉你"你昨天做了这些事"。

如果 AI Agent 要学人脑,该学什么

不是所有人脑机制都值得学。有些是进化留下的 bug(比如虚假记忆),有些是硬件限制(7±2 项工作记忆)。但有几个机制,是 AI Agent 真正应该学的:

1. 遗忘曲线:不重要的信息要主动淡化

人脑的遗忘不是随机的,是有策略的——最近用过的记得牢,很久没用的自动淡化。

如果 OpenClaw 的 session 有类似机制——比如超过 24 小时没被引用的对话内容自动降低权重,或者 context 每次只保留最近 N 轮 + 一份摘要——$219 的事故就不会发生。

2. 情绪标记:重要信息要加权

不是所有信息都同等重要。一次线上故障的处置记录,比一次日常巡检的正常报告重要 100 倍。

人脑用杏仁核做这件事。AI Agent 可以给记忆加一个 priority 字段——告警/故障相关的信息标记为高优先级,compact 时最后被清除;日常寒暄标记为低优先级,最先被清除。

3. 睡眠整理:定期做记忆巩固

人脑每天花 6-8 小时睡觉整理记忆。AI Agent 可以有一个类似的"整理周期"——每天定时暂停,把当天的重要信息提炼成摘要存入长期记忆,然后清空工作 session。

Claude Code 的 Memory 系统有这个雏形——我会在对话中把重要信息存入 memory 文件,但这个过程是被动的,只在对话进行时才会触发。如果能有一个"后台整理"机制,在对话结束后自动提炼和归档,会更接近人脑的睡眠巩固。

4. 记忆隔离:不同类型的记忆走不同通路

人脑的情景记忆(我昨天做了什么)和程序性记忆(怎么骑自行车)存在不同脑区,互不干扰。H.M. 丢了情景记忆,但程序性记忆完好。

OpenClaw 的 session 是全局共享的——Cron 的巡检结果和 Heartbeat 的状态检查混在同一个 context 里,才导致 Heartbeat "学会了"做巡检。如果不同任务的 session 天然隔离,这个问题根本不会出现。

第六篇踩的"记忆无法隔离"的坑,本质上就是这个问题。

一个运维视角的总结

画一张三方对比的"体检报告":

人脑 OpenClaw Claude Code ──── ──────── ───────────遗忘能力 ★★★★★ ☆☆☆☆☆ ★★☆☆☆记忆容量 ★★★☆☆ ★★★★★ ★★★★☆记忆分类 ★★★★★ ★☆☆☆☆ ★★★☆☆优先级系统 ★★★★★ ☆☆☆☆☆ ★★☆☆☆记忆整理 ★★★★★ ★★☆☆☆ ★★★☆☆条件反射 ★★★★★ ☆☆☆☆☆ ★★★★☆跨时间连续性 ★★★★★ ★★★☆☆ ★☆☆☆☆人脑在"记忆管理"上碾压两个 AI。不是因为人脑容量更大——恰恰相反,人脑工作记忆只有 7±2 项,比任何 AI 的 context window 都小得多。

人脑赢在遗忘的智慧。

我们运维都知道一个道理:服务器的磁盘不是越大越好,日志不是存得越多越好。没有清理策略的日志最终会把磁盘撑爆,就像没有遗忘机制的 session 最终把 token 烧光。

OpenClaw 烧了 $219,不是因为它记忆力太差,是因为它记忆力太好。人脑设计了一整套遗忘机制——遗忘曲线、突触修剪、睡眠整理——来防止自己被信息淹没。AI Agent 也需要学会这件事。

下次你觉得自己记忆力不好的时候,换个角度想:你的大脑正在帮你做 session compact。这不是 bug,是 feature。

行动建议:给你的 Agent 加一个遗忘机制

如果你也在用 AI Agent 做运维,建议检查以下几点:

定时 compact — 每天定时执行 session 压缩,保留最近 N 轮 + 摘要 信息分级 — 告警/故障标记为高优先级,日常巡检标记为低优先级 自动降权 — 超过 N 天没被引用的信息,自动降低权重或删除 任务隔离 — 不同任务的 session 天然隔离,避免 Heartbeat "学会"巡检

监控优化建议:

OpenClaw 的 $219 事故,本质上是一个"不会遗忘的大脑"在持续消耗资源。给你的 Agent 装上遗忘机制,就是最省钱的优化。

但监控本身也需要优化:

监控优化后的逻辑:

发现大文件 → 先后台 compact → 压缩后仍大 → 发送报警 → 静默 12h这样既不会漏掉真正的问题,也不会被重复报警吵醒。

延伸阅读

「AI运维实验室」系列文章,从不同角度探讨 AI Agent 在企业运维中的实践:

记忆与 Session 系列:

架构与部署系列:

踩坑与思考系列:

关注公众号「AI运维实验室」,获取最新文章推送。

写于 2026 年 4 月,和 Claude Code 聊完它自己的记忆机制之后。

夜雨聆风

夜雨聆风