论文标题:

WildDet3D: Scaling Promptable 3D Detection in the Wild

论文链接:

https://arxiv.org/abs/2604.08626

代码地址:

https://github.com/allenai/WildDet3D

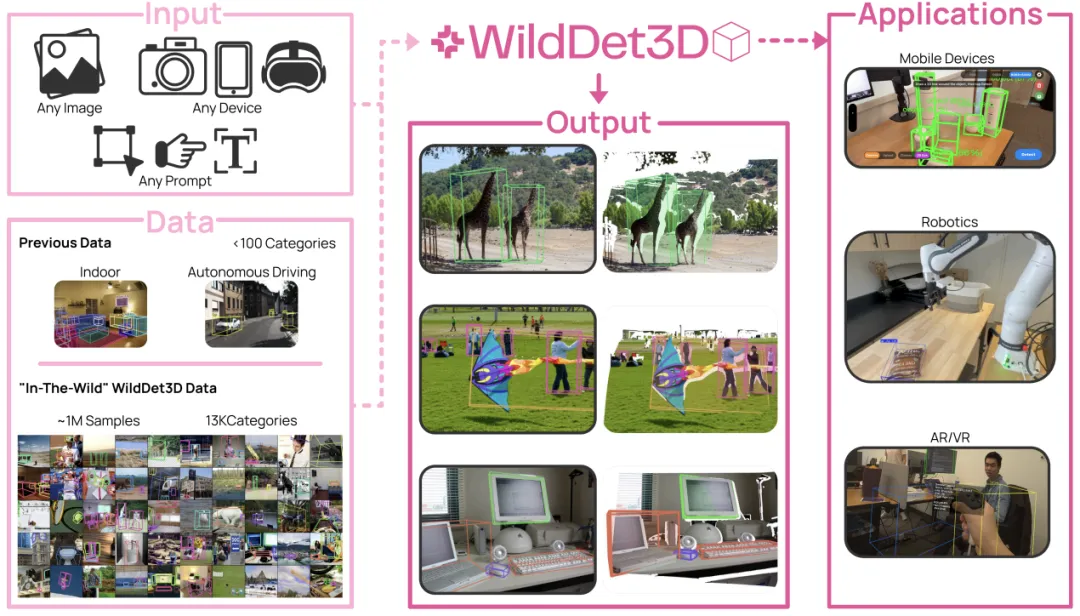

Allen Institute for AI 最新力作,首个支持多模态 Prompt 的开放世界单目 3D 检测模型。

想象一下:你随手拍了一张咖啡馆的照片,一个 AI 不仅能认出画面里的椅子、杯子和人,还能精准告诉你每个物体离镜头多远、有多大,甚至面朝哪个方向,而且它对从未见过的物体类别同样奏效。

这,正是 WildDet3D 要解决的问题。

从 2D 到 3D:一道长久未解的难题

人类的眼睛是单目的,却能轻易判断一个物体离我们有多远、有多大。这背后依赖的是大脑对光影、遮挡、大小比例的综合判断。

对机器来说,从一张二维照片中恢复三维信息,即单目 3D 目标检测(Monocular 3D Object Detection),一直是计算机视觉领域最具挑战性的任务之一。

传统的方法要么依赖昂贵的激光雷达(LiDAR),要么依赖双目相机,又或者只在特定的封闭场景下(比如自动驾驶的街道)才能工作。

这些方法有一个共同的局限:它们被训练为识别固定的几十个类别,一旦遇到没见过的物体就束手无策。

真实世界里的物体不会乖乖待在类别列表里,一只鹦鹉、一把复古椅、一个塑料袋,都应该被理解。

此外,现有方法通常只接受一种"提示"方式:要么只能用文字描述,要么只能框选,而不能灵活切换。这在实际部署中极不方便。

WildDet3D 的两大核心贡献

这篇论文用两把钥匙同时破局。

贡献一:统一的几何感知架构

WildDet3D 是一个能接受三种不同输入"提示"的单目 3D 检测模型。

你可以用文字告诉它找什么,可以用鼠标点击图像中的物体,也可以用一个 2D 矩形框圈出目标,模型都能将其"提升"为完整的 3D 边界框,输出物体的深度、尺寸和六自由度朝向。

架构中有一个特别优雅的设计:几何后端是模块化解耦的。这意味着深度估计的组件可以像"插件"一样随时替换,不需要重新训练整个系统。

更重要的是,当没有任何深度信息时,模型会自动降级到纯单目模式,换句话说,一张普通手机照片也可以直接输入。

贡献二:迄今最大的开放 3D 检测数据集

有了好的架构,还需要足够的数据来让它真正"见过"这个世界。以往的 3D 检测数据集,如 Omni3D,往往只覆盖几十到几百个类别,且主要集中在室内或自动驾驶场景。

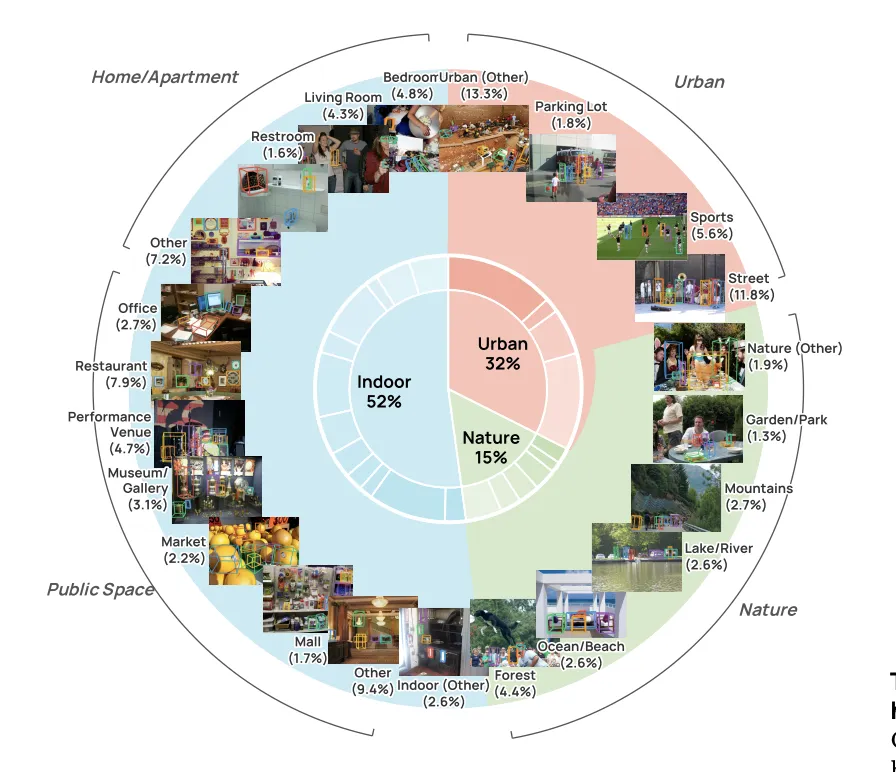

为此,论文团队构建了 WildDet3D-Data:利用 COCO、LVIS、Objects365、V3Det 等现有 2D 标注数据生成候选 3D 框,再经过几何和语义双重校验,最终保留经人工核验的标注,规模如下:

数据集覆盖了室内、城市街道、自然风光等多样化的真实场景,相比此前的数据集,多样性提升是质的飞跃。

性能表现:多个基准上的新 SOTA

论文在多个基准数据集上进行了系统评估,WildDet3D 均取得了当前最优成绩。下表整理了核心结果:

关键发现:深度信息的价值

当推理时提供深度图(例如来自 LiDAR 或 ToF 传感器),模型在各基准上平均额外提升 +20.7 AP。

这说明架构的深度融合设计非常高效,哪怕只是稀疏的深度点,也能显著改善 3D 定位精度。

不只是论文:真实世界的部署

WildDet3D 最令人印象深刻的地方,也许不在于跑分,而在于它被部署到了多个真实场景。

网页 Demo

上传任意图片,输入文字或框提示,实时看到 3D 检测结果。

iPhone AR 应用

借助 LiDAR 深度,将 3D 边界框以 AR 形式叠加到真实场景。

机器人操作

为 Franka 机械臂提供开放词汇 3D 感知,实现零样本抓取。

视觉语言模型联动

配合 VLM(如 Molmo 2),实现自然语言驱动的 3D 目标定位。

这套系统的模块化设计意味着:任何能产生"类别名称""一个点""一个 2D 框"的上游系统,都可以和 WildDet3D 组合,获得即插即用的 3D 理解能力。

正如论文中描述的那样,它甚至可以在从未训练过追踪数据的情况下,通过逐帧处理 2D 追踪结果来实现零样本 3D 目标追踪。

这项工作意义在哪里

WildDet3D 的意义在于,它将一个长期以来只能在特定场景和固定类别下工作的任务3D 目标检测,推向了真正的开放世界。

它同时在三个维度上取得了突破:

泛化能力方面,依托 13,500 个类别的大规模训练数据,模型在从未见过的物体和场景上表现出色,零样本分数甚至比此前最优方法翻倍。

交互灵活性方面,统一支持文本、点击、框三种提示,使模型能嵌入几乎任何现有的感知流水线中,而无需重新训练。

工程实用性方面,深度信息的模块化融合让模型在有传感器时能充分利用几何线索,没有传感器时也能优雅降级,这种设计对真实产品落地至关重要。

灵光一闪

灵光一闪是专为高校学生、课题组及导师打造的科研资讯工具。通过论文合集、论文导读等核心方向,助您快速定位课题、突破科研瓶颈。

知识库内包含多个开源项目复现指南,再到前沿论文速递全部打包。我们将保持每周更新,赶快收藏起来吧!点击下方阅读原文进入知识库。

灵光一闪 | 具身AI热门论文导读

Embox具身知识库 | 新手仿真从0到1

告别手动标注!Grounding DINO + SAM:用嘴“指挥”视觉 AI,开启具身智能零样本分割新纪元!

Embox具身知识库 | 每日具身智能资讯

……

获取知识库最新动态,欢迎大家关注

【EmboX具身工坊】⬇

夜雨聆风

夜雨聆风