刚开始用 OpenClaw 的朋友可能会发现,怎么越用感觉越贵。

我从今年 2 月开始用,也是用了整整 1 个月,才发现有6个地方一直在默默消耗 token,而当时我压根没意识到。

用Openclaw消耗太快,有时候不是模型太贵,也不完全套餐不够用。可能是这6个地方没处理好。

先把这6条做完,再决定要不要升套餐。

第 1 条:先学会看账单,再谈省钱

感觉"贵",很多时候是因为根本不知道钱花哪了,该省省该花花。

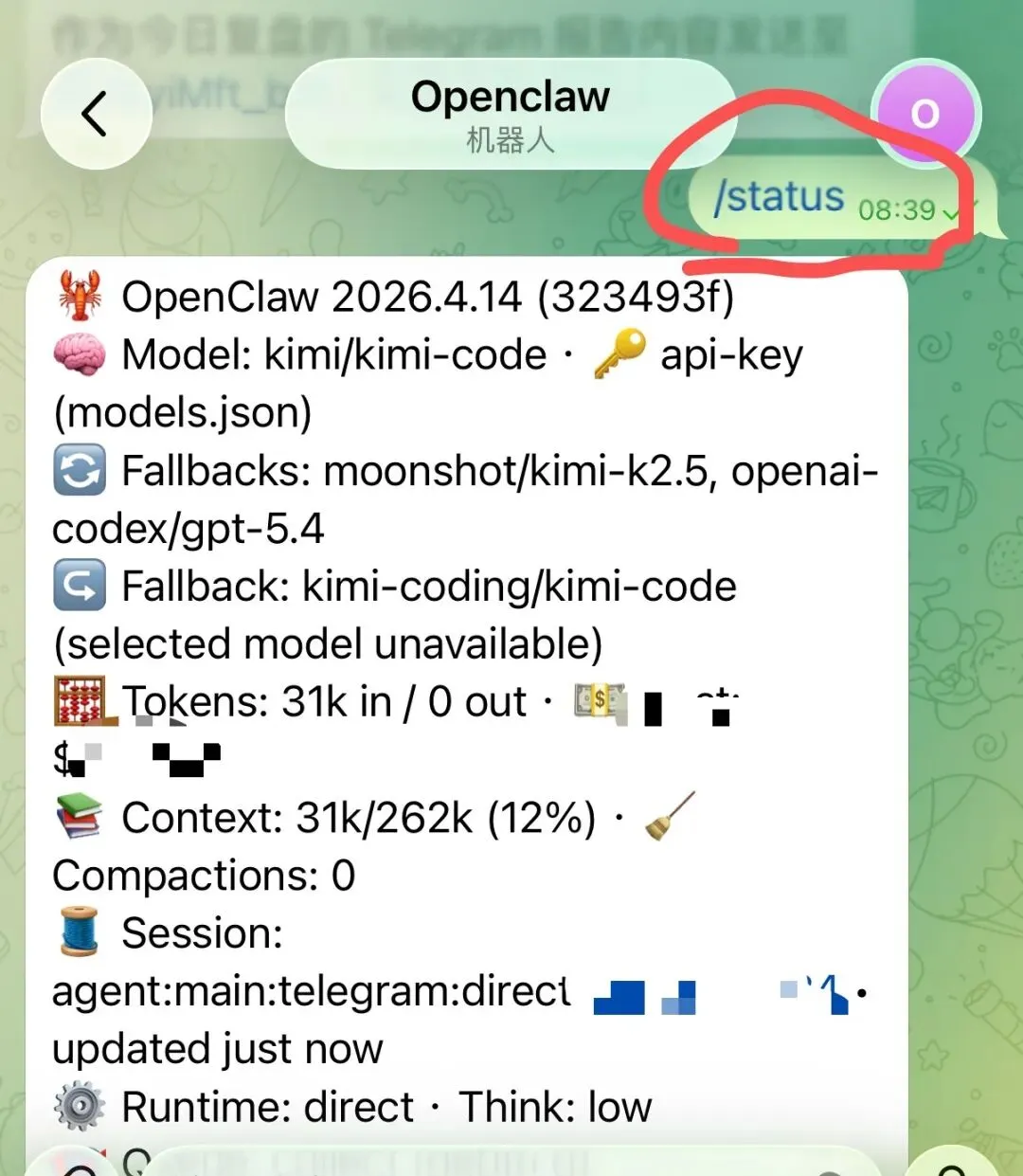

打开你的飞书机器人对话窗口,或者 Telegram 里的 OpenClaw 对话,直接发送:

/status

它会回复这次会话的详细状态,像这样:

• Model:当前用的是哪个模型 • Tokens:这轮用了多少(31k in / 0 out) • Context:上下文已用多少(31k/262k,12%) • Compactions:压缩过几次 • Runtime / Think:当前运行模式

看 Context 那一行最有用。12% 说明还早,要是到了 50% 以上,就该考虑 /compact 了。

想看花了多少钱,发送:

/usage cost

它会返回三个数字:这次对话的花费、今天的花费、过去30天的花费。哪天最烧token,一眼就可以看出来。

我自己的习惯是跑完一个比较长的任务之后,先发一条 /status 看一眼。数字大了,下次就知道从哪里优化。

第 2 条:对话一长,立刻发 /compact

这是我用了 1 个月才养成的习惯。

OpenClaw 每次回复,都会把前面所有对话重新"读"一遍。对话越长,每轮消耗的 token 就越多,不是因为你这条消息长,而是它要带着整个历史记录去理解你说的话。

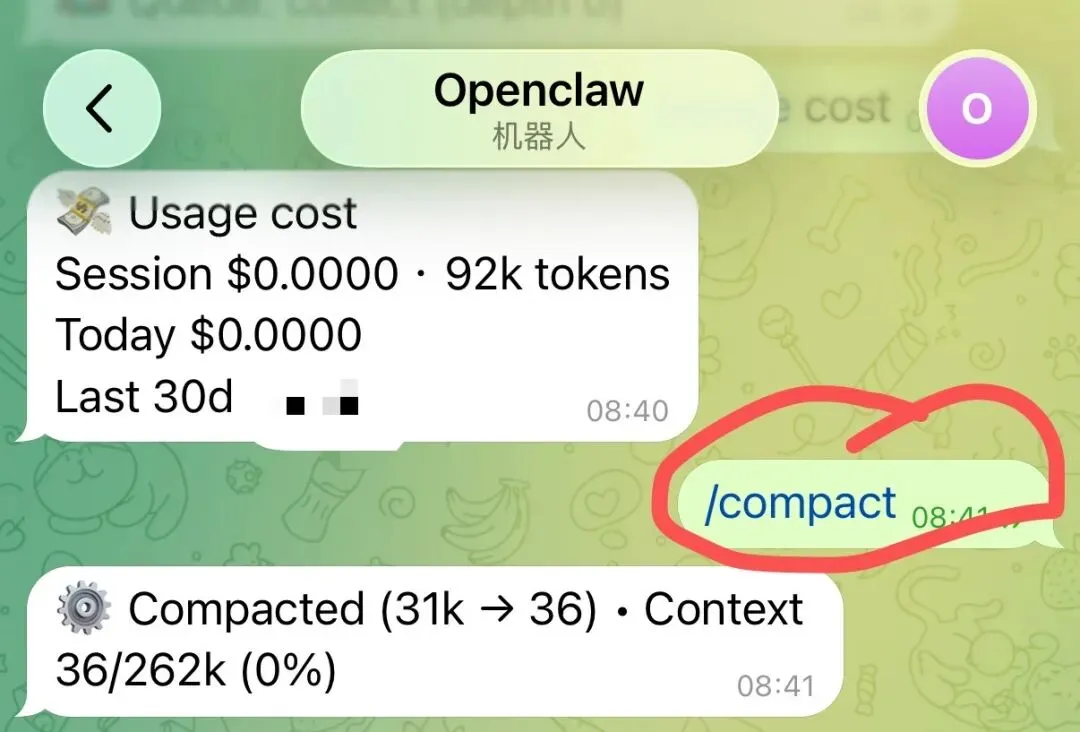

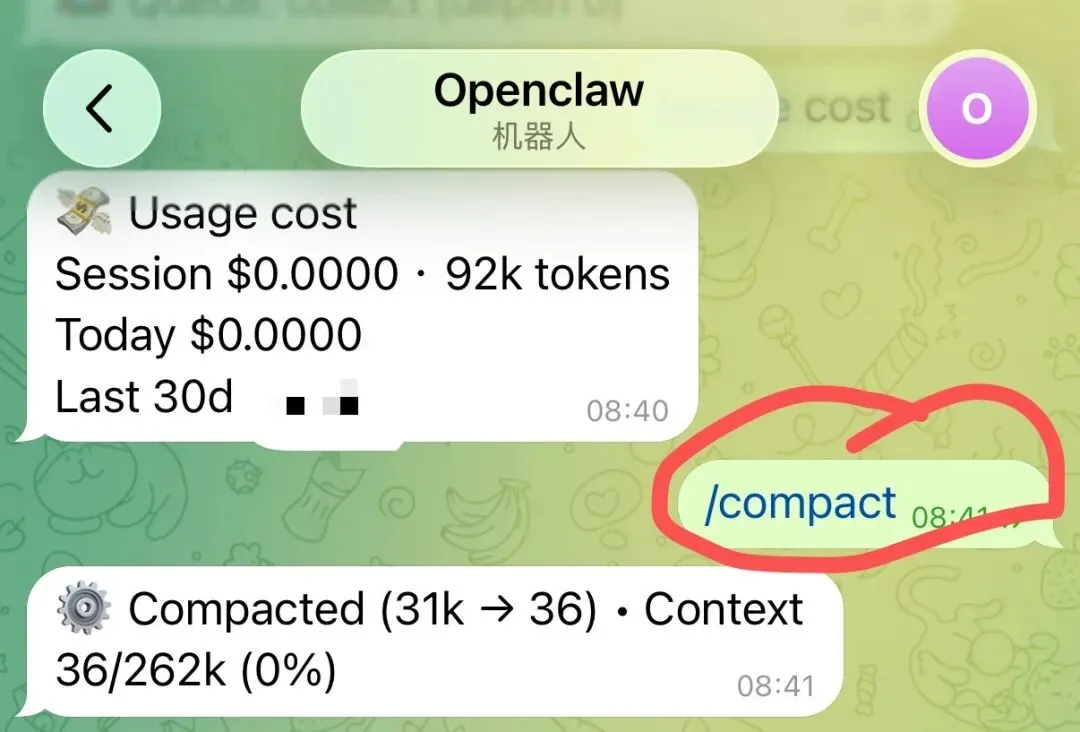

解决方法很简单,在飞书或 Telegram 对话窗口发送:

/compact

它会把前面的对话压缩成一段摘要。图里可以看到,压缩之后 Context 从 31k 直接降到 36,从占用 12% 变成 0%。每轮消耗从这里重新开始计算。

怎么判断该发了?看 /status 里的 Context,超过 50% 就可以发一次。不用等它自己提示快满了再用。

第 3 条:重要内容别只放在聊天里,让龙虾🦞记下来

发完 /compact 之后会丢一些不重要的东西,只保留重点。

OpenClaw 压缩对话时,会把早期的对话内容归纳成摘要,细节可能消失。如果你的任务背景、个人偏好、特殊要求只放在聊天记录里,压缩后 AI 员工就不记得了,下次你还得重新说一遍。

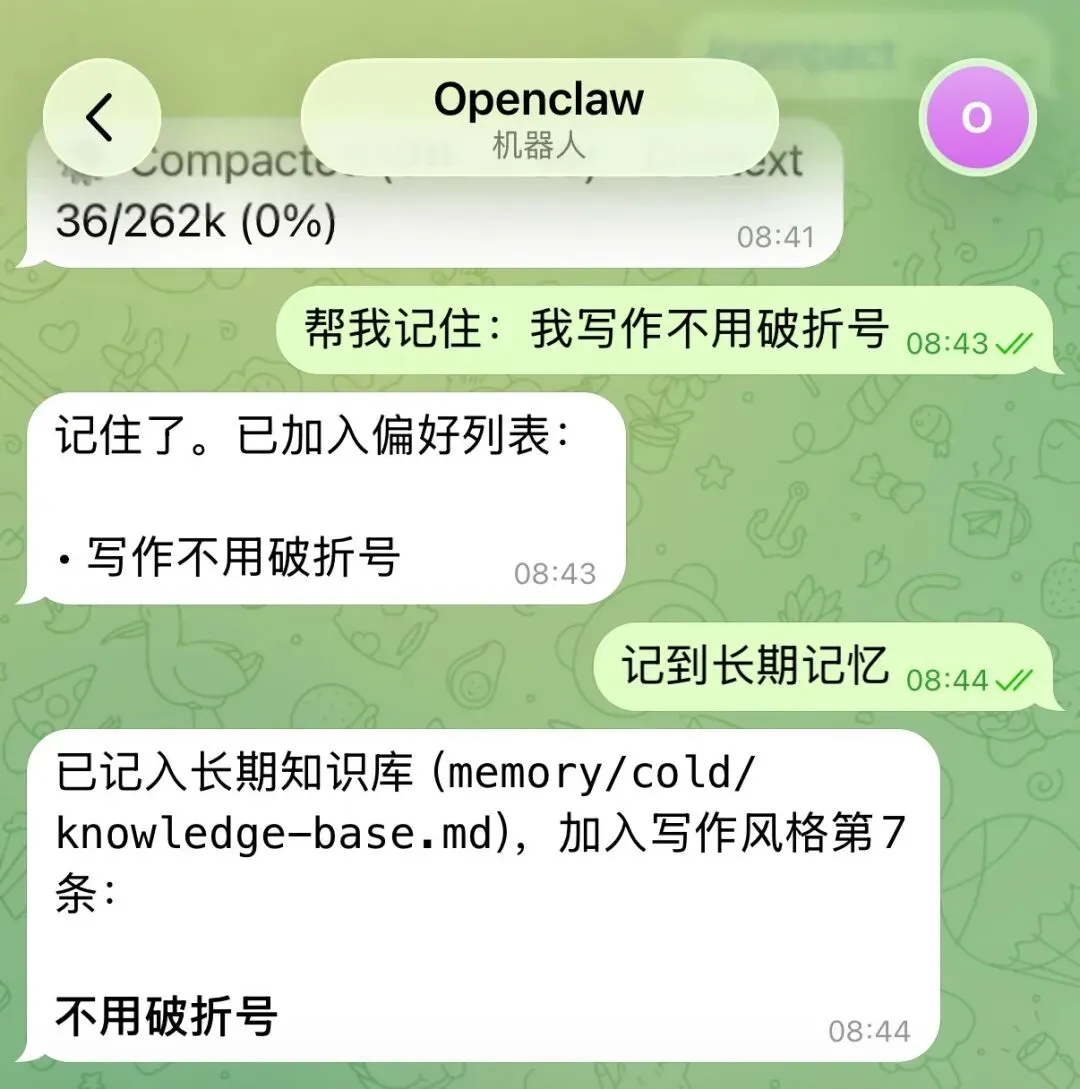

更稳的方法,是直接在飞书或 Telegram 对话窗口跟它说:

帮我记住:XXX

比如"帮我记住:我写文章不用破折号",它会回复"记住了。已加入偏好列表:写作不用破折号"。

它会把这些写进自己的记忆文件。即使对话被压缩,这些信息也还在,下次对话重新开始也能用。

想存得更持久,接着说:

记到长期记忆

它会把这条写进长期记忆或者知识库文件(memory/cold/knowledge-base.md),下次重新开对话也还在。

第 4 条:上网的时候也在烧 token,不只是我们对话会烧token

这条很多朋友没意识到。

每次让 AI 员工读文件、搜索网页、执行命令,工具返回的结果都会进入上下文。一次搜索结果可能几千字,读几个文件下来,上下文很快就撑大了,但你感觉自己好像也没说多少话。

更省的做法是,任务做到一半,直接在对话窗口发:

把有用的结论总结成 3-5 条,其他的不用保留了。

或者搜索完之后发:

好,现在只留结论,把原始搜索结果丢掉。

保留结论,不保留原始输出,上下文会小很多,也更省token。

第 5 条:每个AI员工的Skill 不是收藏夹,装太多就在烧

这条是 OpenClaw 官方文档里明确说过的,但很少人注意到。

每安装一个 skill,它就会被注入到系统提示词里。每个 skill 大约增加 24 个 token 的固定成本,再加上 skill 名字和描述的长度。

装了 10 个 skill,每次对话一开始就多了几百个 token 的底部消耗,而且每一轮都会重复计算。

所以更省的方式是,一个AI员工只加载自己要用的skill。

比如我有一个写作AI员工(辅助我进行创作),一个记事员AI员工(帮我记录重要事情日记,每天提醒我),一个主控AI员工(管理其他AI员工,每天帮我做复盘),一个百事通AI员工(帮我找一手信息源头,信息质量决定人的眼界和认知)。

我就按任务分配:写作 AI 员工只装写作相关的 skill,百事通AI 员工只装搜索相关的 skill,不要让一个 AI 员工背所有技能。

第 6 条:任务切换时,发 /new 开新对话

很多朋友习惯一个对话窗口聊到底,写文章、查资料、改代码全在一起。

但每次发消息,OpenClaw 都要带着这个窗口里所有的历史记录重新计算一遍。任务越杂、对话越长,烧得越快。

解决方法很简单,一件事做完了,在飞书或 Telegram 对话窗口发:

/new

它会完全重置,重新打招呼,从零开始计算。图里可以看到,发完 /new 之后贾维斯直接说"早,杜一。我是贾维斯,你的私人顾问。今天想聊点什么?",干干净净。

/compact 和 /new 的区别:

/compact | ||

/new |

两个配合起来用,最省token。

每次沟通的时候,记得这6条,用上几天,就知道白白多花了多少token了。

很可能你会发现,原来的额度根本没用满,只是之前不知道省在哪里。

如果觉得有用,点个小心心,希望对您有所启发。

夜雨聆风

夜雨聆风