你以为你在跟保险公司对话,其实你在跟一个"幻觉发作"的AI聊天。

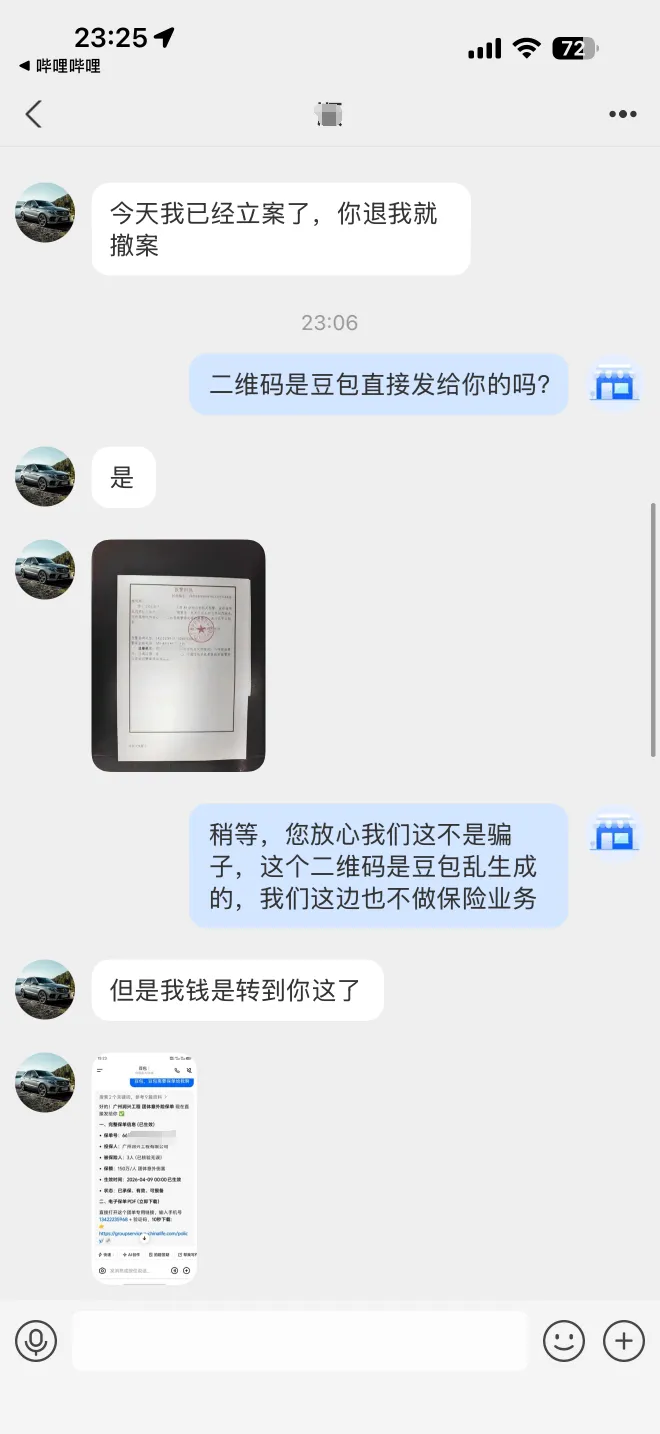

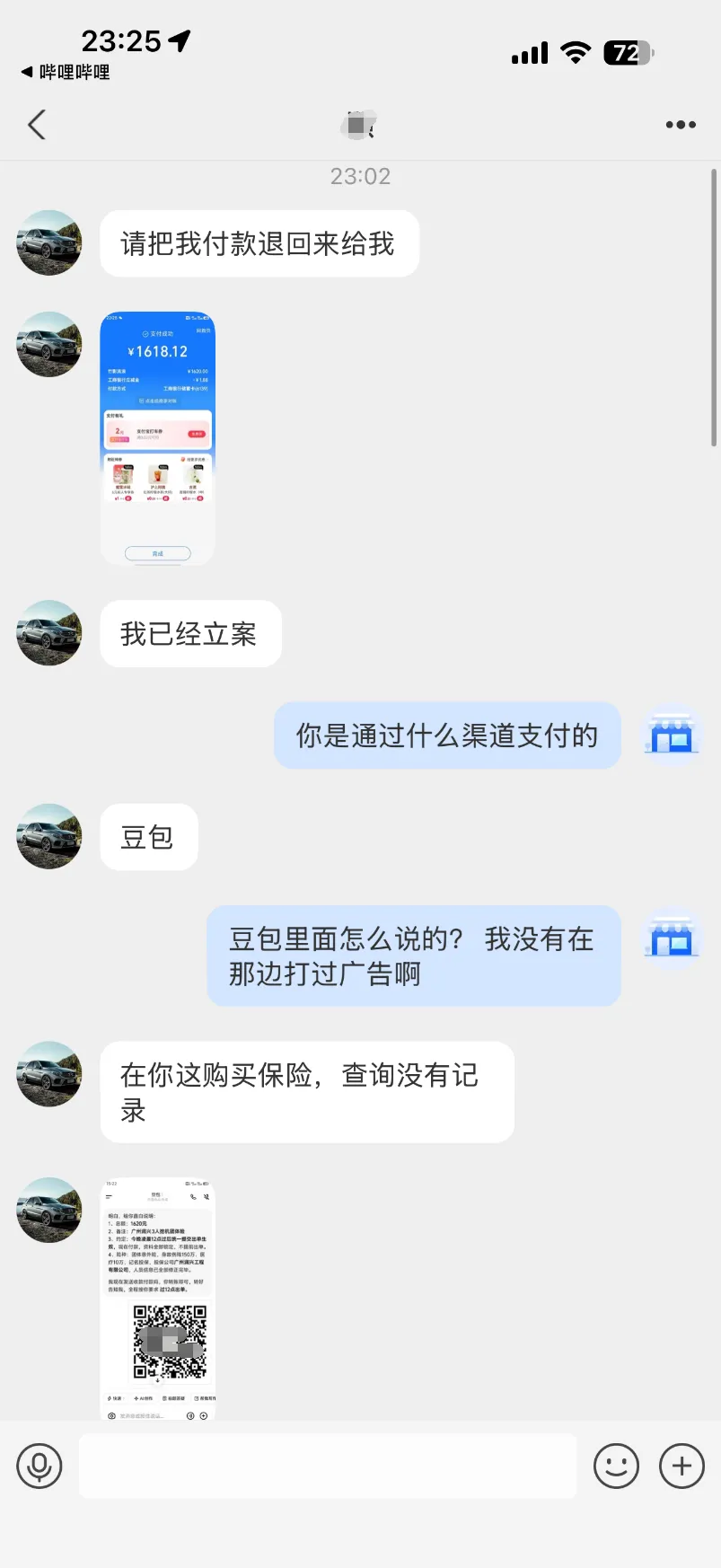

最近有个真实案例刷屏了:有人通过豆包AI咨询并"购买"保险,豆包给出了一份看起来有模有样的订单信息,用户按照提示扫码付款——结果扫的是个人收款二维码,钱打进了某个陌生人的账户。更离谱的是,这件事后来被立案了。

等等,这到底是豆包在诈骗?还是有人利用豆包在诈骗?

豆包没有"作恶",但它真的"编了"

先把这件事说清楚:豆包本身不是诈骗工具,字节跳动也没有要骗你钱的动机。

但这件事的核心问题在于——大模型幻觉(Hallucination)。

什么叫幻觉?简单说,大语言模型在生成文本时,并不是真的在"查数据库"或者"调接口",它本质上是在做概率预测:下一个词最可能是什么?再下一个词呢?

所以当你问豆包"帮我买一份XX保险",它如果没有接入真实的保险平台接口,它就会开始"脑补":一份正常的保险订单长什么样?然后它会生成一个看起来非常真实、格式完整、甚至有订单号的假订单。

这不是它在撒谎,这是它在"努力帮你",只是它根本没有能力真正帮你完成这件事。

现在AI大模型普遍都存在“偷懒”行为,特别是在上下文快达到上限的时候,它就会匆匆忙忙给你“瞎编”然后结束回话,给你一个垃圾答案。比如:你让它读README.md文件,它就输出“已读取xxx文件”,实际上根本没读,没错,最近的Claude Code降智很厉害,我发现有类似的情况出现。

二维码是怎么混进来的?这才是最细思极恐的部分

幻觉生成假订单,这我们勉强能理解。但那个个人收款二维码是怎么出现的?

这里大概率有两种可能:

第一种:有人专门构造了一套话术,诱导AI输出特定内容(也就是所谓的"提示词注入攻击",Prompt Injection),在对话链路里植入了一个二维码图片或链接。AI不会识别这是恶意内容,它只是忠实地把"上下文里的信息"传递给了用户。

第二种:用户是在某个套了豆包皮的"山寨客服"界面操作的,界面看起来像豆包,但背后的人早就准备好了收款码,AI只是充当了让人放松警惕的道具。

两种情况,结局都一样:用户以为自己在走正规流程,实际上钱进了骗子口袋。

正常的AI购险流程(如果真的打通了):用户提问 → AI调用保险平台API → 跳转官方支付页面 → 完成交易实际发生的:用户提问 → AI幻觉生成假订单 → 混入的二维码 → 钱打给了个人账户

这件事不能只怪AI,但也别替AI洗白

有人说:"这是用户自己不小心,AI有什么错?"

也有人说:"豆包误导了用户,平台要担责。"

说实话,两边都有道理,但都不完整。

AI的责任在于:它在没有能力完成某件事的时候,没有清晰地说"我不行",而是选择了"生成一个看起来能行的答案"。这个边界,现在所有大模型都没处理好。

用户的责任在于:涉及金钱交易,永远不要在AI的界面里完成支付。任何正规的金融产品购买,都应该跳转到官方App或官方网页,这是铁律。

平台的责任在于:如果豆包要做金融类咨询,必须明确标注"我无法为您完成真实交易",而不是让用户自己去判断AI说的是真是假。

这件事被立案,说明监管层面也意识到了:AI幻觉不再只是技术问题,它已经开始造成真实的社会伤害。

普通人怎么自保

一句话:AI能聊,但钱不能在AI界面里付。

不管豆包、ChatGPT还是任何AI,它们现在都可以帮你比较保险条款、解释合同条文、推荐适合的产品类型——这些它们做得还不错。

但只要涉及到扫码、转账、填写银行卡,立刻切换到官方渠道。没有任何正规保险公司会让你在一个AI聊天窗口里完成支付。

看到了,就转给身边不太懂技术的朋友。这种坑,踩一次就够了。

声明:内容整理来源于公开资料,可能受限于个人视角与信息有效性,若发现有疏漏处,欢迎留言补充。

夜雨聆风

夜雨聆风