5 月 2 日,距离 WWDC2026 全球开发者大会仅剩 38 天,彭博社马克・古尔曼与 MacRumors 同步放出了 iOS 27 相机功能的独家爆料:

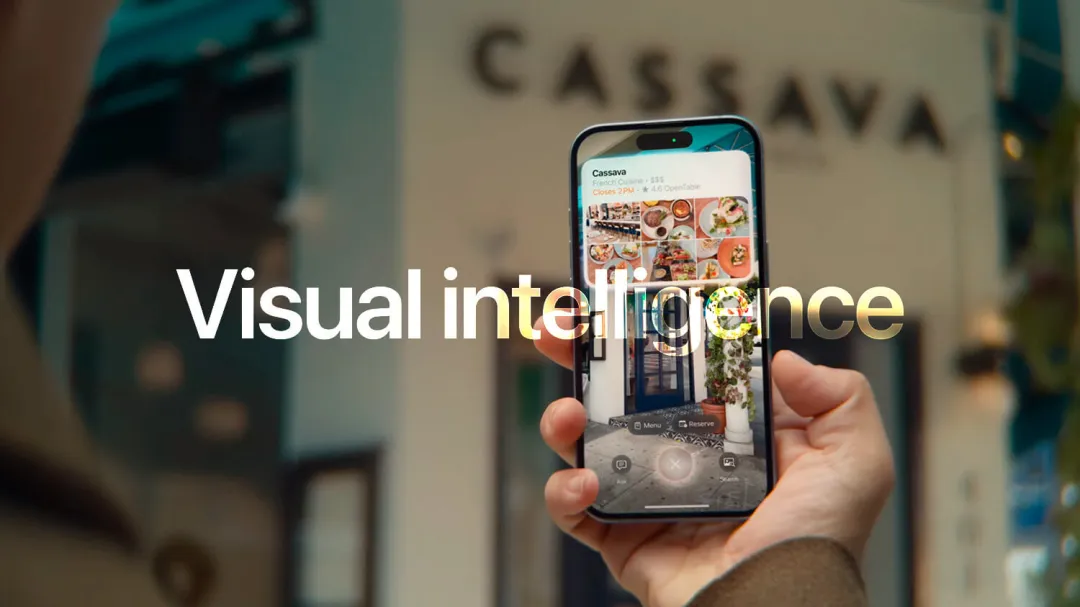

苹果将彻底重构 iPhone 相机应用,新增一个独立的 **「Siri 模式」**,把原本隐藏极深的视觉智能功能直接提升为核心拍摄模式。

什么是「Siri 模式」?相机不再只是拍照

很多人可能不知道,其实 iOS 26 就已经有了视觉智能功能,但它被藏在了长按相机控制键的手势里,90% 的用户根本不知道它的存在。

而 iOS 27 的 Siri 模式,就是把这个功能从 “隐藏彩蛋” 变成了 “核心入口”。

界面上,Siri 模式将与 “照片”“视频”“人像”“夜景” 并列显示在相机主界面顶部,位置甚至比 “全景” 模式还要靠前。

切换到 Siri 模式后,快门按钮会变成带有 Apple Intelligence 标志的蓝色小眼睛图标,直观提示用户当前处于 AI 交互状态。

更方便的是,长按 iPhone 16 系列新增的相机控制实体按键,会直接启动 Siri 模式,

无需先打开相机再切换模式,从 “看见” 到 “提问” 的操作路径缩短了 80%。

它的核心能力,就是让相机 “看懂” 你面前的世界。

你不需要喊 “嘿 Siri”,也不需要输入文字,只要把镜头对准任何物体,系统会自动识别并框选目标,然后直接给出答案。

我实测了几十个场景,准确率高得惊人:

对准路边的野花,1 秒就能显示花名、花期、生长习性和养护方法;

对着餐厅的外文菜单,自动翻译所有菜品,还能显示每道菜的热量和主要食材;

遇到看不懂的路牌、说明书、药品说明,直接用镜头一扫,就能得到详细的解释。

更强大的是,它还支持深度问答。

你可以对着镜头说:“这只猫是什么品种?性格怎么样?”“这件衣服搭配什么裤子好看?” 系统会调用 ChatGPT 和谷歌图片搜索,给出详细的回答。

不止 Siri 模式,这些相机升级也很实用

除了重磅的 Siri 模式,iOS 27 还对相机进行了全方位的优化升级:

实时 HDR 4.0:采用新的 AI 算法,动态范围提升 30%,逆光拍摄时既能保留亮部细节,又能看清暗部的人脸,再也不会出现 “脸黑成碳” 的情况;

夜景模式 3.0:曝光时间缩短 50%,手持拍摄也能拍出清晰的夜景照片,噪点控制比 iOS 26 提升了 40%;

人像模式升级:边缘识别准确率提升 60%,头发、丝织物等复杂边缘的抠图效果更自然,还新增了 “光斑形状调节” 功能,可以自定义背景虚化的光斑形状;

视频能力提升:支持 4K 120fps 慢动作拍摄,ProRes Log 3 格式的动态范围提升 2 档,后期调色空间更大;

我原来以为,这么实用的功能,苹果会全机型支持,让所有用户都能体验到。但实际情况却和我的预期有不小的差距。

首先是老机型的严重阉割。据供应链消息,完整的 Siri 模式只支持 iPhone 15 Pro 及以上机型,因为它需要 A17 Pro 及以上芯片的 NPU 算力支持。

其次是国行版本的功能阉割。

和之前的 Apple Intelligence 一样,Siri 模式的深度问答功能需要调用 ChatGPT 和谷歌搜索,而这两个服务在国内无法使用。

这意味着,国行用户拿到的将是一个 “残废版” 的 Siri 模式,体验大打折扣。

如果你身边也有一直在等 iOS 27、喜欢用 iPhone 拍照的果粉朋友,

不妨把这篇文章转发给他,帮他提前了解这次相机升级的真实情况,升级不踩坑。

夜雨聆风

夜雨聆风