导语:当云端 AI 卷到飞起的时候,一个社区开发者悄悄把 Google AI Edge Gallery fork 了一份,塞进 llama.cpp、stable-diffusion.cpp、whisper.cpp 三大引擎,拼出了一个能在 Android 手机上完全离线跑通聊天、语音、画图、视觉问答、文档分析的本地 AI 套件——Box。它不是什么横空出世的神作,但它可能代表了端侧 AI 正在从"技术秀"走向"真产品"的一个关键拐点。

一个 fork,五种能力,零云端依赖

5 月 2 日,X 平台用户 @QingQ77 发布了一条推文,展示了一个名为 Box 的 Android 应用。推文原文写得很直白:

在 Android 设备上完全离线运行 AI 聊天、语音对话、图像生成、视觉问答和文档分析,不依赖任何云端服务。

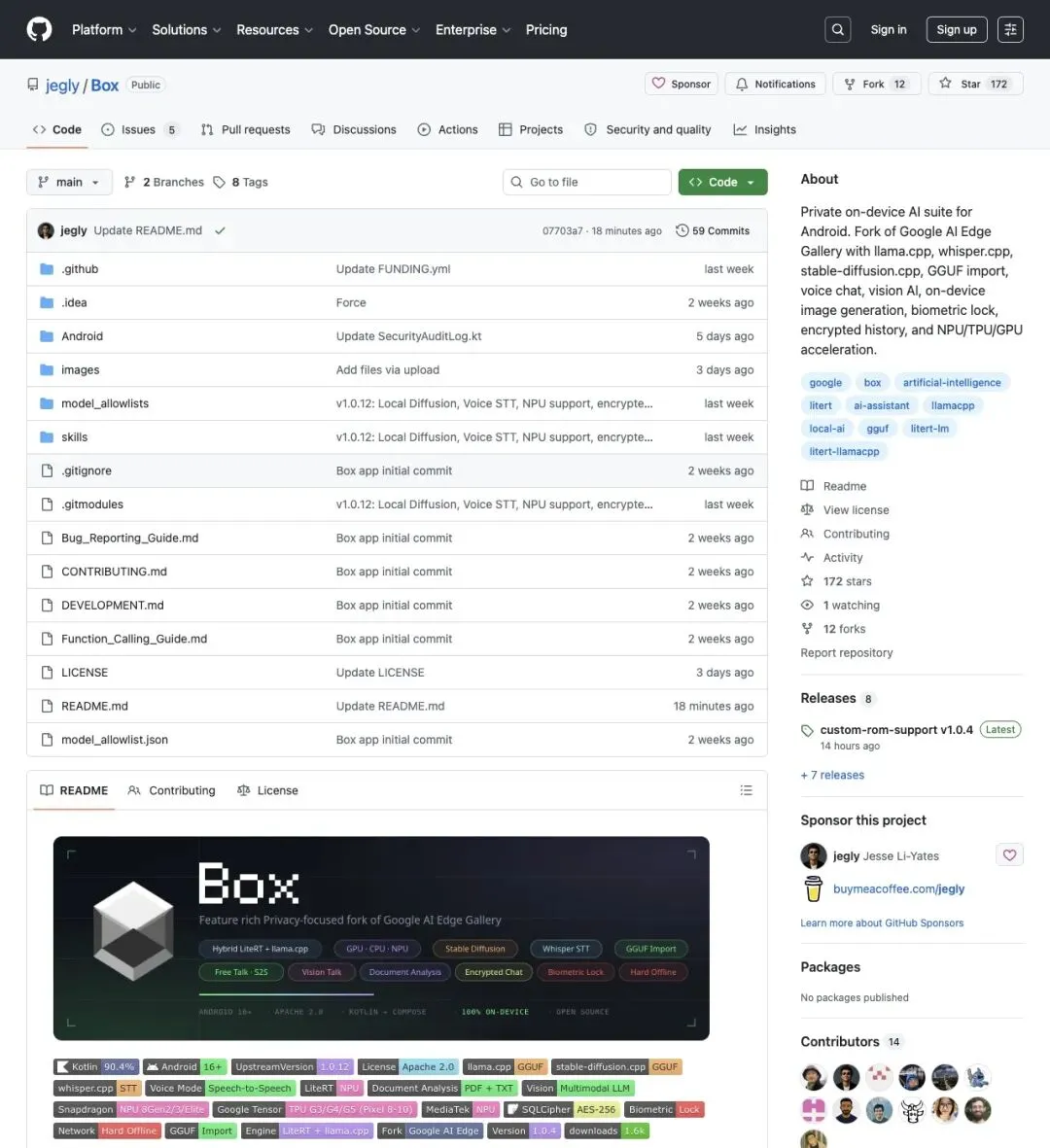

这条推文指向的 GitHub 仓库是 `jegly/Box`,截至抓取时有 172 颗 star。数字不算夸张,但打开 README 细看,这个项目的野心比 star 数暗示的要大得多。

Box 给自己的定位是"Private on-device AI suite for Android"——一个私有的、完全在设备端运行的 Android AI 套件。它的 README 开门见山写了一句话:"No Cloud. No Compromise."

它覆盖的能力清单包括:本地 AI 聊天、语音输入与语音连续对话(Free Talk 模式)、摄像头视觉问答(Vision Talk)、本地图像生成、文档分析、GGUF 模型导入、加密聊天记录、生物识别锁、NPU/TPU/GPU 多后端加速,以及一个叫"硬离线模式"的功能——确保在任何场景下都不会偷偷联网。

但最关键的一点是:Box 并非平地起楼。README 里写得明明白白——"Box is a security-hardened fork of Google AI Edge Gallery"。它是 Google 官方 AI Edge Gallery 项目的一个社区分支,在上游的底座上做了更激进的能力拼装和安全加固。

上游是 Google,下游是社区:一场接力式的产品化

要理解 Box,必须先看它的上游。

Google AI Edge Gallery(GitHub 仓库 `google-ai-edge/gallery`,22428 star)是 Google 官方推出的一个 Android 端本地 AI 体验应用。它的 README 把定位写得很清楚:

"Experience high-performance Generative AI directly on your hardware — fully offline, private, and lightning-fast."

这个应用本身已经支持本地 AI 聊天、图片问答(Ask Image)、语音转写(Audio Scribe)、Prompt Lab 等能力,也已经做了模型管理和 benchmark 功能。换句话说,"Android 本地离线 AI"这件事,Google 自己已经开了头、搭了架子、写了规范。

那 Box 做了什么?

它在 Google 的底座上,补了三个社区最成熟的 C/C++ 推理引擎:

- llama.cpp

:社区公认的本地大模型推理标杆,支持 Llama、Gemma、Qwen、Mistral、Phi 等几乎所有主流开源模型的 GGUF 格式推理; - stable-diffusion.cpp

:本地图像生成引擎,让手机不联网也能出图; - whisper.cpp

:OpenAI Whisper 的 C++ 移植版,本地语音识别。

在这三个引擎之上,Box 又往产品方向做了不少增量:Free Talk 连续语音对话(点一下就能和 AI 持续聊,不用反复按按钮)、Vision Talk 摄像头实时问答、文档分析、GGUF 模型自由导入、加密聊天记录、生物识别解锁,以及专门为 GrapheneOS、LineageOS、CalyxOS 等自定义 ROM 提供的独立分支和 release。

从 Google AI Edge Gallery 到 Box,这条路线可以用一句话概括:Google 证明了"手机能跑本地 AI",Box 想证明"手机上的本地 AI 能当产品用"。

真机 benchmark 已经开始跑了

最能说明一个项目是否真的有生命力的,往往不只是 README 有多漂亮,还要看社区里有没有人在认真讨论性能。

Box 的 GitHub issue #16 标题是"Benchmark collection for different AI models and devices"。维护者和社区成员在这里收集不同设备、不同模型、不同后端的实机跑分。

目前可见的一组样本数据来自一台Google Pixel 9 Pro XL,运行 GrapheneOS(Android 16),Box 版本 v1.0.3custom,测试模型为Gemma-4-E4B-it:

需要说明的是,这是社区 issue 中的自报数据,不是独立实验室的标准化测试。但即便如此,这组数字也透露出几个重要信号:

首先,GPU 后端的 prefill 速度(120 TPS)远超 NPU 和 CPU,但 decode 速度三者差距相对可控(7.4–9.5 TPS),说明当前硬件条件下本地大模型的"生成速度"已经进入可用区间。

其次,该 issue 中提到 CPU 推理会导致设备明显发热,而 GPU 和 NPU 后端没有出现同等问题。这对实际使用体验至关重要——如果手机跑 AI 跑到烫手,用户是不会长期用的。

第三,也是最重要的一点:当社区讨论已经细化到"哪个后端更省电""首 token 要等多久""哪个 ROM 兼容性更好"的时候,这个项目就已经不只是一个技术演示了。

社区在聊什么?安装、快捷入口、设备适配

翻看 Box 的 issue 列表,你会发现讨论内容已经相当"产品化":

- Better Obtainium support

:有用户在问能不能通过 Obtainium(一个 Android 应用自动更新工具)更方便地跟进 Box 的版本发布; - Widget/Shortcut for Voice2Voice mode / Vision Mode

:有人提需求,想把语音对话和视觉问答做成手机桌面快捷方式,一键直达; - Benchmark collection

:前面提到的性能收集帖; - Tensor / TFLite 安全与性能

:有 issue 在讨论 Google Tensor 芯片的性能层级选项,以及 TFLite reduce op 的安全检查。

这些 issue 的共同特征是:没有人在问"这东西能不能跑",大家在讨论的是"怎么用得更顺"。

另外一个值得注意的细节是,Box 的 README 专门为多个自定义 Android ROM 做了适配说明,包括 GrapheneOS、LineageOS、CalyxOS 等。这些 ROM 的用户群体恰好和"在意隐私、想要离线 AI"的需求高度重合。开发者专门为这些用户群维护独立分支和 release,说明他不是在对着空气写代码——背后已经有一群足够认真的真实用户在给反馈。

端侧 AI 正在从"能跑"进化到"能用"

把视角从 Box 拉远一步,它所代表的趋势可能比项目本身更值得关注。

过去两年,"本地 AI"在技术圈已经从概念变成了现实。llama.cpp 让大模型在笔记本和手机上跑起来了,whisper.cpp 让离线语音识别不再是梦,stable-diffusion.cpp 把出图能力压到了移动端。但长期以来,这些能力是分散的——你想聊天得装一个 app,想画图得装另一个,想语音转写又是第三个,而且大多数都还停留在"跑通了就是胜利"的 demo 阶段。

Box 做的事情,本质上是一次能力收口:把聊天、语音、视觉、图像生成、文档分析这些已经分别被验证可行的本地 AI 能力,收进同一个 Android 应用壳里,然后用加密、生物识别、硬离线模式这些产品化手段包装起来。

这件事在 Android 上发生几乎是必然的。相比 iOS 的封闭生态,Android 天然更适合这种"社区魔改全家桶"的玩法:可以自由 fork 上游项目、适配不同 SoC 的 GPU/NPU 后端、导入各种开源模型格式、甚至针对不同 ROM 做定制化发布。

Google 自己其实也看到了这个方向——AI Edge Gallery 的存在本身就说明 Google 在鼓励开发者把生成式 AI 搬到设备端。但大公司的产品节奏往往受限于内部优先级和合规流程,社区开发者的优势恰恰在于可以更快、更激进地把想法推到产品形态。

写在最后:172 颗星背后的信号

客观地说,Box 现在还是一个早期社区项目。172 个 GitHub star,种子推文的互动量也不算高。它不是那种已经全网刷屏的现象级产品。

但如果你关注端侧 AI 的演进路径,这个项目释放的信号比它当前的热度更重要:

当有人开始把 Google 的官方底座 fork 出来,往上叠加社区引擎、安全加固、产品化功能,再针对隐私向 ROM 做独立发布;当 issue 区里已经有人在认真提交不同机型的 benchmark,有人在要求桌面快捷方式,有人在讨论自动更新机制——

这说明"手机上完全离线跑 AI"这件事,正在从技术可行性验证,过渡到真实用户的日常使用场景。

Box 的 README 最后有一句 slogan 写得挺好:"No Cloud. No Compromise."不用云,也不将就。

这句话今天听起来还有点理想主义。但看看 llama.cpp 三年前刚出来时的样子,再看看它今天的生态规模——端侧 AI 从"能跑"到"好用"之间的距离,可能比大多数人以为的要短。

夜雨聆风

夜雨聆风