AI给AI写代码,这件事比你想象的更奇怪

软件吃掉世界,AI正在吃掉软件。但当AI开始给AI写代码,我们其实正在目睹一件在工业史上从未发生过的事:一台机器第一次有能力改进制造自己的流水线。这不只是效率问题,这是一个关于控制权的问题。

先说一个容易被忽略的事实:过去三年,GitHub Copilot、Cursor、Devin这些工具让「AI辅助写代码」变得稀松平常。但最近发生的事情有点不一样——AI开始被用来训练下一代AI,被用来生成AI的评测基准,被用来优化AI自身的推理链。这个循环正在悄悄闭合。

这一次,机器在改造自己的图纸

工业革命以来,机器一直在替代人类的体力。自动化流水线可以造汽车,但造流水线本身还是靠人。这条边界维持了两百年,从没被真正越过。现在它开始松动了。当OpenAI用GPT-4生成训练数据来微调GPT-4o,当Meta用代码生成模型来自动撰写系统测试,「制造工具的工具」这件事,第一次不完全需要人在场。

●这不是「AI更聪明了」,而是生产链的边界在移动——人类正在从「制造者」退到「监督者」的位置。

听起来很酷,但这里藏着一个真实的技术困境,工程师们每天都在跟它打架。

递归的代价:错误会自我繁殖

假设你让AI写一段代码,AI写完之后用另一个AI来做代码审查,审查通过之后这段代码被用来训练下一个AI模型。整个链条里,如果第一步引入了一个细微的偏差——比如某种不符合安全规范的代码习惯——后续每一步都可能把这个偏差当作「正确示范」放大。这就是递归污染的问题。

「

自动化系统最危险的不是它犯错,而是它把错误变成了标准。

」

这在统计学上有个名字叫「模型崩塌」(Model Collapse)。2023年牛津大学的研究已经用实验证明:如果反复用AI生成的内容训练AI,模型会逐渐失去对真实世界分布的感知,输出越来越同质化,最终变得既自信又错误。放在代码生成场景里,这意味着系统可能会越来越擅长生成「看起来正确」的代码,但实际上漏洞丛生。

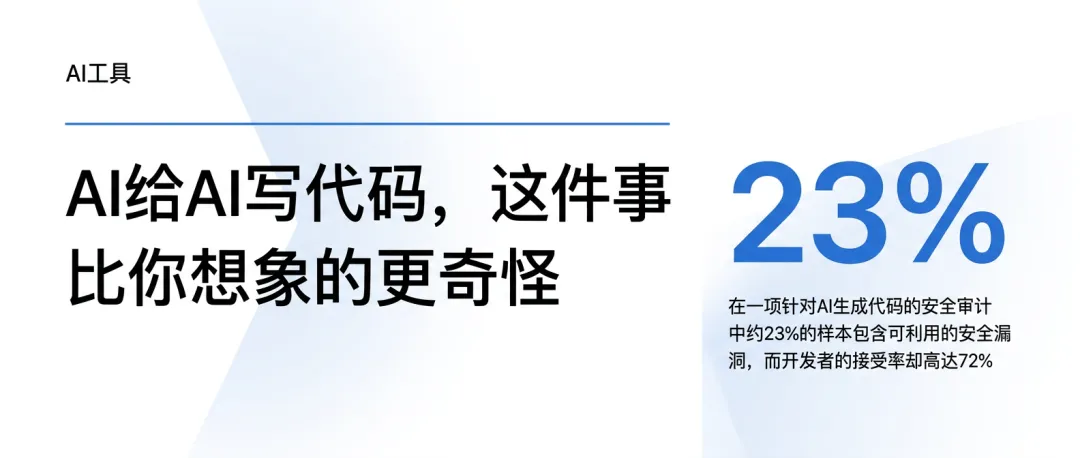

23%

在一项针对AI生成代码的安全审计中,约23%的样本包含可利用的安全漏洞,而开发者的接受率却高达72%

人类在这个循环里扮演什么角色

有一种天真的乐观主义认为:没关系,最后总有人类把关。但「最后把关」这件事,在规模化之后会变得非常困难。一个中型科技公司的代码库每天可能新增数万行AI生成代码,没有任何团队有人力逐行审查。于是「人类监督」在实践中往往退化成「人类抽查」,而抽查的样本是AI帮你挑的。

●监督者依赖被监督者来决定监督什么,这个逻辑漏洞几乎无解。

这不是危言耸听,这是当前工程实践里真实存在的张力。很多团队已经意识到这个问题,但解法还在摸索中。有人在做「AI生成代码的溯源标记」,有人在做「独立评估模型」——用一个与训练流程完全隔离的模型来做质量审查,就像财务审计要用外部机构一样。

但也别太悲观:约束本身就是进步

历史上每一次生产力工具的跃迁,都伴随着新的质量控制体系的诞生。印刷机出现之后,出版行业发展出了编辑、校对、版权的整套机制。互联网出现之后,搜索引擎的排名算法、社区的举报机制、平台的内容审核,都是在混乱中慢慢长出来的。AI写代码这件事,也会走同样的路。

1形式化验证工具正在被引入AI代码生成的下游,用数学证明而非人工审查来保证关键逻辑的正确性

2「红队测试」(Red Teaming)开始被系统化用于AI编程工具,专门寻找模型的盲点和习惯性错误

3一些公司开始要求AI生成代码必须附带「置信度说明」,让开发者知道哪些部分是模型不确定的

这些都是对的方向。但有一点需要清醒:这些机制需要人主动去建立,它们不会自动生长出来。技术的自我优化能力越强,人类主动介入、设定边界的责任就越重,而不是越轻。

所以「AI给AI写代码」这件事,本质上是一面镜子,照出了我们对自动化系统的一个根深蒂固的误解:我们以为自动化是在减少我们的工作,但实际上,它只是在把我们的工作从「执行」转移到「设计规则」。以前你写代码,现在你要想清楚代码应该被怎样写、怎样审查、怎样迭代。这个工作,目前还没有任何AI能替你做。

✦ 小结

AI自动化编程不是终点,而是一个新的起点——它把人类从执行者变成了规则制定者。但制定规则比执行规则难得多,而且一旦规则出错,整个系统会以你看不见的速度把错误放大。这才是这场变革真正值得认真对待的地方。

夜雨聆风

夜雨聆风