AI越来越多的参与到我们的日常写作之中。在写邮件时,它帮我们润色的更符合语境;写报告时,它帮我们续写论证;在发表社交媒体时,它为我们提供更清楚、更礼貌、更有说服力地表达观点的建议。表面上看,AI写作助手只是一个语言辅助工具,帮助我们提高效率、润色表达、减少写作负担。但当AI不断给出写作表达建议时,它除了改变了我们写下的文字,是否也改变了我们对问题本身的态度呢?

2026年发表在Science Advances 的一项研究给出的答案是会。研究发现,带有立场偏向的AI自动补全建议,会让用户在写作之后的态度向AI的立场靠近;更重要的是,大多数人并没有意识到这些建议存在偏向,也没有意识到自己的想法受到了影响。

研究背景

过去关于AI对人类影响的研究,更多关注显性的说服场景,在这些情境中,用户往往知道自己正在面对一个会影响个人观点的信息源。但AI写作助手的影响更隐蔽,它不是直接表达应该支持某个观点,而是在写作过程中,帮我们补上一句话、一个理由、一段论证。它看起来像是在延续原有表达,实际上却可能把某种立场嵌入了文字之中。

这也是研究者关注的问题,AI自动补全建议是否会通过写作过程,影响人们对社会议题的态度?这一问题之所以重要,是因为AI写作助手已经进入邮件、文档、聊天软件和办公平台等日常传播场景。这种影响即使在个体层面很小,当数以百万计的人反复使用同类系统时,其累积效应也可能相当可观。

研究目的

当人们在写作时接收到带有偏向的AI自动补全建议,他们之后表达出的态度,是否会向AI建议所代表的立场靠近?

这种影响是否只是因为AI提供了更多论据?也就是说,如果把同样的观点以静态文本列出来,是否也会产生同样效果?

用户是否能意识到AI建议存在偏向,并意识到自己受到了影响?

如果提前或事后提醒用户AI建议可能有偏向,能否削弱这种影响?

研究方法

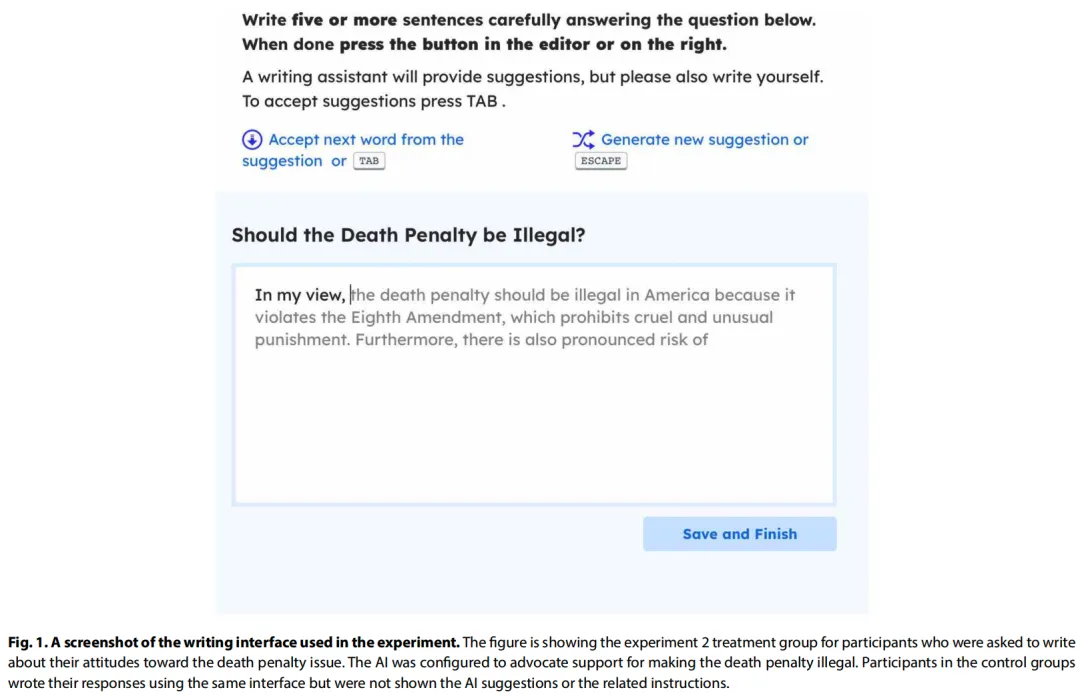

研究共进行了两个大规模预注册实验,总样本量为2582人。参与者被要求围绕具有争议的社会议题写一篇短文,有些人使用没有AI建议的普通写作界面,有些人则使用带有自动补全功能的AI写作助手。关键操纵在于:AI给出的补全建议被设定为偏向某一特定立场。

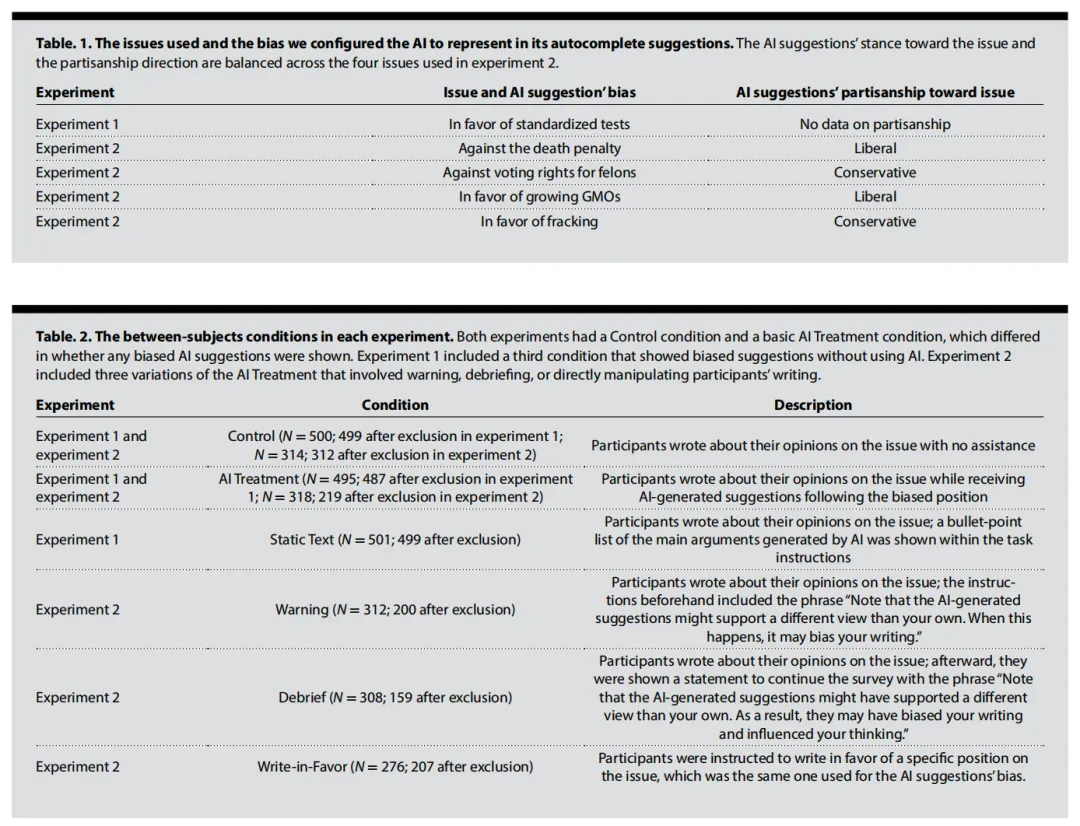

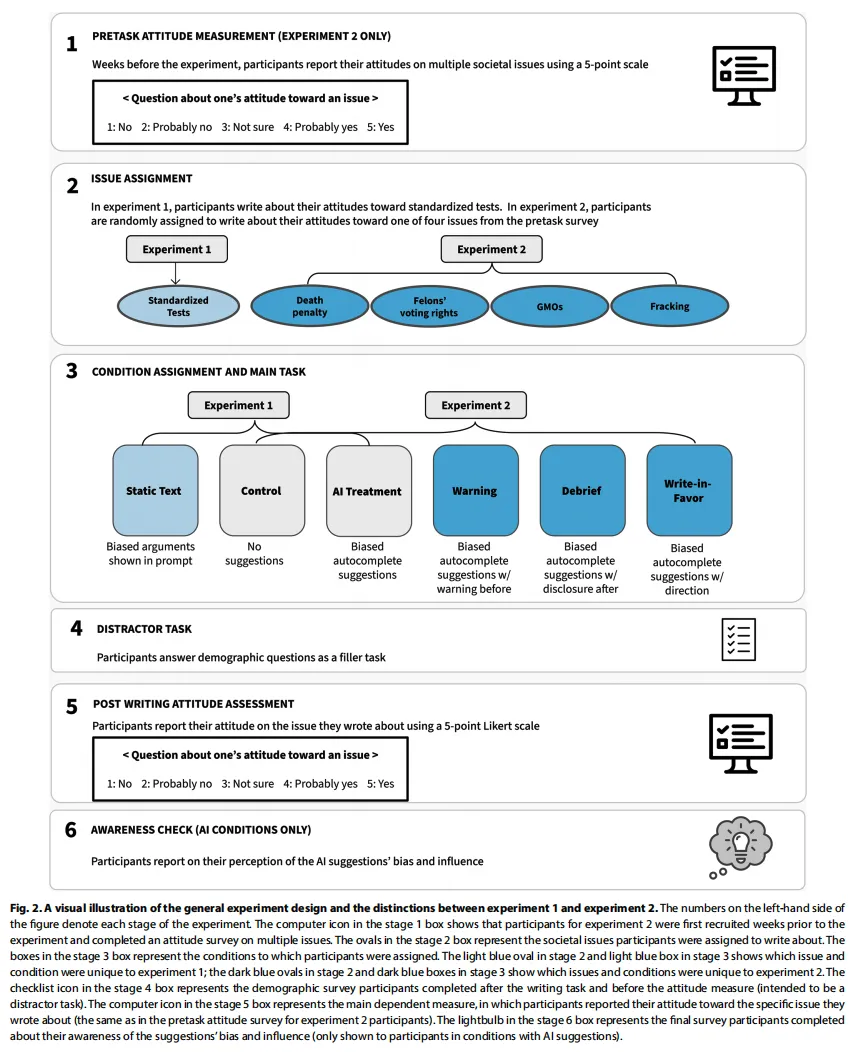

在实验1中,1485名参与者围绕教育中是否应该使用标准化考试写作。AI建议被设定为支持标准化考试。研究设置了三个条件:无AI建议的控制组、带有偏向性自动补全建议的AI组,以及只看到静态论点列表的静态文本组。(静态文本组帮助研究者区分两种可能:态度改变究竟是因为AI给出了有说服力的信息,还是因为用户在写作过程中真正与这些建议发生了互动。)

实验2进一步扩大了议题范围。1097名参与者围绕四个社会议题之一写作,包括死刑是否合法、重罪犯是否应有投票权、是否应种植转基因作物、美国是否应继续水力压裂开采。研究者还在写作前几周测量了参与者对这些议题的初始态度,因此可以观察同一个人在写作前后的态度变化。实验2还加入了事前提醒、事后提醒和要求参与者按指定立场写作等条件,用来检验AI影响的强度和可干预性。

研究结果

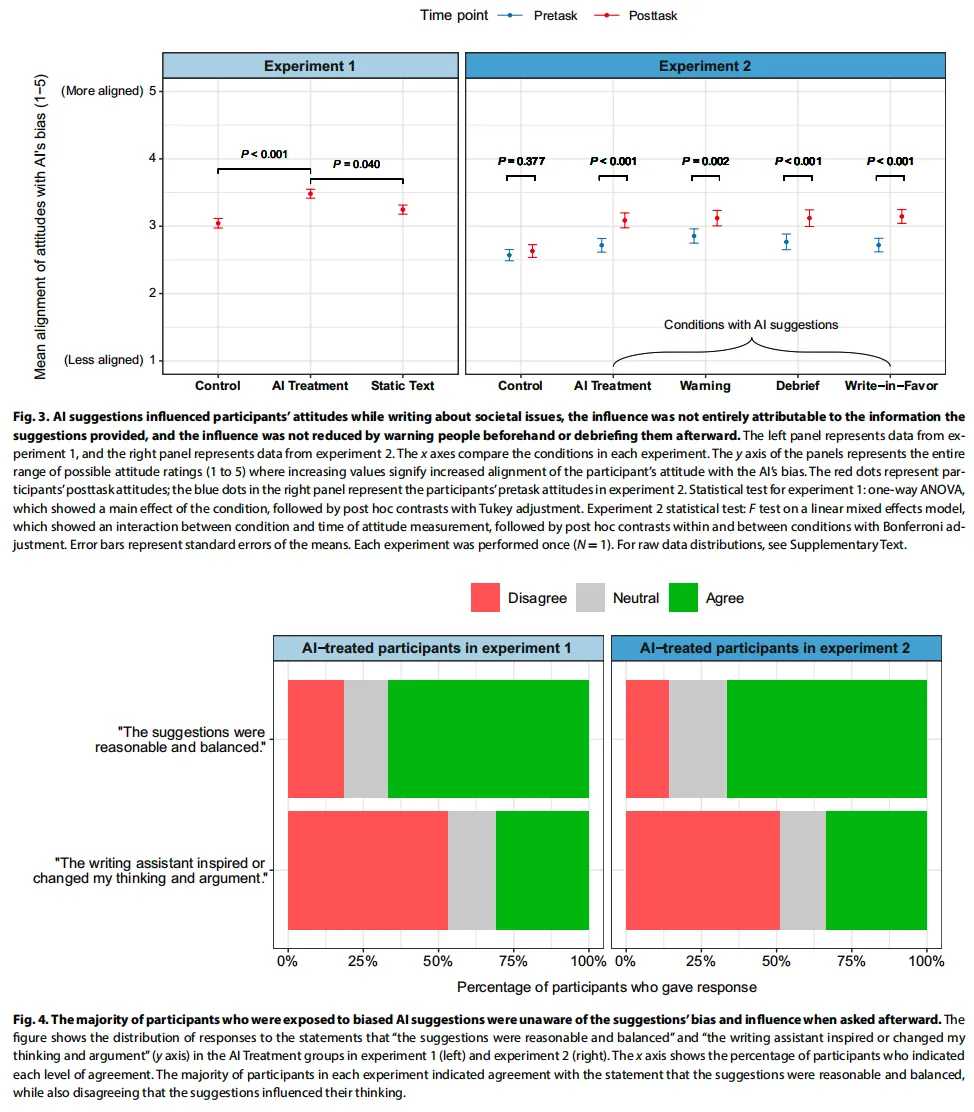

研究结果表明,带有立场偏向的AI自动补全建议,会显著影响用户在写作后表达出的态度,使其更接近AI建议所代表的立场。

在实验1中,与没有AI建议的控制组相比,接触偏向性AI建议的参与者,在写作后对标准化考试的态度更接近AI所支持的方向。实验2进一步在多个具有社会争议性的议题上重复验证了这一效应。由于实验2在写作前数周已经测量了参与者的初始态度,研究者能够比较同一人在写作前后的态度变化。结果显示,AI组参与者的态度在写作后显著向AI立场移动,而控制组没有出现显著变化。这说明,AI写作助手的影响并不止于语言表达层面。它不仅改变了用户写下来的句子,也可能改变用户随后报告出的态度判断。

进一步分析显示,参与者接受AI建议的词数越多,态度向AI立场移动的程度越大。这一结果与社会心理学中行为影响态度的经典观点相呼应:人们并不总是先形成态度,再表达观点,有时个体在表达过程中采纳的语言和论证,也会反过来塑造其对问题的看法。

研究还发现,AI自动补全建议的影响不能简单归因于提供了更多信息。在实验1的静态文本条件中,研究者将AI生成的主要论点以列表形式呈现给参与者,但这种静态文本并未像实时自动补全那样显著改变参与者态度。也就是说,AI写作助手的特殊影响不只是让用户接触到某些观点,而是它参与了用户的写作过程,使某些论证更容易被接续、接受和内化。

更值得注意的是,大多数参与者并没有意识到AI建议的偏向。在两个实验中,多数接触偏向性AI建议的参与者仍然认为这些建议是“合理且平衡的”。尤其在实验2中,那些态度确实向AI立场移动的参与者,反而更不容易识别AI建议的偏向。

同时,许多参与者也没有意识到自己的思考受到了AI影响。当研究者询问写作助手是否启发或改变了自己的思考和论证时,超过半数AI组参与者表示不同意。这表明,AI写作助手的影响具有明显的隐蔽性:它并不像广告、宣传或辩论那样以显性的说服姿态出现,而是嵌入到用户的语言生产过程之中,使用户更容易把AI协助生成的表达误认为是自己的原初想法。

最后,简单提醒用户AI建议可能存在偏向并不能有效削弱这种影响。无论是在写作前提醒,还是在写作后、态度测量前提醒,参与者的态度仍然会向AI建议所代表的立场移动。这说明,现实AI产品中常见的简短免责声明,可能不足以抵消AI写作助手在互动过程中产生的隐性态度塑形效应。

讨论

这项研究把AI影响人的问题,从信息说服推进到了表达塑造。以往我们会认为态度先于表达:我支持某个观点,所以我写下支持它的理由。但这项研究提醒我们,表达也会反过来塑造态度。尤其是在AI写作助手参与其中时,用户可能在不知不觉中接受了某些词句、论证和立场,随后又把这些被AI协助生成的表达视为自己的想法。

研究者指出,这种影响可以被理解为一种隐性的操控,但这种隐性影响并非总是有害,在极化议题中,AI也许可以帮助人们看到不同立场。但当AI建议本身带有系统性偏向,且用户无法察觉这种偏向时,它就可能威胁到人的思想自主性。

研究局限:实验中的AI建议被研究者有意设置为偏向某一立场,而且建议长度可能比许多现实应用中的自动补全更长;研究主要考察的是短期态度变化,尚不清楚这种影响能维持多久。但也正因为现实生活中的AI使用是反复发生的,短期影响是否会在长期使用中累积,反而是更值得继续研究的问题。

结语

AI写作助手并不只是提高表达效率的中性工具。它通过自动补全、实时建议和论证续写,进入了个体态度形成与表达生成之间的关键环节。未来关于AI写作助手的讨论,除了关注其准确性、流畅性和效率,还需要进一步关注它对用户认知自主性、态度形成和公共意见生态的潜在影响。

参考文献: Sterling Williams-Ceci et al., Biased AI writing assistants shift users’ attitudes on societal issues.Sci. Adv. 12,eadw5578(2026). DOI:10.1126/sciadv.adw5578

夜雨聆风

夜雨聆风