今日导读小知识

Theme · heihua

跟AI产品团队开会,这10个词你一定要懂!

#test#staging#canary其实说AI产品团队并不精确,事实上,只要是跟产品和技术团队有工作交集,可能都会遇到这些词。只是AI时代,让很多原本不用和产研团队对接的岗位有了产生交集的可能性,所以,今天这篇也许能为这部分读者提供一些帮助!

不知道你有没有注意到,跟AI产品团队开会,有个通病~

那就是,如果你不是搞技术的,他们嘴里蹦出来的词你一个都不懂,但你又不好意思说不懂……只能点头,心里默默记小抄,回去再偷偷搜……

dev、test、staging、canary、灰度(这个可能知道的人还多一点)、prod等等……

这种感觉我太熟了!

我,纯血文科生,去年之前看到代码避之唯恐不及……这些词一开始听着也完全懵,后来被逼着研究了一遍,发现其实会者不难,只是我们的工作环境里没人给我们好好解释过而已……

所以整理一个说人话的版本~

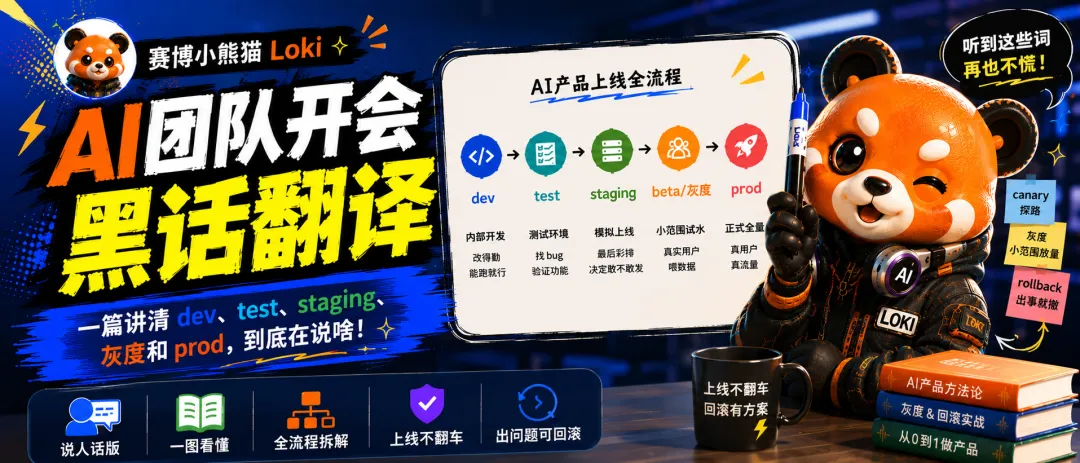

先画个地图,帮你建立一个基本认知。

一个AI功能从做出来到给用户用,通常要经过这几步:dev → test → staging → beta / 灰度 / canary → prod。

翻译成人话就是:内部开发 → 测试 → 模拟上线 → 小范围试水 → 正式全量上线。

不同公司节奏不一样,有些步骤会跳过,有些会反复来回,但大方向基本就是这条路,下面逐个说。

Section 01

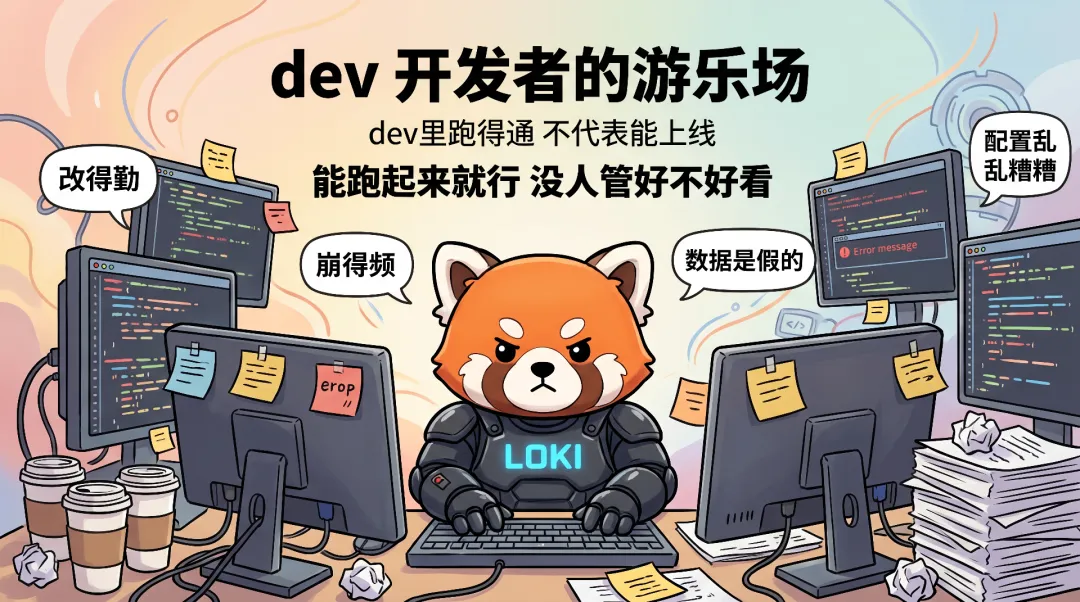

dev,开发者的游乐场

dev就是development,开发环境,说白了就是程序员平时自己写代码的那个地方。

特点是:改得勤、崩得频、数据是假的、配置乱糟糟,能跑起来就行,没人管好不好看。

在AI场景里,dev长这个样子——今天prompt改三版明天又换,工具链还没接全,模型参数还在乱调,日志监控都没配好。(就很草台班子,但这是正常的。

总之,dev里能跑,不代表可以上线。

Section 02

test,专门找bug的地方

test是测试环境。

dev是开发自己写自己试,test是专门验证有没有问题的地方。测什么呢?接口通不通、按钮能不能点、工作流会不会崩、权限有没有搞错。

但说实话,很多公司的test环境也不完全还原真实线上,只是比dev正规一点。所以test过了也不代表万事大吉,这也是为什么后面还有staging。

Section 03

staging,上线前的彩排

这是我觉得这几个词里最关键的一个,因为很多人会忽略它。

staging是预发布环境,核心是模拟真实环境,用来判断:现在到底敢不敢发?到了staging,团队不问「能不能做出来」,问的是「上了真实线上,会不会翻车?」staging通常看这些:

回答质量在真实环境里够不够用(prompt在dev里调得很好,一上真实环境效果突然变味,这种事真的太常见了……)检索内容靠不靠谱多步执行会不会跑偏接口会不会超时、高并发扛不扛得住模型版本、数据库权限配置,跟prod是否一致最后那条最关键!

毕竟AI功能最经典的翻车场景就是:本地演示惊艳,一上真实环境就哑火。

staging就是那最后一次确认:这东西到底是真能用,还是只会demo?

Section 04

beta,让用户帮你测

beta是测试版,对外可见的阶段,意思是功能可以给一部分用户用了,但默认它还没完全成熟。

两种常见形式:内测beta只给内部白名单或种子用户,人数少、可控;公测beta对外开放,但会明确告诉用户「还在迭代、可能不太好用」。

AI产品特别喜欢beta!

原因说白了,很多真实场景,内部根本测不彻底,必须让真实用户来喂数据,才能知道问题在哪。一般我们会帮忙做一些AI产品的内测,就是测这个版本!

所以你看到某款AI产品一直挂着beta标,有时候真的不是谦虚,或者故意吊着你,人家可能是真的还在观察~

Section 05

灰度,不敢全放,先放一点

灰度的意思是:不一次性全量发布,而是一部分一部分地放——先给1%用户,观察没问题,再给5%,再20%,最后全量。

(这个可能你会熟悉一点,之前即梦3.0、4.0发布的时候,有部分人用上了,还有好多人说自己没有,就是这个原因!前几天的gpt-image-2也是一样~)

灰度和beta的区别在于,beta强调的是「这个版本还在测试」,灰度强调的是一种发布策略,两个其实是不同维度的概念,可以同时用的。

AI产品也很喜欢灰度,因为不确定因素太多了:成本不确定、延迟不确定、效果波动大、用户反馈不可控……先放一小波人,盯住使用率、留存、崩溃率、单次调用成本,确认没有明显问题,再继续放量。

Section 06

canary,用金丝雀探路

canary叫金丝雀发布,名字来自矿工用金丝雀探测毒气的典故:先让金丝雀进去,有问题它先倒,人可以及时撤退。

做法是让极小比例的流量走新版本,比如0.5%用户用新模型,重点盯指标,一旦有问题立刻回滚。

AI场景里canary特别适合这几种情况:替换底层模型、改prompt编排逻辑、上新工具调用框架、改检索策略……这些变动表面看着小,实际可能造成全局影响,所以要先探路。

Section 07

prod,真刀真枪

prod是production,生产环境,真实的线上。

真用户、真流量、真数据、真成本、真出事。说某个功能「上prod了」,就是正式上线了,不是演示,不是测试,是玩真的。

AI产品上prod之后最关注的事:用户体验怎么样、准确率有没有飘、成本有没有超、延迟能不能接受,以及如果出了问题,能不能快速回滚?最后那条,跟「能不能发出去」一样重要,有时候甚至更重要。

Section 08

sandbox,隔离试验区

sandbox是沙盒,核心关键词是隔离,有两种用法:一种是安全隔离,让AI执行代码或调用工具,但限制权限,不让它乱来(比如它可以跑代码,但不能读你的文件系统);另一种是给开发者一个sandbox key,先试功能,不影响真实数据和用户。

说白了就是一个围起来的试验区,你在里面随便折腾,外面的东西不受影响。

(如果你日常用过agent,一定对这个词不陌生的

Section 09

A/B test,对照实验

这个倒不是只有AI在用,其实是一个很古老的实验方法,不仅仅是互联网时代,在互联网之前,所有的实验基本上都有这个步骤。

把用户随机分成两组,A组用旧版,B组用新版,比较关键指标,看哪边表现更好。

AI里常用来判断:新prompt回答质量有没有真的提升、新模型效果怎么样、长回答和短回答哪种用户更爱用。(比如你在跟GPT对话的时候,他有的时候会给你两个答案,然后他会让你去选你更喜欢哪个答案,这个其实就是一种对照实验。)和灰度的区别很清楚:灰度是控制风险,A/B test是验证收益。

灰度是我不确定新版会不会出事,先小范围放,A/B test是我觉得新版更好,但需要数据来证明。

Section 10

rollout和rollback,配套用的

rollout是逐步发布:今天10%,明天50%,后天全量。

rollback是回滚:新版本出问题,退回旧版本。

成熟的团队这两个通常是配套的。AI产品的rollback特别常见,因为问题往往不是「挂了」,而是更隐蔽的那种。比如,效果悄悄变差、幻觉突然变多、成本悄然暴涨、某个用户群体的体验突然崩了……

所以一个成熟的AI功能上线,能不能快速回滚,跟能不能发出去一样重要。

Section 11

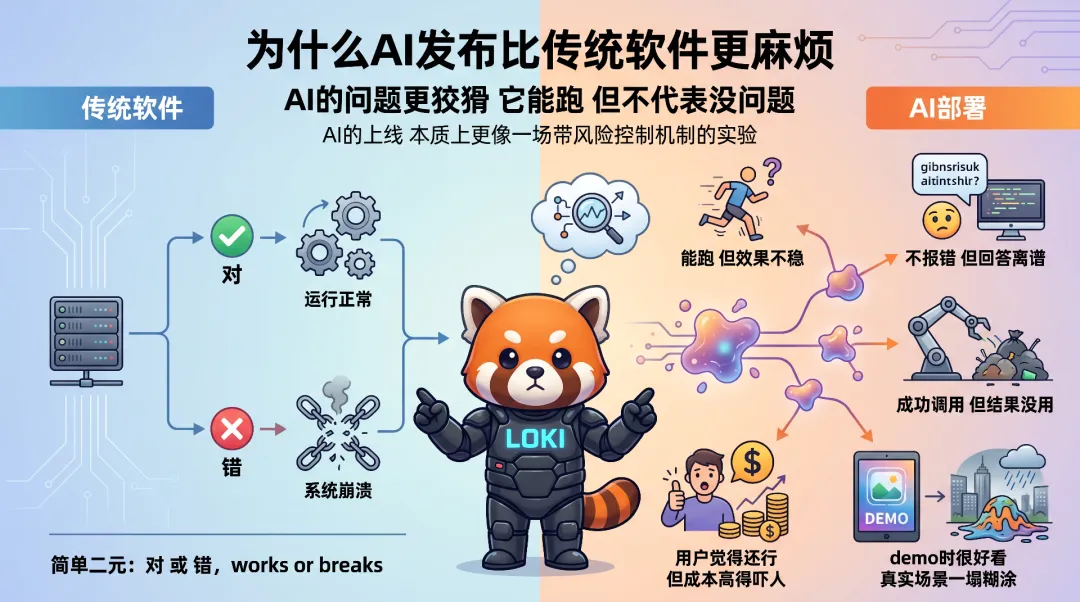

为什么AI发布比传统软件更麻烦

传统软件的问题通常是对或错:要么功能跑通了,要么报错了。

AI的问题更狡猾,它能跑,但不代表没问题。

能跑,但效果有问题;不报错,但回答离谱;成功调用了,但结果没用;用户觉得还行,但成本高得吓人;demo时很好看,真实场景一塌糊涂。

所以AI团队才会反复说【先上staging看看】【先灰度】【先canary】【不行就rollback】。AI的上线,更像一场带风险控制机制的实验,跟软件交付差远了。

Section 12

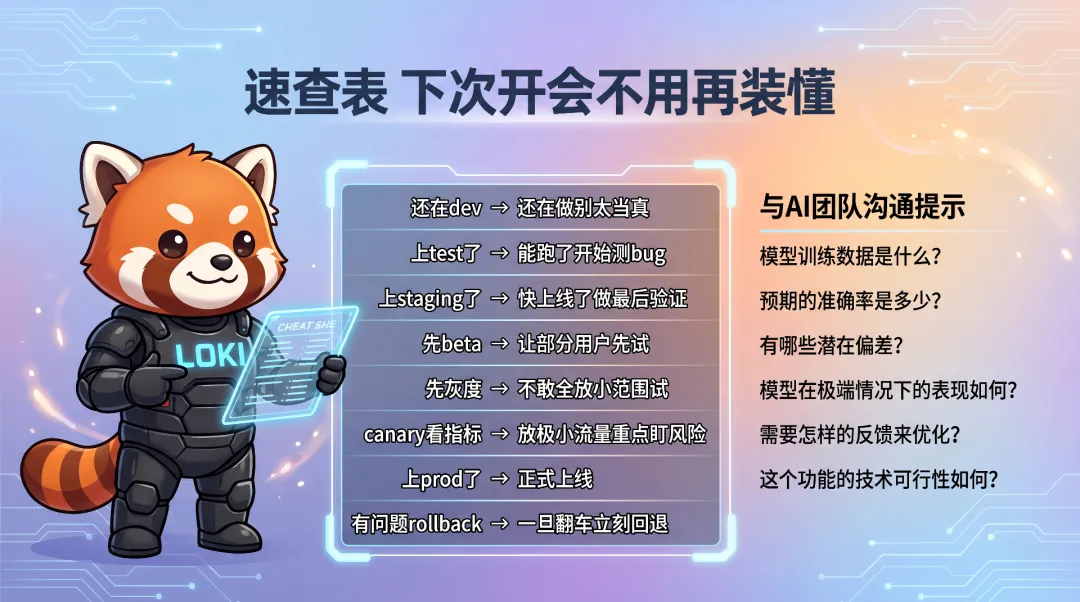

速查表

还在dev,就是还在做别太当真;上test了,就是能跑了开始测bug;上staging了,就是快上线了在做最后验证;先beta,就是让部分用户先试还在打磨;先灰度,就是不敢全放小范围试;canary看指标,就是放极小流量重点盯风险;上prod了,就是正式上线;有问题rollback,就是一旦出事立刻回退。

Section 13

跟AI团队开会,可以这么问

这个功能现在在dev / test 还是staging?staging和prod的模型版本一致吗?这次是beta还是正式发布?灰度的放量规则是什么?观察哪些指标决定全量?效果变差有回滚方案吗?这次上线关注的是bug风险、效果风险还是成本风险?

如果你也是文科生,正在跟AI团队或AI产品打交道,希望这篇能让你下次开会的时候不用再微笑点头装懂——至少知道他们在说什么,哪步出了问题,该问哪个问题。

(老规矩,欢迎转给有同样困惑、需要帮助的朋友。)

夜雨聆风

夜雨聆风