生成式AI生成用户画像,

真的安全吗?

生成式AI 正在被大量用于自动生成用户画像(GenAIPs)。它更快、更省事、结果产出更精美,却很少有人意识到:AI生成的用户画像,可能会带来系统性的风险。

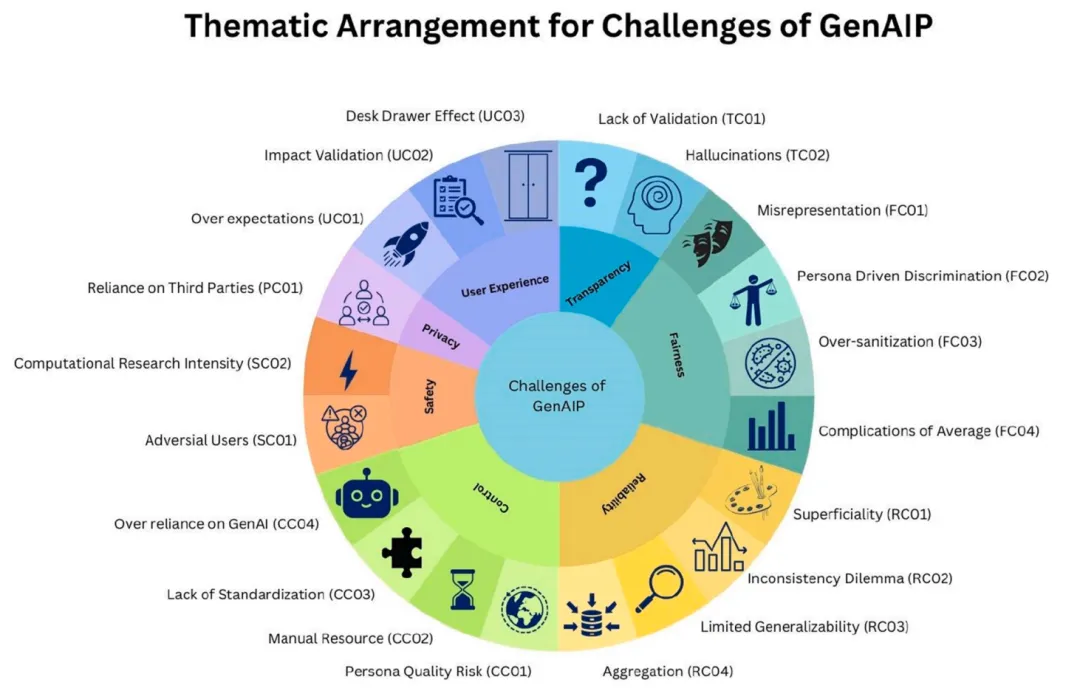

本研究系统梳理了使用生成式AI的20个关键挑战,并邀请17位国际专家进行评估。最终得到的结论非常明确:AI没有消除传统问题,而是把问题变得更隐蔽、更难察觉。

高效背后的陷阱

AI生成用户画像(GenAIPs)能快速生成人物设定、行为特征、场景故事,流畅、美观、一键产出,但其本质是概率生成,不是真实研究。

已有研究证实:

AI 会凭空编造用户特征、习惯、场景(幻觉)

AI会放大刻板印象,性别/职业/地域偏见更隐蔽

AI会过度美化,隐藏真实存在的用户痛点

生成过程不可验证,来源黑箱,无法追溯

呈现文字提醒用户“谨慎使用”的传统方法基本无效。因为人类一旦看到流畅完整的内容,就会自动降低警惕、产生认知偷懒。

用户画像:从人工到 AI

传统用户画像

人工研究、访谈、数据分析→虽然慢,但可以追溯、可以验证、有人把关

AI生成用户画像

LLM 一键生成→极快,但生成过程是黑箱,随机、不可控

AI没有解决传统问题,而是把风险升级、放大、变隐蔽。本实验中,AI生成存在的20个风险全部被专家评为“有问题”,且有12个风险比传统方法更严重。

研究介绍

·方法:文献综述+17位国际专家打分(7 分制)

·对比:AI生成画像 vs 传统数据驱动画像

·评估:20个风险点的严重程度

评分最高的三大风险

幻觉编造(5.94)

AI会编造不存在的用户特征、行为、场景,但语言流畅、逻辑自洽,极具欺骗性

过度美化(5.82)

AI 倾向于生成积极、正面、理想化的用户形象,隐藏真实存在的痛点、困境与负面行为,导致脱离现实

缺乏标准(5.59)

用不同的提示词、不同的模型,生成的结果天差地别,无规范、无验证、无可信度控制。

核心发现:三大危机

① 透明性危机(无法判断真假)

无法验证信息的来源

AI 幻觉达到高风险水平

内容再流畅,也可能全是编的

② 公平性危机(结果携带偏见)

系统性忽略少数群体(残障、老幼......)

固化性别、职业、地域之间的刻板印象

③ 控制性危机(诱导放弃思考)

使用者可能过度依赖AI,跳过真实的用户研究

新手也能使用AI生成,但质量完全不可控

设计师会失去对用户的真实理解

原理拆解:为什么AI画像更危险?

中性/机器式AI输出

→语气专业、流畅、确定→用户容易信任、降低认知投入→直接照搬→风险拉满

人类审核+AI辅助

→人保持判断、核查、修正→认知投入提升,警惕性在线→识别幻觉、纠正偏见、贴近真实

一句话总结:

AI越流畅、越确定、越像权威,人越容易放弃思考,越容易被带偏。

启示:3 条安全准则

01 破除迷信:好看≠真实,流畅≠正确

AI 生成的画像再专业,也只是语言的拼接,和真实用户、真实研究无关。

02 高风险场景必须人工核查

产品设计、用户研究、医疗、教育、公共服务......凡是会影响到真实人的决策,就绝对不能直接用 AI输出。

03 正确定位:AI是助手,不是替代者

·AI 负责:整理、归纳、扩写、初稿

·人类负责:验证、纠错、判断、决策

只有人的大脑保持在线,才能真正实现和AI的协同办公。

结语

AI 可以帮我们写文案、整理结构、加速产出,但不能替我们负责、替我们验证、替我们理解真实的用户。

高效的代价,往往是看不见的风险。在下一次使用 AI生成用户画像前,不妨先问问自己:这些信息真实吗?可验证吗?有人核查吗?

保持思考,保持判断,才是AI时代最稀缺、最重要的能力。

参考文献

Amin, D., Salminen, J., Jansen, B. J., Shin, J., & Kim, D. H. (2025). Generative AI personas considered harmful? Putting forth twenty challenges of algorithmic user representation in human-computer interaction. International Journal of Human–Computer Studies, 205, 103657.

ZJUpsy@黄海斌供稿

夜雨聆风

夜雨聆风