AI算力深潜 之二 CPU:算力的调度员

接着拆解AI算力服务器,上一篇我们拆解了GPU——算力的"发动机",它用海量并行计算啃下大模型最重的矩阵乘法。但GPU不会自己动,它需要一个"调度员"来分配任务、协调数据流、管理内存和网络。这个调度员就是CPU。

这是AI算力产业链拆解系列的第二篇,我们将聚焦CPU在AI基础设施中的核心作用,以及它的产业链格局。

一张图看懂产业链

CPU处在"芯片层",负责调度GPU、内存、网络,连接上游制造和下游应用。整条产业链自下而上,共4层。

CPU自己的产业链

一颗CPU芯片,从IP授权到系统集成,涉及设计、制造、封装、集成的完整链条

🎯 上游:IP授权与CPU设计

CPU设计公司使用IP授权或开源架构进行设计,依赖EDA工具和代工厂制造。

💡 CPU产业链的核心竞争是指令集生态:x86主导服务器/PC,ARM主导移动端并向服务器渗透,RISC-V是新兴开放生态。

🏆 中游:CPU芯片——x86与ARM主导,RISC-V嵌入式突围

🏗️ 下游:CPU装进服务器,协同GPU工作

CPU与GPU、内存、网卡协同,构成完整AI服务器。服务器厂商根据不同工作负载配置CPU型号和数量。

📌 随着AI工作负载从训练转向推理,CPU在边缘和云端的角色愈发重要。ARM架构凭借能效优势,在推理服务器市场份额快速提升。

CPU产业链:三地市场全标的

沿CPU上下游梳理A股、港股、美股核心公司。年内涨幅为2026年至今涨跌幅。

🇺🇸 美股:CPU芯片巨头与代工

🇭🇰 港股:CPU制造、设计与生态

🇨🇳 A股:CPU产业链全谱

包括CPU设计、鲲鹏生态、EDA工具、封装测试等全环节,按市值排序。

接下来的变化

① CPU在AI服务器中的角色重塑

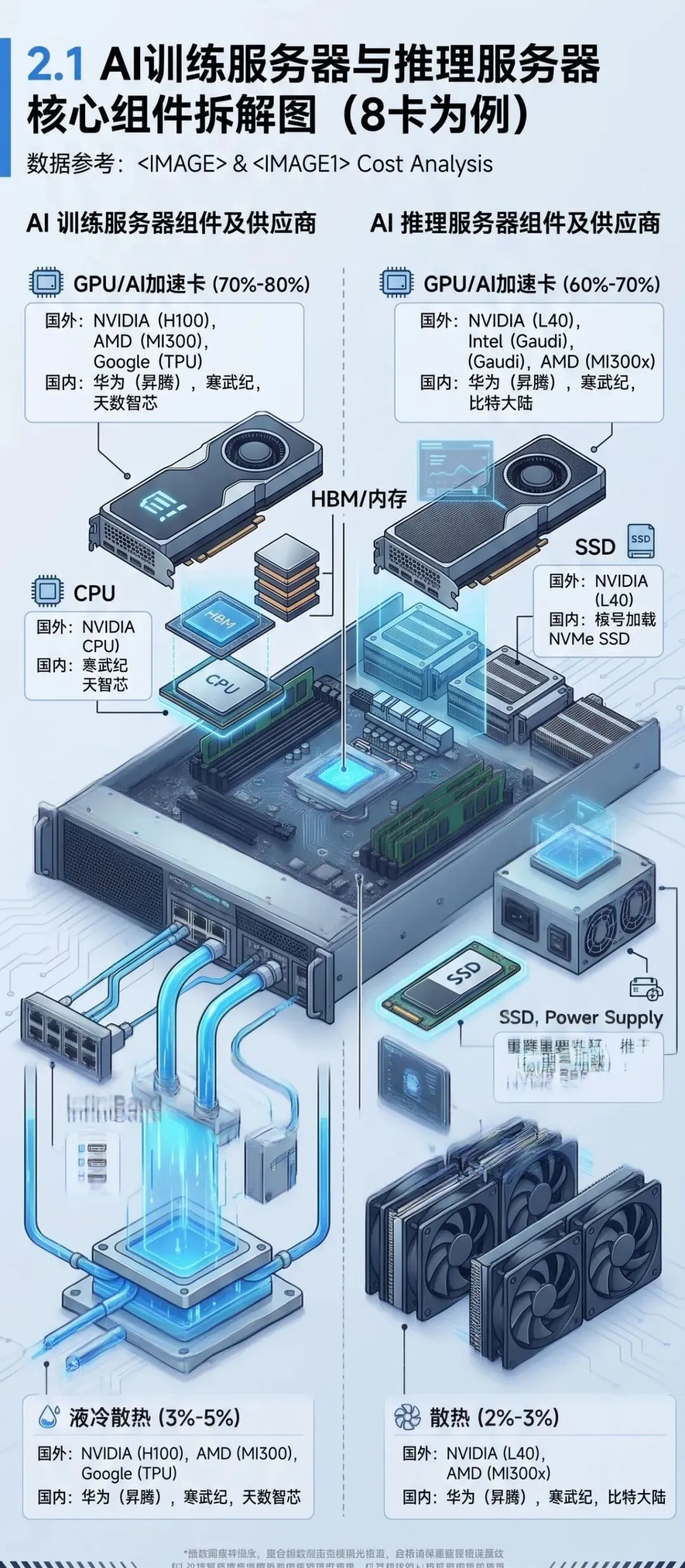

传统服务器CPU承担主要计算,AI服务器中CPU退居"调度员"。但调度复杂度激增:8卡GPU需要CPU高效协调数据流、管理HBM内存、处理网络通信。英特尔、AMD都在CPU中集成AI加速单元(如AMX)来分担部分推理负载。

② ARM架构从移动端杀回服务器

亚马逊Graviton4、AmpereOne在云服务器市场份额已超20%。ARM架构的能效优势在AI推理场景凸显。2026-2027年,ARM服务器CPU份额有望达到30%。Windows on ARM的生态突破将进一步侵蚀x86的PC市场。

③ 国产CPU进入"可用→好用"拐点

2026年国产CPU整体市占率有望从8%提升至15%。

总结:CPU产业链的钱流向了谁?

英特尔、AMD拿走x86 CPU环节 ~85% 利润

ARM拿走IP授权环节 ~10-15% royalties

TSMC、三星拿走制造环节 ~12-15%毛利

国产CPU利润仍薄,但增速远超行业平均

下一篇,我们将深入内存——算力的"高速公路",看看涨了几倍的HBM如何成为GPU性能的瓶颈,以及存储产业链的格局。

⚠️ 免责声明:基于公开数据整理,年内涨幅截至2026年5月8日。仅供参考,不构成投资建议。

来源:英特尔/AMD财报、ARM招股书、TrendForce、券商研报、neodata行情数据

2026-05-09 21:53

--------------------社群预告-------------------

「一百个事的AI实验」

我们只教你怎么用AI,把生活玩出花儿来,把工作效率提高起来,

如果你:

✅ 热爱探索AI玩法,或者想知道这些实验怎么做的

✅ 愿意分享你的AI想法

✅ 单纯想找一群“AI玩伴”

欢迎评论区留言加入我们正在筹备的「AI玩家俱乐部」微信群!

夜雨聆风

夜雨聆风