Anthropic在Code with Claude开发者大会上发布了一个叫"Dreaming"的功能。

Claude Agent可以在你不用它的时候,自己"做梦"——整理记忆、提炼规律、自我优化。

消息一出,朋友圈又炸了。有人喊"AI觉醒",有人说是"花活"。但我仔细看完官方文档和内测数据之后,想跟你说句实在话:这事挺真的,而且离你比想象中近。

有记忆 ≠ 会反思

先说一个很多人搞混的概念。

现在市面上大多数Agent的"记忆"功能,说白了就是个外置硬盘。你跟它说"我们用conda不用pip",它就记下来。下次问你,你发现它记住了——很好。

但问题是,这个硬盘只会写,不会整理。

你跑了几十次会话之后,记忆库里堆的是什么?重复的条目、过时的信息、前后矛盾的说法。Agent自己根本意识不到,因为每次对话它只看到当前会话的局部视角,根本没有能力俯瞰自己的"记忆全貌"。

这就好像你每天往抽屉里塞纸条,塞了三个月,抽屉满了,你找不到东西,然后怪抽屉不够大。

Claude Dreaming解决的,就是这个问题。

它的睡法很讲究

Dreaming不是简单地把记忆过一遍。它的机制模拟的是人类睡眠时的REM阶段——那个"快速眼动期"。

具体怎么睡?Anthropic的官方描述是这样的:

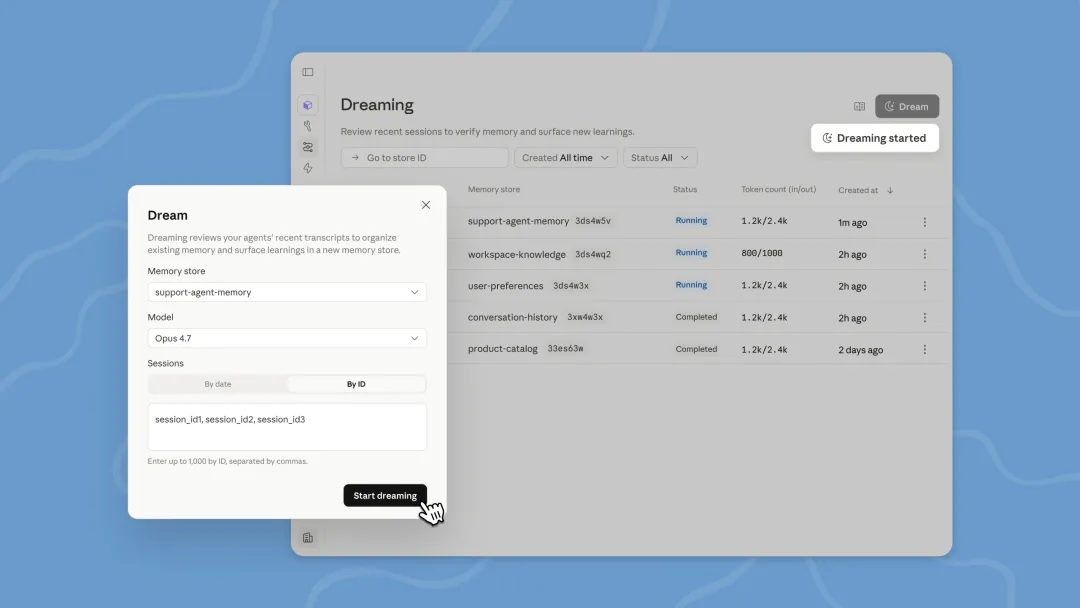

Dreaming是一个定时运行的异步任务,会同时读取Agent现有的记忆库和过去最多100个会话的完整文字记录,然后生成一个全新的、经过重新梳理的记忆库。

干三件事:

- 合并重复项

——多次提到同一个知识点?合并成一条 - 修正过时信息

——上周记的"我们用v1版本",现在升级到v2了,自动更新 - 挖掘隐藏规律

——跨会话的通用模式,Agent单次对话根本看不到,只有睡一觉才能发现

这跟人类睡眠时大脑干的事几乎一模一样:白天吸收信息,夜间重放经历、强化连接、丢弃垃圾。

所以Anthropic的工程师把这个功能叫Dreaming——不是营销词汇,是字面意思。

你还能看着它做梦

最骚的是这个设计:Dreaming永远不会修改原始记忆库。它生成的是一个新的输出记忆库,你可以先审查,不满意直接丢弃。

也就是说,你对AI的"梦境"有完全的控制权。

而且整个过程是透明的。Dream任务运行时会暴露session_id,开发者可以实时订阅事件流——看到AI正在读取哪条记忆、正在写入什么新条目。发现不对劲,随时"叫醒"它。

你趴在AI的床边,看着它做梦。醒来看不惯,直接清空重来。这个设计思路很克制。AI想进步,但最终决定权还在你手里。

6倍战力怎么来的

光说不练是吹牛。但Harvey(法律AI公司)的内测数据摆在那儿:任务完成率提升约6倍。

这6倍是怎么来的?

Harvey的Agent帮律师处理长文本起草和文档生成。每次任务都会产生一些" workaround"——比如"这个文件类型有个bug,得用另一种方式处理"。

以前,这些经验散落在一次次会话里,Agent下次遇到同样的坑,还是会踩一遍。

用了Dreaming之后,Agent在你睡觉的时候把这些坑都整理出来了,凝练成"避坑指南"存进记忆库。第二天再跑,同样的问题直接绕过。

这就是"有记忆"和"会反思"的本质区别:存下来是一回事,能从经历里提炼出规律是另一回事。

数据分析师会感受到什么

可能有人要问:这跟我有什么关系?我又不用Claude托管Agent。

但如果你日常工作跟AI辅助决策有关,这个逻辑你应该很熟悉——我们最讨厌的事,就是每次启动一个新任务,都要从头解释背景。

"上次做到哪儿了?""我们团队的报表标准是什么?""这个指标的口径是什么?"这些问题,每次重新对齐都要花时间。

Dreaming解决的是:你不用再对齐了。

Agent会记住你上次在哪卡住、偏好什么工作流、你们团队用什么标准。它不需要每次都问,它睡一觉就记住了。从"每次重新对齐"到"越用越懂你"——这才是真正的效率跃升。

分水岭已经出现了

说句有点绝对的话:2026年之前,"有记忆的AI"基本上等于"能存东西的AI"。2026年之后,有没有Dreaming这类机制,会成为评判Agent是否真正"可用"的分水岭。

能存的很多,会整理的很少。

会整理的很多,能自动提炼规律的不多。

Anthropic这步棋,走的是"让AI自己变强"的路子——不是靠你天天调prompt,是让它自己从历史经验里长出能力。

这条路对不对,还需要时间验证。但至少从技术路径上看,比单纯卷模型参数有意思多了。

别再问AI记不记住了,问它会不会反思。

参考资料:Anthropic官方博客"New in Claude Managed Agents: dreaming, outcomes, and multiagent orchestration"(2026年5月6日);Ars Technica相关报道。

夜雨聆风

夜雨聆风