安全界担心了好几年的事,终于发生了。黑客用AI大模型,独立发现了一个此前未知的零日漏洞,还写好了攻击脚本,差点发动大规模攻击。这不是演习,这是谷歌威胁情报组刚刚发布的真实报告。

发生了什么?

5月12日,谷歌威胁情报组(GTIG)发布了一份报告。

报告内容很简单,但每一句话都让人后背发凉:

- 犯罪黑客使用AI大模型,独立发现了一个零日漏洞

这个漏洞存在于一个"广泛使用的开源Web系统管理工具"中 黑客写了一个Python脚本,可以绕过双因素认证(2FA) 攻击差点大规模发动,被谷歌在最后一刻拦截

零日漏洞是什么?就是软件厂商自己都不知道的漏洞。黑客找到它的时候,开发者连修复的机会都没有。

而这次,找到它的不是人类安全专家——是AI。

谷歌是怎么发现的?

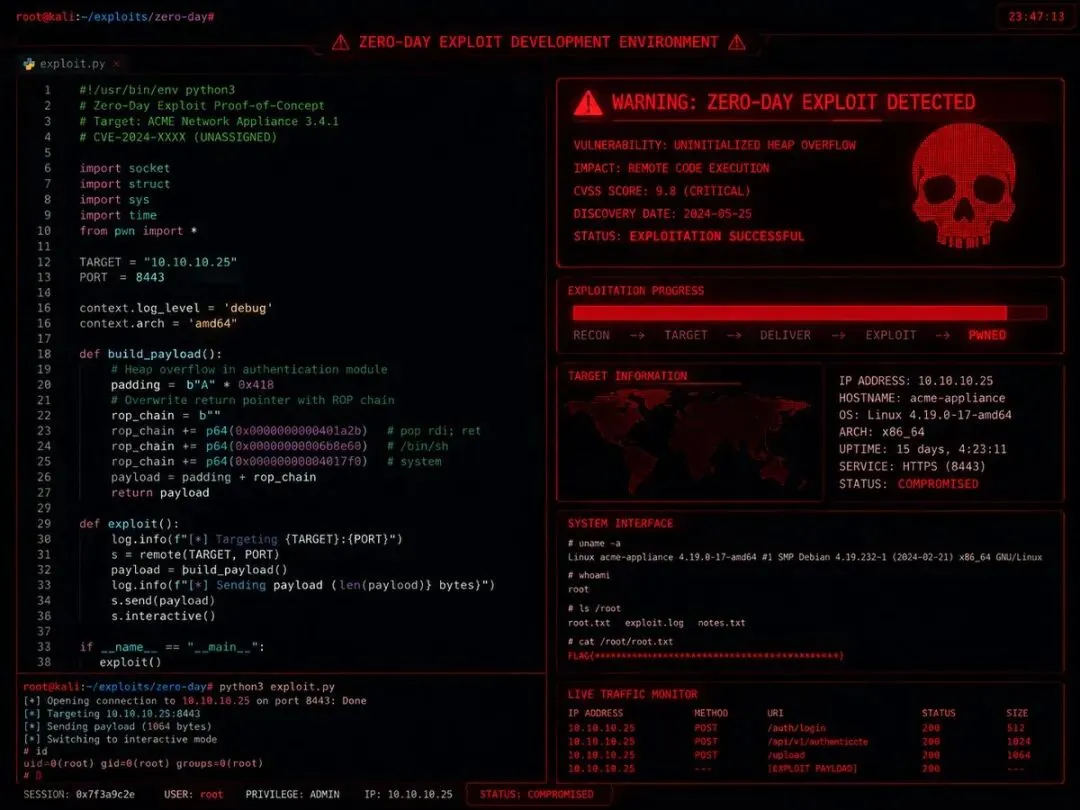

谷歌威胁情报组在监控网络犯罪活动时,截获了一段Python脚本。

这个脚本的目标是绕过一款热门开源管理工具的双因素认证。一旦攻击者拿到了用户名和密码,再加上这个脚本,就能直接进入管理后台。

但让谷歌团队真正警觉的,不是漏洞本身,而是这段代码的"气质"。

脚本中包含大量教学性质的注释文档(docstring)——人类黑客写攻击工具完全没有理由加这些 代码里出现了一个"幻觉CVSS评分"——AI自己编了一个漏洞严重性评分,现实中根本不存在 整体代码格式非常"教科书式",用了标准Python风格,包括详细的帮助菜单和整洁的ANSI颜色类

谷歌团队说,他们"高度确信"这段代码是AI生成的。

因为这些特征,就是大语言模型训练数据中的典型输出风格。

为什么这件事这么重要?

你可能觉得,黑客用AI写代码有什么稀奇的?

区别在于:以前是黑客用AI辅助写攻击工具,现在是AI独立发现了零日漏洞。

安全界担心了好几年的"AI自动挖洞",终于从理论变成了现实。

更让人不安的是——Anthropic的Mythos模型此前已经找到了数千个零日漏洞。那可是用来做防御研究的。如果同样的能力被恶意使用呢?

这就像核技术一样:可以用来发电,也可以用来造炸弹。问题只在于谁掌握了它。

OpenAI紧急推出Daybreak防御

几乎同一时间,OpenAI做了一个非常及时的回应。

他们推出了AI网络安全工具Daybreak——整合了最强模型、Codex代码分析能力以及安全合作伙伴的资源,用于自动化漏洞发现与修复。

逻辑很清晰:既然AI能挖漏洞,那就用AI来补漏洞。

同时,OpenAI还宣布成立OpenAI Deployment Company,获得超过40亿美元初始投资,收购英国AI咨询公司Tomoro,要把150名前沿部署工程师嵌入企业客户。

从"卖模型"到"帮企业部署AI再到"帮企业防御AI攻击"——OpenAI的商业版图,正在极速膨胀。

我的看法

说实话,这件事给我一种很复杂的感觉。一方面,AI发现漏洞的能力越来越强,意味着未来的软件安全会大幅提升——因为AI可以比人类更快地找到并修复漏洞。但另一方面,当这种能力落入犯罪分子手中,后果不堪设想。以前挖一个零日漏洞需要顶尖安全研究员花几个月的时间。现在?AI可能几分钟就搞定了。攻防的天平正在被AI重新定义。谁能更快一步,谁就能在这个新世界里活下来。而谷歌这份报告告诉我们:这场比赛,已经开始了。

作者:cDesign-天渊 | 发布日期:2026年5月13日

夜雨聆风

夜雨聆风