国家网信办等三部门联合发布《智能体规范应用与创新发展实施意见》,中国AI治理正式进入"智能体时代"

新规提出四大支柱框架:产品准则+安全防线+治理体系+行业自律,核心是"三可追问"——做了什么、为什么这么做、出问题谁负责

对标全球:欧盟"风险分级"、美国"联邦缺位",中国选了最可操作的"行为追问"路线

对Agent创业公司:合规成本上升但赛道更清晰,"野蛮生长"结束,"有法可依"开始

为什么偏偏是现在?AI从"嘴巴"长出了"手脚"

图:智能体正加速融入物理世界,从"对话助手"变为"行动代理"

过去两年我们谈论的AI,本质上还是个"嘴炮"——你问它答,它不会主动干任何事。但2025年以来风向变了:AI开始"长手长脚"了——帮你订机票、写代码、操作软件、甚至替你发邮件。这就是智能体(AI Agent):具备自主感知、记忆、决策、交互与执行能力的智能系统。

"让它干活"和"它自己决定怎么干",就像你请了一个厨师和一个外卖骑手——厨师只管做菜,骑手要自己上路、自己选路线。前者出了事最多菜不好吃;后者出了事可能撞人。智能体就是那个"骑手",它带来的是从"内容风险"到"行为风险"的根本性跃迁——AI的风险不再是"说了什么",而是"做了什么"。

正是在这个背景下,5月8日,国家网信办等三部门联合发布《智能体规范应用与创新发展实施意见》。这标志着中国AI治理从"管模型"升级到"管行为"。而就在同月,中国AI四小龙估值破万亿、DeepSeek融资500亿、月之暗面136亿D轮——产业狂飙和监管出手几乎同步。当AI的能力强到足以自主行动,规则就必须跟上。

拆解四大支柱:每一根撑的是什么?

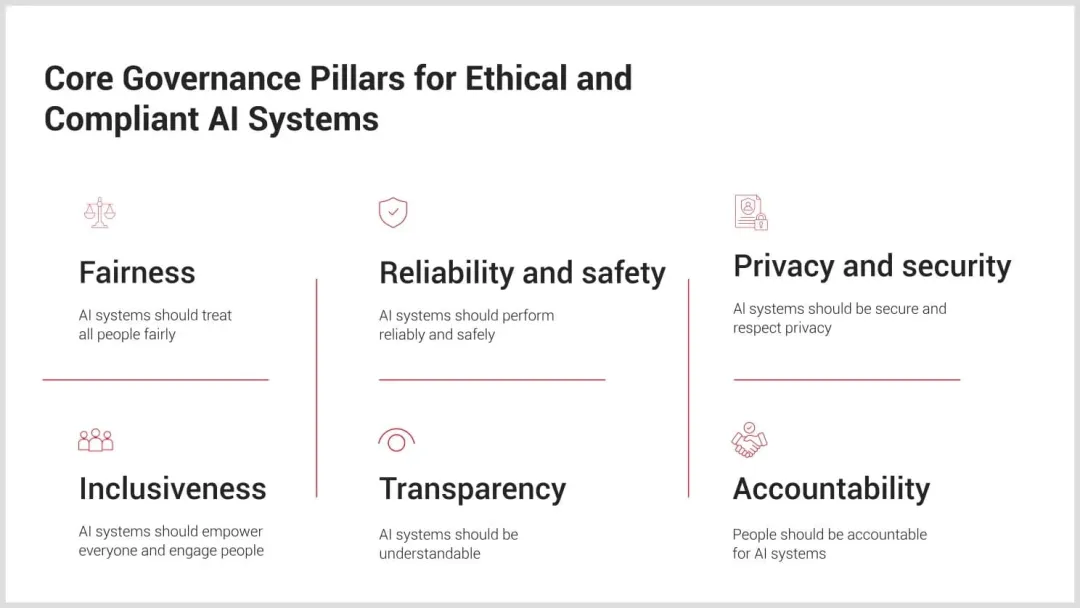

图:AI治理的核心支柱框架——公平、安全、隐私、包容、透明、问责

《实施意见》构建了一个"四梁八柱"式的监管框架,四根大梁分别是:明确产品准则、防范安全风险、完善治理体系、强化行业自律。听上去很像官话,但拆开看,每一根都精准切中了智能体最让人头疼的问题。

第一根梁:产品准则——"谁说了算"。新规要求厘清"仅限用户本人决策"、"需用户授权决策"和"智能体自主决策"三种方式的边界。比如转账必须你自己拍板,选餐厅AI可以代劳但你得点头,整理邮件标签AI可以自己做主。核心原则:用户享有知情权和最终决策权,AI不得超出授权范围。就像给AI装了"权限围栏"——你让它收快递,它不能顺便签贷款合同。

第二根梁:安全防线——"出事怎么办"。新规提出"行为管控+内生安全"双重防御。行为管控要求发展"规则内嵌、行为围栏"技术,还探索用区块链建立行为可验证、可追溯机制。内生安全覆盖数据投毒、隐私泄露、算法篡改、运行失控等全链路风险,供应链安全也被纳入——从模型接入到API调用,每个环节都得有安全规范。

第三根梁:治理体系——"怎么管"。新规提出分类分级治理框架,不搞一刀切。敏感领域(金融、医疗、司法)实行备案、检测、产品召回等硬约束;低风险领域(生活娱乐、日常办公)通过合规自测、行业自律等柔性手段。就像交通管理:高速公路设收费站和测速摄像头,乡间小路靠自觉和村规民约。

第四根梁:行业自律——"谁来兜底"。新规鼓励行业组织和企业联合制定自律规则,探索智能体信用评价机制——做得好的得到认证和市场认可,做得差的被淘汰。本质上是把"谁来兜底"从"政府包办"转向"行业共治"。

把四根梁串起来,核心逻辑就一句话:"三可追问"——做了什么(可追溯)、为什么这么做(可解释)、出问题谁负责(可问责)。这不是给AI上枷锁,而是上保险——有了这套框架,智能体才能从"实验品"变成"商品"。

全球对比:三种治理哲学,中国选了最"能落地"的路

图:全球AI政策版图——不同国家正在形成各自的治理路径

把镜头拉远一点,全球AI治理目前形成了三条截然不同的路径。

欧盟:风险分级,先立法后执行。欧盟《人工智能法案》把AI分为"不可接受"、"高风险"、"有限风险"和"最小风险"四档,违规最高罚全球年营收7%。规则严密但合规成本高,部分高风险条款实施被推迟到2027年底。更关键的是,这套体系针对"静态AI系统"设计,对智能体这种"动态执行"的新形态,风险分级的颗粒度够不够用,还是个问号。

美国:联邦缺位,各州各自为战。截至目前美国仍无联邦统一AI立法。2026年3月白宫发布的《国家AI政策框架》只是非约束性建议,核心是"联邦优先、轻触监管"。但2025年约38个州通过了约100项AI法规,加州、德州、科罗拉多各有各的标准,形成碎片化的"合规拼图"——合规成本不是低了,而是更不确定了。

中国:行为追问,先划底线再发展。中国的智能体新规既不像欧盟追求"大而全"的刚性立法,也不像美国"放任自流+事后追责",而是抓住"行为"这个关键变量。不管你是什么类型的智能体,只要"动手"了,就得回答三个问题:做了什么、为什么、谁负责。这种思路可操作性强、适应性高——不管技术怎么迭代,"三可追问"的框架都能适用。

简单类比:欧盟像严格的考官,进门先分ABCD等级;美国像缺席的班主任,口头说"大家自觉",实际上各科代表各管各的;中国像务实的工程师,不管你等级高低,只要设备在运行就得装监控、贴标签、留记录。三种哲学没有绝对优劣,但就"智能体治理"这个场景而言,中国的"行为追问"确实最能落地——因为智能体最大的风险不在于它属于哪个等级,而在于它"做了什么"。

Agent创业公司的命运分水岭:利好还是利空?

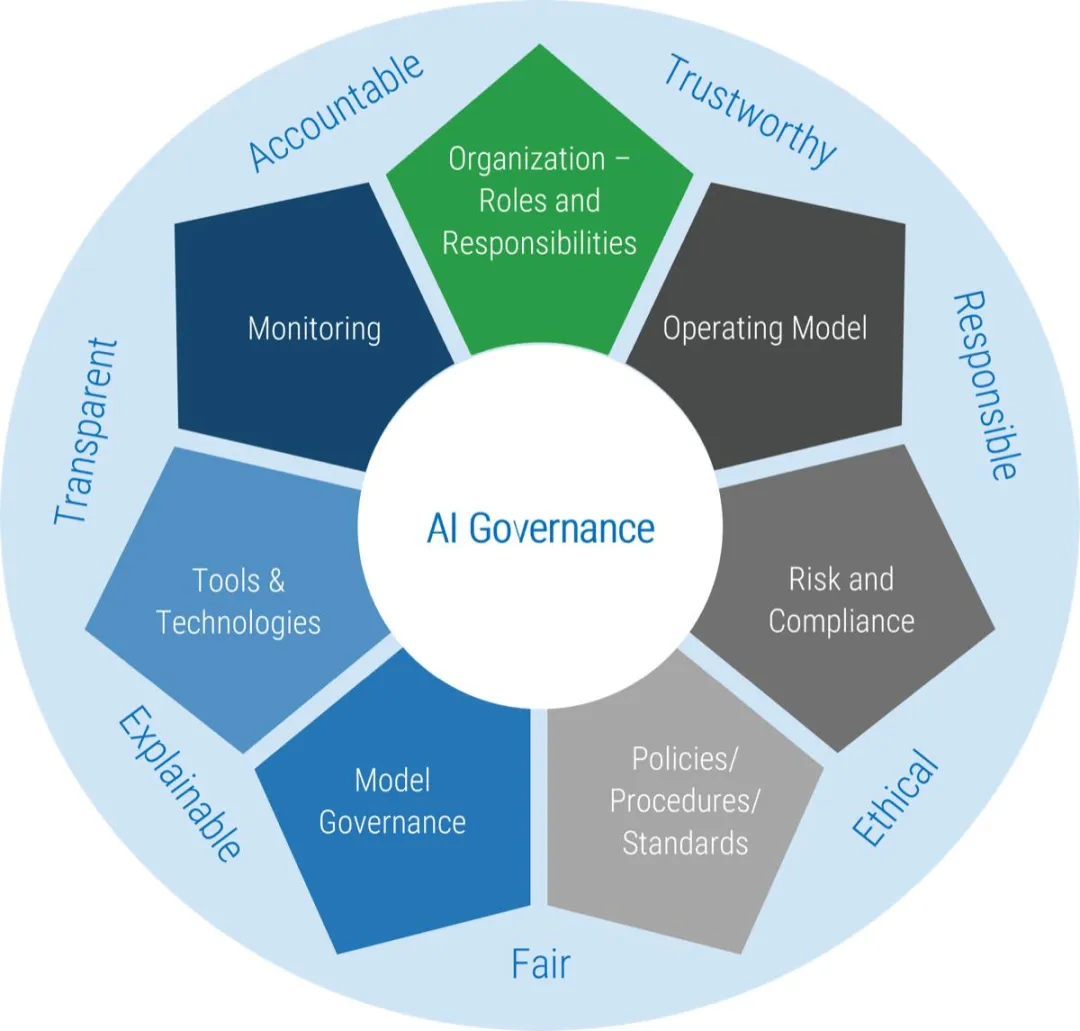

图:AI治理框架的多维架构——组织、运营、风险、政策、技术、监控

新规发布后,Agent赛道创业者最关心的就一个:合规成本涨多少?

短期来看,成本确实会上升。行为可追溯要部署日志系统,权限管理要设计精细的授权框架,安全评估要引入第三方检测。对资源有限的小团队来说,这些"合规税"不是小数目。尤其是"套壳"类公司——只调用大厂API再套个UI,新规要求的可追溯、可解释能力,它们根本接触不到底层参数,合规天然就是短板。

但长期看,新规反而是最大的利好。因为在新规之前,Agent创业最大的障碍不是技术,而是不确定性——客户不敢用,不知出了事谁担责;资本不敢投,不知哪天政策一刀切。新规最大的价值,是给了行业最缺的东西——确定性。红线划清楚了,市场反而能放开手脚。就像交通规则出台后,不是车少了,而是车跑得更快更稳了。

更重要的是,分类分级思路为不同规模玩家留出差异化空间:高风险领域门槛高,大厂主导;低风险领域门槛低,中小团队可敏捷创新。而合规工具本身——行为监测、安全评估、追溯系统——正在成为全新市场机会。谁能做出最好用的"合规SaaS",谁就可能成为Agent赛道的"卖水人"。

DeepSeek融资500亿、月之暗面136亿D轮——这些天文数字的融资发生在新规发布的同一时期,说明资本市场已用真金白银投票:有法可依的赛道,远比野蛮生长的蛮荒更有投资价值。

结语:治理不是刹车,是方向盘

图:AI治理——信任与变革时代的数字守护

回到根本问题:AI治理到底是在"限速"还是"导航"?答案是后者。一辆没有方向盘的跑车,不是跑得更快,而是根本不敢上赛道。中国的"三可追问",本质上就是给智能体装了三个仪表盘:行为记录仪(做了什么)、决策解释器(为什么这么做)、责任追踪器(出问题谁负责)。有了这三样东西,智能体才能从"黑箱"变成"可信组件"。

新规的深层意义,不只是"管住了AI"——它给行业注入了极其稀缺的资源:确定性。在AI创业的丛林里,最让人恐惧的不是竞争,而是不知道边界在哪。当边界清晰了,企业才能放心投入,资本才能放心下注,用户才能放心使用。《实施意见》不是一份监管文件,而是一份"智能体商用许可证"的申请指南——满足这些条件,你就可以合法合规地大干一场。

清华大学薛澜教授在解读新规时说:"唯有在创新与规范之间找到动态平衡,我们才能真正驾驭智能体这一强大工具。"AI治理从来不是"做完就完了"的任务,而是需要不断校准的动态过程。新规是起点,不是终点。但有了这个起点,中国AI的"智能体时代"才算真正有了轨道。

三部门联合发布智能体新规:《智能体规范应用与创新发展实施意见》正式出台,AI治理进入"行为追问"时代

中国AI四小龙估值破万亿:DeepSeek、月之暗面、智谱AI、百川智能估值集体飙升,产业进入"万亿俱乐部"

DeepSeek融资500亿:开源大模型龙头完成新一轮融资,估值继续领跑国产AI

月之暗面136亿D轮:Kimi母公司刷新国产AI单轮融资纪录,资本加速押注Agent赛道

"AI治理不是刹车,是方向盘。没有方向盘的跑车不是跑得更快,而是根本不敢上赛道。"

—— 科技前线观察

💬 深度思考

中国用"三可追问"治理智能体,你觉得这比欧盟的"风险分级"更实用吗?如果你是Agent创业者,新规对你来说是"紧箍咒"还是"护身符"?

欢迎在评论区分享你的观点

中国网信网 - 《智能体规范应用与创新发展实施意见》全文

中国网信网 - 专家解读:统筹高质量发展与高水平安全

中国网信网 - 专家解读:以规范应用护航智能体发展行稳致远

unanswered.io - How Is the US Government Regulating AI in 2026

🌟 关注我,获取每日深度科技分析

夜雨聆风

夜雨聆风