陈巍:“龙虾”们颠覆软件世界?(上)——OpenClaw(原Clawdbot)超深度分析

OpenClaw (曾用名ClawdBot/MoltBot)是一个开源、自托管、支持多种聊天应用的 AI 智能体(Agent,也有翻译为“代理”)系统,旨在通过自然语言接口实现复杂任务的自主任务执行,而非局限于简单的对话交互。2026 年初发布的ClawdBot,其国外GitHub 星标迅速突破 180,000,并吸引数百万访问者。同时大量的国内云服务商开始提供OpenClaw云服务,大量AI芯片开始适配OpenClaw。在国内多个自媒体平台上,OpenClaw赚钱和出售Macmini的搞笑段子也迅速流行起来。

主编作者:陈巍博士,大模型+AI芯片专家,高级职称。国际计算机学会(ACM)、中国计算机学会(CCF)专业会员,多个国际人工智能期刊审稿人。主要研究方向为大模型架构、稀疏压缩与部署加速,存算一体、AI芯片与3D Chiplet处理器。

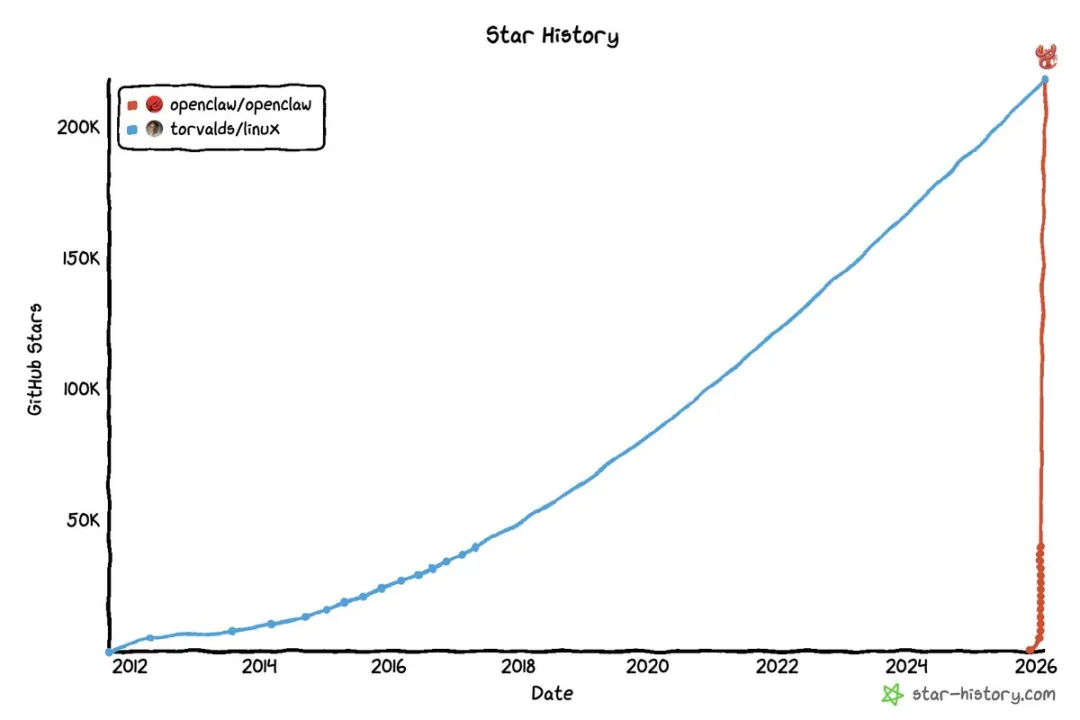

OpenClaw在短时间达到Linux活跃度

相对于ChatGPT的“只动口不动手”,OpenClaw就像一个聊天框背后的开源自动化机器人,按照对话要求进行各种自主的工作。OpenClaw的核心功能在于将用户意图或指令转化为可操作的步骤,例如管理日历行程、发送邮件或航班值机等实际生活或工作操作。该系统支持多种聊天应用集成,如 WhatsApp 和 Telegram,使用户能够在日常通信环境中无缝使用 AI 智能体,无需切换到专用界面。

在作者看来,OpenClaw们,必将颠覆现有的软件世界。

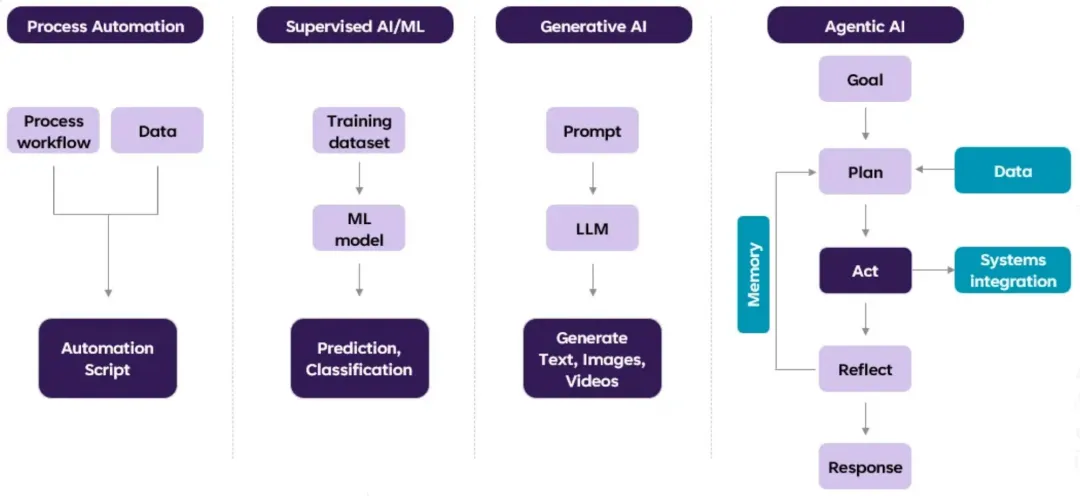

Agentic AI的变革

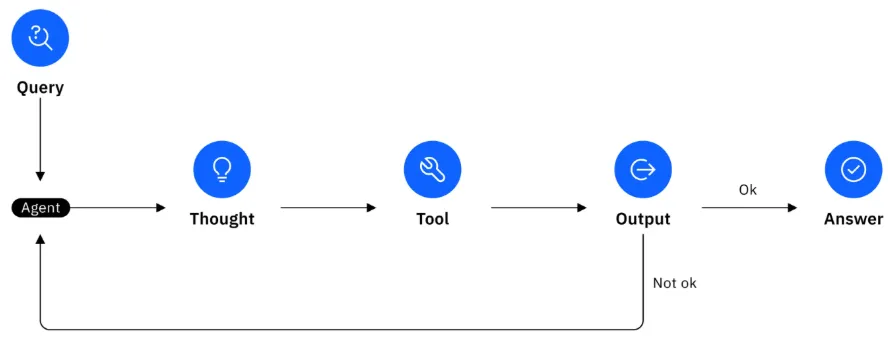

在AI 助手领域,OpenClaw 填补了传统聊天机器人(如 ChatGPT 或 Claude)和全自动智能体系统(如 Auto-GPT)之间的空白。国内的网友往往称之为“龙虾”。OpenClaw强调“动作导向”(action-oriented)的设计,允许智能体与外部环境自主交互,例如浏览器操作、API 调用和设备控制。这使得它不仅仅是信息查询工具,而是真正意义上的“数字助手”,能够处理多步任务链并从反馈中迭代优化。根据项目创始人 Peter Steinberger 的描述,该系统灵感来源于 Lobster 框架(一个受 Claude AI 启发的智能体循环框架)的智能体循环(agentic loop),旨在探索人类-AI 协作的边界,推动 AI 从被动响应向主动执行的演变。在开源 AI 生态中,OpenClaw 的自托管特性突出了隐私和自定义的优势,用户可以本地运行智能体,避免依赖云服务提供商,隔离用户的私有信息,从而减少核心数据泄露风险。作为一个快速崛起的开源项目,OpenClaw 展示了如何通过最小化依赖和最大化可扩展性来构建高效的智能体系统,为自主智能体发展形成了基本框架。

通过考察其核心组件(如任务分解机制和多模型集成),本报告将揭示其在提升任务自动化效率方面的创新,同时评估其局限性,例如模型幻觉(hallucinations)和权限管理风险。对OpenClaw的分析将聚焦于深层技术和生态启示,例如探讨智能体循环如何通过事件驱动架构实现异步任务处理,以及如何平衡计算资源与响应速度,还包括社区驱动的插件系统如何加速创新,以及类似项目在面对监管和竞争时的韧性。

2 背景与发展历史

2.1 项目起源

OpenClaw项目的起源可以追溯到2026年1月左右。在中国工程师们还在期待晚到的春节时,软件工程师Peter Steinberger发布了其初始版本(当时还叫ClawdBot)。Steinberger是PSPDFKit的创始人,该公司专注于PDF处理,并于2022年被Insight Partner收购,交易额约为1.19亿美元。这次成功的退出为Steinberger提供了资源和时间,让他能够探索AI领域的个人兴趣,为OpenClaw的早期快速迭代奠定了基础。

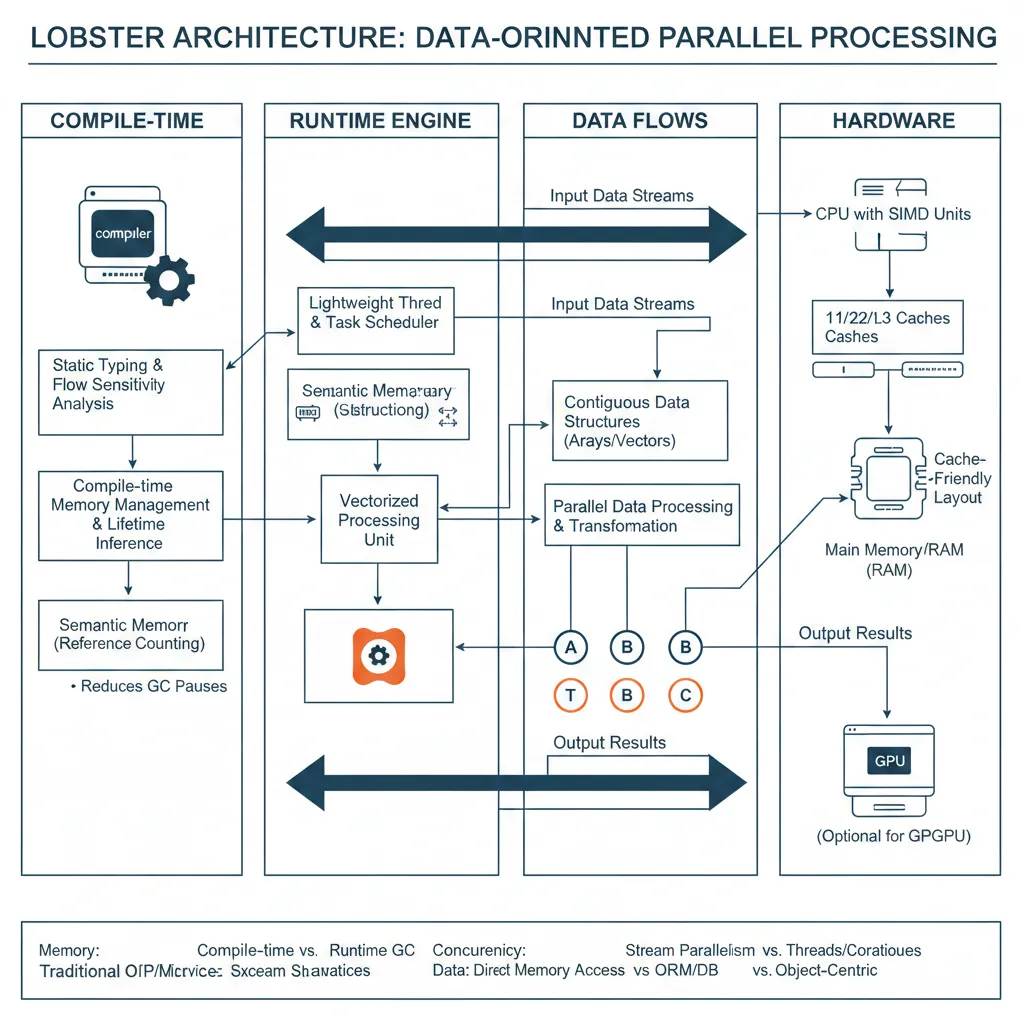

项目来源于Lobster工作流壳(Lobster workflow shell),这是一个受Anthropic的Claude AI模型启发的智能体循环框架。Lobster框架强调任务分解、执行和反馈的循环机制,旨在将AI从单纯的对话工具转化为能够自主行动的智能体。ClawdBot最初是一个“周末项目”,目的是创建一个自托管的AI助手,能够通过消息接口(如WhatsApp)执行实际任务,例如管理邮件或调度日历。这种设计灵感反映了Steinberger对“个人AI”的愿景:一个像Siri但更强大、更隐私友好的助手,能够在本地运行而非依赖云服务。早期版本迅速吸引了关注,并展示出AI智能体在日常自动化中的潜力,标志着从实验性工具向实用应用的转变。

lobster项目

2.2 重命名历程

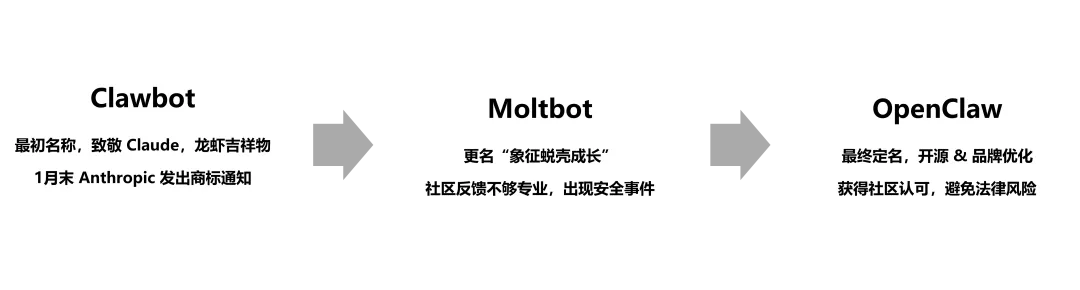

OpenClaw 的重命名历程,集中反映了开源项目在快速传播之后所面临的法律与品牌层面挑战。

项目最初名为Clawdbot,这是一个对Anthropic的Claude模型的“谐音梗”——“Clawd”类似于“Claude”,并配以龙虾吉祥物。随着项目关注度迅速上升,这种命名方式很快引发了合规问题。2026 年 1 月底,Anthropic发出商标侵权通知,认为Clawdbot的名称可能导致用户混淆其Claude品牌。Steinberger在X平台上公开表示,这次更名并非他的主动决定,而是被迫响应。在社区的快速脑暴中,项目于1月27日重命名为Moltbot,“Molt”指龙虾蜕壳的过程,象征项目的成长和适应。

Moltbot名称虽巧妙,但很快引发社区的负面反馈:一些用户认为Moltbot听起来不够专业或易记,导致进一步的品牌优化讨论。

最终,在1月30日,项目再次重命名为OpenClaw,强调“Open”代表开源性质,“Claw”保留了原龙虾主题的精髓。这一变化获得了社区认可,因为它提升了品牌的清晰度和专业性,同时避免了进一步的法律风险。整个历程展示了开源项目如何通过社区反馈和快速迭代来优化品牌的过程。

OpenClaw的重命名历程

2.3 社区与流行度

OpenClaw 的流行度主要得益于病毒式传播效应。项目发布后的短短几天内,其 GitHub 星标数从数千迅速增长至 18 万以上,使其成为开源 AI 项目中增长速度最快的案例之一。

传播的关键推动力来自早期采用者的自发分享,诸如 #Clawdbot 和 #OpenClaw 等话题迅速积累了数百万次互动,甚至用户通过演示视频展示 AI 智能体自主完成任务的过程。在这一背景下,相关话题和段子也在简中社区和APP小作文中被大量翻译和传播。

开源社区的持续参与显著影响了项目发展,截至目前,有300-400位贡献者参与,包括代码优化、SKILL插件添加和文档改进。GitHub Issues和Discord频道成为活跃的讨论场所,用户在其中提出功能请求,如多模态支持,推动项目快速迭代。社区还催生了衍生项目,如Moltbook(一个AI智能体专属社交网络),展示了OpenClaw如何激发更广泛的生态创新。这种集体智慧不仅加速了bug修复,还增强了项目的韧性,使其从个人项目演变为社区驱动的平台。

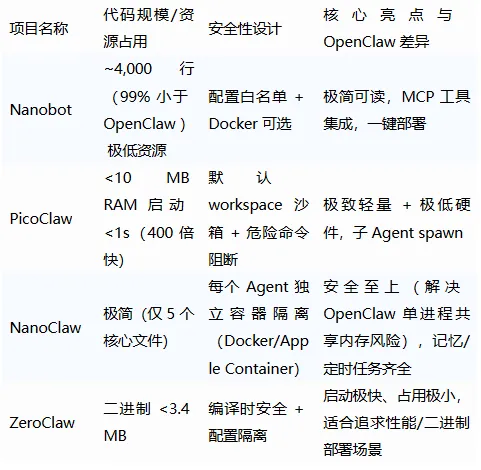

除了OpenClaw外,在其后也诞生了一些框架类似的开源项目,特点是轻量级、本地优先、支持消息平台集成。这些项目主要针对OpenClaw的冗余进行简化,提供缩减版的OpenClaw,并提升安全性。

OpenClaw衍生框架对比

在 AI 智能体生态中,OpenClaw 与 Auto-GPT、BabyAGI 等代表性项目既存在共性,也呈现出明确差异。这些系统均基于大模型(LLM)构建自主智能体能力,但在设计目标和使用场景上各有侧重。

Auto-GPT 强调递归式任务执行与本地环境交互,支持多模态处理和丰富的工具集成,更适用于通用自动化与复杂流程探索;BabyAGI 则聚焦于任务队列管理与反馈循环机制,通过模拟人类认知过程来组织任务,更偏向实验性研究和学习场景;Manus 提供可组合的智能体定义和任务流管理接口,方便快速搭建完成任务,但完全闭源。相比之下,OpenClaw 的生态定位更加明确,其核心卖点在于自托管与实际任务导向。项目优先支持本地运行,并针对 Macmini 等硬件环境进行优化,尽量避免对云服务的依赖,从而在隐私保护和用户控制权方面具备优势。

与Auto-GPT偏向广义工具集成不同,OpenClaw更注重聊天应用桥接(如Telegram、Slack),实现无缝人类-AI协作;相对于BabyAGI的简单任务优先级机制,OpenClaw引入持久记忆和多智能体协作,提升复杂任务处理能力。

OpenClaw 的优势在于其 开箱即用的行动导向能力,使其不仅能作为实验或开发平台,更可以直接部署为生产级“数字员工”。OpenClaw 在自动化执行、隐私保护、本地优先、生产应用定位等方面进行了大量优化,从而形成了差异化优势。

OpenClaw与其他Agent对比

3 系统架构

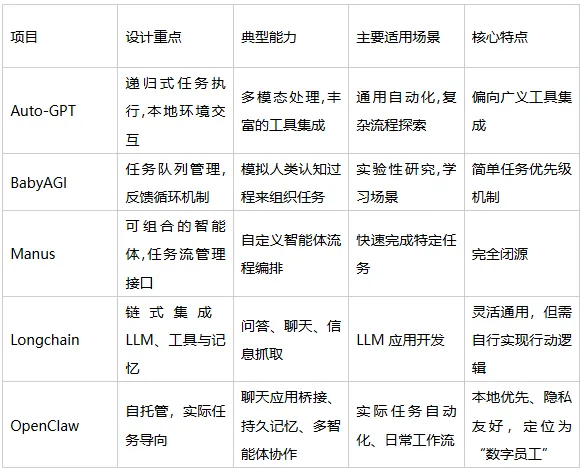

OpenClaw该架构的核心灵感来源于Lobster工作流壳(一个受Pi智能体核心启发的智能体循环框架),但在实际实现中进行了显著优化,以适应本地硬件环境和多通道集成。

OpenClaw的架构并非一个持续运行的“智能体”,而是一个高效的守护进程(daemon),通过事件触发来模拟智能体的“生命力”,从而避免了传统LLM的请求-响应局限性。这种设计在平衡性能、安全和扩展性方面表现出色,同时也引入了权限管理和上下文管理的复杂性。

3.1 整体框架与核心

OpenClaw的整体框架

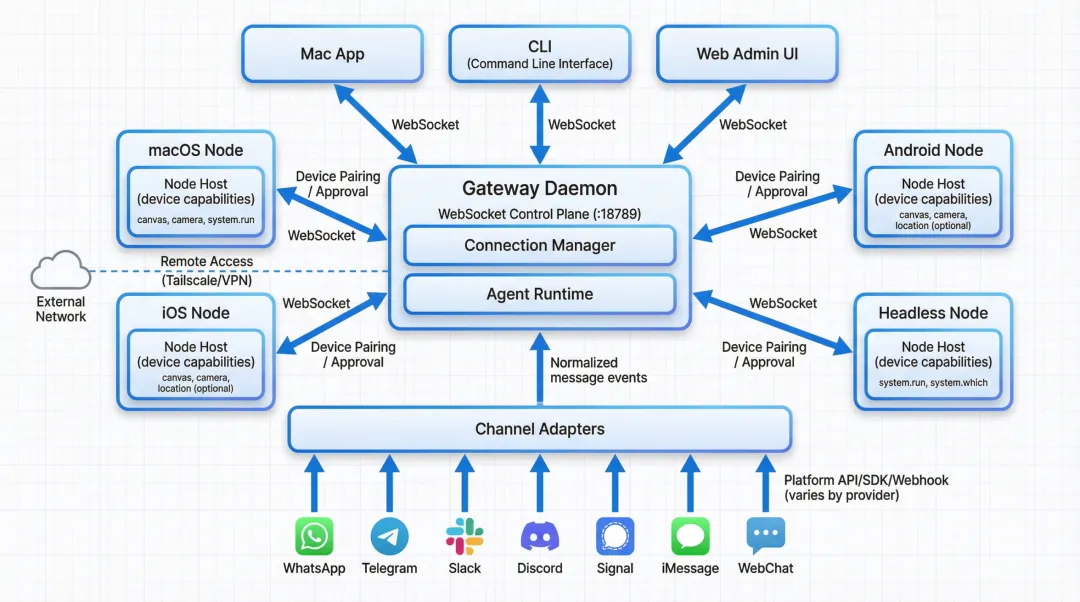

以Lobster工作流壳为核心智能体循环(agentic loop),这是一个事件驱动的循环机制,旨在将复杂任务分解为可执行的原子操作,并通过反馈迭代实现自主优化。Lobster壳起源于早期智能体设计(如Pi-agent-core),其角色类似于一个“协调器”,负责将用户意图转化为结构化的工作流。

OpenClaw的逻辑分层

Lobster工作流壳包括三个关键阶段:任务分解(decomposition)、执行(execution)和反馈(feedback)。

●任务分解:智能体首先通过上下文解析(context assembly)将输入分解为子任务。例如,一个用户查询如“检查邮箱并安排会议”会被分解为“检索邮箱API”、“意图识别”和“日历集成”等子模块。这种分解依赖于系统提示(system prompt)的注入,包括OpenClaw的“灵魂”(SOUL.md文件,定义个性)和“用户”偏好(USER.md),确保任务粒度细化到工具级别,避免大模型的幻觉(hallucinations)。这种分解机制借鉴了生物启发的节奏(如睡眠/唤醒周期),允许智能体在低能量状态下暂停,从而优化资源消耗。

●执行:一旦分解完成,智能体进入工具调用阶段,使用预定义的技能(如浏览器自动化、API调用)来实际执行子任务。Lobster壳在这里充当“路由器”,支持异步执行和错误恢复,例如通过重试机制处理API失败。相对于传统聊天机器人文本生成的单一职能;OpenClaw强调“行动导向”,允许智能体修改本地文件或触发外部服务。

lobster架构图

●反馈机制:执行后,智能体通过持久化存储(如Markdown文件和JSONL日志)反馈结果,并更新记忆(memory)。这形成了一个闭环:反馈数据注入下一次循环的上下文,实现自适应学习。例如,如果任务失败,智能体可自动调整策略,如切换LLM模型或增加检查点。该框架的整体优势在于其本地优先(local-first)设计,减少了对云依赖,但挑战在于高负载下的瓶颈,如长上下文窗口溢出。总体上,Lobster壳使OpenClaw从传统的被动响应转向主动智能体,有些类似于多智能体系统(multi-agent systems)的简化版,但更注重单机效率。

核心智能体循环(agentic loop)

3.2 组件分解

OpenClaw的组件设计采用模块化架构,主要分为大模型集成、后端引擎和前端接口,确保各部分可独立扩展。基于Node.js和部分Python的混合实现,该系统强调事件驱动和异步处理,以支持实时任务自动化。

●AI模型集成:OpenClaw支持多种大型语言模型(LLM),如Claude系列、GPT系列、Ollama本地模型和OpenRouter等,通过一个模型无关(model-agnostic)的接口设计实现。

OpenClaw能直接支持的模型列表(注:目前一些国内模型也开始支持OpenClaw)

该接口使用WebSocket和API智能体(如Cloudflare AI Gateway的变体)来路由请求,允许用户提供自己的API密钥,确保隐私。模型选择对性能影响显著:上下文窗口大小决定了任务复杂度的上限,长窗口模型适合多步推理,但增加延迟;推理速度(例如Codex作为“肌肉”模型用于代码生成,Opus作为“大脑”用于规划)则影响实时性。在基准测试中,使用本地模型如Ollama可降低延迟20-30%,但牺牲准确性。接口还支持热重载(hot-reload)技能,允许智能体动态扩展自身,而不需重启。

●后端引擎:基于Node.js的核心实现,辅以Python技能扩展,该引擎采用事件驱动架构(event-driven architecture),使用WebSocket作为控制平面。异步任务处理通过setInterval和Promise实现,例如心跳(heartbeat)间隔(每30秒ping客户端)和轮询器(poller)管理定时任务,如cron调度。状态管理依赖于持久化层,包括工作区(workspace)文件夹(/openclaw)和状态目录(/.openclaw),使用Markdown文件存储内存和JSONL日志记录会话。引擎支持多智能体隔离(separate workspaces),但在高并发下可能出现瓶颈,如工具执行的序列化导致延迟。相比纯Python实现,Node.js提供了更好的I/O并发,但引入了安全风险,如权限滥用。

●前端接口:OpenClaw作为一个以“对话驱动任务”为核心的框架,其集成能力主要通过 Gateway(网关) 层实现,由于其诞生于个人开发者场景,原生支持对 Telegram 和 WhatsApp 较好,对国内主流办公应用(钉钉、飞书、微信等)目前主要依赖中转桥接(如AppFlow或Webhook)来实现,前端通过API桥接集成聊天应用,如WhatsApp、Telegram、Slack和iMessage,支持多通道(multi-channel)输入。该桥接使用Gateway作为消息路由器,将自然语言处理(NLP)映射到动作:输入消息触发事件→NLP意图解析(via LLM)→动作工具调用。NLP依赖于系统提示注入(如组装用户上下文和工具列表),然后映射到技能(如邮箱管理)。这一方案的优势在于无缝集成现有应用,但同时也意味着潜在的提示词注入风险(prompt injection)。该接口还支持语音输入(via ElevenLabs),增强多模态能力。

OpenClaw对国内通信APP支持情况

3.3 数据流分析

OpenClaw的数据流遵循高效的端到端管道:用户输入→意图解析→任务规划→执行→结果反馈,确保信息在智能体循环中流动顺畅。该流程嵌入Lobster壳中,支持异步和持久化,以实现可靠的任务自动化。

●用户输入:数据流从多通道输入开始,如消息事件或cron触发。Gateway监听并路由到智能体ID,加载会话历史(JSONL格式)。

●意图解析:输入注入系统提示,包括上下文组装(workspace文件如SOUL.md和MEMORY.md)。LLM解析意图,生成工具调用序列,同时应用 rails(如“先搜索内存”)以减少错误。

●任务规划:基于解析,智能体规划子任务路径,使用工具列表和技能元数据。规划阶段支持多轮推理(up to 10 rounds),优化复杂任务如财务自动化。

●执行:工具执行阶段处理API调用或本地操作,结果追加到上下文。异步处理确保非阻塞,例如浏览器工具(Puppeteer)并行运行。

●结果反馈:执行后,流式回复用户,并持久化状态(更新记忆文件、索引)。反馈闭环允许智能体自省,如调整下次规划。该流程的均衡性体现在各阶段的资源分配:解析和规划消耗LLM tokens,执行依赖I/O,反馈确保长期一致性。但在长上下文下,可能出现token溢出,需通过压缩(compaction)优化。

全文目录

1 引言

2 背景与发展历史

2.1 项目起源

2.2 重命名历程

2.3 社区与流行度

2.4 生态定位

3 系统架构

3.1 整体框架与核心

3.2 组件分解

3.3 数据流分析

4 核心技术与功能

4.1 任务执行机制

4.2 集成能力

4.3 AI增强模块

4.4 自托管部署

5 性能评估与基准测试

5.1 量化指标

5.2 案例研究

5.3 扩展性分析

6 安全、隐私与伦理考虑

6.1 风险评估

6.2 防护机制

6.3 隐私合规

6.4 伦理讨论

7 挑战、未来发展与结论

7.1 挑战与局限性

7.2 未来发展展望

7.3 结论

夜雨聆风

夜雨聆风