本地源码方式部署OpenClaw,接入飞书,通过手机也能随时vibe coding了【保姆级教程】

这两天刷到了不少“同城上门服务安装OpenClaw”的帖子,给我惊到了——这东西居然火到有人提供上门服务了?

年前刚火那会儿,发了一篇推文:45.7k Star!Clawdbot热度持续上升!当时看了一些头部大佬的评测,由于担心🦞权限太高不安全,一直没敢在自己电脑上搞,当时在某云上部署了一套——确实便宜省事,近乎白嫖的价格,但是2c2g的配置体验不算太好。

最近OpenClaw版本依旧是频繁迭代更新,看了一下github,现在Star数已经猛涨到242K了,于是决定干脆在本地电脑上源码搞一把,通信渠道依旧是接入飞书。

好了,不多说,直接上干货!

源码部署OpenClaw

1、前置依赖

首先确保你本地有Node环境(官方建议node版本 >=22.12.0)以及 pnpm 包管理器,这个很重要。

如果你没有coding基础,觉得配置环境麻烦,可以略过源码启动的方式,使用一键部署方式,可以自动安装 Node.js 和所有依赖,一步到位:

curl -fsSL https://clawd.org.cn/install.sh | bash2、 克隆代码

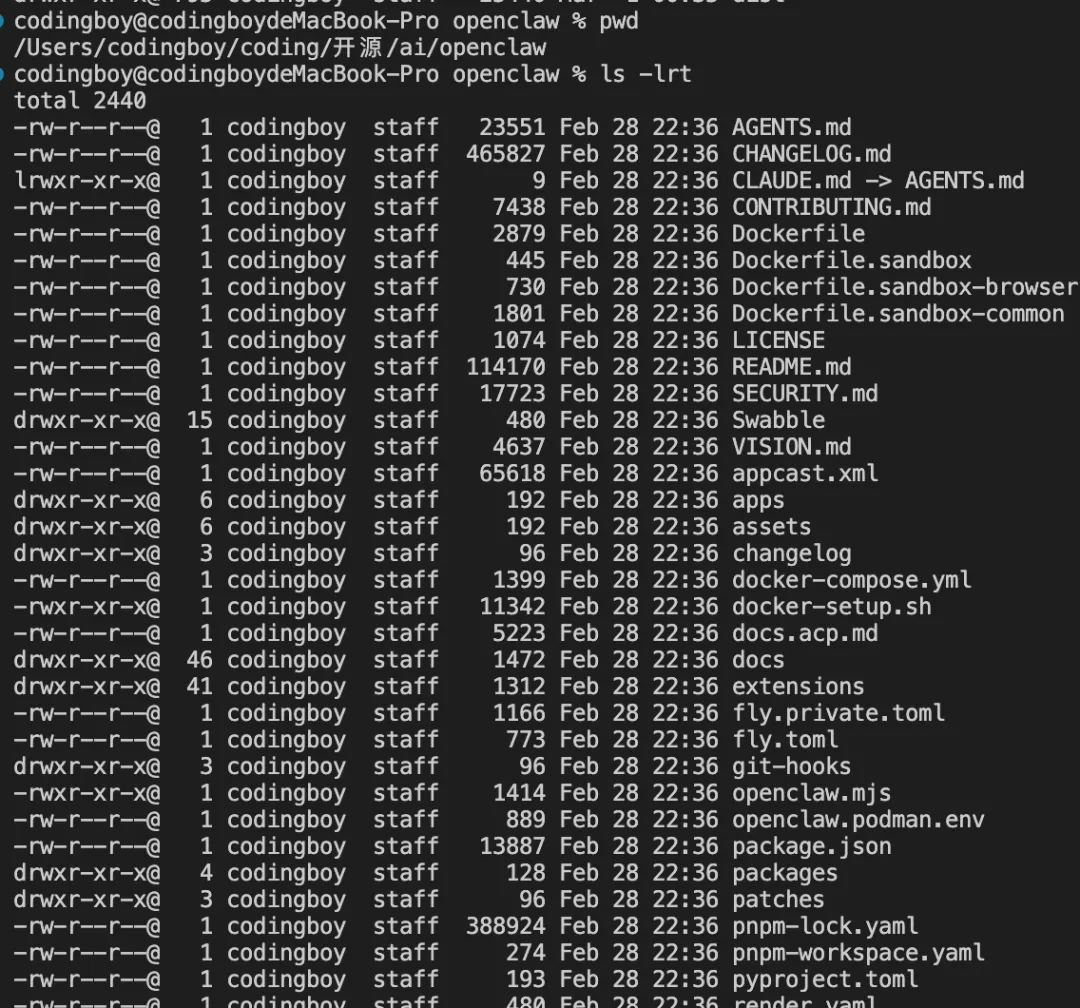

打开终端,执行git clone命令,从github仓库拉取源码:

git clone https://github.com/openclaw/openclaw.git进入程序目录:cd openclaw

3、安装依赖

使用pnpm安装依赖,速度比npm快很多(ps:如果没有pnpm,可以先用 npm install -g pnpm 安装)

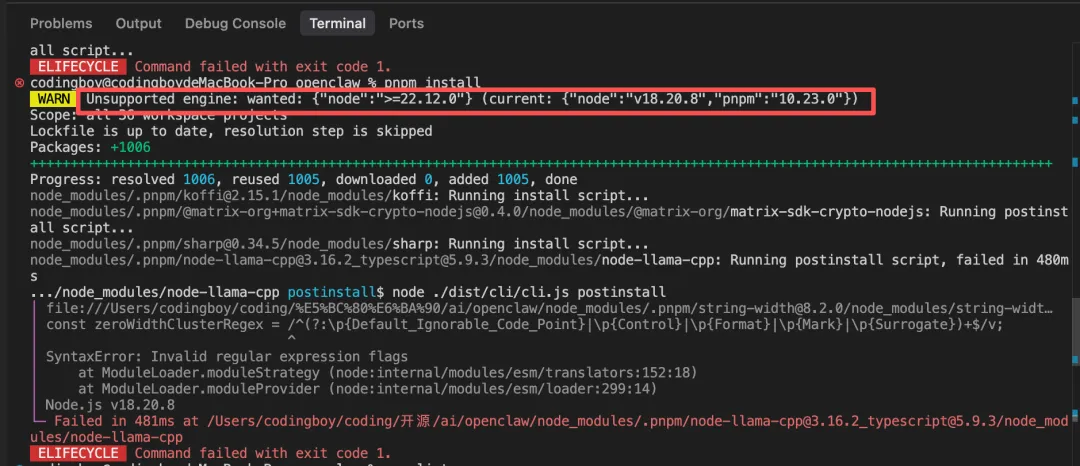

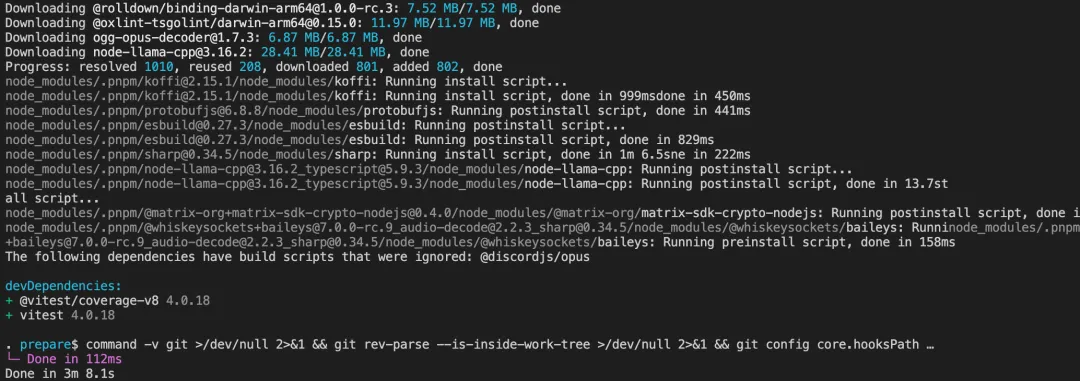

pnpm install这一步会安装所有的依赖项,可能需要一两分钟。

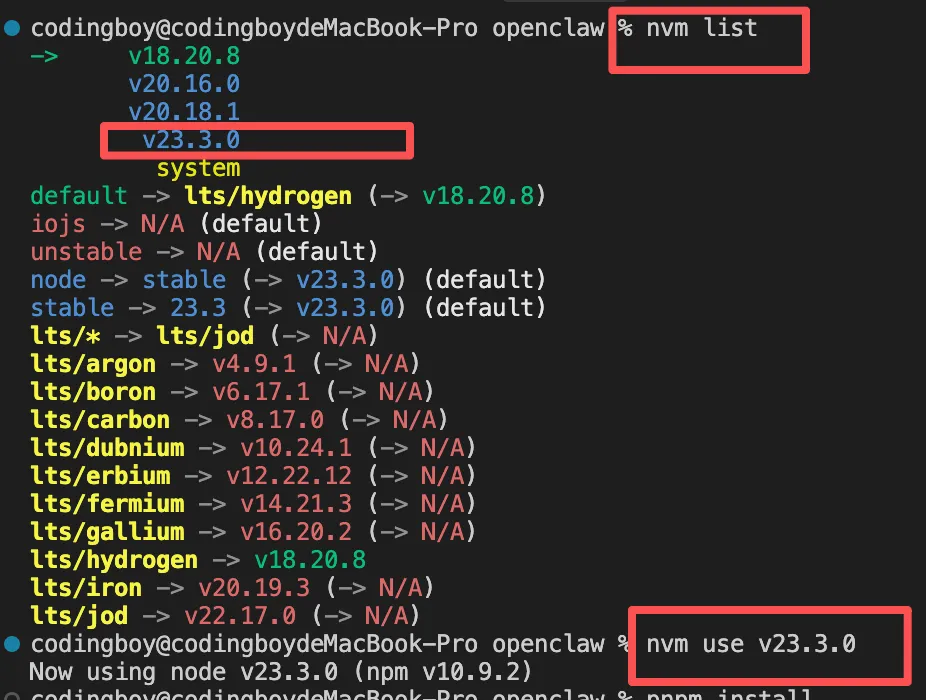

话说,我在安装过程中遇到一个小插曲,通过日志可以看到,由于我本地默认使用的node版本是v18.20.8,导致依赖安装失败了,所以前置环境很重要。日志也明确给出了提示:node版本需要 >= 22.12.0

我本地有多个node环境,使用了nvm来维护,可以丝滑切换,于是,我把node版本切换到了v23.3.0

再次执行:pnpm install 可以看到,依赖安装成功!

4、构建前后端依赖

构建前端UI资源相关的依赖:

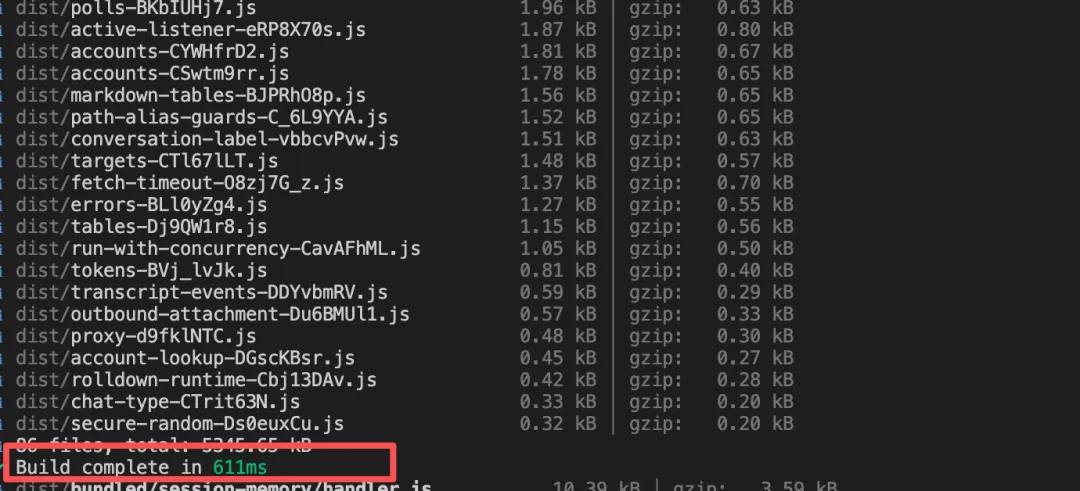

pnpm ui:build接着构建整个前后端项目:

pnpm build如果看到这个日志,恭喜你,你的基础环境安装工作基本结束了,是不是很简单!

接下来需要做的,就是初始化配置你的专属🦞小龙虾了,跟在云平台配置基本一致了。

5、配置初始化

执行以下命令,开始初始化配置🦞小龙虾:

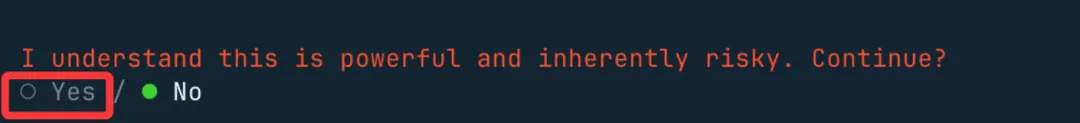

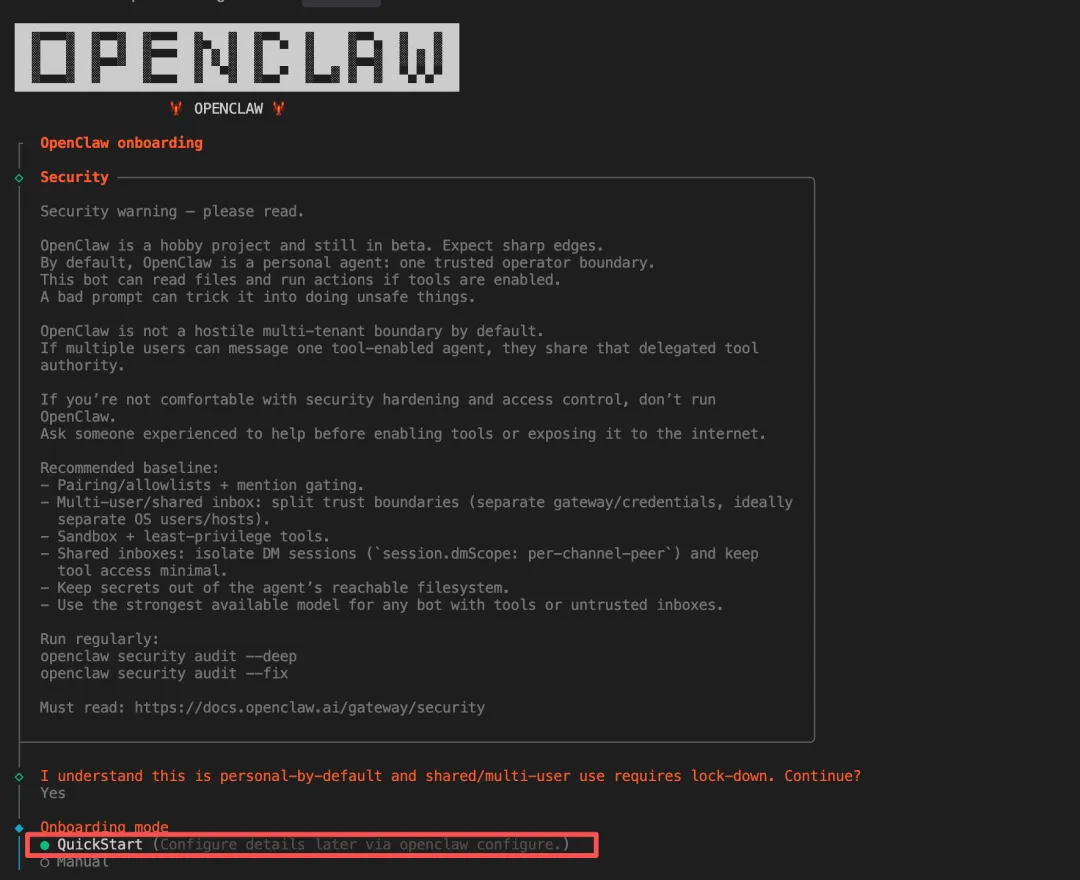

pnpm openclaw onboard --install-daemon如果是第一次安装,会给出提示:能力很强,但同时风险也很高,是否继续。注意⚠️:我们必须选择Yes,否则会退出初始化配置,无法往下走

接着,选择默认的QuickStart,开始配置大模型:

配置大模型

可以看到,支持了不少国内外主流的模型供应商,基本上只需要对应服务商的key就可以完成配置,这根据自己的实际情况去选择运营商,就不赘述了。

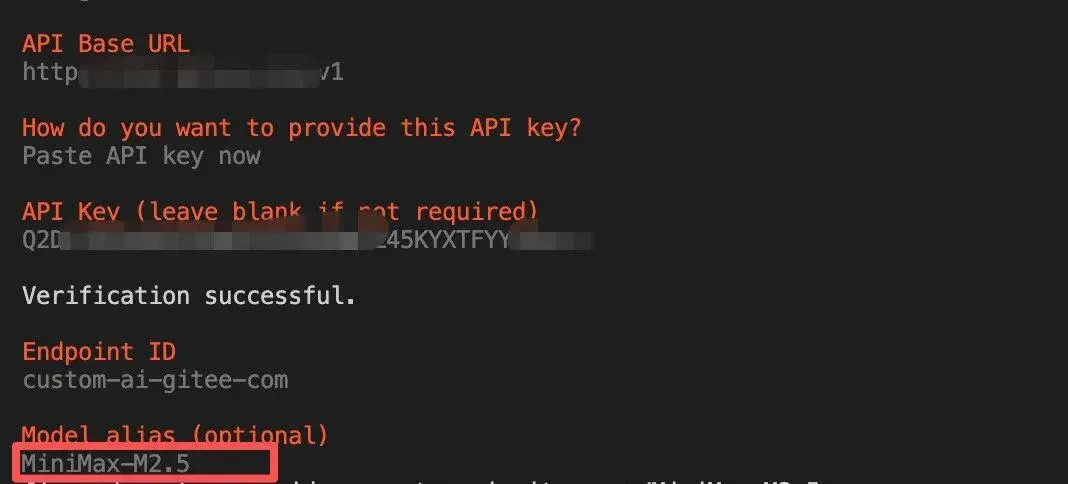

另外值得一提的是,除了云厂商之外,还支持了自定义运营商,选择Custom Provider,我们可以配置OpenAI、Anthropic兼容的任何大语言模型。包括私有化部署的模型,比如本地ollama部署的模型,这个是灵活度最高的一种配置方式,我们可以自定义BaseURL、key、模型名称。

我这里使用Custom Provider的方式,配置了MiniMax M2.5 (ps:这里推荐一波 minimax M2.x版本,性价比很高,推理能力很棒,速度也嘎嘎快!)

配置消息渠道

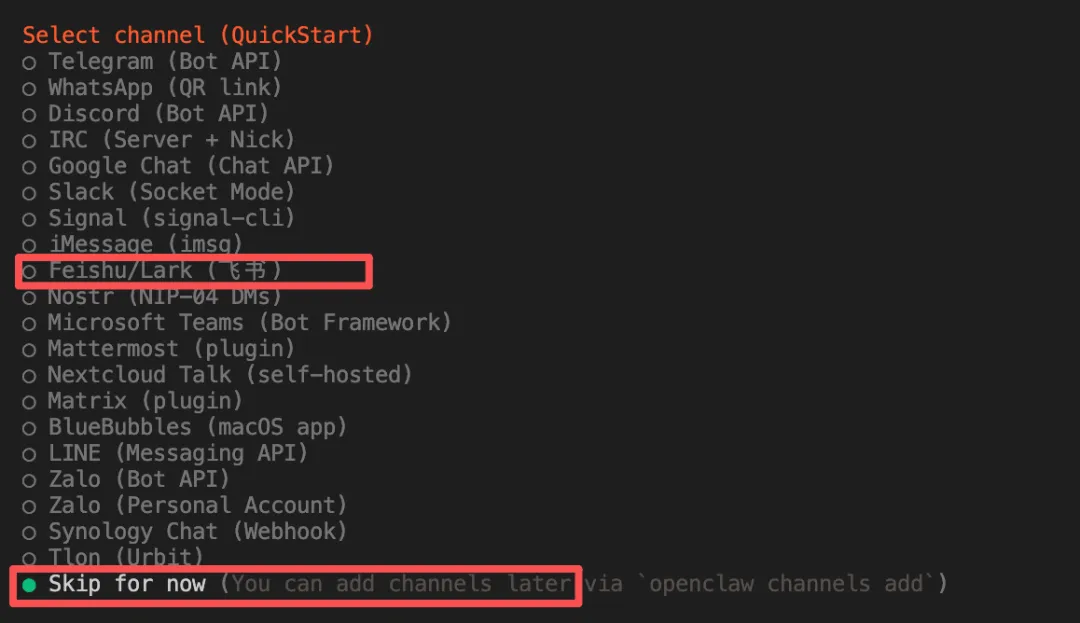

完成大模型配置后,开始配置消息渠道,个人而言,强烈推荐使用飞书。这里我们先选择下一步,后面再配,先保证前面的流程都能走通。

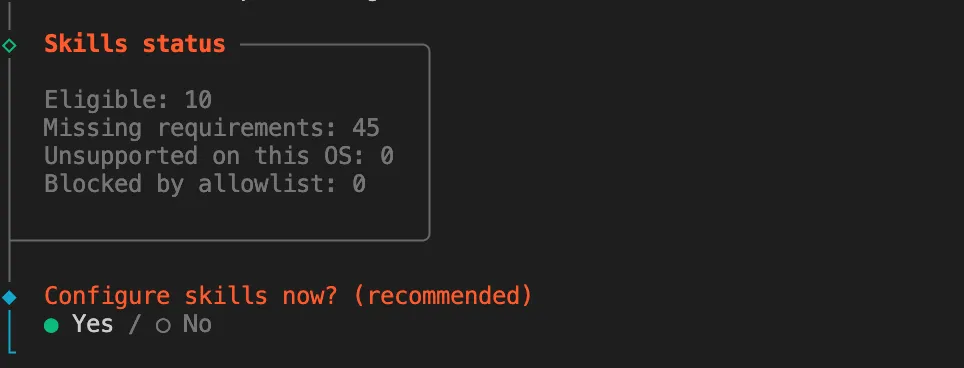

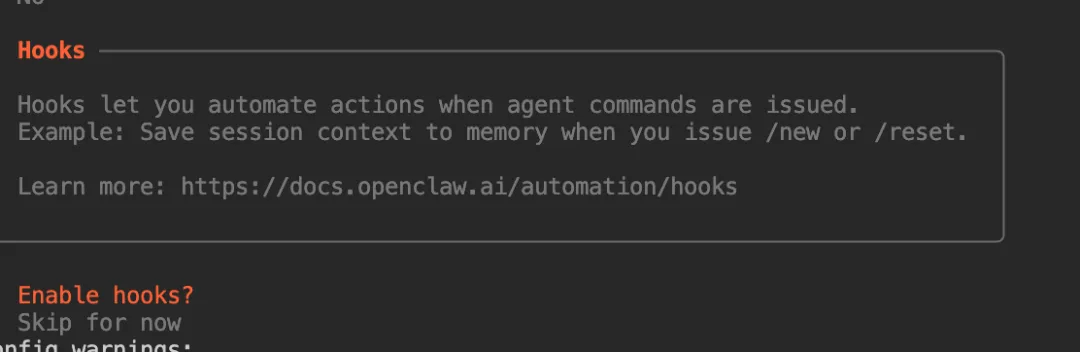

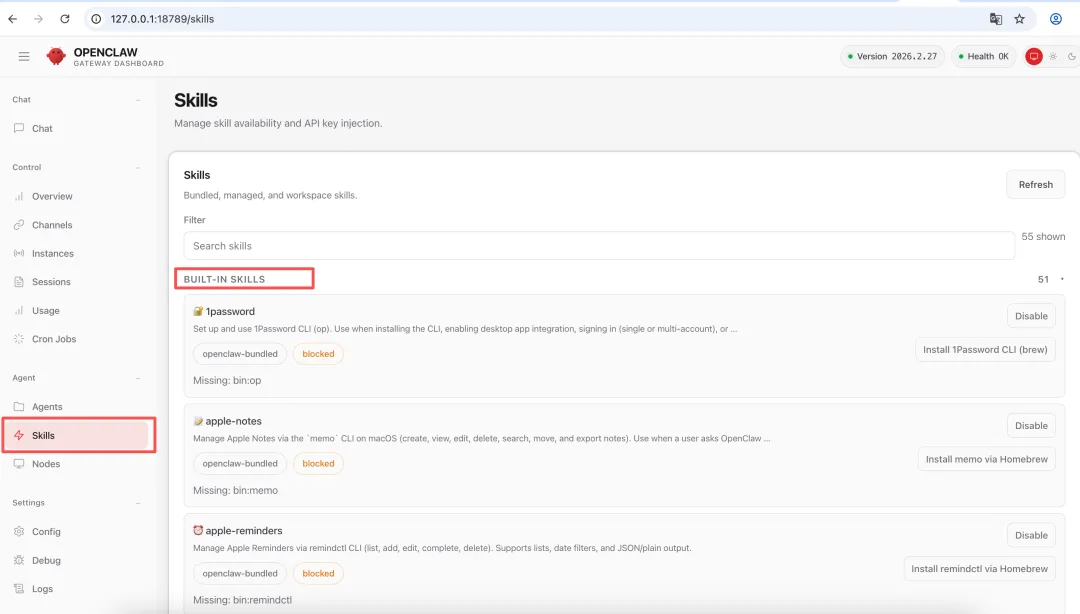

接下来的Skills、Hooks配置均可以先忽略,直接选择Skip for now 下一步,后面再慢慢配。

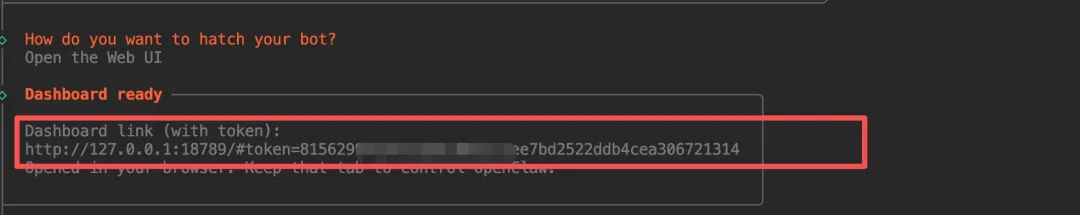

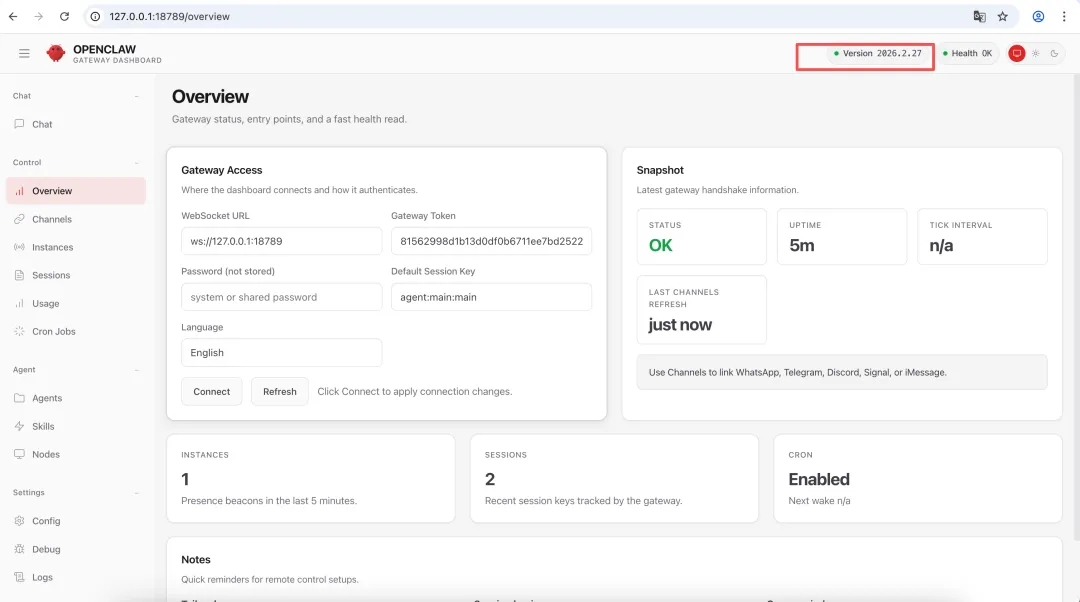

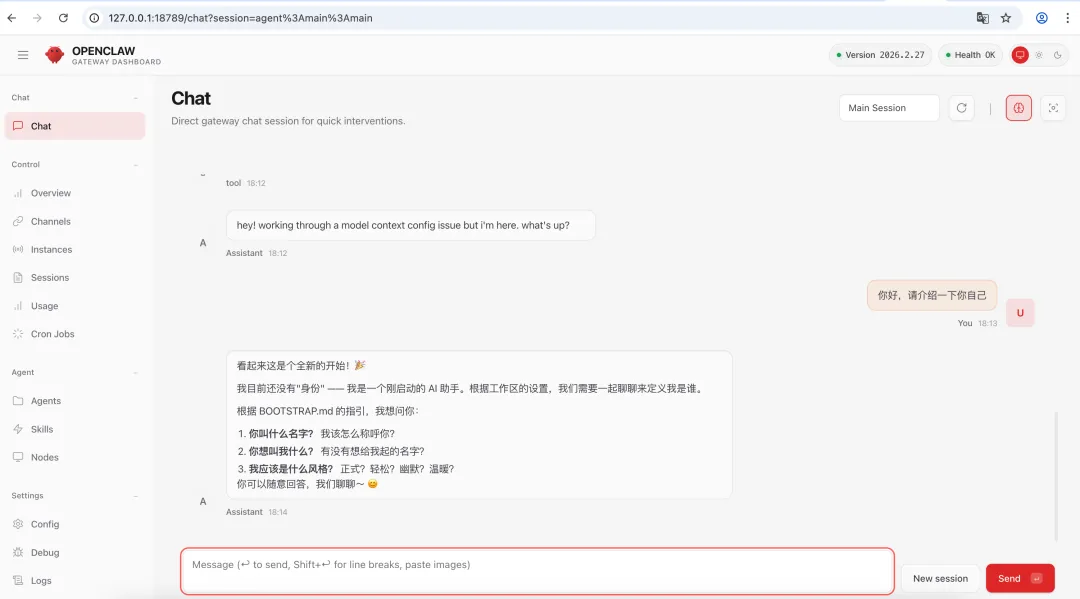

一路下一步到最后,选择Open The Web UI,浏览器会弹出后台界面,我们可以看到当前源码部署的版本:2026.2.27

接着我们可以通过后台界面再去安装Skills、配置Hooks等。

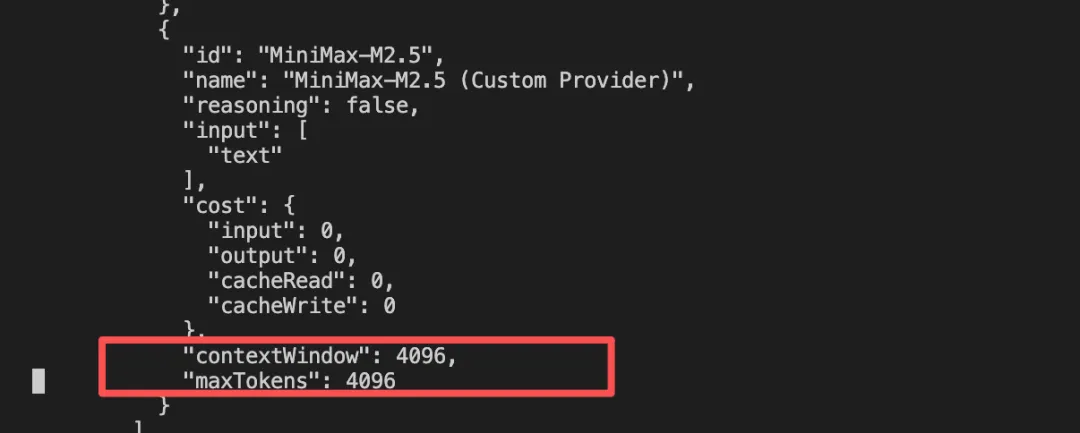

6. 踩坑:模型上下文长度默认值修改

是不是以为到了这里流程就已经走通了?

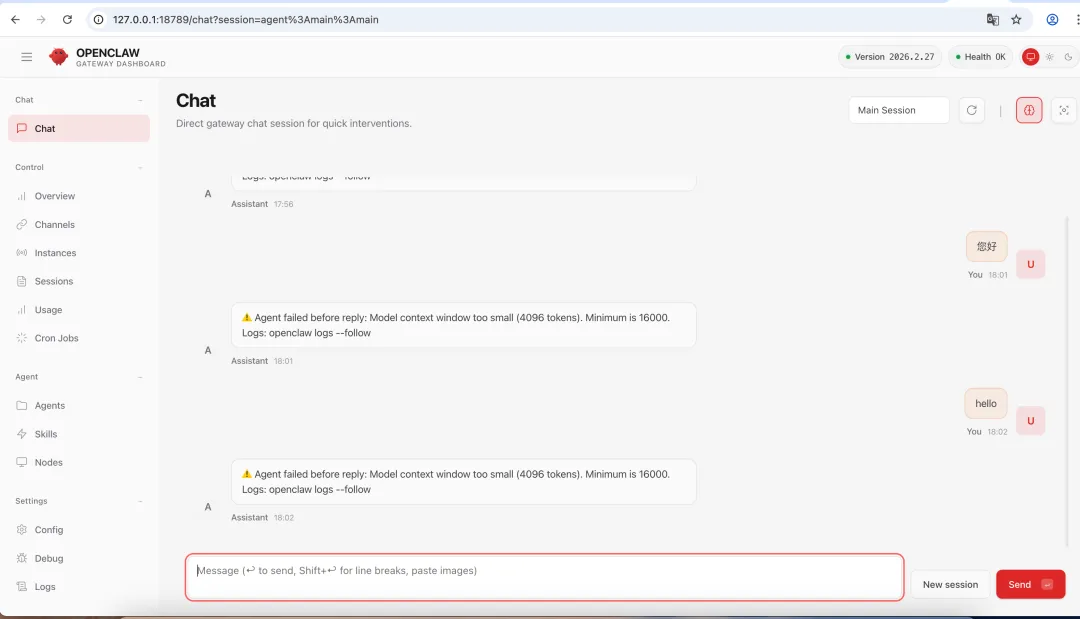

在chat界面给小龙虾🦞发送一条消息,你就会立马收到一条报错提示:⚠️ Agent failed before reply: Model context window too small (4096 tokens). Minimum is 16000

不要慌,这是由于我们使用了自定义的模型供应商,配置的大模型上下文长度被系统默认置为4096,而Agent最小的长度要求是16000,我们可以通过修改配置文件来调整。

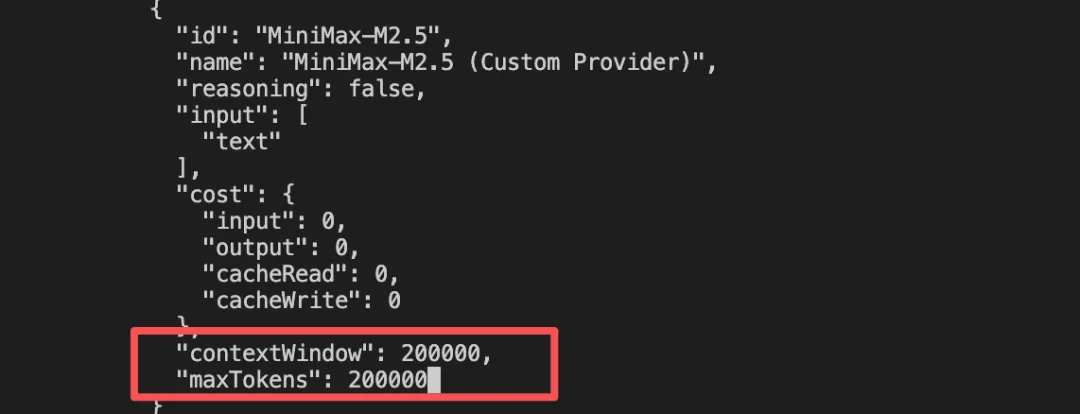

修改openclaw.json配置

OpenClaw 的配置文件默认存放在用户目录下的 .openclaw/openclaw.json。我们可以修改它来调整一些参数,比如最大 Token 限制,以适应大模型的上下文。

vi ~/.openclaw/openclaw.json我们找到对应的大模型配置,可以看到maxTokens和contextWindow默认为4096

修改为200k,保存配置之后,重启网关

重启网关和管理页面

node openclaw.mjs gateway --port 18789 --verboseps:如果想重新打开管理页面执行:

node openclaw.mjs dashboard重启之后,我们再次给小龙虾🦞发送一条消息,可以看到已经可以正常回复消息了。

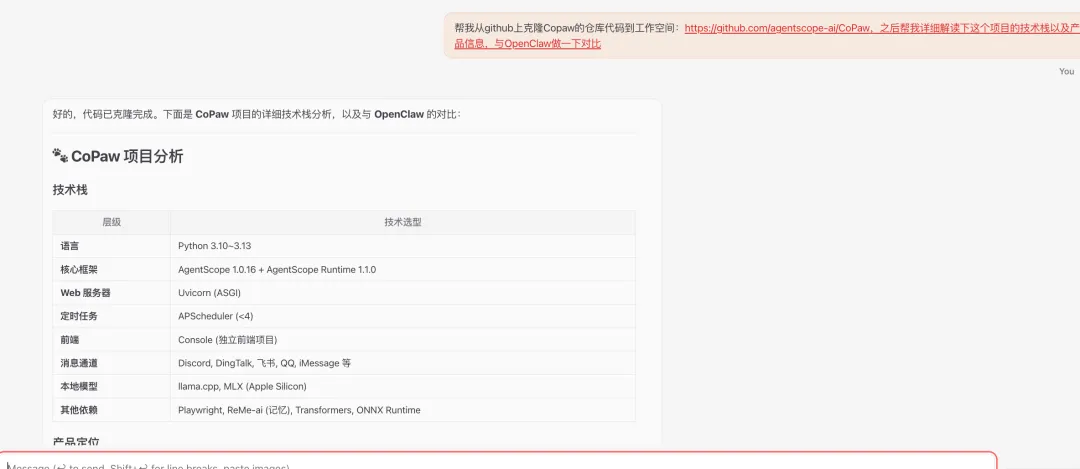

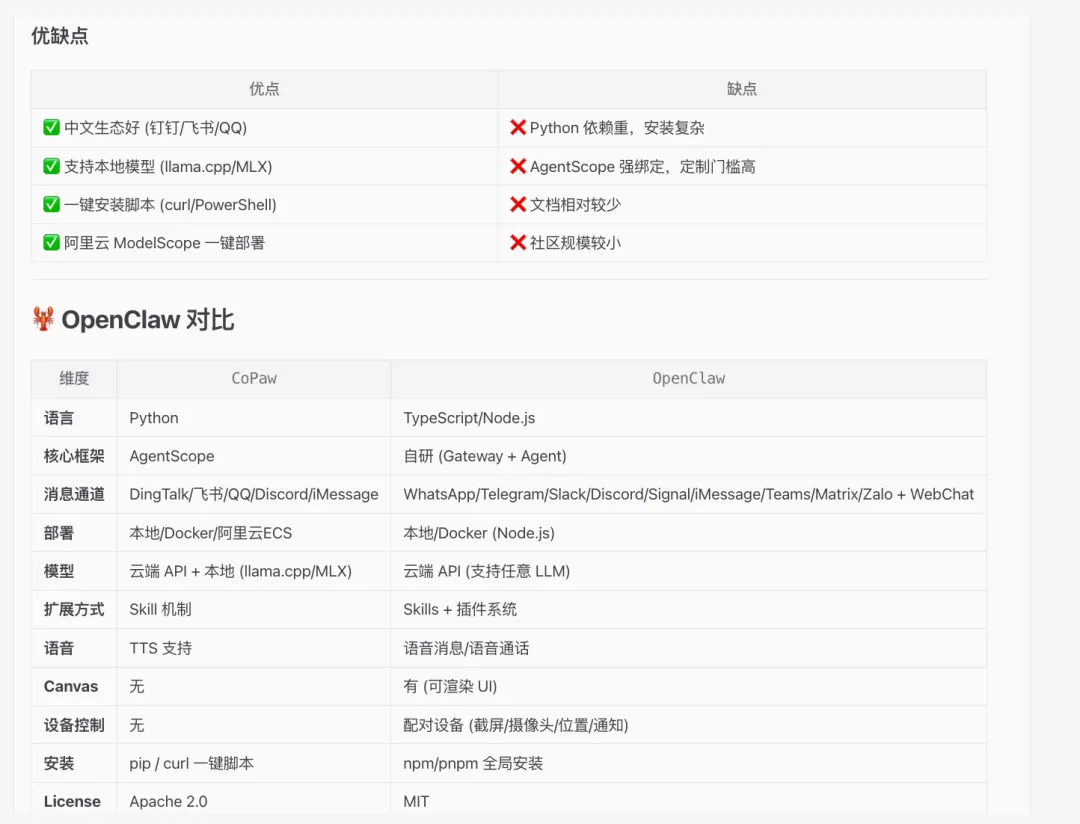

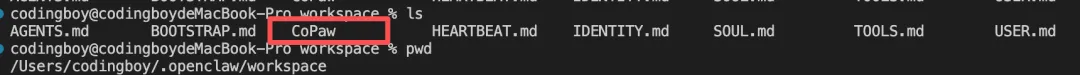

给Agent上一上难度:

帮我从github上克隆Copaw的仓库代码到工作空间:https://github.com/agentscope-ai/CoPaw,之后帮我详细解读下这个项目的技术栈以及产品信息,与OpenClaw做一下对比

接入飞书应用

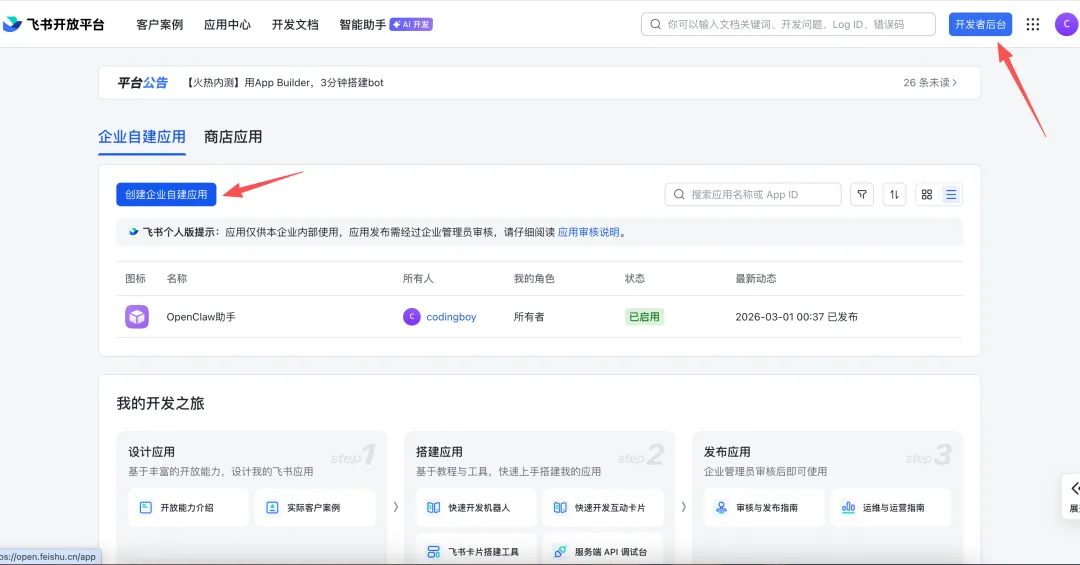

OpenClaw 已经内置了飞书适配器插件,我们只需要在飞书开发者后台创建一个应用机器人,简单几步配置即可完成接入,下面是详细步骤:

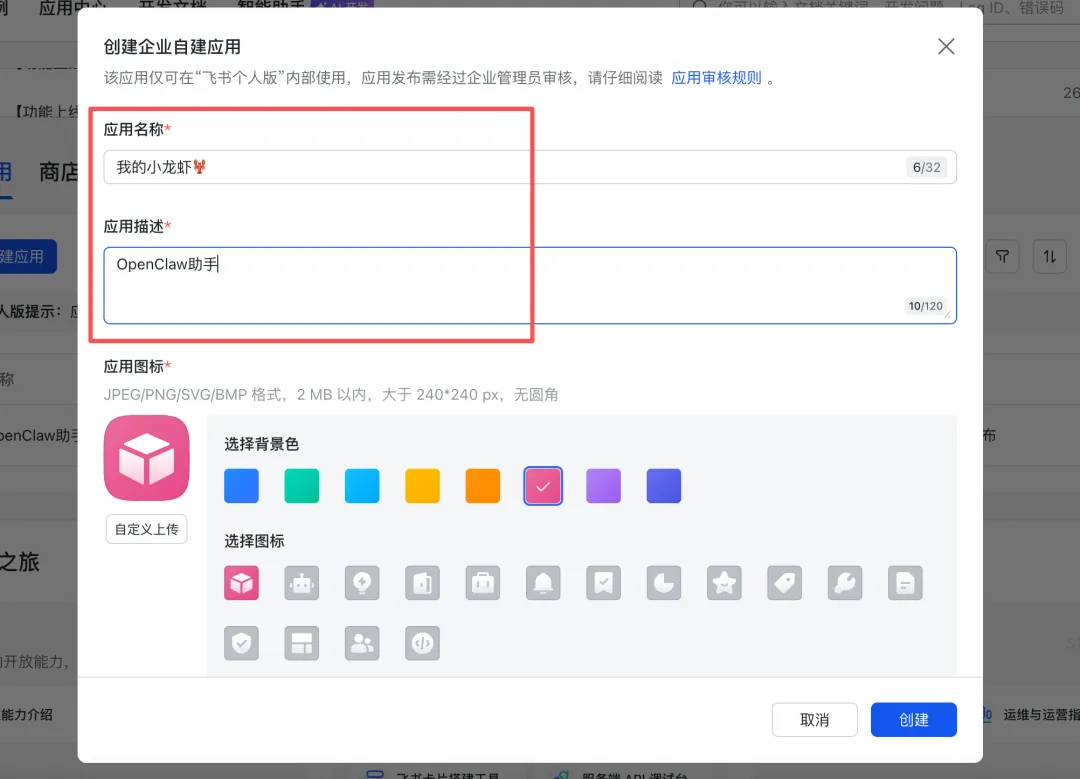

步骤 1:配置飞书应用

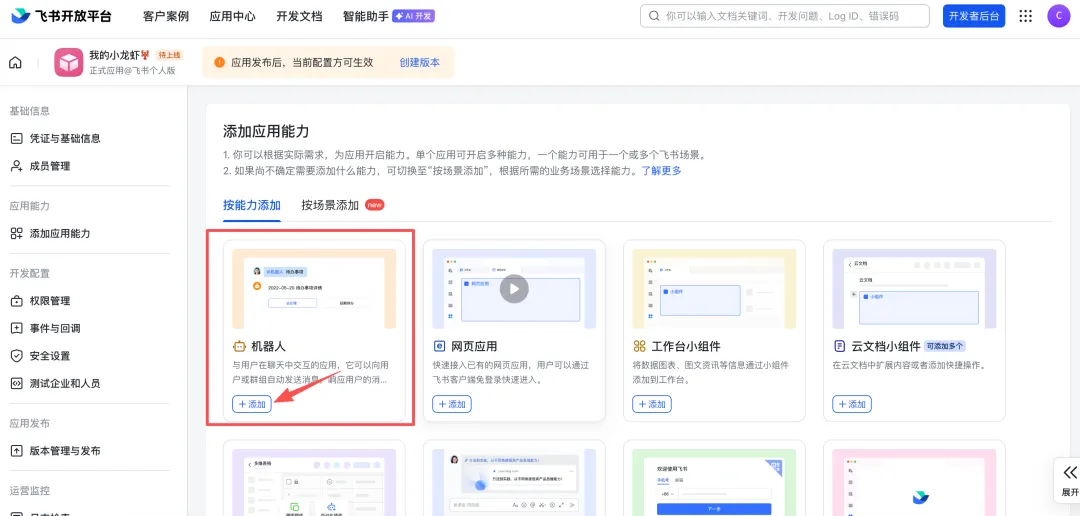

2、添加应用能力:添加机器人

在按能力添加tab页面,点击“添加”

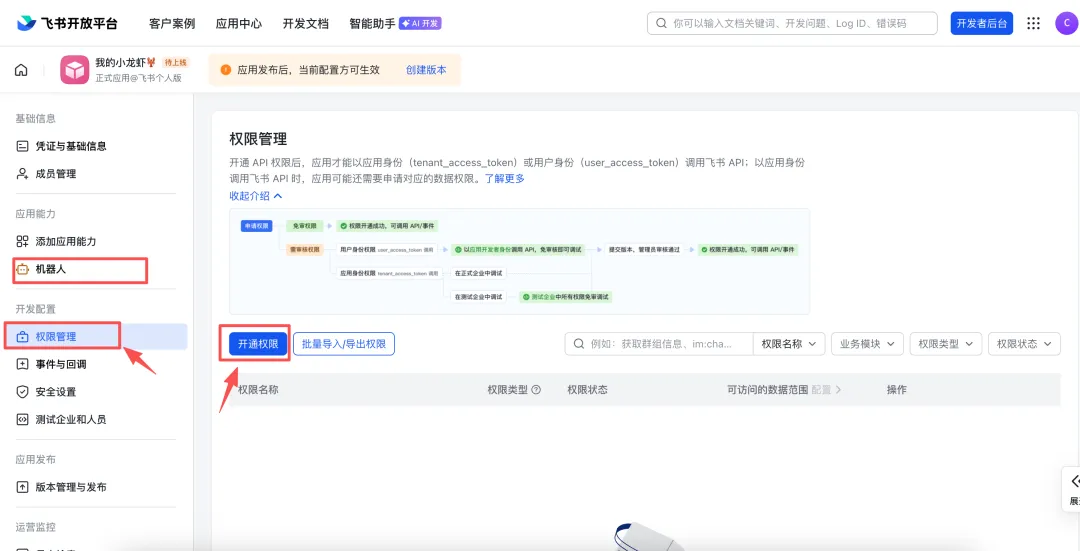

3、开通权限

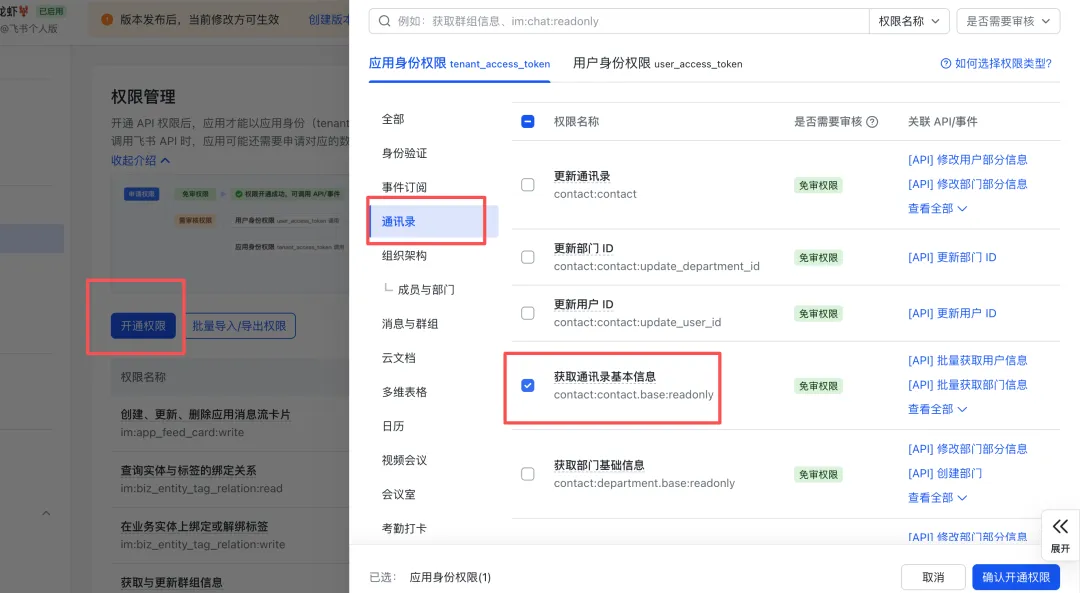

点击添加机器人之后,之后可以看到左侧应用能力菜单下多了“机器人”功能,点击权限配置->开通权限

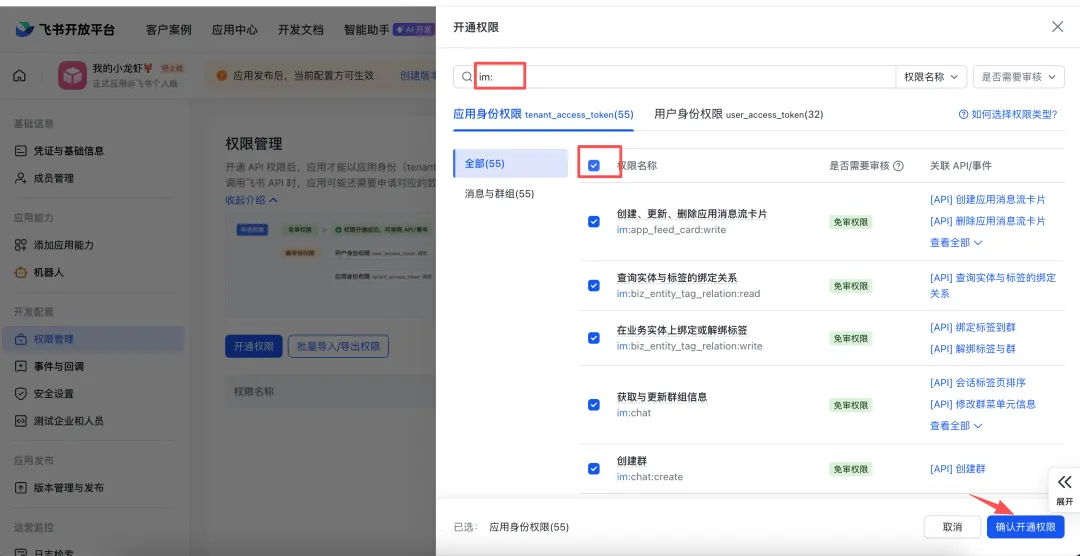

关键字过滤:im: 把消息与群组相关的所有权限都勾选,点击确认开通权限

如果是飞书个人用户账号,如果想要更好地体验Agent能力,我们可以尽可能地按需多给一些权限。如果是企业用户,建议悠着点

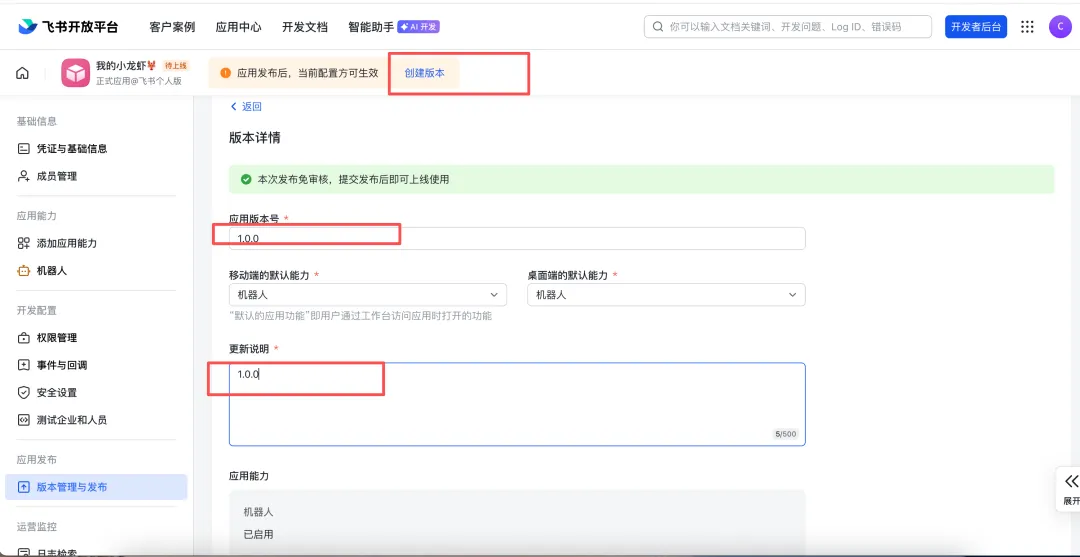

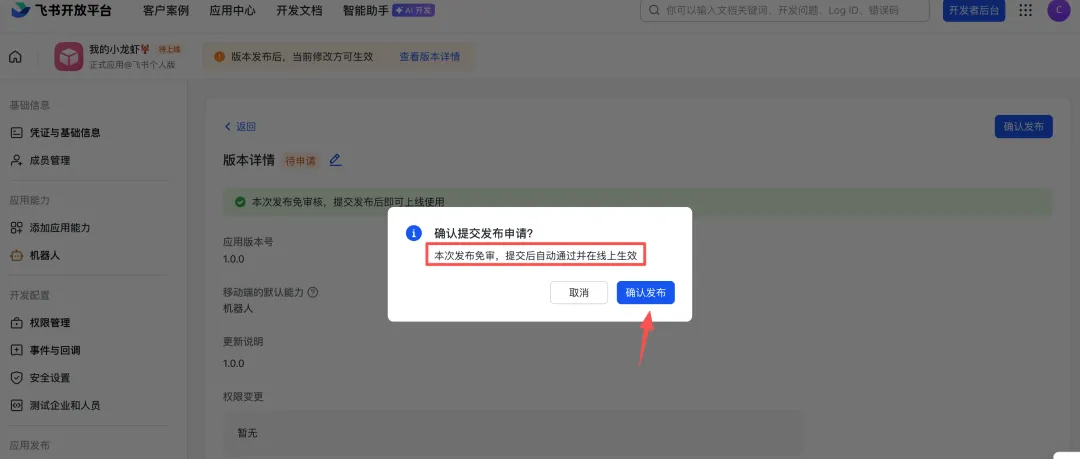

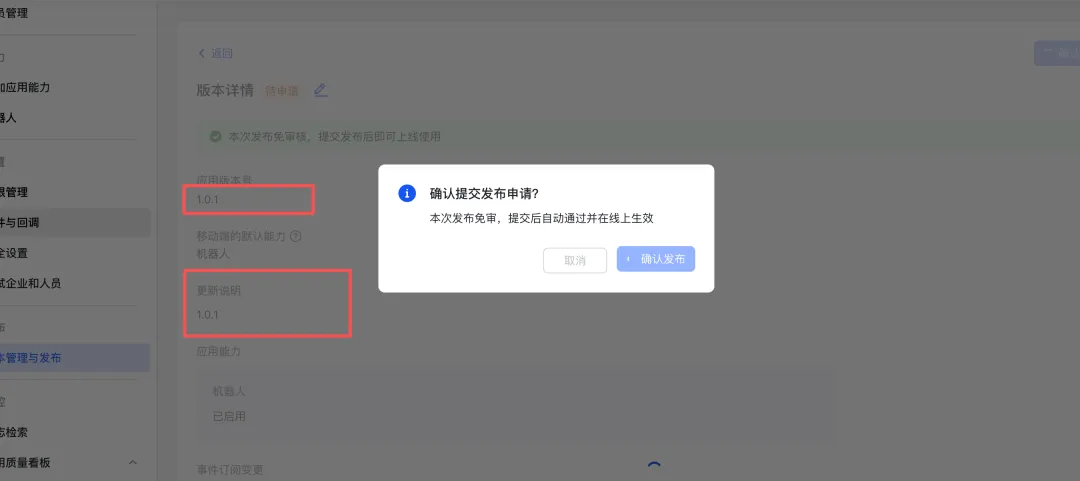

4、创建/发布版本

步骤 2:在 OpenClaw 中配置飞书插件

1、配置飞书插件

终端执行下面的命令,开始配置飞书机器人:

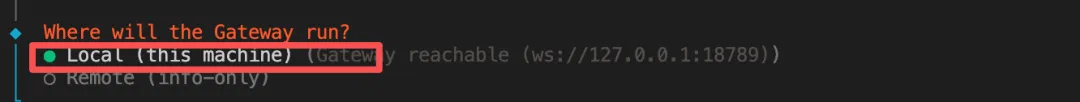

node openclaw.mjs config选择Local:

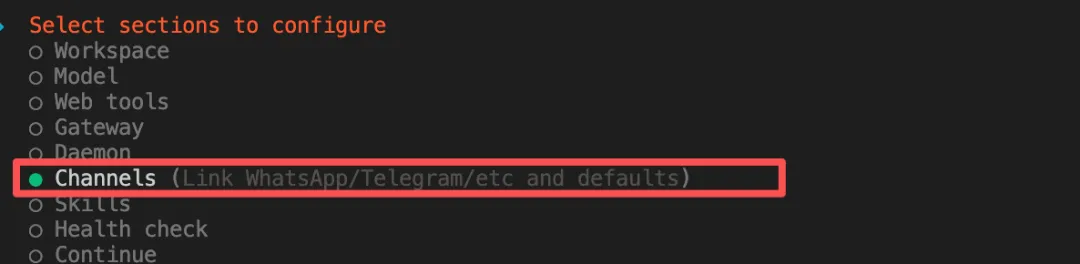

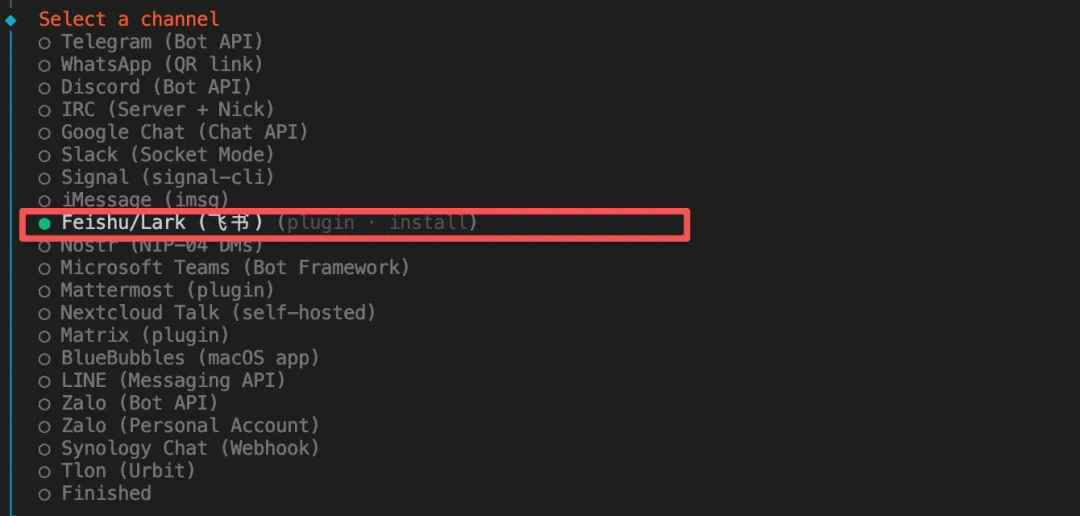

Channels选择飞书:

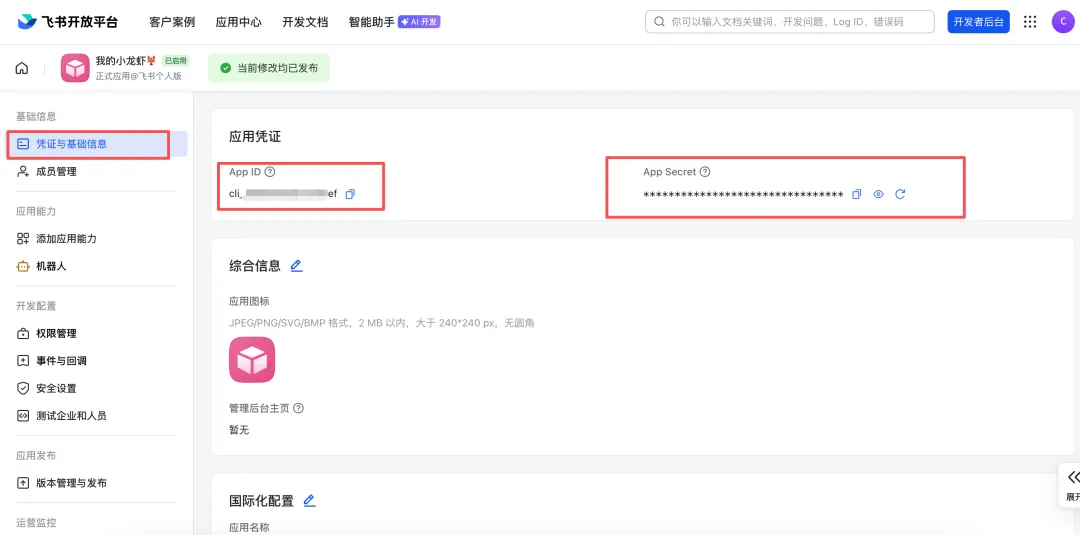

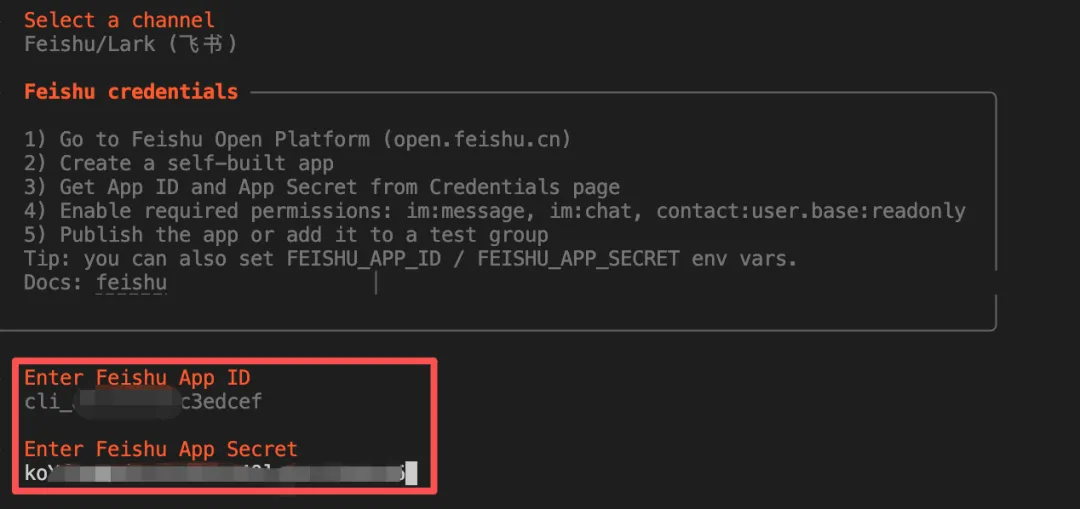

按照提示,输入飞书应用凭证(直接从飞书管理后台应用凭证copy即可)

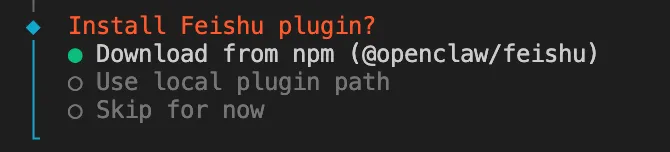

安装飞书插件

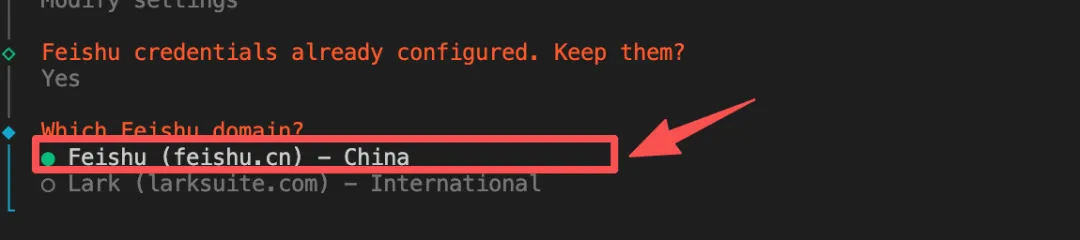

配置飞书选择国内的域名:

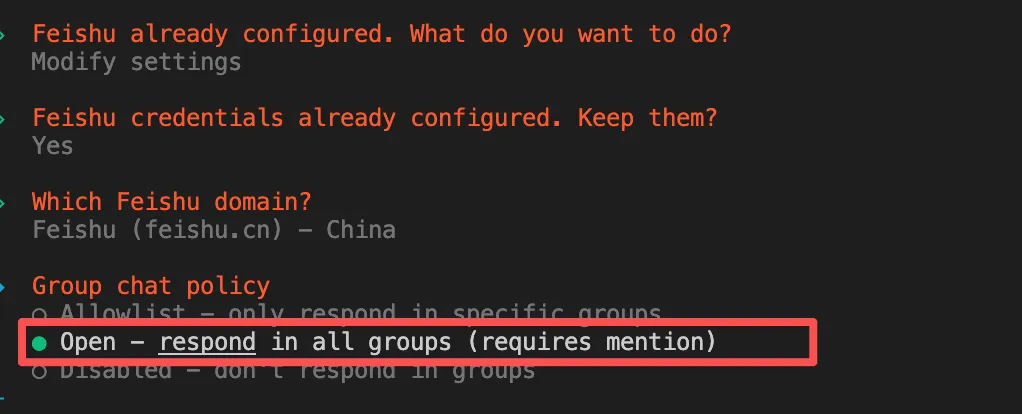

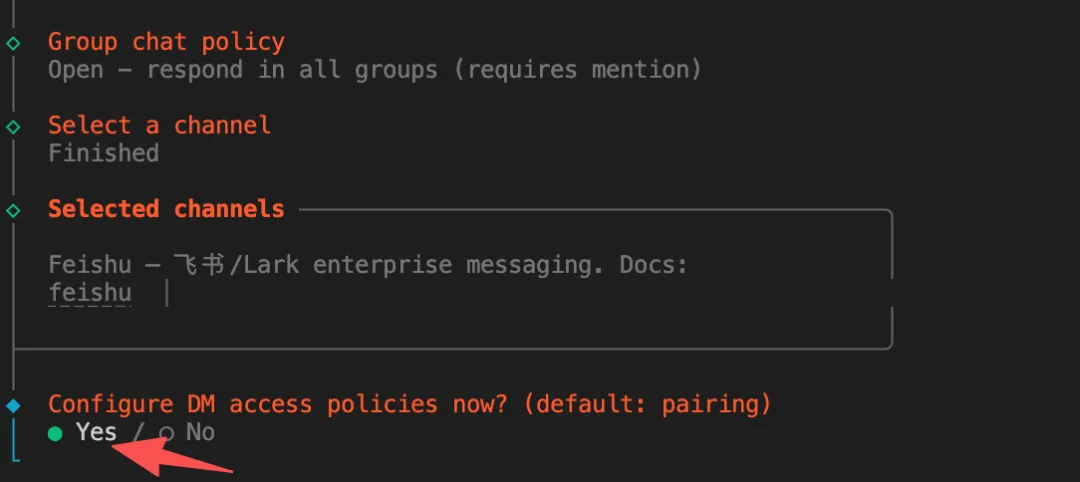

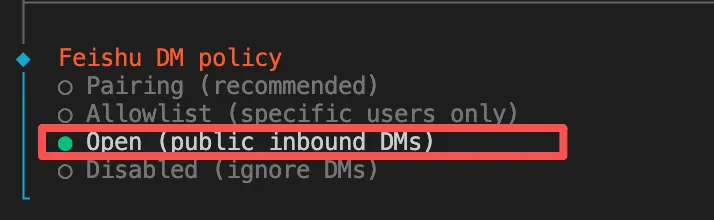

群组策略选择:Open 表示接收群组聊天,接下来按照截图步骤选择下一步操作即可:

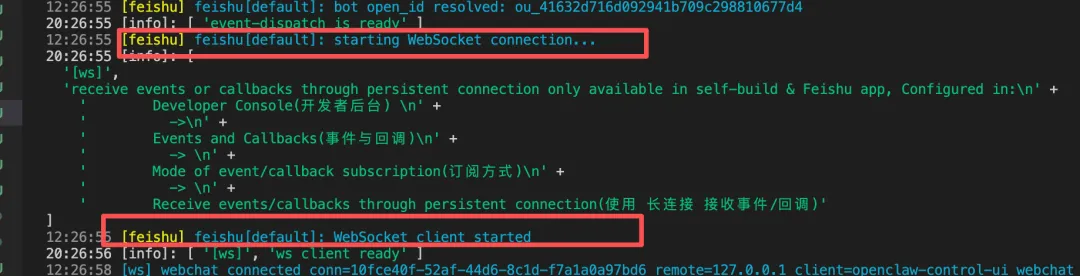

重启OpenClaw的网关服务,通过日志可以看到,飞书应用已成功建立WebSocket连接

node openclaw.mjs gateway stopnode openclaw.mjs gateway

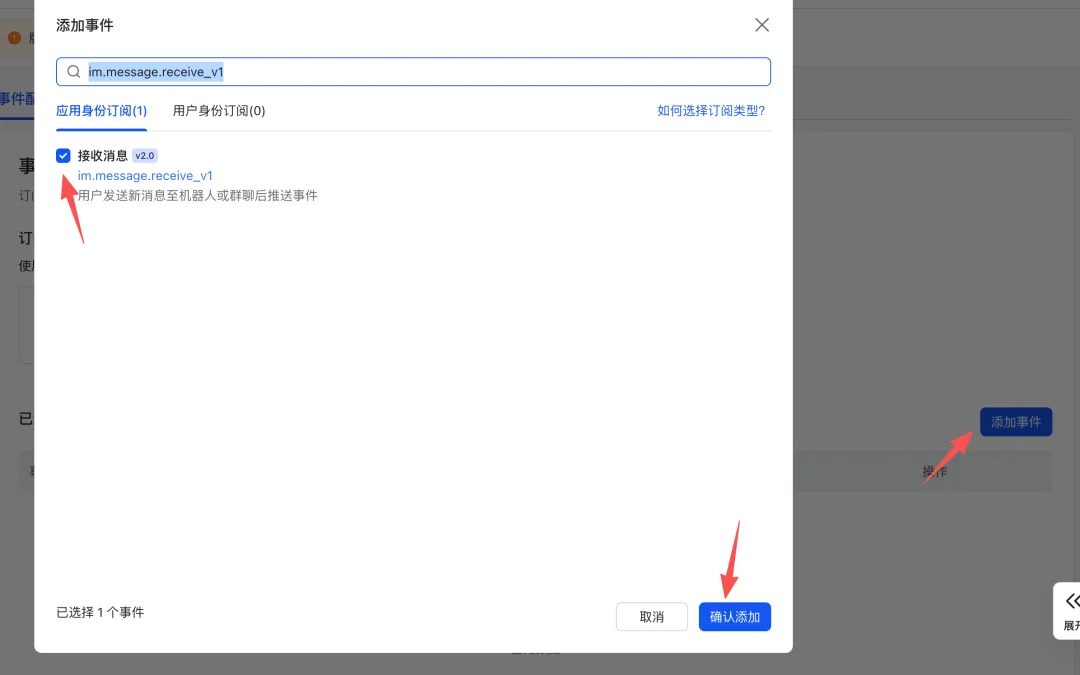

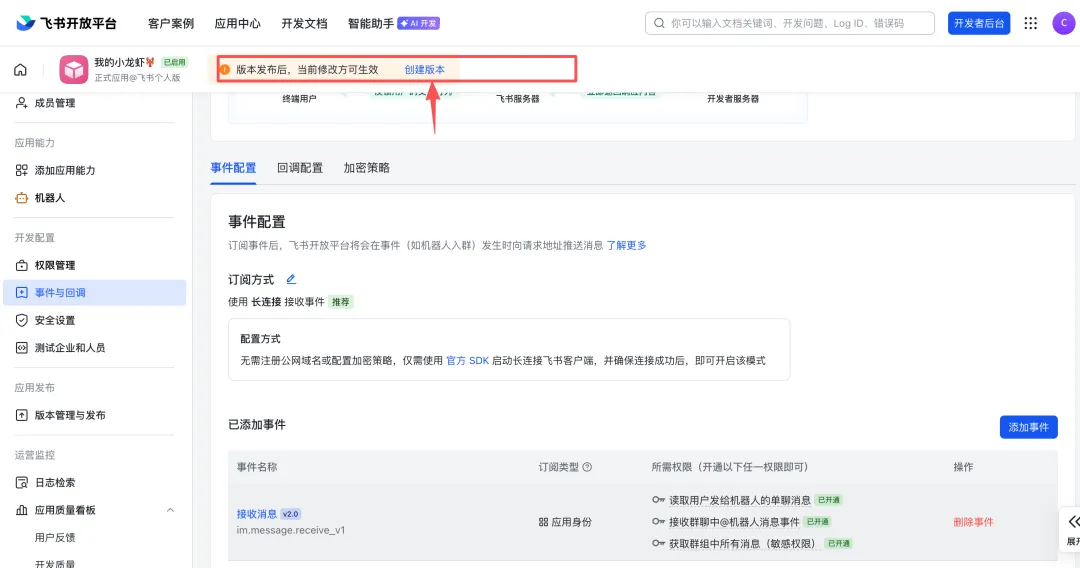

2、事件与回调配置

在飞书开放平台继续配置刚刚的应用,选择事件与回调,配置事件:本地部署要选择使用 长连接 接收事件 ,点击保存

接着,添加事件,模糊搜索关键字:im.message.receive_v1,点击确认添加

事件配置完成之后,再次发布版本

快速体验

上面,已经使用源码部署好了OpenClaw,也接入了飞书应用,简单测试一波吧!

打开飞书App,搜索机器人名称:

选择我的小龙虾机器人,进入对话框,发送指令测试一波:

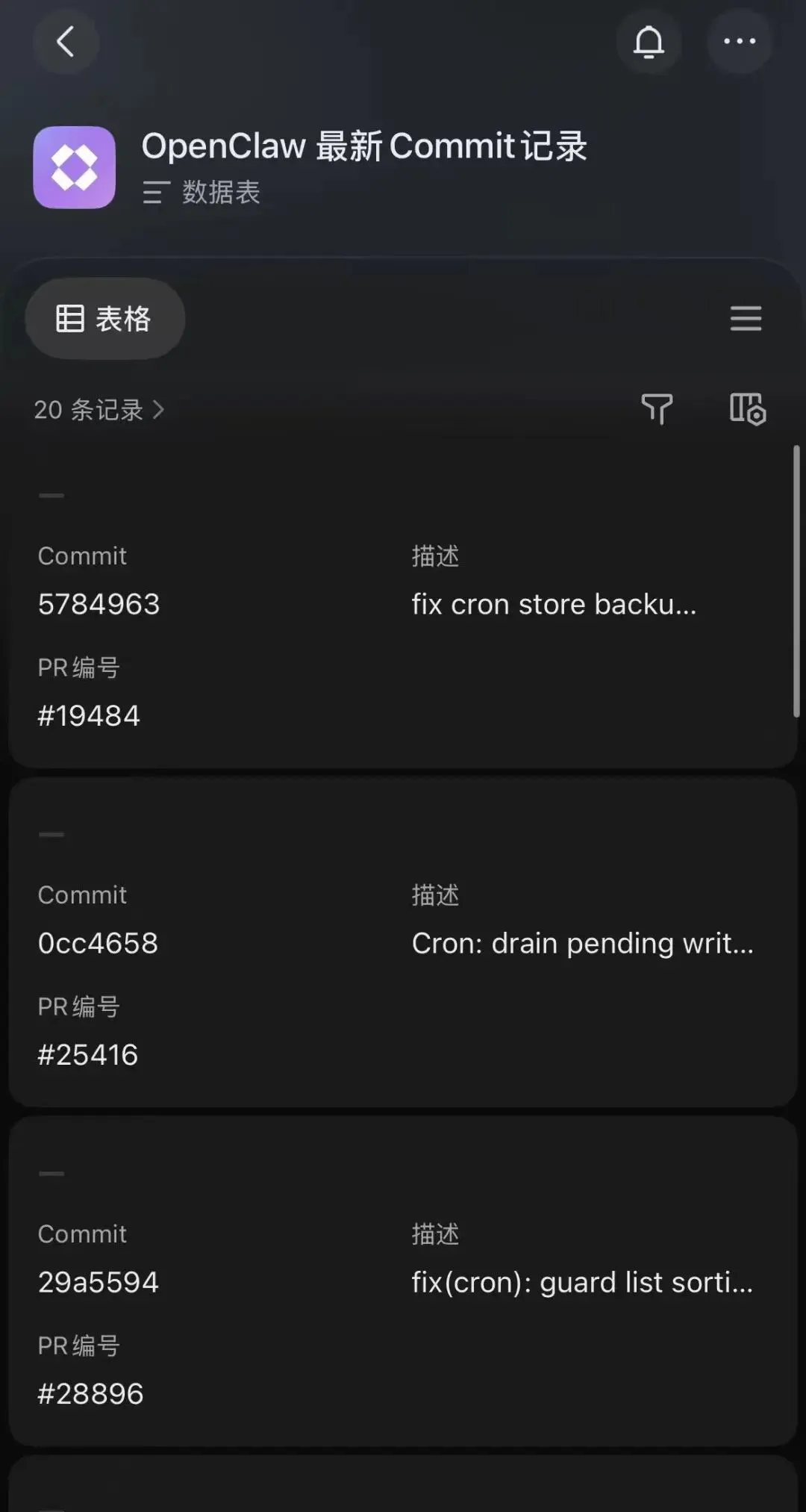

case1:我让它帮我从github拉取OpenClaw最新的代码,并整理commit记录

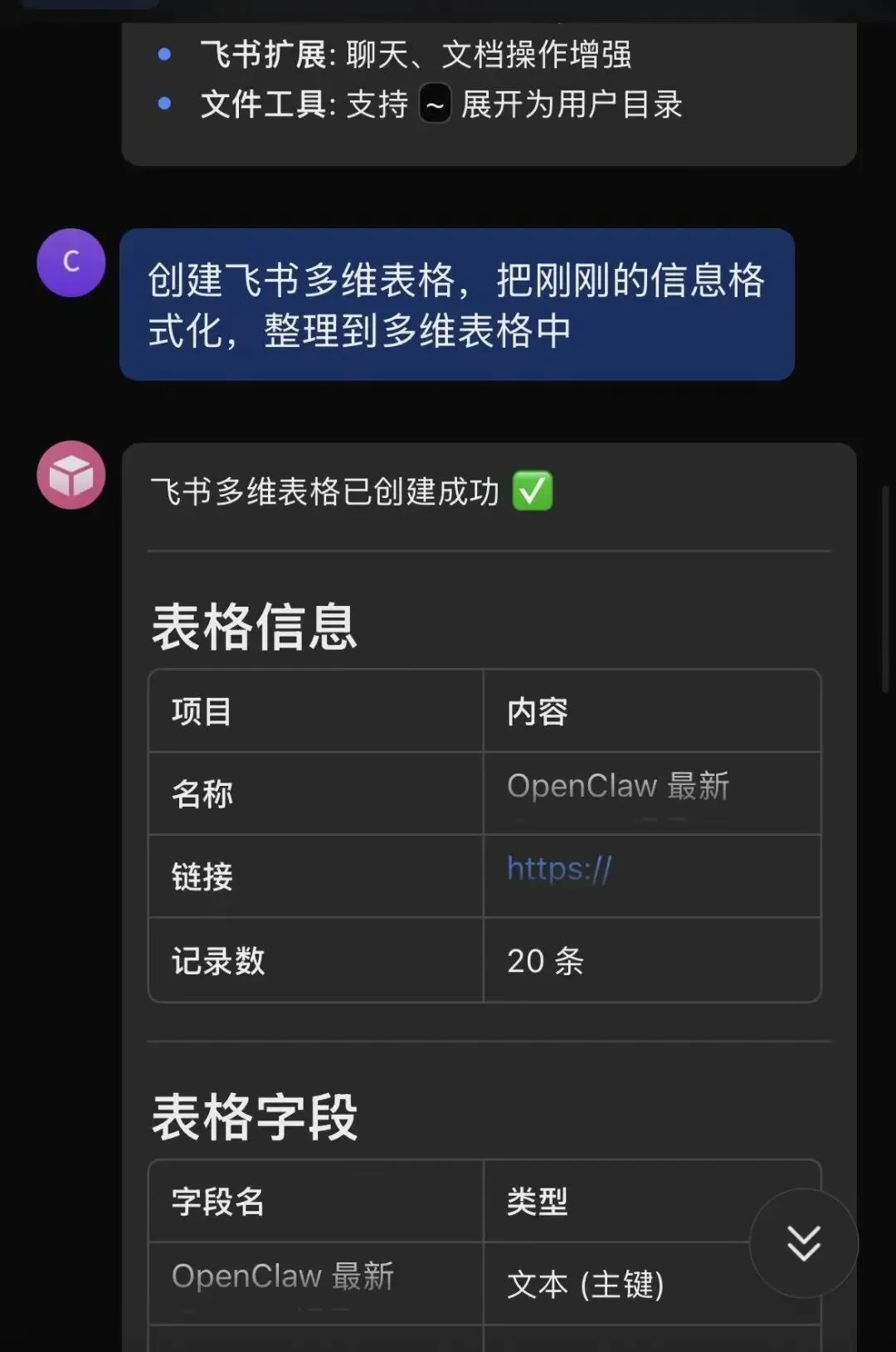

case2:创建飞书多维表格,把刚刚的记录格式化放进去

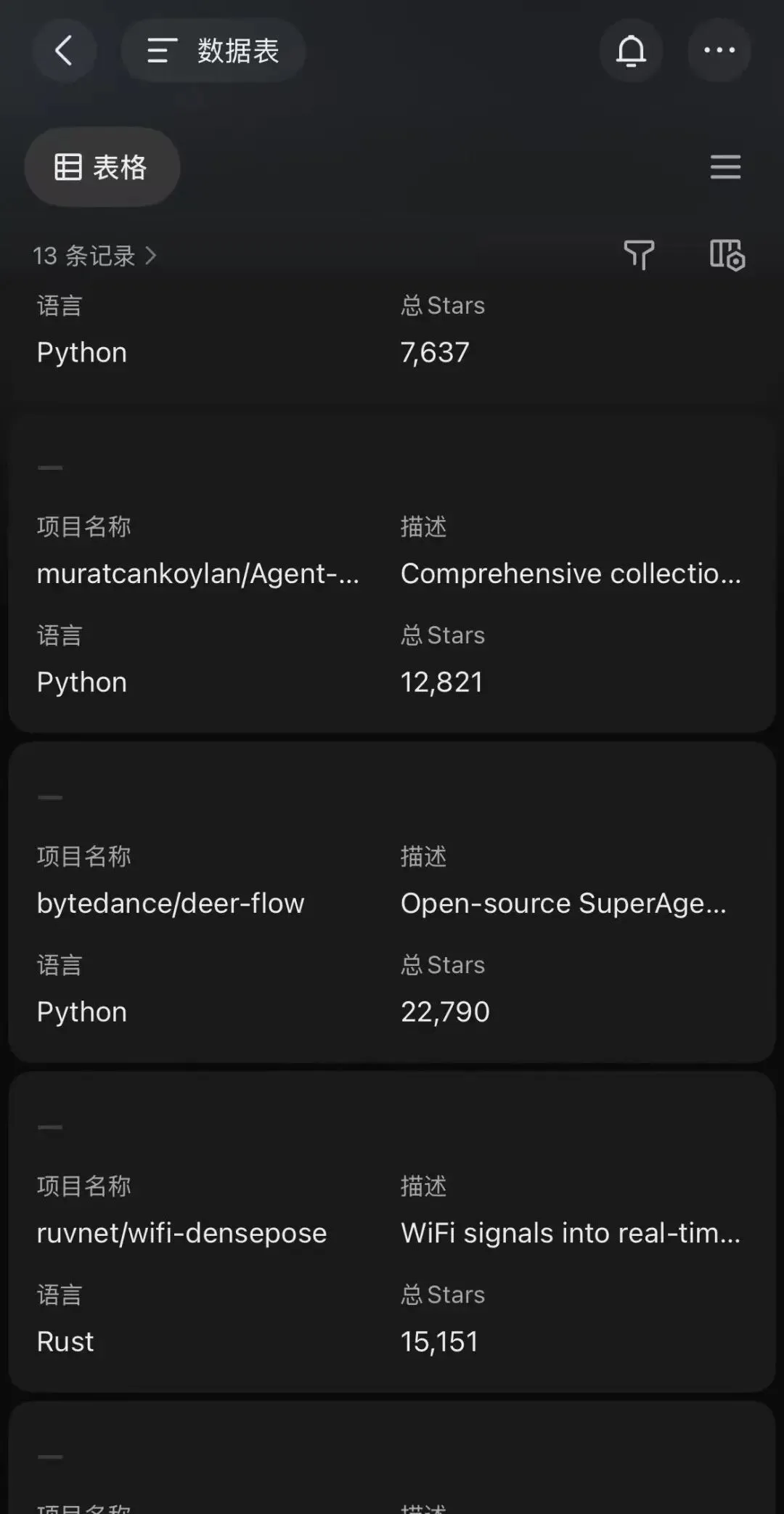

case3:创建飞书多维表格,把刚刚的记录格式化放进去

这3个case不算复杂,也不算简单,小龙虾🦞的处理结果让我非常满意,确实有点东西!

如果我们的需求足够明确,接入的模型能力足够强大,有合适的Skills底座作为支撑,我们随时随地使用app给他发一条指令,他就能默默地帮我们咔咔咔一顿输出,在一定程度上真的可以解放我们的劳动力,对于爱折腾的小伙伴,通过手机也能使用随时随地vibe coding。

写到最后

从部署OpenClaw到接入飞书,实际上步骤不算复杂,体验相对比较丝滑,整套流程下来,半小时内就能搞定。

最后说明一下:源码部署的方式可能对开发者更友好,并不适用于所有人,大家按需去选择部署方式。另外,由于🦞运行权限较高,在自己电脑上搭建还是有一定风险,需要做好安全评估后再玩!

我现在终于体会到Mac Mini当初涨价、卖断货的原因了!

感兴趣的小伙伴,赶紧尝试一波吧!

官网:https://openclaw.ai

github:https://github.com/openclaw/openclaw

文档中心:https://docs.openclaw.ai/zh-CN

中文社区:https://www.openclawcn.cc

最后,感谢大家的持续关注,一起探索好玩的开源技术!

夜雨聆风

夜雨聆风