文档多模态RAG思路MoDora及多摸态预训练的两个影响因素探究

今天是2026年3月6日,星期五,北京,天气晴

来看多模态RAG进展,文档多模态问答思路MoDora。

另一个是多摸态预训练的影响探究,两个探究性结论。

多看,多思考,会有收获。

一、多摸态预训练的两个影响因素探究

来看经验,《Beyond Language Modeling: An Exploration of Multimodal Pretraining》(https://arxiv.org/abs/2603.03276),探究了视觉表征、数据构成等关键维度对多模态预训练的影响。看亮点

1、视觉表征影响

对比了VAE(SD-VAE/FLUX.1)、语义编码器(RAE,如SigLIP2/DINOv2)、原始像素三类视觉表征,核心发现:

首先,RAE(SigLIP2)性能最优,在视觉理解(VQA)和生成(DPGBench/GenEval)上均超越VAE,且保持与纯文本基线相当的文本困惑度,实现单编码器兼顾两大任务,简化模型设计;

其次,原始像素有潜力,VQA性能与RAE差距较小,仅生成质量偏低,是未来研究的重要方向;

最后,VAE存在局限,低维潜空间导致视觉理解能力弱,且缩放时损失易饱和,不如RAE适配多模态缩放。

2、不同数据混合对模型性能的影响

不同数据混合物对模型性能的影响,核心结论如下:

首先,视觉数据不干扰语言性能。纯视频数据与语言建模兼容,甚至能降低文本困惑度;图文对导致的文本性能下降源于文本分布偏移,非视觉模态本身;

其次,图文对是视觉能力的核心,无图文对则模型无视觉生成/理解能力,不同图文源(MetaCLIP/Shutterstock)有互补性,组合使用可兼顾文本性能和视觉能力。

最后,多模态共训练产生强协同效应。语言对视觉有增益:文本令牌能提升视觉生成质量,因生成任务为文本条件;泛化预训练优于专属数据缩放:20BVQA数据+80B通用多模态数据,VQA准确率超100B纯VQA数据模型,提升约3-4个百分点;多模态预训练后,VQA性能较纯文本预训练模型提升5-10个百分点(不同编码器)。

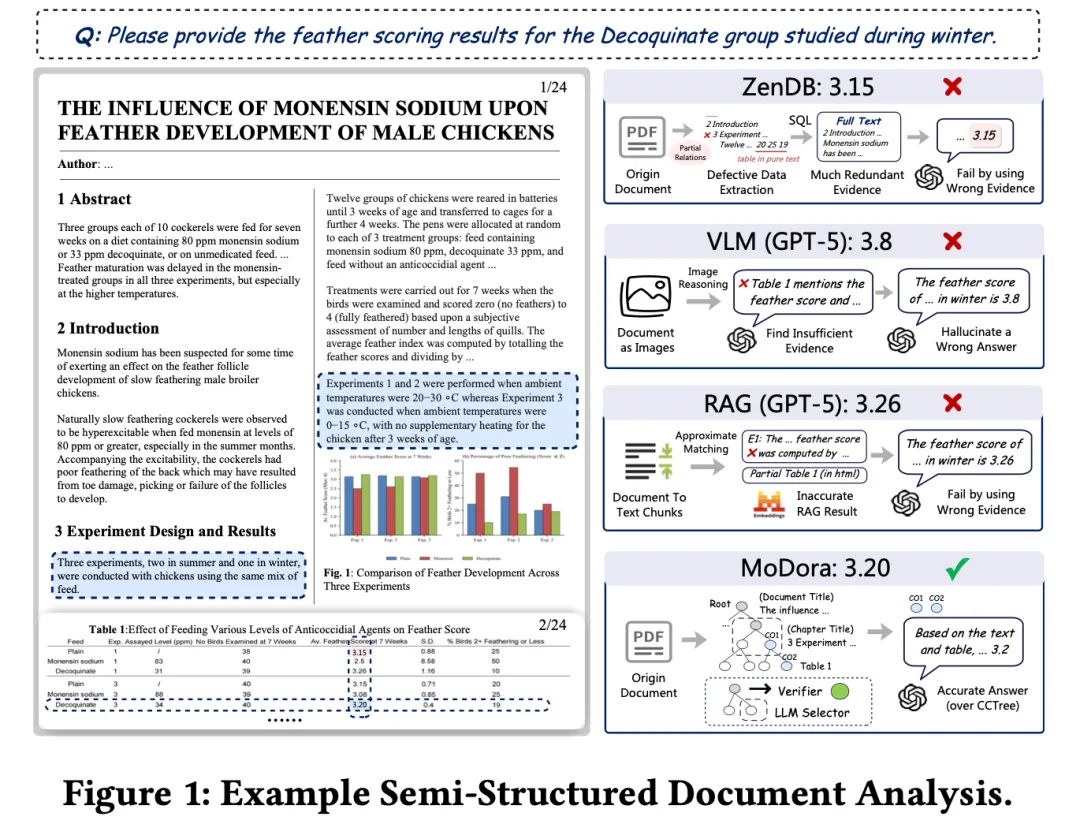

二、文档多模态RAG问答思路MoDora

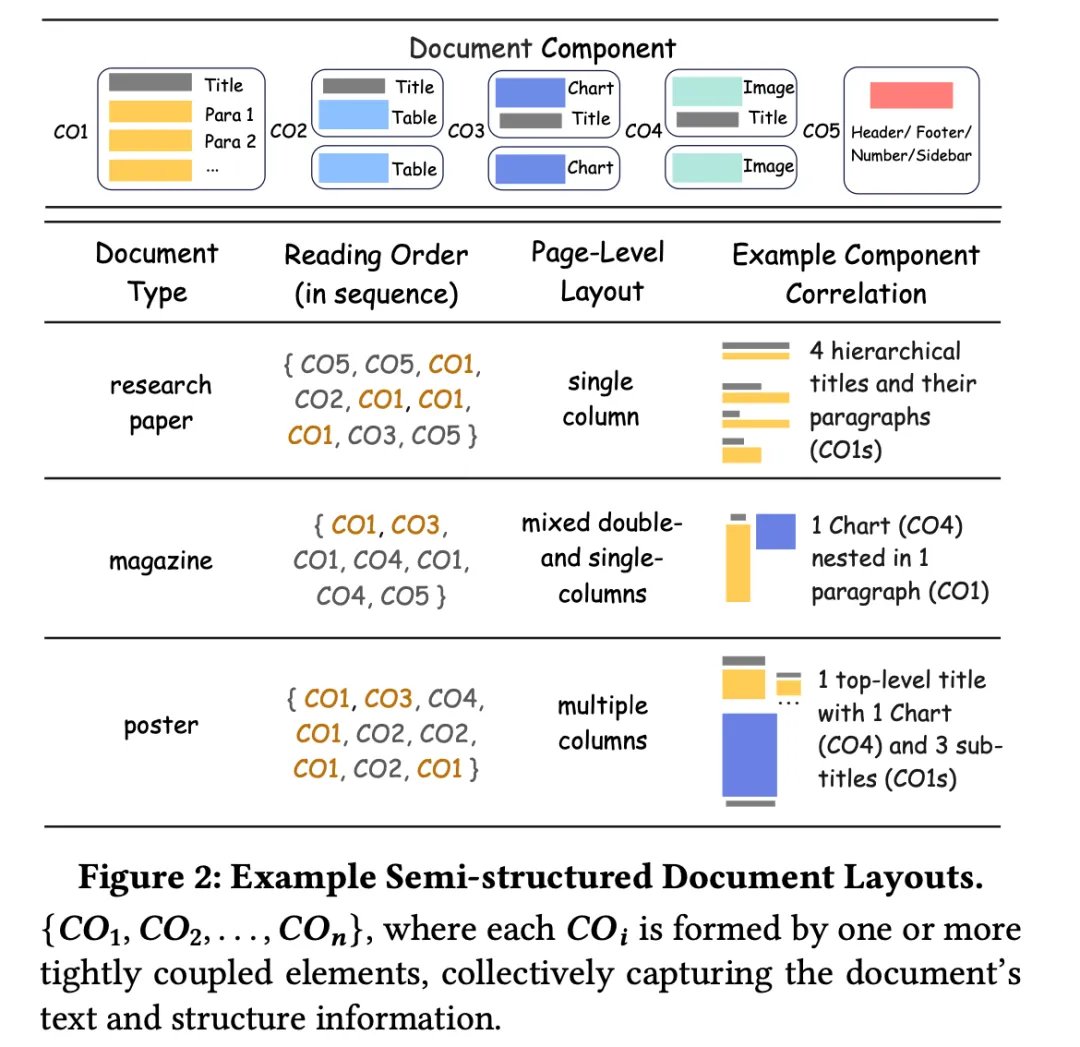

来看文档多模态问答进展,讲的是基于树结构的半结构化文档分析思路。

所谓的半结构化文档,几个特征:融合表格、图表、层级段落等多类元素,布局不规则,广泛应用于科研报告、财务报表等领域,超77%的真实文档包含表格/图表/段落标题,61%含表格、40%含图表。

然后现有方案如内容容提取法丢失结构信息、结构提取法缺乏细粒度建模、端到端模型易忽略布局关系、RAG方法存在证据错位等,所以搞个新方案。

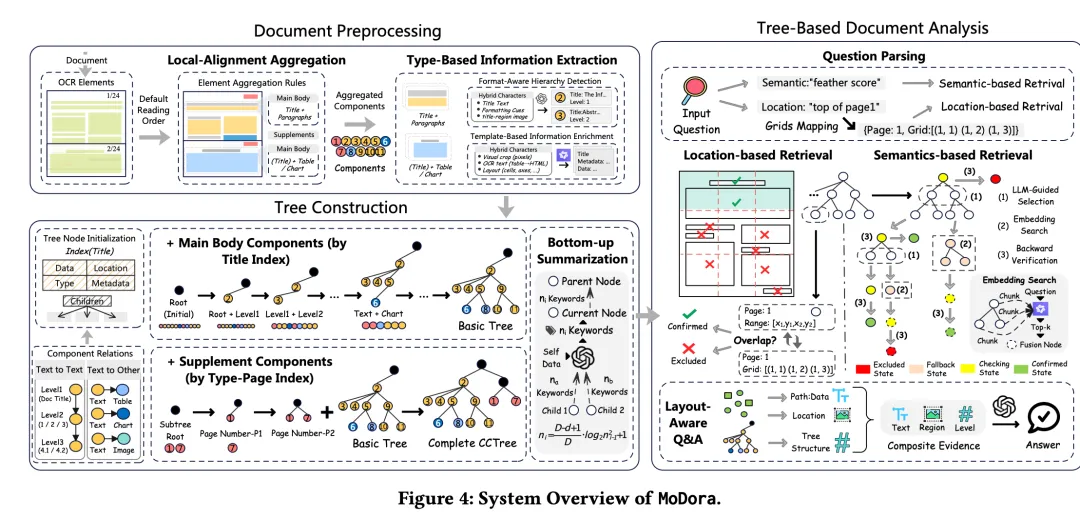

《MoDora: Tree-Based Semi-Structured Document Analysis System》,https://arxiv.org/pdf/2602.23061,https://github.com/weAIDB/MoDora,核心思路包括文档档预处理、树构建、基于树的文档分析几个部分。

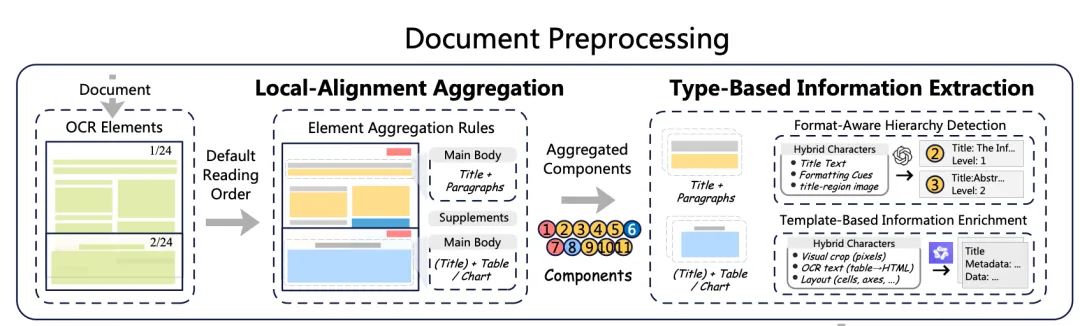

1、文档预处理

将原始输出转化为结构化组件。

有以下几个点:

一个是局部对齐聚合策略:通过文本、表格/图表、补充元素三类聚合规则,将OCR元素分组为布局感知组件;

一个是格式感知层级检测:结合标题文本与视觉特征,通过MLLM识别标题层级,确定组件的嵌套关系;

一个是模板化信息富集:为表格/图表等非文本组件生成(title,metadata,data)语义三元组,补充属性信息;

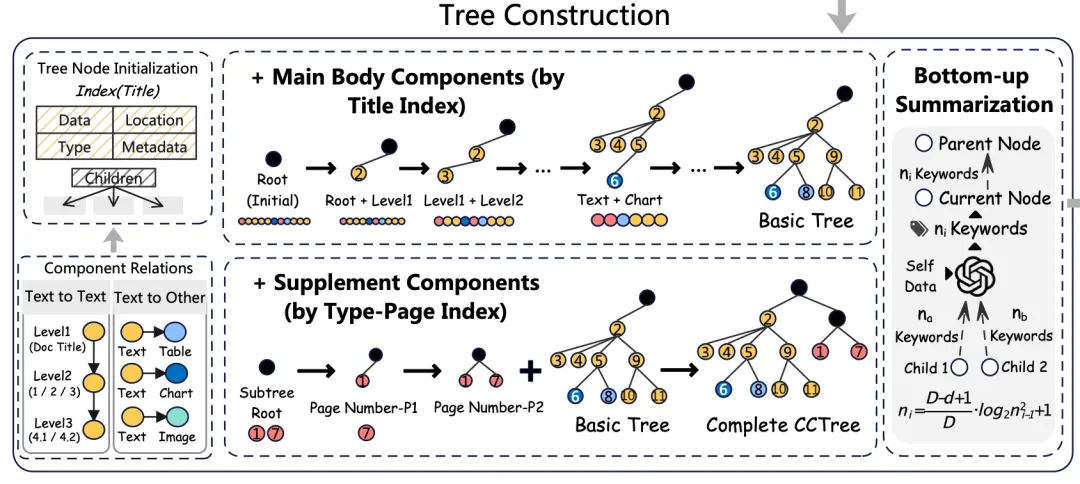

2、组件关联树(CCTree)构建

这一步实现文档的层级化表示,捕捉组件间关系与布局差异,核心是这棵树的设计:节点代表文档组件,扩展唯一索引和子节点属性;边代表三类组件关系(文本-文本、文本-非文本、独立补充元素);

构建方式上, 包括两阶段:

先基于阅读顺序、标题层级构建主内容分支,再将补充元素作为独立分支挂载至虚拟根节点;

然后进行自底向上元数据总结,从叶节点开始,通过信息衰减公式生成节点元数据(关键词)并向上传播;

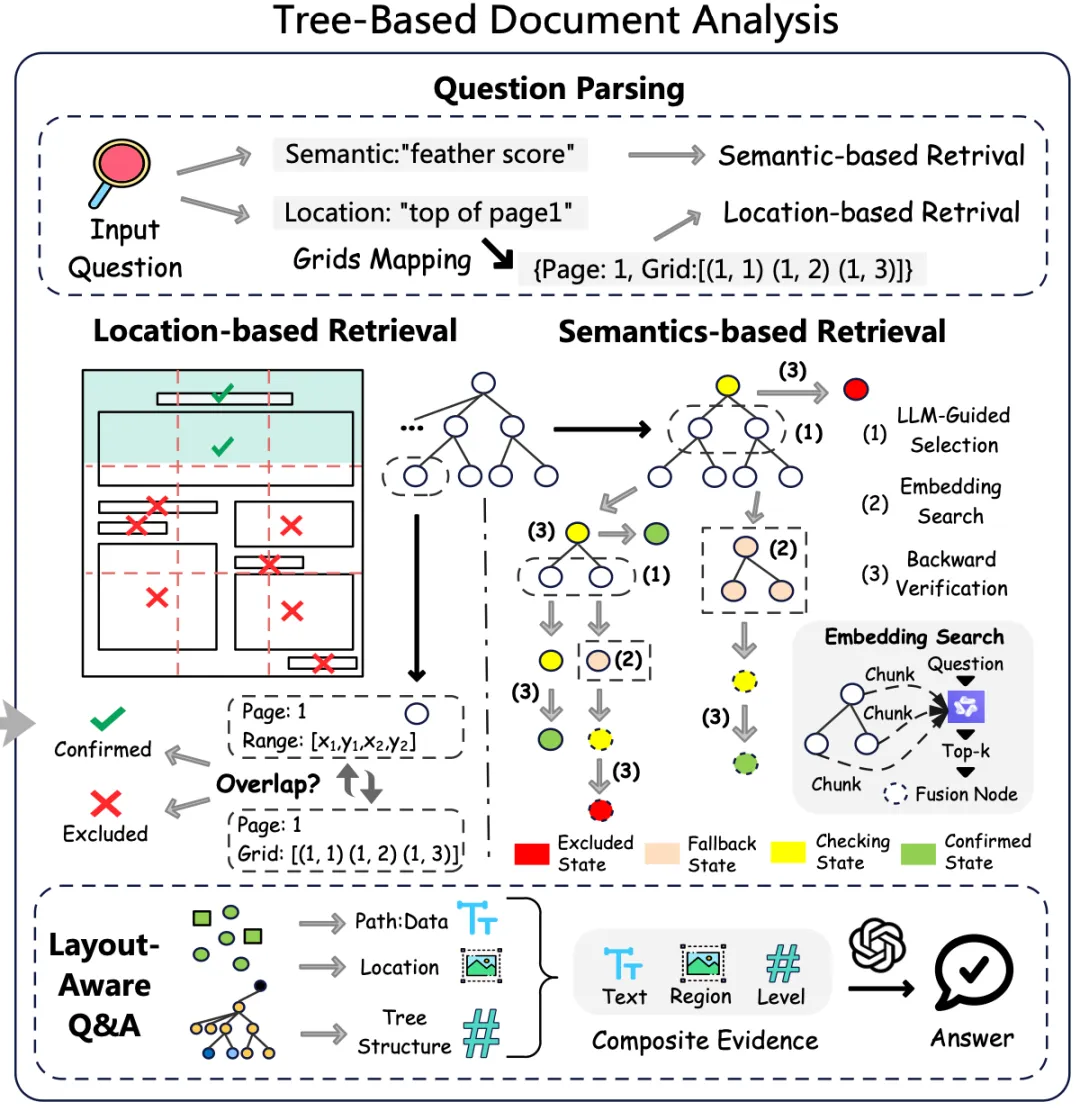

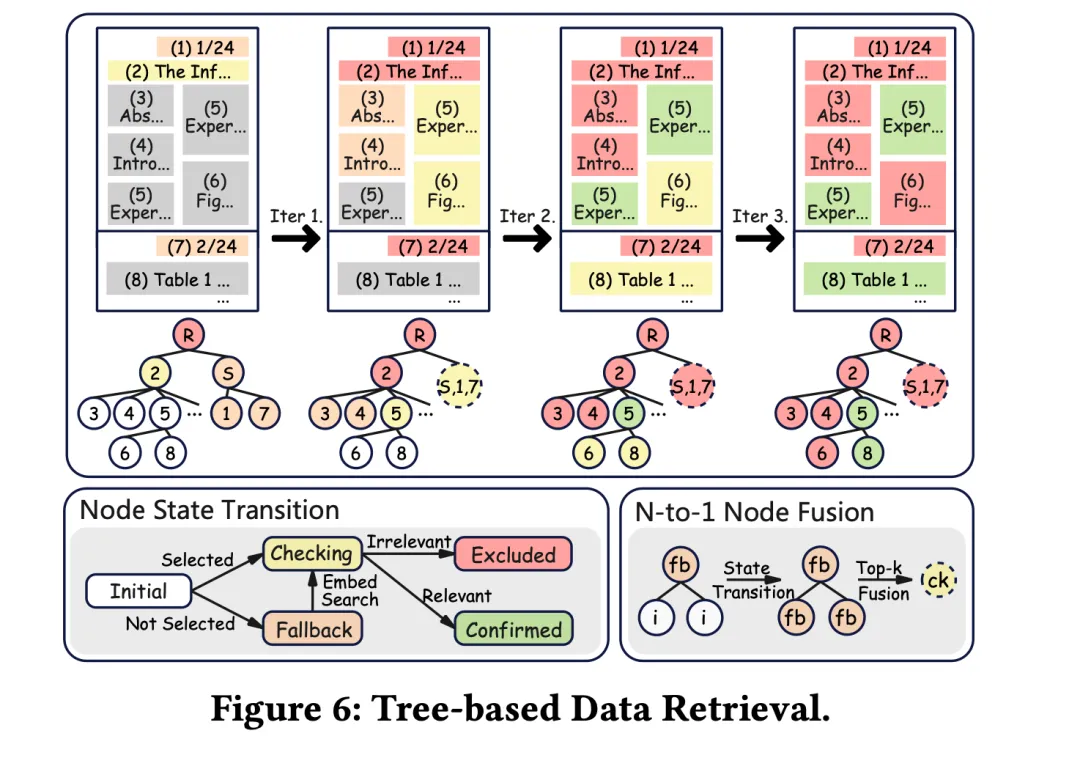

3、基于树结构的文档问答

这一步是基于CCTree做问题类型感知检索与答案生成,具体的:

首先,进行问题解析,提取问题中的语义、位置线索,确定检索类型;

其次,进行双检索,位置类问题采用3×3网格划分匹配组件空间位置,语义类问题采用LLM引导选择+嵌入搜索回退+MLLM反向验证的迭代检索,如下图:

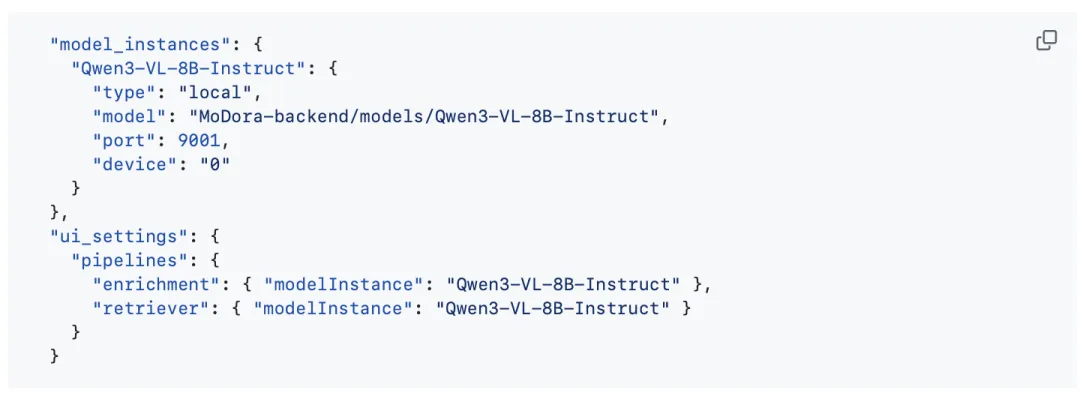

其中:模型使用Qwen3-VL-8B-instruct。

最后是证据聚合与答案生成,整合文本证据、位置证据、层级信息,输入MLLM生成最终答案。

参考文献

1、https://arxiv.org/pdf/2602.23061

2、https://arxiv.org/abs/2603.03276

关于我们

老刘,NLP开源爱好者与践行者,主页:https://liuhuanyong.github.io。

对大模型&知识图谱&RAG&文档理解感兴趣,并对每日早报、老刘说NLP历史线上分享、心得交流等感兴趣的,欢迎加入社区,社区持续纳新。

加入社区方式:关注公众号,在后台菜单栏中点击会员社区加入。

夜雨聆风

夜雨聆风