黄仁勋GTC演讲:AI正在从"工具"进化为"基础设施"(一场关于计算范式根本转移的宣言)

3月16日至19日,英伟达GTC 2026大会在美国加州圣何塞召开,作为全球AI算力领域的“风向标”,本次大会备受市场瞩目。其中NVIDIA CEO黄仁勋在GTC 2026的主题演讲,不仅仅是一场产品发布会,而是一份关于AI时代计算架构根本转移的”技术宣言”。在这场长达两小时的演讲中,他反复传递一个核心信息:AI不再是某个应用的功能,而是像电力一样的基础设施。根据他的演讲核心内容我们做了一些整理和编辑呈现给大家:

一、AI的三次跃迁:从感知到智能体再到物理世界

黄仁勋将AI的发展划分为清晰的三个阶段:

第一阶段:感知AI

计算机视觉、语音识别——AI学会”看懂”和”听懂”。

第二阶段:生成式AI

过去五年,AI学会了模态转换:文本生成图像、文字生成视频、氨基酸预测蛋白质结构。这彻底改变了计算范式——从”检索计算”转向”生成计算”。我们不再存储预设答案,而是让AI实时生成答案。

第三阶段:智能体AI与物理AI(正在发生)

这是演讲的重中之重。黄仁勋用两个词概括了AI的下一步:

• Agentic AI(智能体AI):AI获得”自主能力”——它能感知环境、推理问题、规划行动、使用工具。它可以浏览网站、观看视频、理解上下文,然后自主完成任务。

• Physical AI(物理AI):AI理解物理世界——摩擦、惯性、因果关系、物体恒存。这是机器人技术爆发的关键前提。

核心洞察:每一次跃迁都带来100倍的计算需求增长。黄仁勋直言:”去年这个时候,我们低估了AI所需的计算量——实际上需要100倍。”

二、推理:AI的”终极计算挑战”

演讲中最技术性的部分,也是最关键的洞察,是关于推理(Inference)的重新定义。

传统观念认为,AI的训练最消耗算力。但黄仁勋指出:推理正在成为计算的最大挑战。

为什么推理如此困难?

现代AI(如DeepSeek-R1)使用”思维链”(Chain of Thought)技术:

• 不再是”一次性给出答案”

• 而是逐步推理——拆解问题、多路径探索、自我验证、一致性检查

• 这个过程可能产生数千甚至上万倍的token

黄仁勋举了一个例子:安排婚礼座位这种需要权衡多方约束的问题,传统模型用439个token快速给出错误答案;而推理模型用8000多个token深思熟虑后给出正确答案。

关键公式:10倍token × 10倍速度 = 100倍计算需求

这意味着什么?意味着AI基础设施必须彻底重构。

三、从数据中心到”AI工厂”

黄仁勋提出了一个重新定义行业的概念:AI工厂(AI Factory)。

传统数据中心是”文件检索中心”——存储数据,按需调取。而AI工厂是”token生成器”——它的唯一任务是生成智能(token),然后将其重构为音乐、文字、代码、科学研究或化学分子。

AI工厂的核心指标

黄仁勋用一张曲线图解释了AI工厂的设计哲学:

• X轴:每个用户的响应速度(token/秒)——决定AI的”聪明程度”

• Y轴:整个工厂的吞吐量(token/秒)——决定收入规模

• 目标:在右上角最大化”曲线下面积”

这是一个根本性的张力:你要让AI更聪明(生成更多token),又要让它足够快(用户有耐心等)。解决这个问题的唯一方法是极致的算力密度。

四、技术架构的革命:纵向扩展先于横向扩展

为了实现AI工厂,NVIDIA正在推动一场硬件架构的革命。

1. 从风冷到液冷

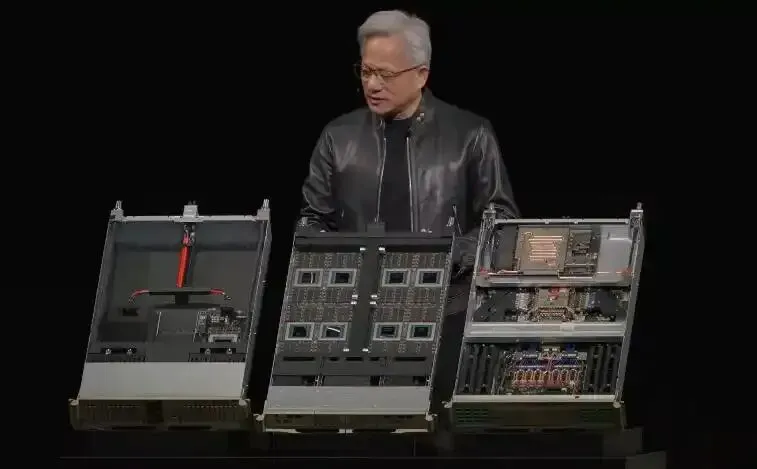

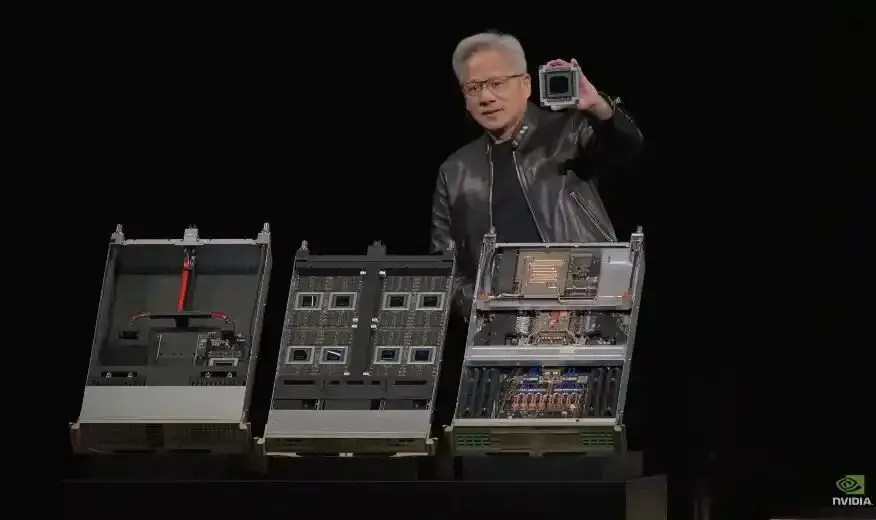

Blackwell NVLink72机架是全球首个单架百亿亿次(Exaflops)计算机:

• 60万个组件,3000磅重,2英里长的电缆

• 120千瓦功率,完全液冷

• 相当于20辆汽车的零件集成在一台机器中

2. 从横向扩展到纵向扩展

传统云计算强调”横向扩展”——用大量廉价机器分布式处理。但AI需要先”纵向扩展”(scale-up)——把更多算力压缩到最小空间,然后再横向扩展。

Blackwell相比上一代Hopper,在同等功耗下性能提升25倍。

3. Vera Rubin路线图

黄仁勋罕见地公布了未来三年的路线图:

• 2025下半年:Blackwell Ultra(1.5倍性能提升)

• 2026下半年:Vera Rubin(全新CPU、GPU、HBM4内存、NVLink 144)

• 2027下半年:Vera Rubin Ultra(NVLink 576,15百亿亿次,600千瓦/机架)

“每年一次架构升级,每两年一次新产品线。这是时钟滴答般的节奏。”

五、硅光子:破解百万GPU互联的物理极限

当数据中心规模扩展到百万级GPU时,传统电气互联遇到了物理极限。

黄仁勋展示了NVIDIA的硅光子(Silicon Photonics)突破——全球首个1.6Tbps共封装光器件(CPO):

• 问题:传统光收发器每个消耗30瓦,百万GPU需要600万个收发器,仅收发器就耗电180兆瓦

• 解决方案:微环谐振器调制器(MRM)技术,将激光器直接集成到芯片上

• 结果:节省的电力相当于100个Rubin Ultra机架的算力

这项技术让NVIDIA能够将数据中心从”体育场规模”扩展到”城市规模”。

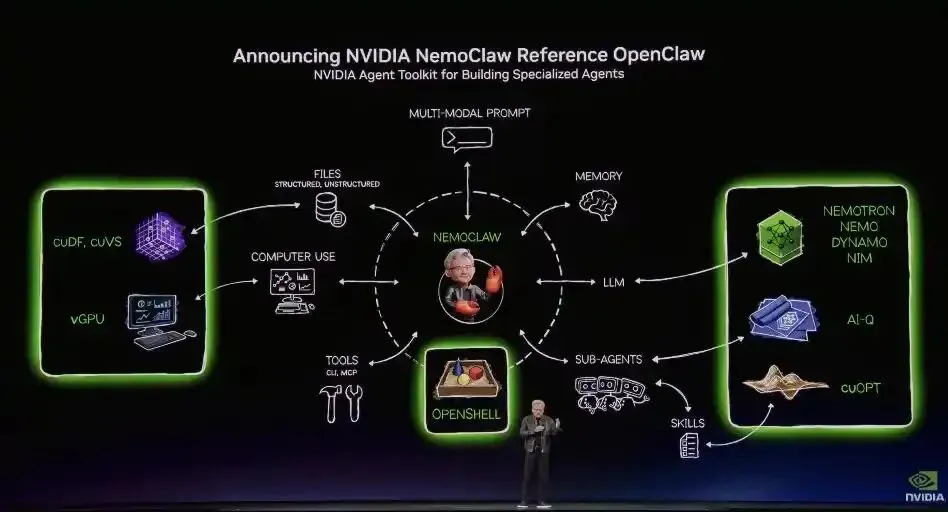

六、开源战略:构建AI生态的护城河

演讲中最令人意外的部分,是NVIDIA的开源决心。

Dynamo:AI工厂的”操作系统”

这是一个开源软件层,负责管理:

• 张量并行、管道并行、专家并行

• 预填充与解码的动态解耦

• KV缓存的智能路由

黄仁勋称其为”AI工厂的操作系统”,类比VMware之于传统数据中心。

GR00T N1:开源人形机器人基础模型

这是另一个重磅开源——一个通用的人形机器人基础模型,采用”快慢双系统”架构(类似人类认知),能够理解物理世界并执行复杂任务。

战略意图:NVIDIA不只想卖芯片,它想成为AI时代的”基础设施提供商”。

七、机器人:AI的终极落地场景

黄仁勋对机器人技术的预测最为激进:

“到本十年末,世界将短缺5000万工人。我们可能需要付给机器人每年5万美元来工作——这将成为历史上最大的产业之一。”

NVIDIA的三台计算机理论:

1. 训练计算机:在数据中心训练AI模型

2. 仿真计算机(Omniverse):在虚拟世界中生成无限训练数据

3. 机器人计算机:在真实世界中运行

通过Newton物理引擎(与DeepMind、迪士尼合作开发),机器人可以在超实时仿真中学习触觉反馈、精细动作和执行器控制。

—-

八、企业AI:每个公司都需要”AI工厂”

黄仁勋没有忽视企业市场。他宣布了一系列针对企业的产品:

• DGX Station:2000万亿次浮点运算的桌面AI工作站

• AI存储革命:从”检索式存储”转向”语义式存储”——你不再搜索文件,而是直接问问题

• 开源企业模型:完全开源、可本地部署的推理模型

“未来将有10亿知识工作者,还会有100亿数字员工与他们并肩工作。”

结语:为什么这次演讲重要?

黄仁勋的GTC演讲传递了三个不可回避的趋势:

1. 计算需求没有天花板:AI越智能,需要的算力呈指数级增长。这不是泡沫,而是结构性趋势。

2. 基础设施必须重构:从芯片到网络,从存储到冷却,整个数据中心正在围绕AI重新设计。

3. AI正在物理化:从数字世界走向物理世界,机器人将成为AI最大的落地场景。

正如黄仁勋所言:

“AI不再是一次性的突破或应用——它是基础设施。每家公司都会使用它。每个国家都会建造它。”

这不仅是NVIDIA的愿景,也是整个技术行业的未来十年蓝图。

(郭博士团队根据黄仁勋讲话编撰整理)

夜雨聆风

夜雨聆风