豆包手机向左,OpenClaw向上:AI助手权限模型的两条分岔路径

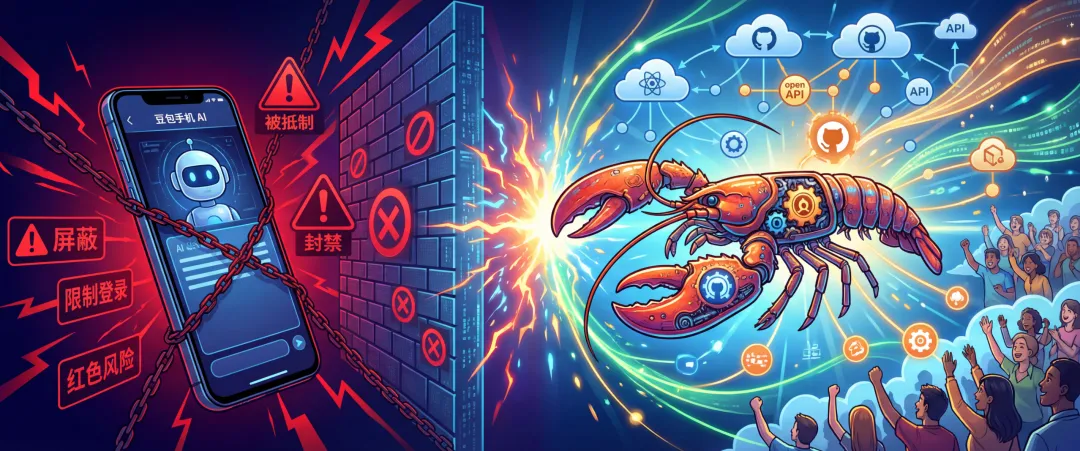

最近一段时间,AI助手赛道出现了一个值得深究的对照:豆包手机与OpenClaw。前者一度被视为AI进入终端设备、系统级交互的重要尝试,后者则以近乎意外的速度从开发者社区升温到大众舆论场。表面上看,它们都在让AI走出对话框,走向真实任务与真实操作。但如果从安全架构的角度审视,就会发现一个更本质的分野:它们选择了完全相反的权限模型。

豆包手机试图构建一个系统级可信代理(Trusted System Agent),OpenClaw则走向了用户侧自主部署(User-ControlledDeployment)。前者的安全挑战是”如何让一个中心化代理值得信任”,后者的挑战则是”如何让分散的部署不失控”。一个向左遭遇围堵,一个向上获得追捧,背后不只是市场情绪,更是两种权限治理模式在现实中的第一次碰撞。

01 豆包的困境

系统级代理的权限悖论

1.1 它要的不是”多一个应用”,而是”跨应用的特权层”

豆包手机的核心能力,依赖于一个在传统移动安全模型中本不应存在的角色:跨应用权限协调者(Cross-App Permission Orchestrator)。

传统Android/iOS的安全模型是沙箱隔离:每个App只能访问自己的数据空间,跨应用交互需要明确的用户授权(如分享照片时需要手动选择接收App)。这种设计虽然繁琐,但有一个关键优势:权限授予是显式的、一次性的、可撤销的。

而豆包手机要实现”帮我订明天去上海的机票”,需要串联:

-

日历App(读取行程)

-

航司/OTA App(查询+下单)

-

支付App(触发交易)

-

短信/邮箱(接收验证码)

这条链路上,每一跳都是潜在攻击面。更关键的问题是:这种跨应用协调能力,无法用现有的权限模型表达。

你不能让用户每次都弹窗确认——那和直接用App没区别;但如果AI拥有”一次授权、长期有效”的跨应用权限,就等于在沙箱之上又造了一层超级权限层(Superuser Layer)。这一层一旦被攻破(通过prompt injection、越狱、供应链污染等手段),后果远超单个App被攻击。

1.2 技术上的三个未解难题

难题1:细粒度权限控制的计算成本

理想情况下,AI每次操作都应该经过一个细粒度的权限检查:

-

“读取日历”→ 允许读取未来7天的工作相关事件,但不能读取私人标记的事件

-

“调用支付”→ 单次限额500元,且必须在用户可见的情况下执行

但这种策略的表达、验证和执行,都需要一个运行时权限策略引擎(Runtime Policy Engine)。问题在于:

-

如何用自然语言定义策略?(用户不会写ACL规则)

-

如何让AI理解策略约束?(LLM不是形式化系统)

-

如何在性能开销和安全性之间平衡?(每次调用都做策略匹配会拖慢响应)

目前没有成熟方案。

难题2:AI决策的不可预测性

传统软件的权限检查是静态的:代码在编译时就确定了会调用哪些API。但AI代理是动态的:同样的用户输入,在不同上下文、不同模型版本、甚至不同的随机种子下,可能走出完全不同的执行路径。这意味着:

-

无法做静态分析(你不知道它会调什么)

-

难以做异常检测(什么算”异常行为”?)

-

追溯困难(同样的prompt下次可能走不同的路径)

难题3:责任归属的技术化难题

当AI误操作导致资损,技术上需要回答:

-

是模型的推理错误(幻觉、上下文污染)?

-

是用户输入的歧义(prompt表达不清)?

-

是外部API的返回异常?

-

是恶意攻击者通过注入绕过了检查?

这需要一个完整的可观测性体系(Observability Stack):

-

Prompt的完整上下文(包括系统指令、历史对话、工具调用记录)

-

每一步推理的中间结果(模型内部状态)

-

每一次外部调用的请求/响应

-

策略检查的通过/拒绝日志

但这套体系目前在手机上根本不存在。

1.3 为什么平台会警觉?

从平台视角看,豆包手机不只是”功能创新”,而是在重新定义权限层级:

传统模型:

用户 → App → 系统API → 硬件/数据豆包模型:

用户 → AI代理 → App → 系统API → 硬件/数据AI代理成了新的控制平面(Control Plane)。问题在于:

-

它能看到所有App的行为(观测能力)

-

它能代替用户操作所有App(执行能力)

-

它的决策逻辑不透明(黑盒性)

从安全威胁建模看,这是一个单点失效风险点(Single Point of Failure):

-

如果AI被绕过(jailbreak),所有App的权限都暴露

-

如果AI被污染(供应链攻击),所有用户数据都可能泄露

-

如果AI被滥用(厂商作恶),监管和审计都难以介入

豆包手机遭遇的不是”产品不好”,而是它要求整个生态为一个新的权限层级让路,但这个层级的安全性尚未被证明。

02 OpenClaw的巧妙

把权限治理”下放”

2.1 架构上的关键差异

OpenClaw不是”手机里的AI”,而是”你自己部署的AI工具箱”。这个差异带来了完全不同的权限模型:

豆包模型:

厂商 → 系统级代理 → 用户设备上的所有App权限集中在厂商可控的代理上,用户只能”信任或不信任”。

OpenClaw模型:

用户 → 自己部署的Agent → 用户自己配置的工具/API权限分散在每个用户的部署实例中,厂商/社区不掌握实际执行权限。

这种差异带来三个关键后果:

后果1:攻击面分散化

豆包手机是集中式风险点:所有用户的AI跑在同一套系统上,一个通用的jailbreak prompt可以影响所有用户,供应链攻击一旦得手,影响是全量的。

OpenClaw是分布式风险:每个用户/企业自己部署,攻破一个实例只影响那个环境,没有”一次攻击、全局影响”的可能

从威胁建模角度,这相当于把一个高价值目标(High-Value Target)拆成了无数个低价值目标(Low-Value Targets)。对攻击者而言,ROI大幅下降。

后果2:责任边界前置化

豆包手机的用户协议再怎么写,用户也会觉得:”这是你的系统,出了问题你得负责。”

OpenClaw的开源协议直接写明:”按现状提供,不提供任何保证。”用户在部署前就知道:风险自担。

这不是甩锅,而是一种风险认知的社会契约重构。当用户知道自己在”DIY一个工具”时,心理预期和责任归属都更清晰。

后果3:权限粒度可自定义

豆包手机的权限策略是厂商预设的,用户只能接受或拒绝。OpenClaw的权限策略是用户自己配置的:

-

你可以只让它访问本地文件,不给网络权限

-

你可以只让它调用某几个API,不给支付能力

-

你可以在Docker里跑,隔离宿主机环境

虽然大部分用户不会用好这些能力(甚至会配置不当导致更大风险),但从控制感(Sense of Control)的心理学角度,这种”我可以选择”的感觉至关重要。

2.2 但风险并未消失

必须明确:OpenClaw的安全风险不比豆包手机小,甚至可能更大。只是风险的分布方式不同。OpenClaw面临的真实威胁:

1. 供应链攻击

– 恶意NPM包/Python包

– 被污染的Docker镜像

– 伪造的官方插件

2. 配置错误

– API密钥直接写在配置文件里

– 服务暴露在公网上没做认证

– 权限配置过度开放(给了sudo权限)

3. 本地提权

– Agent进程被劫持

– 日志文件泄露敏感信息

– 临时文件未清理

4. 模型层攻击

– Prompt injection绕过本地策略

– Jailbreak让Agent执行恶意指令

– 数据外泄(用户输入被发送到外部模型)

这些风险一个都不少。但关键在于:出了问题,首先由部署者承担,不会立刻冲击到平台/厂商的核心利益。

从舆论传播的角度,”某用户自己部署的Agent被黑了”和”某大厂的系统级AI失控了”,影响力完全不在一个量级。

03 两条路的技术分野

集中式信任vs分布式自治

如果我们抽象一下,豆包和OpenClaw代表了AI Agent安全治理的两种范式:

3.1 豆包的路:集中式可信代理(CentralizedTrustedAgent)

核心假设:

– 存在一个可信的中心化实体(厂商/平台)

– 这个实体能建立一套安全的权限协调机制

– 用户愿意把跨应用的协调权交给它

技术路径:

– 构建系统级权限中间层

– 建立运行时策略引擎

– 实现细粒度的权限检查和审计

优势:

– 统一的安全标准和防护能力

– 异常行为可以被集中检测

– 出问题可以快速熔断和修复

挑战:

– 如何证明自己值得信任?(技术+治理)

– 如何平衡便利性和安全性?(用户体验)

– 如何应对监管和责任追溯?(法律合规)

3.2 OpenClaw的路:分布式自主部署(DistributedAutonomousDeployment)

核心假设:

– 不存在一个所有人都信任的中心实体

– 用户/组织有能力(或愿意购买服务)自己部署和管理

– 安全责任由部署者自己承担

技术路径:

– 提供可组合的Agent框架

– 提供权限隔离的最佳实践(文档/模板)

– 社区贡献安全工具和检测插件

优势:

– 风险分散,没有系统性单点失效

– 用户有更强的控制感

– 生态参与门槛低,容易形成增量

挑战:

– 大部分用户没有安全运维能力

– 安全水平参差不齐

– 缺乏统一的应急响应机制

3.3 两条路的共同盲区

无论选择哪条路,当前都面临一些技术上尚未解决的共同难题:

1. AI决策的可解释性和可追溯性

– LLM的推理过程是黑盒,出问题时难以复现和定责

2. 跨信任域的权限传递

– 当Agent需要调用外部API时,如何安全地传递凭证?

3. 对抗性输入的防御

– Prompt injection、jailbreak等攻击目前没有根治方案

4. 执行层的沙箱隔离

– 如何在保证功能性的前提下,限制Agent的实际破坏能力?

这些问题,不会因为选择了”集中”或”分布”就自动消失。

04 未来可能的监管路径

随着AI Agent越来越多地”动手干活”,监管不可能一直缺位。从技术实现角度,可能的方向包括:

4.1分级授权制度

参考金融支付的多因素认证:

– 低风险操作(查询信息):AI可以自主执行

– 中风险操作(发送邮件、创建文档):需要用户确认

– 高风险操作(支付、删除数据):必须二次认证(密码/生物识别)

技术实现需要:

– 风险分级标准(需要行业共识)

– 运行时风险评估引擎

– 与系统认证框架的集成

4.2执行层沙箱

借鉴浏览器沙箱的思路:

– AI的操作只能在受限环境中执行

– 关键操作必须通过安全网关(Security Gateway)

– 网关负责日志记录、策略检查和异常熔断

技术实现需要:

– 定义Agent的”系统调用”边界

– 构建高性能的沙箱运行时

– 设计逃逸检测机制

4.3可审计性要求

参考自动驾驶的黑匣子要求:

– AI的每一步决策和操作必须留痕

– 日志格式标准化,可被第三方审计

– 关键事件(支付、删除、授权)必须可回溯

技术实现需要:

– 统一的Agent日志格式(类似OpenTelemetry)

– 隐私保护的日志存储(本地/云端平衡)

– 审计工具链和取证流程

4.4责任保险机制

参考网络安全保险:

– Agent提供商必须购买责任保险

– 保险费率根据安全评估等级确定

– 出险时由保险方先行赔付,再追溯责任

这需要:

– 成熟的AI Agent安全评估标准

– 精算模型(如何定价AI失误的风险?)

– 司法体系对AI责任的明确界定

05 结语

不是路线之争,是治理模式之争

从AI安全的视角看,豆包和OpenClaw的分野,本质是两种权限治理模式的社会实验:

– 豆包代表的是:集中式治理+厂商担保+用户让渡控制权

– OpenClaw代表的是:分布式治理+用户自担风险+保留控制感

前者的问题是:如何让人相信中心化的代理值得信任?

后者的问题是:如何避免分散的部署带来更大的系统性风险?

两条路都不完美。豆包可能会因为”信任门槛过高”而受阻,OpenClaw可能会因为”安全能力不足”而出事。但可以确定的是:

当AI从”建议”走向”执行”,安全不再是锦上添花,而是生死线。

谁先把这条线画清楚——用技术手段、治理规则、法律框架、保险机制的组合拳——谁才可能真正走远。

豆包在左撞墙,OpenClaw向上爬山。但也许过两年,爬山的那位在山顶也会撞上另一堵看不见的墙。那堵墙的名字,可能叫”分布式失控”。

AI Agent的时代才刚刚开始,但安全的账单已经在路上了。

夜雨聆风

夜雨聆风