OpenClaw 记不住事?这个开源插件,想把 AI 的“失忆症”补上

做 AI 项目的人,应该都被同一个问题折磨过。

前面刚讲清楚的约束、设定、接口细节,聊着聊着就没了。你能明显感觉到它不是不会,而是“忘了”。于是你只好再重复一遍。一次两次还行,次数多了真的很烦,尤其你在用 OpenClaw 跑稍微复杂一点的项目时,这种上下文掉线感特别明显。

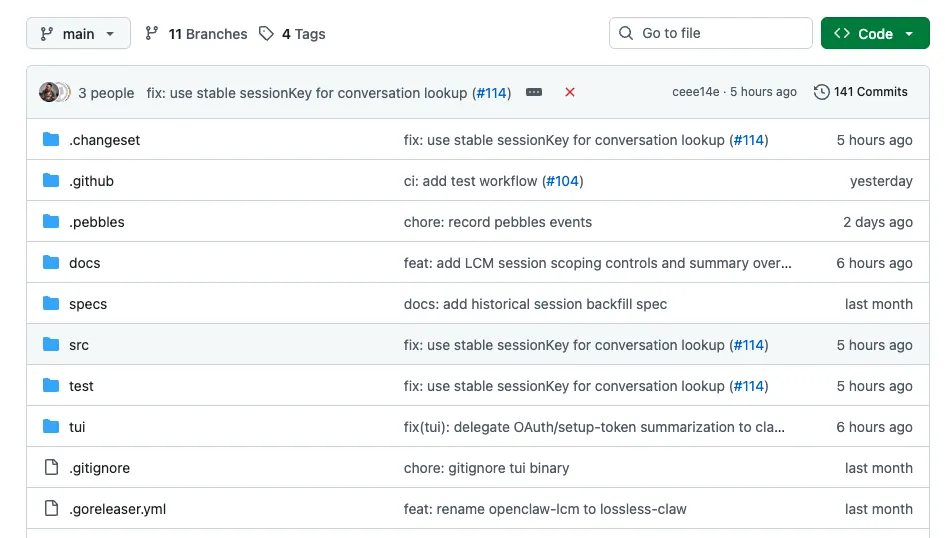

OpenClaw 作者自己也注意到了这个坑,所以现在更推荐配一个开源插件:lossless-claw。它本质上是在给 OpenClaw 补一套“长期记忆系统”。

项目 README 里写得很直白:默认模式下,OpenClaw 会像很多 agent 一样,在上下文快满时不断截断旧消息;而 lossless-claw 做的事,是把每条消息先存进 SQLite,再把旧内容逐层压成摘要节点,最后拼成一个 DAG 结构,需要时再把摘要和最近原始消息一起组回上下文。

这个思路妙的地方,不是“存下来”这么简单。

很多工具也会说自己支持记忆,但最后要么是粗暴截断,要么是做一份很悬浮的总结,真到关键时候还是会漏。lossless-claw 走的是另一条路:原始消息不丢,只是平时先收起来。 摘要节点会一直指回源消息,所以 agent 不只是“记得大概”,而是能在需要时继续往下翻,把细节重新捞出来。

README 里甚至直接给了几把检索工具:lcm_grep、lcm_describe、lcm_expand,就是为了让 AI 在忘词、忘设定、忘某个历史决策时,别靠猜,自己回库里找。

这玩意儿最适合什么场景?

不是那种问一句答一句的轻聊天,而是你已经把 AI 当搭子在用了:写代码、跑 agent、维护一个多轮迭代的需求、长时间讨论产品方案。你会发现,上下文窗口从来都不只是 token 成本问题,它更像一个“合作关系能维持多久”的问题。窗口太短,AI 就总像个刚开完会就失忆的同事。

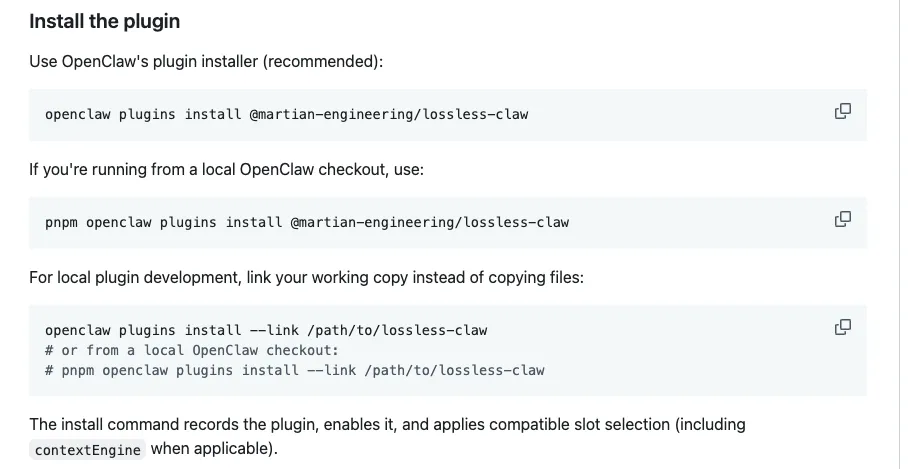

安装倒是很省事。项目给的推荐命令就一条:

openclaw plugins install @martian-engineering/lossless-claw

装完之后,它会接管 OpenClaw 的 context engine。保留多少最近消息、上下文用到多少比例开始压缩,也都能自己配,比如 freshTailCount 和 contextThreshold 这些参数,README 里都有。

我会觉得这个插件值得写,不只是因为它“能装”。

而是它解决的,刚好是现在很多 AI 工具最别扭的地方:能力明明已经够强了,但一旦任务拉长,它又开始像金鱼。你不缺一个更会说的大模型,你缺的是一个别把前情提要弄丢的工作流。

所以,如果你正在用 OpenClaw,或者本来就在折腾多轮 agent 项目,lossless-claw 真的可以试一下。它不是那种看起来很炫的新功能,更像一个你用了之后,才会意识到“这东西早就该有了”的基础补丁。

GitHub地址:martian-engineering/lossless-claw

夜雨聆风

夜雨聆风