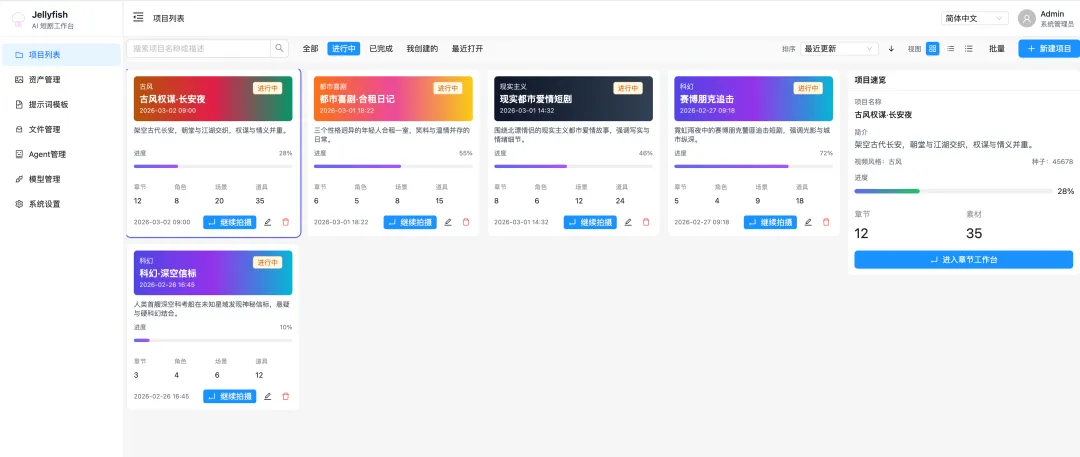

我用这个开源工具,一个人做完了一整部AI短剧

编剧、分镜、生成、剪辑,全流程一个人搞定最近有个开源项目,在AI创作者圈子里悄悄火了。

没有营销,没有包装,但它做了一件事:把原本需要一个团队才能完成的短剧制作,压缩成一个人、一台电脑就能跑的流水线。

如果你在做短视频、AI内容,或者正考虑入局短剧赛道,这篇文章值得你认真看完。

先说一个扎心的现实

做一部短剧,哪怕是最简单的竖屏微短剧,通常需要:

-

编剧(写剧本)

-

分镜师(拆镜头)

-

美术/角色设定(保证统一)

-

视频生成/拍摄

-

剪辑 + 配音 + 后期

但是用AI制作过程中通常会遇到一些问题:一致性崩塌 + 流程割裂

-

AI生成角色“上一秒长这样,下一秒换张脸”

-

场景、道具频繁“漂移”

-

分镜靠人脑,效率极低

-

剪辑与生成完全脱节

而 Jellyfish 的核心价值,可以用一句话概括:

把“短剧制作”从创意工作,变成工程化流程。

Jellyfish到底做了什么?

它不是一个单点工具,而是一个完整生产链路系统。

1、输入剧本 → 自动生成分镜

你只需要提供文本剧本,它会自动完成:

-

场景拆解

-

镜头划分

-

角色出场逻辑

-

画面描述结构化

相当于一个“AI分镜导演”

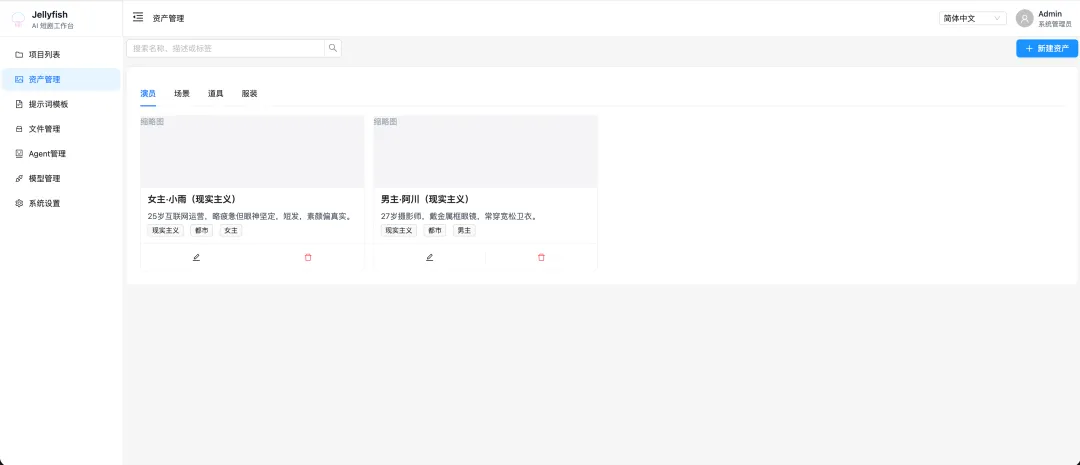

2、强一致性控制(这是核心)

这是目前绝大多数AI工具做不到的:

-

角色外观锁定(脸、服装、风格)

-

场景连续性保持

-

道具不漂移

换句话说:它不是在“生成图片”,而是在“维护一个世界观状态”。这一步,直接解决了AI短剧最大的痛点。

3、一键生成视频

在分镜基础上:

-

自动逐镜头生成画面

-

拼接为视频

-

支持竖屏(适配抖音/视频号)

从“单图AI”跨越到“连续叙事AI”

4、内置多轨剪辑系统

不是简单拼接,而是:

-

多轨道编辑(视频 / 音频 / 字幕)

-

节奏控制

-

可视化调整

它不是工具,而是一个“AI版Premiere + Runway”的融合体

5、一键导出完整短剧

最终你得到的不是素材,而是:

-

成片视频

-

可直接发布

-

完整叙事结构

为什么说它正在改变内容生产?

它改变的不是效率,而是生产关系。

过去:团队 = 内容产能

现在:工具 = 内容产能

这带来三个巨大变化:

(1)创作门槛被大幅拉低

不需要剪辑经验、不需要美术能力、不需要拍摄设备,一个普通人,也能做“连续剧情内容”

(2) 内容生产进入“工业化”阶段

你可以:批量生成短剧、测试多个剧情版本、快速迭代爆款方向,内容开始像代码一样“可编译、可复用”

(3)AI短剧赛道正在加速

参考路径已经很清晰:

-

AI图文 → 爆发(2023)

-

AI视频 → 起飞(2024)

-

AI短剧 → 正在进入爆发期(2025-2026)

而 Jellyfish,正好卡在这个拐点上。

谁最适合用这个工具?

如果你是以下人群,优先级很高:

AI内容创作者:想从“图文”升级到“视频叙事”

短视频运营:需要低成本测试剧情内容

剧本作者:想把文字变成“可视化产品”

独立开发者 / AI玩家:想参与下一波内容红利

它的真正价值,不是工具,而是“范式变化”

很多人看到 Jellyfish,会觉得:

“哦,一个更强的视频生成工具”

但实际上,它更接近:

“AI影视流水线操作系统”

它的意义在于:把创作拆成模块、用AI连接每个模块、最终实现自动化生产,这件事一旦成熟,会带来一个结果:未来1–2年,短剧制作中AI的参与度,会远超我们今天的想象。

写在最后:一个机会窗口

每一轮技术变革,都会出现一类人:

-

第一批用工具的人

-

第一批做内容的人

-

第一批赚到红利的人

现在的问题不是:

“AI短剧会不会火?”

而是:

“你会不会是第一批做的人?”

项目地址点击阅读原文即可立即开始

给你的一个建议

不要只“看懂”,要“用起来”。哪怕只做一件事:把你写过的一段故事,用AI变成一个短剧,你会立刻感受到,这个时代已经变了。

你试过用AI做短剧吗?最卡在哪一步?

欢迎在评论区交流,我会挑几个典型问题,专门出一期实操避坑指南。

夜雨聆风

夜雨聆风