DeepSeek 崩了:当 AI 从“工具”变成“水电煤”后的 11 小时断供危机

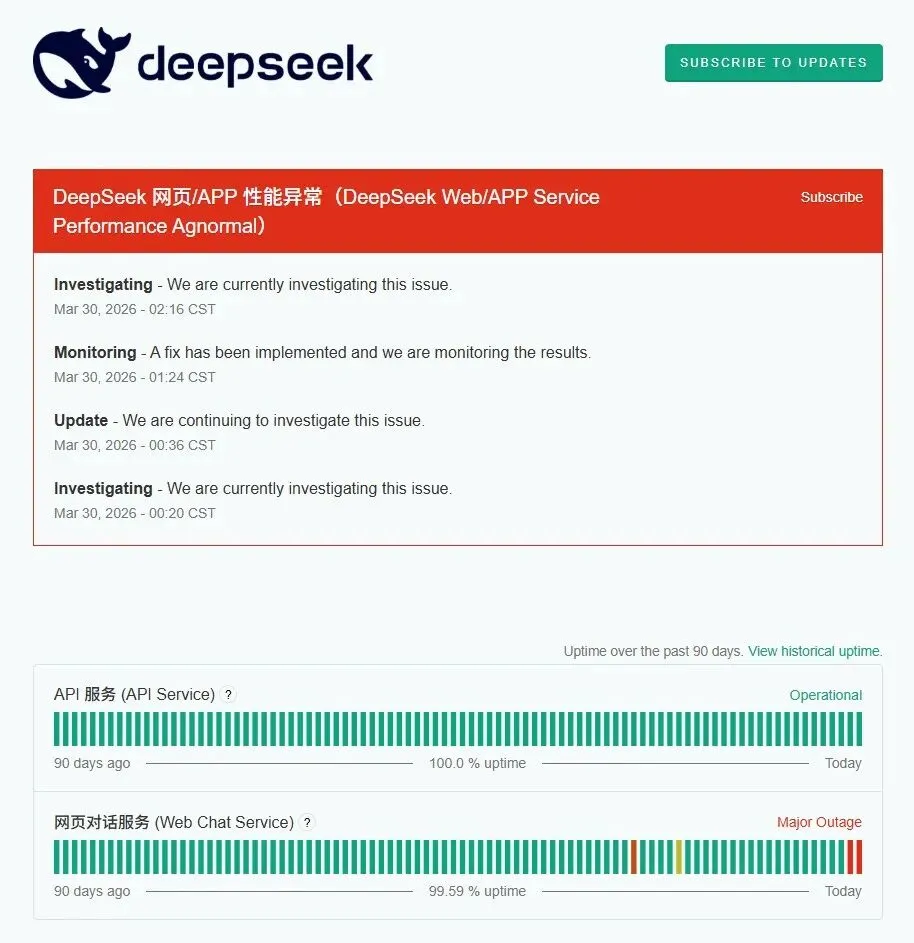

2026年3月29日21:35起,DeepSeek网页与App服务突发重大中断,历经两次“修复-复发”波折,截至30日08:34发稿时,故障已持续近11小时仍未彻底解决。这不仅是技术故障,更是对AI时代基础设施依赖度的极限压力测试。

一、 事件复盘:从“短暂抖动”到“马拉松式宕机”

根据DeepSeek官方状态页及媒体报道,这次故障呈现出罕见的“反复发作”特征,打破了用户对“秒级恢复”的惯性期待:

– 第一波冲击(29日21:35):服务首次异常,官方于23:23宣布解决,给用户“虚惊一场”的错觉。

– 第二波崩盘(30日00:20):仅一小时后,服务再次性能异常,官方实施修复方案后,状态从“监控中”回退至“调查中”,显示底层问题并未根除。

– 持久战(截至发稿):状态页仍标记为“重大中断”,网页对话服务持续报错“服务器繁忙”,API服务虽基本正常,但C端用户体验已彻底崩盘。

二、 社会级连锁反应:被“断网”的论文与代码

“DeepSeek崩了”迅速登顶热搜的背后,是用户工作流被强制中断的集体焦虑。与普通App宕机不同,DeepSeek的故障具备“生产资料”断供属性:

– 毕业季“卡脖子”:正值3月底高校论文盲审冲刺期,大量学生依赖其进行文献综述、逻辑梳理,对话中断直接导致未保存内容丢失,打乱了原本紧张的deadline节奏。

– 开发者“停摆”:深夜 coding 的程序员遭遇代码生成与调试中断,项目交付风险骤增。

– 信任度透支:付费会员的抱怨最为尖锐——“充了会员就是为了稳定性,关键时刻却掉链子”。这种体验落差正在消耗品牌长期积累的信任资本。

三、 深度拆解:为何这次“崩”得如此彻底?

虽然官方尚未公布最终根因,但结合其业务特征与行业通病,此次长时宕机暴露了AI独角兽在狂奔中的三大隐疾:

1. 算力“爆仓”与架构瓶颈

DeepSeek凭借“深度思考”等长文本、强推理功能迅速破圈,用户量呈指数级增长。然而,MoE(混合专家)模型在推理阶段的算力消耗极大,高峰时段的集中请求极易击穿资源池上限。若基础设施扩容速度跟不上用户增长,宕机只是时间问题。

2. “修复-复发”暴露运维成熟度短板

故障处理中出现“已修复”又“回退调查”的罕见情况,通常指向复杂依赖链故障或热修复不彻底。这说明其监控体系对复杂故障的根因定位能力,以及灾备切换机制,在面对真实大规模流量冲击时仍有欠缺。

3. 从“工具”到“基建”的身份错位

用户已将DeepSeek视为如水电般的基础设施,但企业的运维保障能力显然还未达到电信级“五个九”(99.999%)的可靠性标准。这种“期望与现实”的落差,是此次舆情发酵的核心痛点。

四、 启示录:AI时代的“韧性”必修课

DeepSeek的这11小时,给所有AI厂商乃至数字化企业上了一课:

– 稳定性是第二产品力:对于To C应用,再惊艳的模型能力,若没有稳定的服务兜底,用户也会在一次次“断联”中流失。“功能酷炫但总崩”是产品最大的负分项。

– 多云与异地容灾不再是可选项:单一集群或区域的风险过于集中,建立弹性的多云架构,是应对突发流量或单点故障的必由之路。

– 用户习惯的重塑:此次事件将倒逼重度用户重新审视“AI依赖症”,建立本地备份、多工具并行的风险分散意识。企业级用户则会更加看重SLA(服务等级协议)的违约赔偿条款。

结语

DeepSeek的宕机,是中国AI产业从“技术 demo 秀”走向“工业化服务”的成人礼。它残酷地证明:在AI真正成为社会基础设施的路上,技术实力与工程化韧性,缺一不可。 修复服务器易,修复用户被击穿的信任,需要更长时间的稳定守护。

夜雨聆风

夜雨聆风