Claude Code 源码泄露之后,我更想讲清楚:AI Agent 到底是怎么工作的

最近 Claude Code 源码泄露,这事在国内外都挺火热的。

很多人盯着泄露出来的隐藏功能研究。我更关心另一件事:它终于让我们有机会,从产品壳子里面看一个 AI Agent。

这也是我想写这篇文章的原因。

前面那篇关于 Harness Engineering,我讲的是:为什么 AI 不能只靠 prompt,而是需要一个能干活的工作台。这篇我想继续往前推一步,讲更具体的问题:当工作台真的搭起来之后,一个 AI Agent 到底是怎么工作的?

先说结论:Agent 不是更会聊,是一个会围绕目标持续推进任务的执行系统。

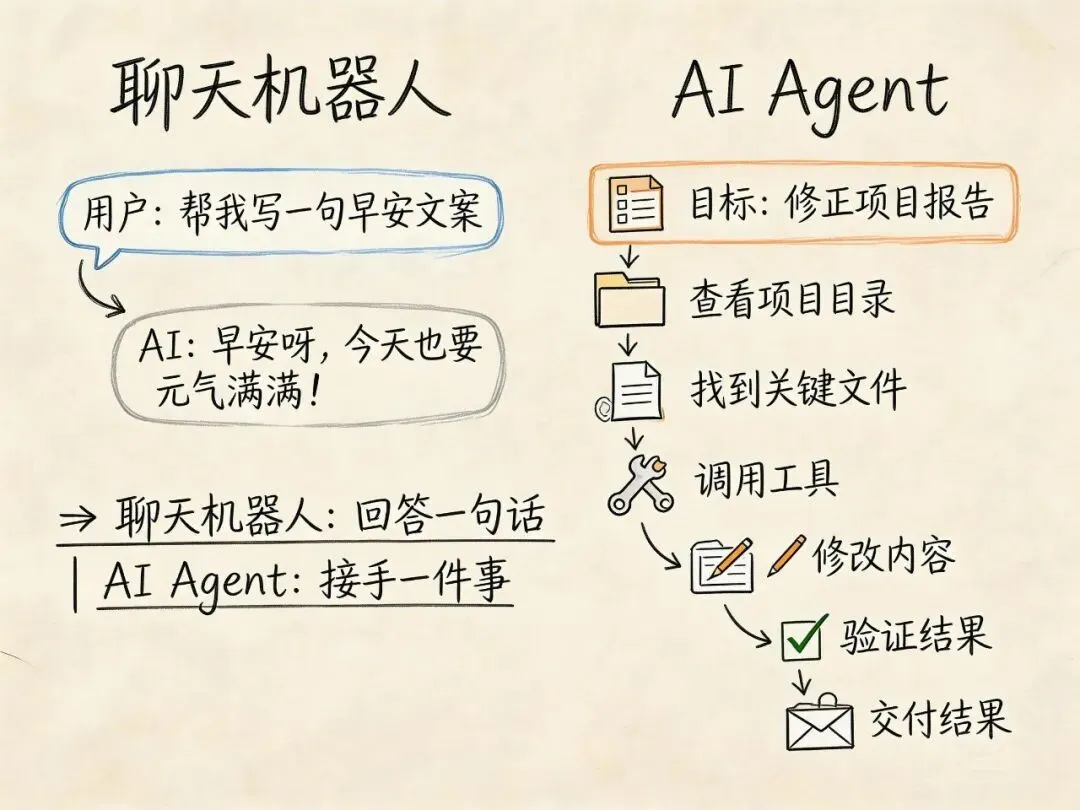

聊天机器人和 Agent,差别不在界面,在任务结构

如果只看表面,聊天机器人和 Agent 很像。你说一句,它回一句。很多人第一次用 Claude Code、Codex 这一类工具的时候,也会觉得:这不就是一个更强一点的聊天框吗?

但真正的差别,不在界面,在任务结构。

聊天机器人处理的是「这一轮你问了什么,结合之前的对话,我这一轮怎么答」。它的工作单位是单轮响应。哪怕上下文更长、语气更自然,本质上还是回答。

Agent 不一样。Agent 接到的不是一句话,而是一件事。

比如你让它读项目目录、找到关键文件、整理结构、改一个 bug、再把结果交回来。它必须先理解目标,再决定从哪开始,然后读文件、调工具、判断下一步、根据结果修正动作,直到把任务收住。

Chatbot 是在回答一个问题,Agent 是在接手一件任务。

这是理解这波 Agent 的第一道分水岭。

用 Claude Code 拆开看,Agent 的核心不是回答,是循环

Claude Code Unpacked 里有一个很有价值的地方:它把这类 Agent 的工作路径拆开了。你会看到,中间根本不是「收到输入,生成回复」这么简单。

它要经过用户输入、历史记录、系统提示、API 调用、工具判断、循环执行、结果渲染,然后再等待下一步。

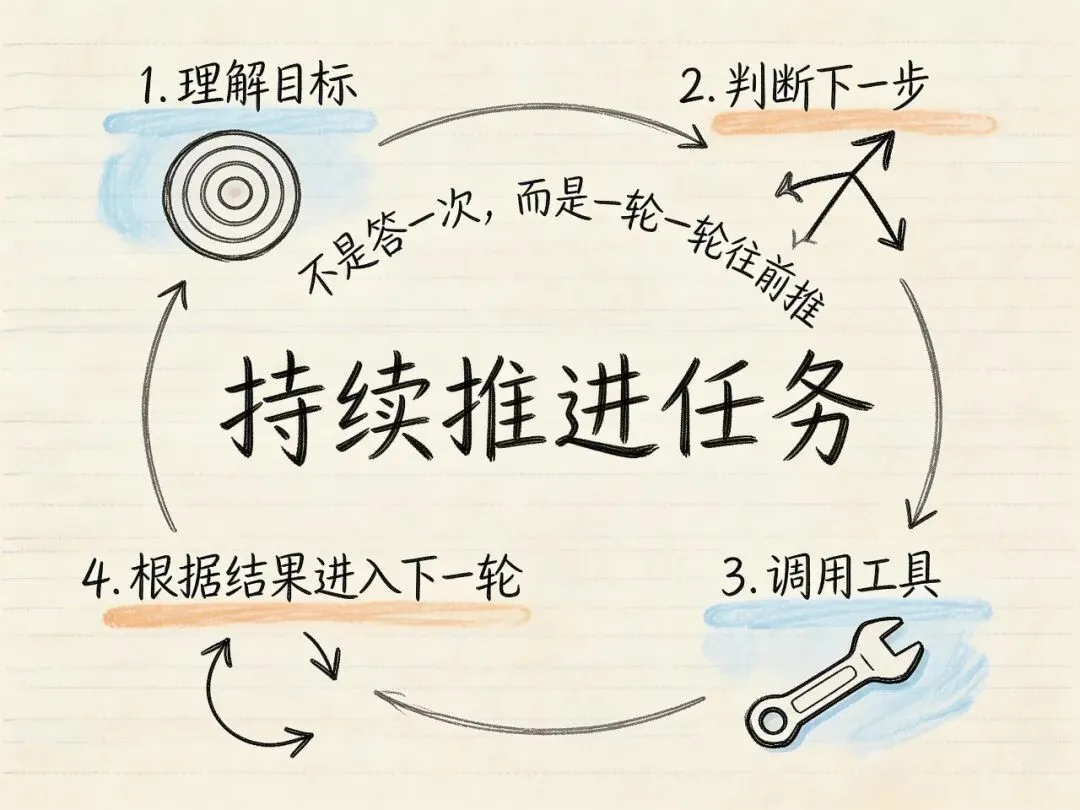

翻译成人话,其实就一句:Agent 不是答一次,它是在一轮一轮往前推。

每一轮,它都在做四件事。

第一,理解现在的目标是什么。

第二,判断接下来最该做什么。

第三,决定这一步要不要调用外部工具。

第四,根据执行结果,重新进入下一轮判断。

你会发现,基本和人干活的逻辑是一样的,这就是 agent loop。

这个 loop 才是 Agent 的心脏。因为有了它,AI 才不再只是一个被动回答器,而开始像一个会持续推进任务的执行者。

说白了,Agent 最关键的能力不是生成,而是推进。

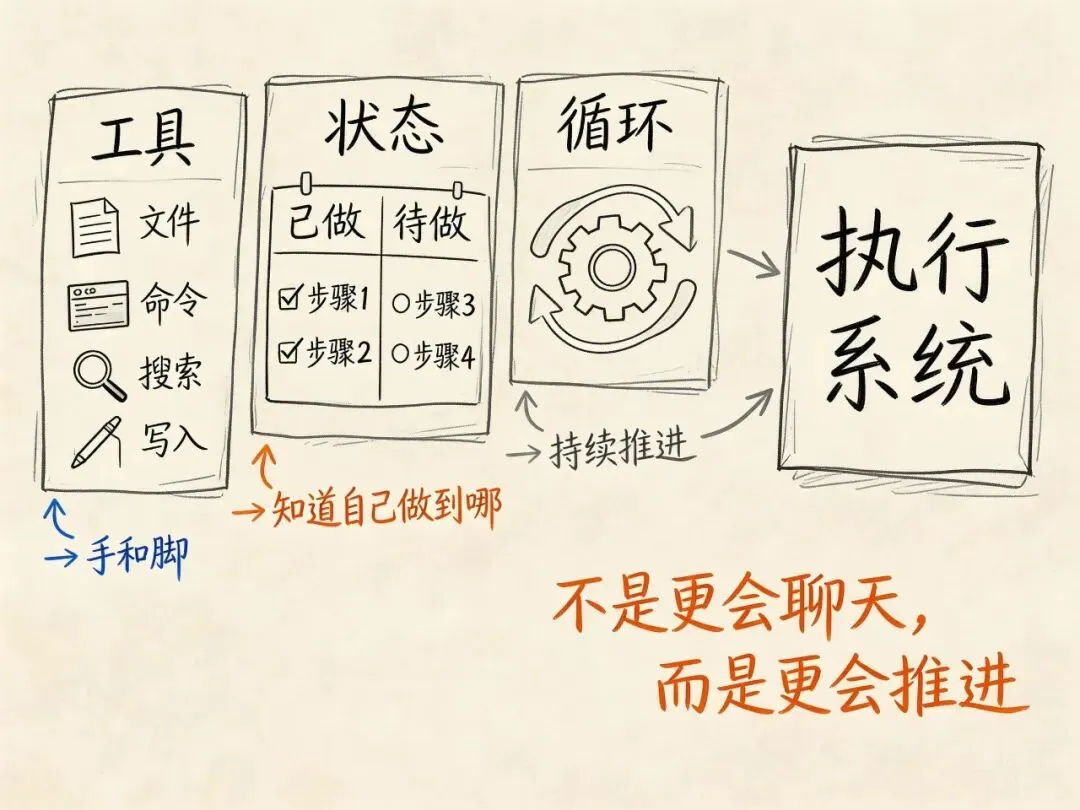

一旦有了工具、状态和循环,AI 的性质就变了

为什么同样是一个模型,放在聊天框里和放在 Agent 里,感觉完全不是一个东西?

因为一旦你给了它工具、状态和循环,它处理任务的方式就变了。

先说工具。

没有工具的时候,AI 再会说,也只能停留在语言层。它可以解释、建议、起草,但碰不到真实对象。看不到文件,改不了系统,也验证不了结果。

用一个很形象的比喻,就是「缸中之脑」。

工具一接上,边界就被打开了。它可以读文件、写文件、执行命令、搜索资料、管理任务。这个时候,它才真正长出了手和脚。

再说状态。

Chatbot 每一轮对话的初始状态是你们的聊天记录。Agent 不一样。它要知道现在做到哪一步了,前面看过什么,哪个动作执行过了,哪里失败了,下一步该往哪走。

这其实就是任务状态管理。

最后是循环。

工具解决的是「能不能动手」,状态解决的是「知不知道自己在哪」,循环解决的是「能不能把事情持续往前推」。少一个都不行。

所以我越来越不喜欢把 Agent 说成「Chatbot 升级版」。这个说法太轻了。它会让人误以为,Agent 只是聊天做得更好、上下文更长、工具更多。

但本质上不是。

一旦系统开始围绕目标、状态、工具和循环组织起来,它就有了真正的主体性。

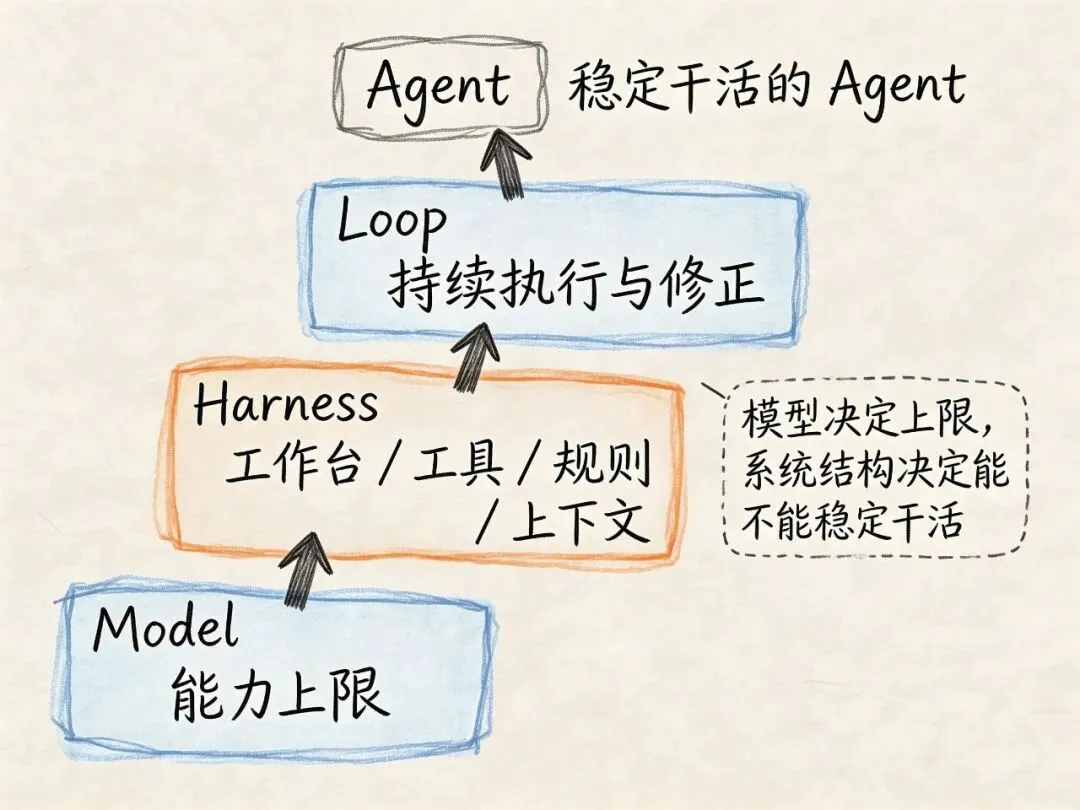

这也是 Harness Engineering 真正接上的地方

前面那篇讲 Harness Engineering,我想讲清楚的是:AI 协作的瓶颈,正在从「会不会问」,转向「有没有把工作方式整理成 AI 能接手的执行环境」。

这篇要回答的,是下一步的问题:当你真的把执行环境搭好了,AI 是怎么在里面跑起来的?

如果说 harness 讨论的是「怎么给 AI 搭工作台」,那这篇讨论的就是:AI 站上工作台之后,到底是怎么工作的。

这也是为什么,理解 Agent,不能只盯着模型。模型决定上限,但真正决定它能不能稳定干活的,是外面的系统结构。

那句很朴素的话,我现在越来越认同:Agent = Model + Harness。

模型决定能力上限,harness 决定它有没有工作台,loop 决定它能不能真的把任务往前推。

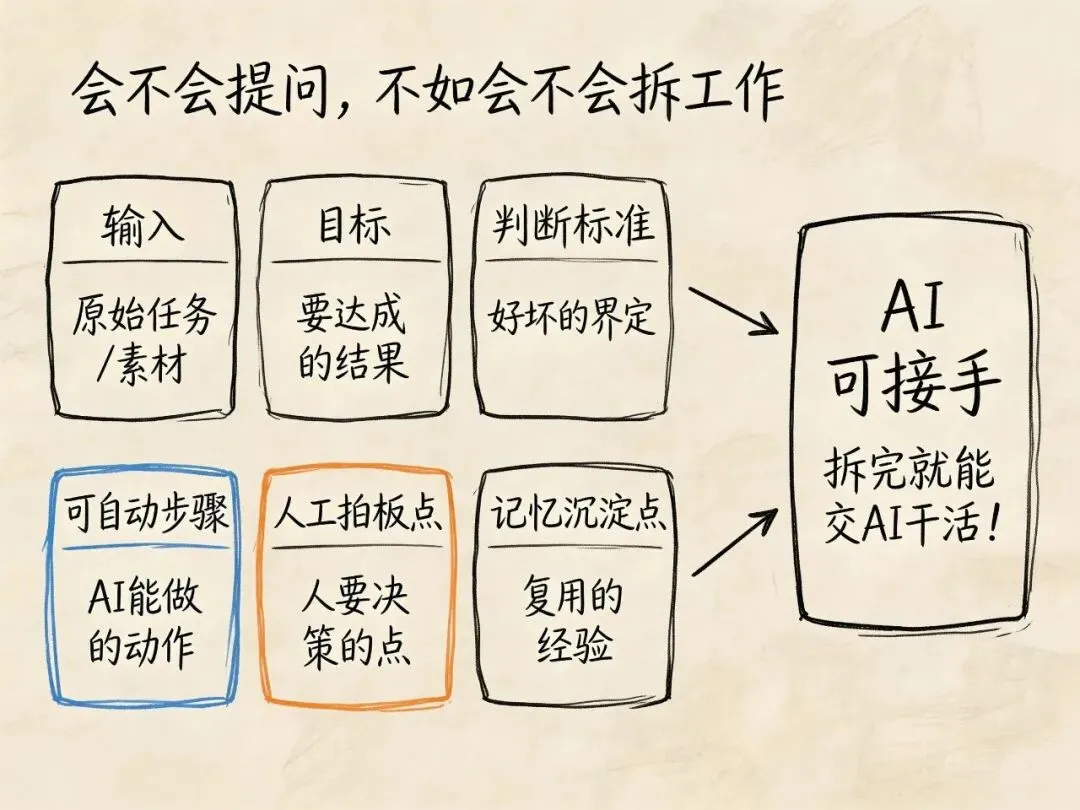

对普通人真正重要的,不是会不会提问,而是会不会拆工作

Claude Code 只是一个样本。真正值得关心的,不是 Anthropic 这次泄露了什么,而是它让我们更清楚地看到:未来真正有价值的能力,可能已经在变了。

以前大家都在学怎么提问、怎么写 prompt。这当然没错,而且今天也还重要。但如果 Agent 继续往前走,真正拉开差距的能力,可能不是「谁更会问」,而是谁更早学会把自己的工作拆成 AI 能接手的结构。

输入是什么,目标是什么,判断标准是什么,哪些步骤可以自动做,哪些步骤必须人工拍板,哪里最容易跑偏,哪里需要检查,哪里需要记忆沉淀。

你把这些东西整理得越清楚,Agent 就越容易真正接手。

反过来,如果你的工作方式本身还是一团雾,全靠临场发挥,那你就算接了最强模型、配了最多工具,最后也很容易只得到一种感觉:AI 好像很强,但总差最后一步。

如果你只记住一句话,我希望是这一句:Agent 时代,真正拉开差距的能力,是谁更早学会把自己的工作拆成 AI 能接手的结构。

「注」本文由大鹏的分身系统创作

夜雨聆风

夜雨聆风