RTK 工具实测:AI 编程 Token 消耗降低 60%-90%,Claude Code 省钱神器

最近好多朋友跟我说,Claude Code 真心好用,就是 Token 烧得太快,额度两三天就没了。今天给你们带来一个真正的省钱神器,实测能省 60%–90% Token

1. Token消耗:AI编程最大的”隐形成本”

在聊这个神器之前,我们先搞清楚一个核心问题:AI编程到底在花谁的钱?

很多人以为Token消耗主要来自”和AI对话的轮数”,聊得多消耗就大,这没错,但不是全部

实际情况是,当你用Claude Code、Cursor这类AI编程工具时,每次执行终端命令(如cargo test、git diff、npm run build),命令输出也会被塞进AI的上下文窗口

问题来了:这些命令输出里,到底有多少是”有效信息”?

我随手截几个例子给你看:

cargo test

一次测试跑下来,输出可能超过10万字符。进度条、测试用例列表、PASSED/FAILED标记、耗时统计……真正有用的”哪个测试失败了、为什么失败”,可能就占几百个字符。80%以上的输出都是噪音。

再比如:

git diff

一个大项目的diff输出,轻轻松松几万个Token。但对AI来说,它其实只需要知道”改了哪几个文件、大概改了什么”就够了。那些行号、统计行、文件头信息……全是不必要的开销。

不是模型不够强,是喂给模型的信息太”脏”。

社区里有人仔细算过一笔账:在AWS Bedrock上跑一次完整的开发会话,Token成本可能超过134美元。Claude Pro Max一个月才100美元。换句话说,Anthropic的订阅费其实是在亏本卖。

所以问题不是”要不要用AI编程”,而是**”怎么让AI编程更省钱”**。

2. RTK是什么

RTK(Rust Token Killer)就是为解决这个痛点而生的。

它的定位非常精准:在终端命令输出进入AI上下文之前,做一次智能过滤和压缩,只把有用的信息放进去。

官方说法是”CLI代理工具”,你可以理解成在AI编程工具和你的终端之间加了一层”过滤器”:

没有RTK:

Claude Code → git status → 2000 tokens进入上下文

有RTK:

Claude Code → RTK拦截 → git status → 200 tokens进入上下文

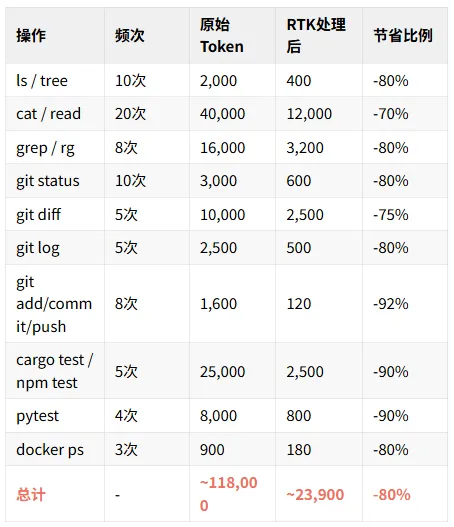

RTK的官方测试数据是这样的:

一次30分钟的Claude Code开发会话,用RTK前需要约15万Token,用RTK后只需要约4.5万Token。节省超过70%。

实测数据更夸张:某开发者使用数周后统计,整体Token节省率达到88.9%。部分命令(比如vitest run)的压缩率高达99.6%——从10万字符压到377字符。

3. RTK是怎么工作的

RTK的核心是4层过滤策略,层层递进,既压缩噪音,又保留关键信息。

第一层:智能过滤

直接剔除终端输出中的”噪音”:

-

代码注释 -

空行 -

ANSI颜色码(那些红红绿绿的输出) -

进度条、动画字符 -

时间戳、PID、内存地址等不稳定信息 -

无关警告

从源头减少Token消耗,不让无用的东西进入上下文。

第二层:分组聚合

将同类输出合并展示,避免重复铺开:

-

搜索结果按文件分组 -

错误信息按类型归类 -

日志按模块收拢

AI能快速定位核心内容,而不是在重复信息里打转。

第三层:智能截断

基于启发式算法,按信息密度取样,而非简单的”截到N行就停”:

-

保留代码关键片段 -

保留错误核心原因 -

砍掉重复、长尾、无意义的输出片段

第四层:去重合并

针对日志类输出,将反复出现的相同行自动合并,并标注次数:

# 原始输出

连接超时

连接超时

连接超时

连接超时

连接超时

连接超时

连接超时

连接超时

连接超时

连接超时

# RTK处理后

连接超时(×10)

既大幅缩短输出长度,又保留了发生频率这一关键信息。

4. 为什么是”零侵入”

很多开发者一听”加层过滤”,第一反应是”会不会很麻烦?要改代码吗?要装插件吗?”

RTK的设计理念是零侵入。

它通过AI编程工具的Hook机制透明运行。以Claude Code为例,安装后执行rtk init --global,RTK会自动注册到~/.claude/settings.json里。

之后你该怎么用还怎么用:

# 你输入

git status

# AI实际收到的是

rtk git status(过滤后的精简版)

整个过程对开发者完全无感。 你不需要记住任何新命令,不需要改任何习惯,RTK在后台默默工作。

而且它是单二进制文件,零依赖。装就是装,卸就是卸,不留任何痕迹。

5. 谁该用RTK

适用人群

-

每天用Claude Code、Cursor、GitHub Copilot CLI的开发者——Token消耗直接和钱包挂钩,省就是赚。

-

频繁执行git、cargo、grep等命令的项目——这类命令输出量大、噪音多,RTK优化效果最明显。

-

对Token成本敏感的个人或小团队——Claude Pro Max一个月100美元,但有人用Max计划的额度,两天就烧完了。RTK能让你的配额用得更久。

-

经常需要维持长篇AI会话的开发者——上下文窗口压力大减,不用频繁重启会话、重复输需求。

实际收益

以独立开发者为例,假设你每天用AI编程2-3小时:

-

不用RTK:每月Token配额可能撑不到月底 -

用RTK:Token消耗降到原来的1/5-1/3,配额绰绰有余

换算成人民币,每个月可能省下几十到上百块的API费用。对个人开发者来说,这可不是小数目。

6. 5分钟上手指南

第一步:安装

macOS(推荐Homebrew):

brew install rtk

Linux / WSL:

curl -fsSL https://raw.githubusercontent.com/rtk-ai/rtk/refs/heads/master/install.sh | sh

Windows:访问GitHub Releases页面下载预编译二进制:

-

rtk-x86_64-pc-windows-msvc.zip

第二步:验证安装

⚠️ 注意:crates.io上存在另一个叫”rtk”的项目(Rust Type Kit),功能完全不同。安装后务必验证:

rtk --version # 应显示 "rtk 0.28.x"

rtk gain # 应显示Token节省统计

如果rtk gain报错,说明你装错了包。

第三步:初始化Hook

rtk init --global

这会自动给Claude Code注册拦截钩子。如果你想支持其他AI编程工具:

rtk init --global --opencode # OpenCode

rtk init --global --gemini # Gemini CLI

安装完成后记得重启AI编程助手,否则Hook不会生效。

第四步:查看节省效果

rtk gain

这会显示你累计节省了多少Token。直观看到省了多少,成就感拉满。

7. 写在最后

前天聊Claude Code的融资,有人说”贵,但值”;昨天聊开源替代,有人说”免费,但差点意思”。

今天聊RTK,我想说的是:贵不贵、值不值,有时候不取决于工具本身,而取决于你怎么用它。

同样的Claude Code,用RTK之前,Token哗哗地烧,额度两天见底;用RTK之后,Token消耗降到原来的五分之一,配额能撑一整月。

最便宜的Token,是根本没进上下文的Token。

RTK不改变你的工作习惯,不破坏开发环境,安装简单,卸载无痕。对每天用AI写代码的开发者来说,它不是”可选工具”,而是”必备神器”。

GitHub地址:github.com/rtk-ai/rtk

今天的省钱工具就介绍到这里。降本增效系列,我们明天继续。

夜雨聆风

夜雨聆风