关注秦朔朋友圈,ID:qspyq2015

未来,机器学习“会变得像使用Word、PowerPoint或者Excel一样”,任何一个领域的研究人员都可以更容易地使用它。

9月17日,麻省理工学院(MIT)名誉校长埃里克·格里姆森(Eric Grimson)在接受澎湃新闻记者专访时做出了以上预测。他此行是为了来上海参加2018世界人工智能大会。

| Eric Grimson接受专访

| Eric Grimson接受专访

AI作为一个顾问:为医生“出谋划策”,给病人“量体裁衣”

AI作为一个顾问:为医生“出谋划策”,给病人“量体裁衣”

记者:您在医疗领域的计算机视觉上做了很多工作,这些年计算机视觉也在癌症识别、健康管理等方面取得了很多突破。在您看来,距离医疗AI大规模普及且进入人们的日常生活,还有哪些困难需要突破?

Eric Grimson: 我想你已经看到了一些例子,说明AI技术可以对医学产生影响。我会告诉你一些例子,然后讨论为使AI产生更大作用,还需要做什么。

在许多成功的例子中,计算机技术不是在代替医生,而是在改善医生。有一个很好的例子叫做图像引导手术(image guide surgery),在手术中,医生可以在切开病人身体之前看到病人体内的情况。我们曾经开玩笑地说它让医生变成了超人,医生有了X射线(X-ray vision),可以看到人的体内。有时这被称为微创手术,意味着你在病人身上开了一个很小的开口,这样对病人的伤害就更小了。在很多情况下,人们认为AI会取代某人,但在这个例子中,通过让医生看到通常看不到的事物,AI让医生变得更好。

至于AI医疗的更广泛影响,我认为,AI医疗会在“个性化医疗”中产生最好的影响,即为某个特定的病人想出一个解决方案。我的一个同事是癌症幸存者。她患有乳腺癌。很不幸,对女性来说,这是很常见的事情。她对许多地方散布的信息感到非常失望。所以她建立了一个系统,把医生的手写报告、化验结果、医学图像、家族病史、科学研究中获取的信息等等放在一个地方,然后她告诉医生:这是一个特殊的情况,你需要专门为这个病人设计方案。这是我认为在AI医疗真正产生广泛的影响之前,我们需要做到的一步。医生不只是对病人说,你的情况与其他人一样,我会一样地来处理。在个性化医疗中,医生会看所有的信息,计算机将它们结合在一起,这样医生就可以为某个病人做出最好的决定,而不仅仅是一般的、通用性的治疗方案。

记者:AI医生会不会带来伦理上的问题,比如出了医疗事故谁负责?

Eric Grimson:我想,在使用AI系统的过程中,伦理是很重要的。在医疗中当然会出现伦理问题,这也可能会发生在自动驾驶的汽车上。如果发生事故,谁该为此负责?该如何判定他们的责任?这是政府需要做出的决定,是社会需要做出的决定。我认为短期内,最有可能的解决方案是AI系统帮助人们做决定(而不是做出最终的决定)。以医学为例,计算机查看所有的信息并将其组合在一起,它可以告诉医生该怎么做,或者可以告诉医生这是与病人相关的所有信息的最佳总结,是计算机的建议,但医生仍然可以做出自己的决定。但如果计算机遗漏了某些信息呢?那还是会产生道德问题。所以我认为,在短期内,人还是应该参与到决策环节中。

记者:所以你认为AI应该扮演一个顾问的角色?

Eric Grimson:是的。特别是在医学上,我认为这一点非常重要。大部分我所知道的AI医疗领域的项目都持有这个观点,他们所关注的是“如何让医生成为更好的医生”,但最终还是由医生做出决定。

记者:但在自动驾驶领域,这个决定权似乎是在AI手中?

Eric Grimson:是的。在一些例子中,人类没有参与到决策中。自动驾驶汽车就是。所以我认为,研究人员需要尽自己最大的努力来确保这类问题尽可能少发生。但最终人们需要决定自己想在什么程度上使用自动驾驶汽车,这是社会、政府和个人的选择。

记者:MIT早在1963年就设立了人工智能实验室,非常有前瞻性。当时为什么会想到设立这个实验室?

Eric Grimson:MIT参与了最早的AI研究,1956年在达特茅斯召开的一个会议上,MIT、达特茅斯、卡内基梅隆,还有其他一些学校参加。“人工智能”这个词是在那次会议上创造的。

MIT这么早成立AI实验室,有两部分原因。第一是有一些教授对这个问题很感兴趣,想探索。第二是MIT认为这是一个对未来非常重要的领域。我们花了60年的时间才看到AI真正的影响,但MIT就是一个喜欢冒险的学校。有一些冒险成功了,另一些没有。对于那些没有起效的项目,就终止它,然后继续前进。我们认为AI是一个能将神经科学、脑科学以及早期的计算机科学知识结合起来的领域,这里有真正做一些不同事情的机会。这就是为什么我们是最早那批建立AI实验室的学校之一。1959年是第一个项目,1962年或1963年MIT创建了第一个AI实验室。

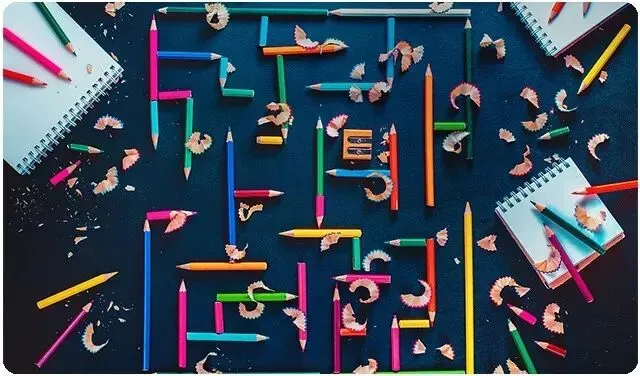

AI作为一种工具:让人们像使用Word、PowerPoint一样使用AI

AI作为一种工具:让人们像使用Word、PowerPoint一样使用AI

记者:今年2月,MIT发起了MIT Intelligence Quest项目,目的是什么?

Eric Grimson:Quest for Intelligence这个项目有四个部分。第一部分我们称之为“核心”(Core),它着眼于智力科学(Science of Intelligence)。这不仅仅是新电脑和新算法,而是想尝试理解在人的大脑里发生了什么。神经科学告诉我们大脑是什么样的,认知科学告诉我们人类是怎样思考的,这些信息综合起来会告诉我们下一代的算法应该是什么样的。我们认为这很重要,因为AI经历了很多周期,发生了很多变化。如今,深度学习很受欢迎,每个人都做神经网络。这些技术打败了世界上最好的围棋选手,令人印象十分深刻。

但这里有个问题,这些深度学习系统需要数以百万计的例子,需要巨大的云计算能力。但对人类来说,情况就十分不同。你给一个2岁的小孩展示6个例子,她就能找出其中的规律。所以她的学习方法不同于那些深度学习系统。那我们可以从中学到什么呢?我们如何利用它来思考未来的技术呢?

第二部分我们称之为“桥”(Bridge)。这是从AI到MIT其他任何领域的桥。我们认为每一个工程领域、科学领域、社会科学领域、设计领域都将受到机器学习和AI的影响。我们希望让任何一个领域的研究人员更容易地使用机器学习,就像让他们使用Word、PowerPoint或者Excel一样。你不需要成为计算机科学专家就能很快地使用它并且理解它。

第三部分是伦理。我们需要真正理解使用这些系统时会遇到的伦理问题。

第四部分是理解AI系统将会产生的影响。例如,工作将会被改变,一些工作将会消失。我跟你打赌,也许在短短五年内,所谓的长途卡车,将东西带到美国各地的大型16轮卡车,将会完全自动化。它们将简单地在旧金山城外完成装载,然后开车去芝加哥,或者开去纽约,去波士顿。这将改变几百万人的就业机会。所以我们真的需要考虑该如何规划未来的工作?如何帮助那些将要失去工作的人重新培训?如何帮助人们适应这些?

最后说一下MIT究竟为什么做这个项目呢?我们认为AI会影响人类研究的每一个领域。而我们希望确保MIT正在尽最大努力尽快建立通往所有其他领域的桥梁。不管人们来自哪个领域,AI都可以作为一个工具来帮助他们更好地完成工作。

记者:你的意思是每个受过教育的人都可以使用AI,就像使用Word或者Excel一样?

Eric Grimson:是的,是的。你不需要成为一个MIT学生就能使用AI。这就是我们的目标,AI应该像你今天使用的其他工具一样容易使用。

记者:所以在这个项目中,计算机科学家将与社会心理学家以及政策制定者合作?

Eric Grimson:当然。我们有计算机科学家与经济学家合作,去思考与就业变化有关的经济学问题;我们有计算机科学家与社会学家、人类学家、哲学家合作,去思考使用这种技术的伦理问题。但我认为最好的例子是,我们有计算机科学家帮助其他工程师和其他科学家更有效地工作。

给个例子,两个MIT的年轻教授,一个来自计算机科学,一个来自材料科学。材料科学家说,当我想设计一种新材料时,我在想材料的特点是什么,我想要特定的硬度、特定的柔韧性和其他性能。但知道这些并不能告诉我如何创造出这个材料。所以他们建立了一个计算机系统,让它来“阅读”几百万篇材料学的文献。这里需要给“阅读”两个字打上一个引号,但是AI确实已经能很好地理解并建立起一个模型。模型建立好之后,他们需要做的是告诉计算机,这是我想要的8种或10种新材料的特性。计算机不会告诉你该怎么制作,但是它可以给出8个、10个或者15个的建议配方来帮助材料科学家。然后材料科学家可以看这些建议,从中发现那些他没有想到的方法。AI能够使材料科学家更高效地工作,但AI并没有取代人类,AI是提出建议。AI是系统的顾问。这种状态最终应该是很容易做到的,例如,任何学生都可以使用这个系统来思考我如何创造一些新的东西。

记者:所以你指的是AI可以帮助其他领域的专家做一些文献阅读的工作?

Eric Grimson:是的。这种系统可以读一至两百万篇文章,然后建立了一个可以使用的模型。事实上,MIT已经有人开始做这件事了,AI用来帮助一个人更好地理解文献中出现的大量信息。

AI教育:每个大学生都应该了解一些计算思维

AI教育:每个大学生都应该了解一些计算思维

记者:中国许多知名高校这两三年来陆续开始设立人工智能学院或课程,您觉得AI教学最重要的元素有哪些?

Eric Grimson:我首先要问一个更广泛的问题:是不是每个大学生都应该了解一些计算思维(computational thinking)?我认为答案是肯定的。不管你是计算机科学家,还是物理学家、经济学家、政治科学家,不管你的专业是什么,我们认为你都应该知道并掌握一点所谓的计算思维,比如什么是算法。这不同于编程,编程很重要,但是“你怎么看待这个问题”是我们认为更重要的。

一旦教育做到了这一层(培养学生的计算思维computational thinking),才可以专门来讨论“关于AI学生应该知道什么”。我认为最重要的事情也许是理解什么叫做“让一个系统去学习”。然后再了解有很多不同的学习方法可以达到学习的效果,比如神经网络现在非常流行,但是还有其他的技术,也还有其他的思考技术。

我认为即使你不是一个计算机科学家,也应该对机器学习算法有足够的了解。比如,我该如何使用它?我需要做什么才能够去使用它?什么情况下我应该相信它的结果?有时我会用这个结果,但有时候我应该质疑,算法真的给出了我所希望的结果吗?每个学生都应该知道这些。

记者:对于一个刚刚选择进入这个领域(AI/ML)的学生,你有哪些建议?

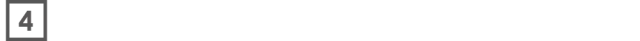

Eric Grimson:首先,要宽广(Be broad)。现如今有一种特别的关于机器学习的方法,你应该去理解,但也应该加以质疑。这是最好的方法吗?有不同的做法吗?人们使用机器学习的早期方法有哪些?因此,我鼓励学生不仅要把它当作一种工具,而要把机器学习当作一个领域,要更广阔地去看到机器学习的不同层面。

第二个建议。现在有很多关于机器学习的工作机会,学习机器学习可能会带来一份工作,这很不错,但如果一个学生真的对生物学感兴趣,我会鼓励他研究机器学习和生物学的交叉领域。不要只是为了学习机器学习而放弃你的其他领域。

MIT现在有三个联合学位,意思是两个学院一起给出的学位。一个是计算机科学和生物学的联合学位。如果你真的对发现药物感兴趣,或者如果你真的对理解疾病感兴趣,了解足够的生物学和计算机科学是一件好事。第二个是计算机科学与经济学金融学的联合学位,学习从大银行到对冲基金、交易系统。第三个可能会让你大吃一惊,它是计算机科学和城市学的联合学位,是关于设计一个城市。中国仍在建设许多新城市,水系统、电气系统、运输系统的设计都需要依靠对庞大数据的理解,利用一个学习系统可以帮助找出最好的方法。我相信我们很快会把计算机科学引入到神经科学。所以我的建议是:不要放弃你真正喜欢的事。你可以看看机器学习在我目前所处的领域有什么样的作用。

记者:所以它更像是一种工具?你仍然可以学习你的专业,但机器学习可以帮助你形成一种新的思维方式?

Eric Grimson:是的,它可以改变你的想法。

数据隐私:自主决定我想要分享哪些数据

数据隐私:自主决定我想要分享哪些数据

记者:机器学习需要大量的数据,但目前数据质量和规模以及对数据公开的监管似乎都不太令人满意,这是人工智能/机器学习的瓶颈吗?您对此有何建议?

Eric Grimson:拥有海量数据是很有价值的,但人们在使用这些数据时需要考虑一些问题:一个就是你的数据中是否包含偶然性偏差。比如人脸识别算法在你我这样的人身上运行效果很好,但在一些肤色或脸型与我们差别巨大的人身上就不起作用了。如果你仅仅对恰好位于所有可能性空间中的一部分数据运行算法,就会在无意间引入偏差了。所以在考虑数据集合时,一个问题就是你如何确保不会发生偶然性偏差,而这些偏差会影响最终的结果。

还有一个关于数据隐私的问题。比如在医疗方面,掌握大量病人的数据是非常有价值的。因为运行算法能更好地检测疾病。但数据的主人希望对自己的私人数据保密,不想让邻居或监护人突然知道他们患有某种疾病。所以保护个人隐私非常重要。

第三个是许多美国人关心的问题:归属于大公司的海量数据。比如亚马逊、Facebook、谷歌这三家公司,尤其是一些拥有大量在线业务的公司,他们掌握着大量数据,这是他们的权利,当你使用他们的网站时你就同意了让他们获取这些数据。但这并不意味着研究人员就可以使用这些数据,除非他们是公司的合作伙伴。这样一来就产生了一个很有趣的问题:学校能不能建立一个所有大学都能共享的数据库?这样一来研究人员就可以在不和公司签协议的情况下,使用这些数据来探索新思路?

记者:阿里巴巴这样的中国公司也拥有海量的数据,人们也会担心数据隐私问题。

Eric Grimson:当然。我并不是说这只是美国公司的问题,我说的是美国版的故事。阿里掌握着海量数据,京东也是。我认为社会学家应该与政府和企业合作,探讨如何有效使用数据,但同时要保护人们的数据隐私。

记者:所以应该制定一些政策进行引导?

Eric Grimson:这也是大多数人的愿望。我不是要告诉政府该怎么做,但我认为很多人也和我一样有着强烈的愿望:我希望自己能够决定我想要分享多少自己的数据。

欧洲已经有这样的先例,在这方面走在最前沿。欧盟已经就这些隐私问题达成一致,主要是提供了一种选择——在参与之前必须要知情同意(“You have to agree that before participate”)。随着这套体制越来越普遍,每一个社会、每一个政府都要考虑如何掌控这种情况,要制定什么样的政策。

何为世界一流大学?“真正一流的大学应该敢于冒险”

何为世界一流大学?“真正一流的大学应该敢于冒险”

记者:许多中国大学都提出了建设世界一流大学的口号。你认为世界一流大学应该具备什么样的素质?

Eric Grimson:评价一所大学有很多方法,我们都说我们不看世界排名,但我们都会悄悄地看。直言不讳地讲,大多数人会说当今世界上最好的大学仍然在美国,哈佛大学、麻省理工学院、耶鲁大学、普林斯顿大学、斯坦福大学、芝加哥大学等,我还遗漏了一些。亚洲、欧洲也有一些非常好的大学,但其中大部分目前仍在美国。随着时间的推移,这种情况可能会改变。

我想说的是,一所真正伟大的大学的特点是愿意冒险,以及有鼓励学生和教授承担风险的氛围。如果你愿意冒险,你就必须不怕失败。我看到很多大学都不愿意这么做。他们过于担心下一步而不愿做出大的改变。

如果你看看今天那些优秀的大学,几乎所有的大学都非常愿意冒险。更重要的是,他们鼓励学生冒险。比如在麻省理工学院,几乎所有本科生都和教授一起做研究。我曾经管理过一个大型的研究小组,我们每周开一次会。在团队中我作为高级导师,还有一些初级导师,一些博士后,部分研究生以及少数本科生。我们会在会议中讨论一个特定的问题。一个大二的本科生会说,为什么我们不这样做呢?如果他们能为自己的想法辩护,如果他们能表达清楚,他们能说明为什么这是个好主意。这样的话,在会议结束时,我很有可能会说:为什么我们不那样做呢?

如果你有一个好主意并且愿意冒险,这对我来说是一所好大学的标志。我这么说是因为,我在其他大学不能经常看到这样的现象,包括其他的美国大学。他们的教授告诉青年教授做什么,青年教授告诉研究生该做什么,研究生告诉本科生该做什么。似乎好像教授经验更丰富,其他人就应该听他的话。

但是我认为一所好的大学要能够自由交流思想。它需要愿意听取新想法。敢于冒险的意愿,是我在一所真正的好大学中看到的最重要的事情之一。在MIT这样的地方,我们会勇敢尝试用一种非常不同的方式思考问题,只是为了看看它是否可行。如果行不通,我们不会说,不好意思,再见,不用再来了。我们会说,这样行不通,接下来要尝试什么?

记者:所以在您看来,对学生来说,“敢于冒险”是指挑战权威?那么对于教授和大学来说,“敢于冒险”有什么含义呢?

Eric Grimson:我说的挑战权威,你应该有礼貌地去做,而不是对教授大喊大叫。也许应该换一个词,“质疑”或者“提问”。

关于教授,我也会这么说。教授很容易采取一系列可预测的步骤,做已经发表的研究,连续不断做下一件事。但在我看来,最好的教授只会在一段时间内这么做,然后他们会有一次质的飞跃。他们会落在不同的地方。所以即使是一个优秀的教授,也会不断地问:我们为什么要这样做?在MIT工作期间,我很荣幸能和很多诺贝尔奖获得者交流,几乎每个人都会告诉我他们经常这样做,他们经常挑战自己:我为什么要这样做?这是最好的方法吗?有更好的方法吗?

国际竞争:“我不认为任何一个国家能够完全成为人工智能的中心”

国际竞争:“我不认为任何一个国家能够完全成为人工智能的中心”

记者:现如今,很多国家像美国、英国、日本、中国等都在大力进行AI研究,谁在哪个方面做得更好?

Eric Grimson:人工智能最初主要起源于美国,但英国像爱丁堡等地很早就跟进了。在法国、德国这些地方都有实验室,日本也投入了大量的精力。当然,中国也发展迅猛。我觉得很难区分。但当涉及到基础理论的时候,也许美国在某些方面仍然微微领先。

但在一些应用程序上,中国的大学和公司已经在飞速进步。在语音识别上,中国有一些公司做得非常好。美国的研究做的不错,但中国在商业化方面比我在美国看到的更有效。那些中国公司是在中国大学多年的研究基础上建立起来的,他们与美国有着非常密切的合作。而在计算机视觉这样一个非常受欢迎的领域,也会有一场非常有益的竞争。

有时美国领先一点,然后中国试图领先一点,然后美国再稍微领先一点,这是一个友好的竞争。在我看来,他们中做得最好的都是基于多年的研究。我认为花时间仔细思考如何创造是很有价值的。实际上,加拿大是另一个在人工智能领域非常强的国家。选择任何特定的领域来看,现在可能是这个国家领先,六个月后其他国家会超越上来。因为每个国家都在努力做得更好。

记者:英国因为图灵的原因想要成为一个中心,他们曾说过类似的话。

Eric Grimson:我希望在AI领域能够形成国际合作。每个国家都有自己的需求,每个国家都想为自己的国家做最好的事情。但是,我不认为任何一个国家能够完全成为中心。美国不会。即使美国有斯坦福、伯克利、麻省理工和哈佛,这些学校都在做不同的事情。但我认为合作将真正推动这一领域的发展,目标应该是让人工智能系统更好地造福每个人的生活。如果我们合作会怎样呢?只会越来越好。

作者澎湃新闻记者 张唯 实习生 李政,原载于9月19日,澎湃新闻APP,经授权刊载,有部分修改和删减。

「 本文仅代表作者个人观点 」

「 图片 | 视觉中国 」

秦朔朋友圈微信公众号:qspyq2015

商务合作|请联系微信号:qspyqswhz

投稿、内容合作、招聘简历:friends@chinamoments.org

夜雨聆风

夜雨聆风