OpenAI,又双叒叕放大招了。

这一次,不是小修小补,也不是常规迭代,而是直接把大模型的能力边界往前拽了一大截。

GPT-5.4,正式来了。

百万上下文,第一次真正解决“大模型失忆症”

GPT-5.4 最先把人震住的,是它在 API 和 Codex 中实验性支持 100 万 token 上下文。

这是什么概念?

差不多就是:

一整个大型代码仓库

几千页长文档

超长任务链的完整历史

大型 Agent 工作流的一次性记忆池

过去很多人以为,大模型最大的问题是“不够聪明”。

其实不是。

真正做复杂任务的人都知道,最大的问题往往是:

它聪明归聪明,但记不住。

前面看了十几份资料,后面推理到一半开始忘;

刚做完几轮工具调用,最初的约束已经丢了;

项目一复杂,prompt 越堆越长,最后不是成本爆炸,就是上下文崩了。

而 GPT-5.4 的百万上下文,本质上就是在解决这个问题。

它让模型第一次有机会在真正长链条的复杂任务里,维持持续理解、持续规划、持续执行。

说白了:

Agent 终于没那么容易“脑子断片”了。

这不是简单的参数升级,而是可用性的跃迁。

GPT-5.4 有三个版本:

ChatGPT 里叫 GPT-5.4 Thinking,

API 和 Codex 里叫 GPT-5.4,

追求极限性能的还有 GPT-5.4 Pro。

这次,OpenAI 把 GPT-5.2 的通用推理能力和 GPT-5.3-Codex 业界领先的编程能力合并到了一个模型里,同时在工具调用、电脑操控、办公文档处理等方面全面升级。

用 OpenAI 的话说:用更少的来回,更准确地完成复杂的实际工作。

百万上下文

GPT-5.4 在 Codex 和 API 中实验性支持 100 万 token 的上下文窗口。

100 万 token 是什么概念?

大约相当于 5000 页文档,或者一整个大型代码仓库。

这让 Agent 能够在超长的任务链中规划、执行和验证,不再因为「记性不够」半途而废。

再也不必上下文恐慌了。

超过标准 272K 上下文的部分,按 2 倍费率计费。开发者可以通过配置 model_context_window 和 model_auto_compact_token_limit 来启用。

同时,GPT-5.4 还能在长时间思考时更好地保持对早期上下文的感知,不会像以前那样想着想着就忘了前面在讲什么。

最惊艳的变化:回答到一半,你居然可以直接打断它

这次在 ChatGPT 里最让人眼前一亮的,反而不是跑分,而是体验。

GPT-5.4 Thinking 支持中途打断。

这个功能乍一看不算炸裂,但真正用过长任务的人都知道,这简直是救命。

以前你和 ChatGPT 的交互,像什么?

像回合制游戏。

你出一招,它出一招;

它一旦开始长篇输出,你只能被迫听完;

如果它理解错了方向,你也只能等它讲完再重新来一轮。

很低效,也很反人类。

因为真实世界里的工作,从来不是一次说清、一步到位。

而是边做边改,边看边调,边推进边修正。

现在 GPT-5.4 Thinking 终于开始接近这种工作方式了。

它会先给一个思考计划,而在执行过程中,你可以随时补充要求、修正目标、临时改方向,它会立刻把这些新信息融合进去,继续往下做。

这意味着什么?

意味着你和 AI 的关系,正在从“提问者和回答者”,变成“协作者和执行者”。

这是一次非常关键的体验升级。

别小看这个变化,它可能会直接改变以后大家使用 ChatGPT 的习惯。

此外,GPT-5.4 Thinking 的深度网页搜索能力也有显著提升,特别是在高度具体的查询上,能更持久地跨多轮搜索找到最相关的信息源。

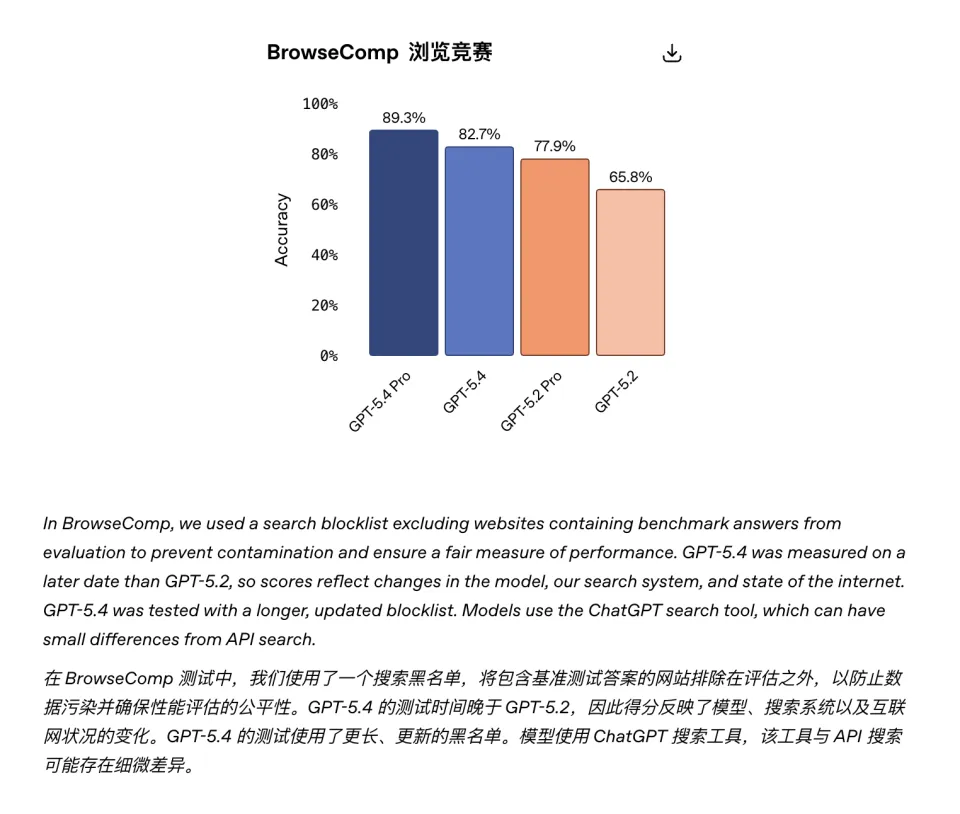

在 BrowseComp 测试中,GPT-5.4 达到 82.7%,比 GPT-5.2 的 65.8% 跃升了 17 个百分点。GPT-5.4 Pro 更是拿下 89.3% 的新纪录。

会操作电脑了,AI 开始真正“自己动手”

如果说过去的大模型主要活在聊天框里,那么这次 GPT-5.4 正在迈出聊天框。

因为它成了 OpenAI 第一个原生支持 Computer Use 的通用模型。

什么意思?

就是它可以像人一样:

看屏幕

识别界面

点击按钮

输入文字

跨应用执行操作

完成复杂任务流程

这已经不是“告诉你怎么操作电脑”了。

这是它自己开始操作电脑。

从行业视角看,这件事的分量非常重。

因为过去 AI 自动化一直有一个核心瓶颈:

模型会想,但落不到界面上。

现在这个瓶颈,正在被突破。

而且成绩还相当离谱。

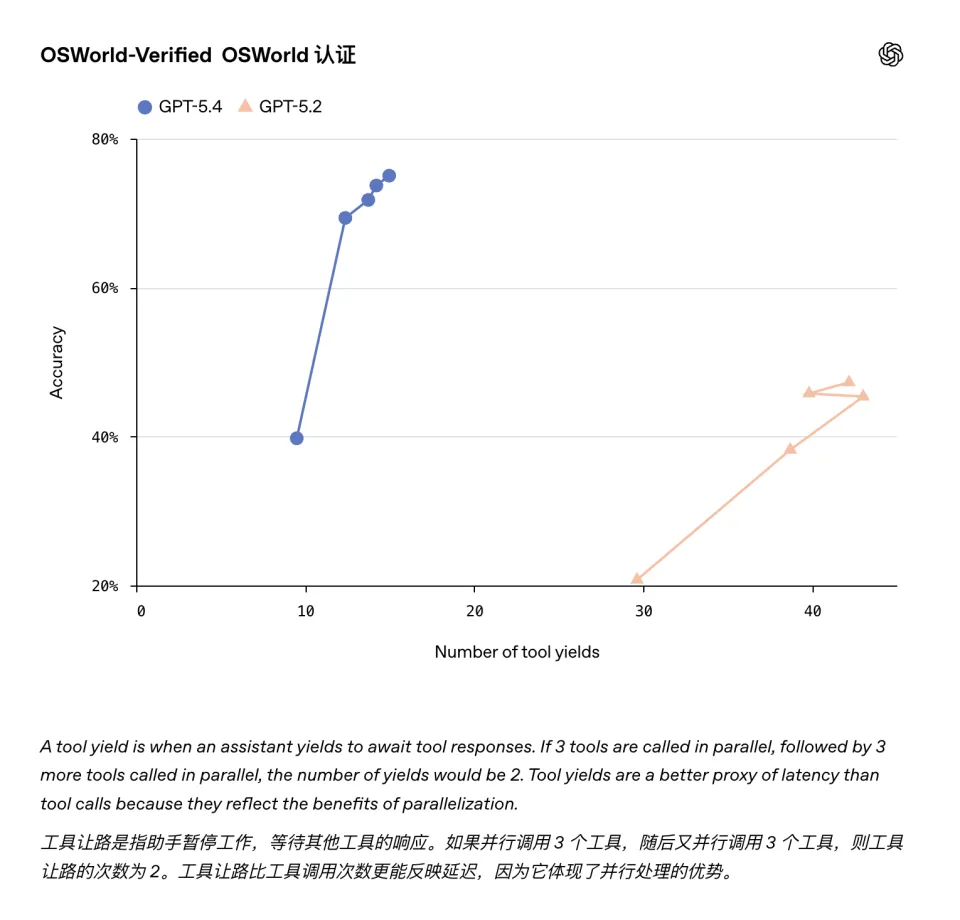

在模拟桌面环境操作的测试里,GPT-5.4 成功率已经超过人类基线。

看到这里,你大概就能明白,为什么越来越多人开始相信:

未来最先被 AI 吃掉的,不一定是创意工作,而可能是那些高频、规则清晰、跨软件执行的数字工作流。

因为它真的开始能“上手干活”了。

推理、编程、工具、视觉,OpenAI 这次是全线拉满

这次 GPT-5.4 最可怕的,不在于某一个能力特别突出。

而在于它几乎是全方位增强。

它把 GPT-5.2 的通用推理,和 GPT-5.3-Codex 的顶级编程能力,合到了一起。

于是你看到的是一个什么样的模型?

推理更强

编程更强

工具调用更准

视觉识别更稳

文档处理更好

电脑操作更成熟

办公输出更像样

这种感觉就像什么?

像是 OpenAI 终于不再做“偏科天才”,而是在做“全能选手”。

这背后透露出来的信息非常明确:

未来模型竞争,比的已经不是单点突破,而是谁更像一个完整的工作系统。

GPT-5.4,显然就是冲着这个方向去的。

更少幻觉,才是它最值钱的地方

很多人看模型更新,最爱看的是跑分。

但真正在企业里落地,最重要的往往不是“高多少分”,而是:

会不会一本正经地胡说。

OpenAI 这次反复强调,GPT-5.4 是目前最不容易幻觉的模型。

这件事,可能比很多 flashy 的功能更重要。

因为你让 AI 写段文案,错一点可能无所谓;

但你让它做财务分析、法务辅助、研究总结、表格建模、商业汇报,一旦错了,代价完全不同。

AI 真正走进生产环节,最核心的一道门槛不是能力上限,而是可靠性下限。

而 GPT-5.4 的一个重要意义就在于:

它正在把“不靠谱”这件事,往下压。

这才是企业最愿意买单的部分。

在 MMMU-Pro 视觉理解测试中,GPT-5.4 不使用工具就达到 81.2%(GPT-5.2 为 79.5%),使用工具则达到 82.1%。

文档解析能力也更强了。在 OmniDocBench 上,GPT-5.4 即使不开推理,平均错误率也从 GPT-5.2 的 0.140 降到了 0.109。

API 早期测试用户反馈,在使用 original 或 high 模式后,定位能力、图像理解和点击准确率都有明显提升。

更强编程

GPT-5.4 整合了 GPT-5.3-Codex 的前沿编程能力,在 SWE-Bench Pro 上达到 57.7%(GPT-5.3-Codex 为 56.8%),同时延迟更低。

在 Terminal-Bench 2.0 上得分 75.1%,GPT-5.2 只有 62.2%。

但还是比 GPT-5.3-Codex 略差……

OpenAI 特别提到,GPT-5.4 在复杂前端任务上表现突出,生成的界面比以往所有模型都更美观、更可用。

Codex 里开 /fast 模式,token 生成速度能提升到 1.5 倍,用的是同一个模型、同样的智能水平,纯粹就是更快。开发者在 API 中可以通过 Priority Processing 获得同样的加速。

作为 Computer Use 和编程能力协同工作的示例,OpenAI 还发布了一个实验性的 Codex Skill:Playwright (Interactive),可以在构建 Web 和 Electron 应用的过程中实时做可视化调试。边写边测,自己调自己。

极高 Token 效率

GPT-5.4 是 OpenAI 最省 token 的推理模型,解决同样的问题,消耗的推理 token 比 GPT-5.2 少得多,速度也更快。

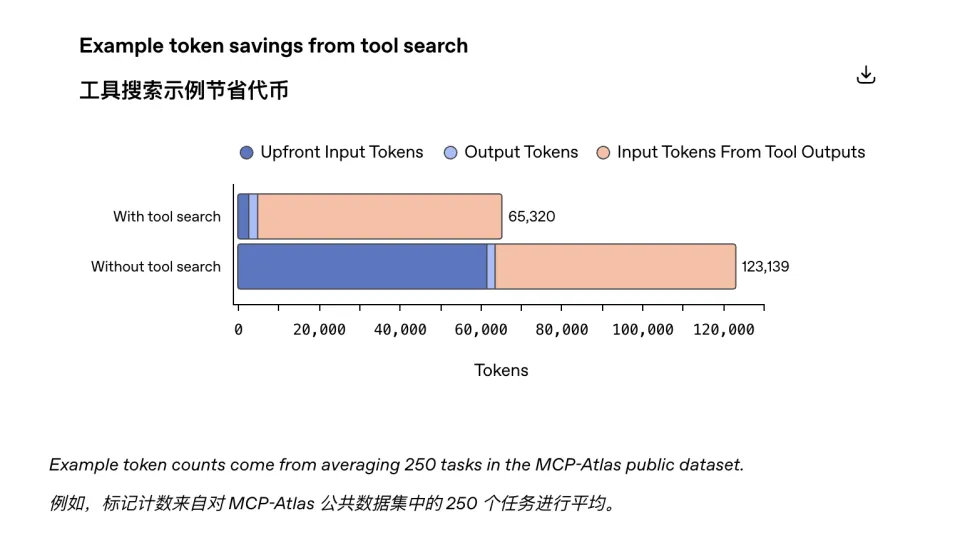

此外,GPT-5.4 引入了 Tool Search 机制,解决了工具调用的老大难问题。

以前给模型配工具,所有工具的定义都要塞进 prompt 里。工具一多,光定义就吃掉上万 token,又贵又慢。

现在 GPT-5.4 只需要一个轻量的工具列表。需要用哪个工具时,模型会自己去查找那个工具的定义,临时加载。这样做还有个好处:保护了缓存,让请求更快更便宜。

OpenAI 用 MCP Atlas 基准测试做了验证:36 个 MCP 服务器全部启用,Tool Search 模式比传统模式减少了 47% 的 token 消耗,准确率不变。

对于那些动辄几万 token 工具定义的 MCP 服务器来说,这个提升非常实在。

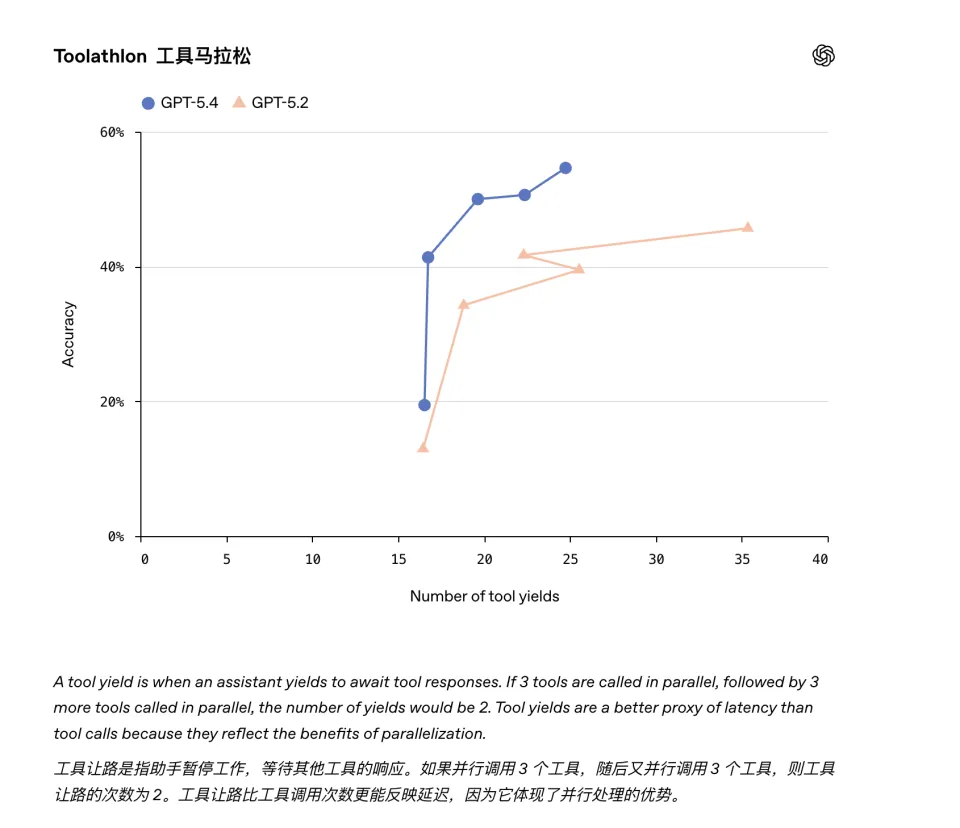

工具调用准确率也在提升。在 Toolathlon 测试中,GPT-5.4 得分 54.6%(GPT-5.2 为 45.7%),用更少的轮次达到更高的准确率。在 MCP Atlas 上,GPT-5.4 得分 67.2%(GPT-5.2 为 60.6%)。

最不会胡说

GPT-5.4 是 OpenAI 目前最不容易产生幻觉的模型。

跟 GPT-5.2 相比:

单条回答中的错误声明减少了 33%

整条回答包含任何错误的概率降低了 18%

在知识工作测试 GDPval 上,GPT-5.4 在 44 个职业的实际工作任务中,83.0% 的情况下达到或超过了行业专业人员的水平。GPT-5.2 只有 70.9%。

办公场景也明显提升:

投行分析师的电子表格建模任务:87.3%(GPT-5.2 为 68.4%)

PPT 制作:人类评审有 68% 的概率更喜欢 GPT-5.4 的版本,因为视觉更丰富、美感更强、图片运用更好

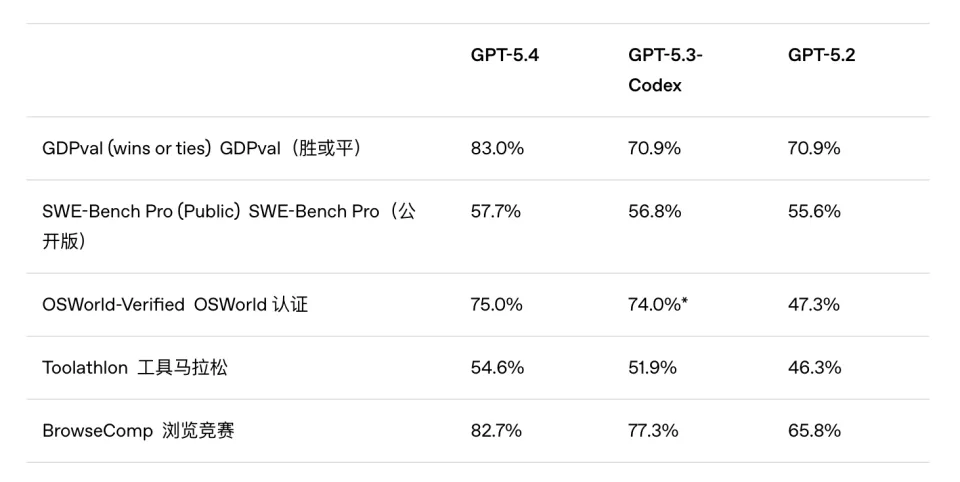

跑分一览

我们挑几个关键的来看下:

编程:

SWE-Bench Pro:57.7%(GPT-5.2 为 55.6%)

Terminal-Bench 2.0:75.1%(GPT-5.2 为 62.2%)

电脑操作和视觉:

OSWorld:75.0%(GPT-5.2 为 47.3%,人类 72.4%)

MMMU-Pro:81.2%(GPT-5.2 为 79.5%)

工具和搜索:

BrowseComp:82.7%(GPT-5.2 为 65.8%)

Toolathlon:54.6%(GPT-5.2 为 45.7%)

MCP Atlas:67.2%(GPT-5.2 为 60.6%)

学术和推理:

ARC-AGI-2:73.3%(GPT-5.2 为 52.9%)

FrontierMath Tier 4:27.1%(GPT-5.2 为 18.8%)

Humanity's Last Exam(带工具):52.1%(GPT-5.2 为 45.5%)

GPQA Diamond:92.8%(GPT-5.2 为 92.4%)

GPT-5.4 Pro 在多项测试中进一步拉高上限:ARC-AGI-2 达到 83.3%,BrowseComp 达到 89.3%,Humanity's Last Exam 达到 58.7%,FrontierMath Tier 4 达到 38.0%。

安全机制

GPT-5.4 被列为 OpenAI Preparedness Framework 下的「高网络能力」等级(与 GPT-5.3-Codex 相同),部署了对应的保护措施:

扩展的网络安全防护栈,包括监控系统、可信访问控制

对零数据留存(ZDR)平台上的高风险请求做异步拦截

减少了不必要的拒绝和过度谨慎的回答

OpenAI 还引入了一项新的开源评测:CoT Controllability,测试模型是否能故意隐藏自己的推理过程来逃避监控。结果显示 GPT-5.4 Thinking 做不到。这对安全来说是个好消息,说明思维链监控仍然是一个有效的安全工具。

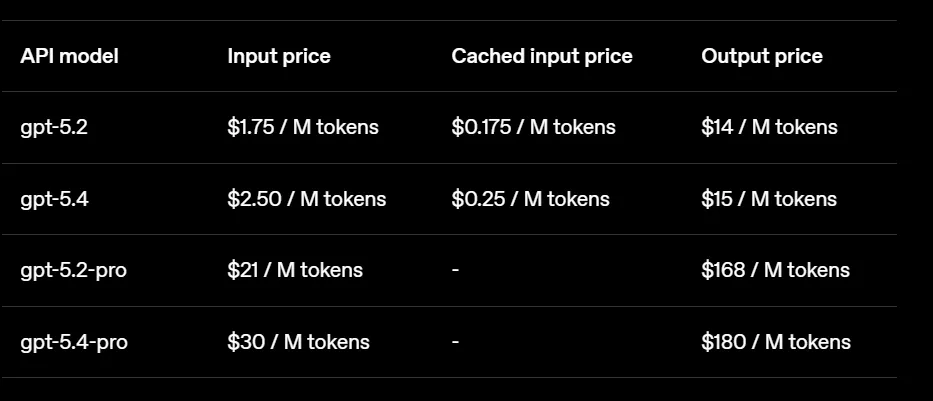

价格

API 定价对比:

| GPT-5.4 | $2.50/M | $0.25/M | $15/M |

| GPT-5.4 Pro | $30/M | — | $180/M |

单价比 GPT-5.2 贵了一些,但由于 token 效率提升,很多任务的总成本反而会降低。

Batch 和 Flex 定价半价,Priority 加速处理 2 倍价。

谁能用

ChatGPT 方面,GPT-5.4 Thinking 即日起向 Plus、Team、Pro 用户开放,替代 GPT-5.2 Thinking。Enterprise 和 Edu 用户可通过管理员设置开启早期访问。

GPT-5.2 Thinking 将保留三个月,6 月 5 日正式退役,期间可在 Legacy Models 中找到。

GPT-5.4 Pro 面向 Pro 和 Enterprise 用户。

API 方面,模型 ID 分别是 gpt-5.4 和 gpt-5.4-pro,现已可用。

OpenAI 表示,未来 Instant 系列和 Thinking 系列模型会以不同的节奏各自演进。

好了,这次又轮到 OpenAI 了:

🔥 最后提醒:时间不等人尽快体验!你最想用AI解决什么问题?

购买这个账号有售后,可以承诺大家如果是套壳不是官方号,可以全额退款,另外系统稳定,不用担心中途封号或者用不了,老客户续费率基本可以达到98%以上

扫码备用,急用找不到

现在购买送活动:一季度送一个月,包年送半年 ~

GPT 5.3 Q&A 常见问题

我们对接是OpenAI官网的账号,给大家打造了一个一模一样ChatGPT5.4,很多粉丝读者朋友现在也都通过我拿这种号,价格不贵,关键还有售后。

一句话说明:用官方一半价格的钱!用跟官方 ChatGPT 5.4一模一样功能,无需魔法,无视封号,不必担心次数不够。

最大优势:可实现会话隔离!突破限制:官方限制每个账号使用 GPT 5.4 次数,本网站可实现次数上限之后,手动切换下一个未使用的账号【相当于一个GPT 5.4 帐号,同享受一百个账号轮换使用权限】

早用早享受效率飞升的快乐~ 赶紧转发给身边需要的小伙伴,一起解锁AI助力的躺赢职场吧!

夜雨聆风

夜雨聆风