2026年了,本地AI早就不是只有极客才能玩的东西。

随着Ollama、LM Studio、vLLM等工具越来越成熟,再加上量化技术的突破,现在几乎任何一台电脑都能跑AI大模型。但很多同学还是不确定:我的电脑到底能不能跑?能跑多快?该选什么模型?

今天就用一张表,帮你彻底搞明白这件事。

先说结论:你的电脑大概率能跑AI

别被"大模型"这个词吓到了。

现在的模型早就不是必须4090显卡才能跑的时代了。核心原因有两个:

第一,量化技术成熟了。 通过降低模型精度(从16位降到4位甚至2位),模型体积可以压缩到原来的1/4甚至1/8。一款14B的模型,量化后只需要7GB左右显存,3060就能跑。

第二,CPU也能跑了。 llama.cpp等工具把推理优化到了极致,现在用纯CPU跑轻量模型已经完全可用。虽然没有GPU快,但至少能跑。

所以结论很直接:2026年,几乎所有电脑都能跑本地AI,只是体验有差别。往下看,找到你的配置对应的那一档。

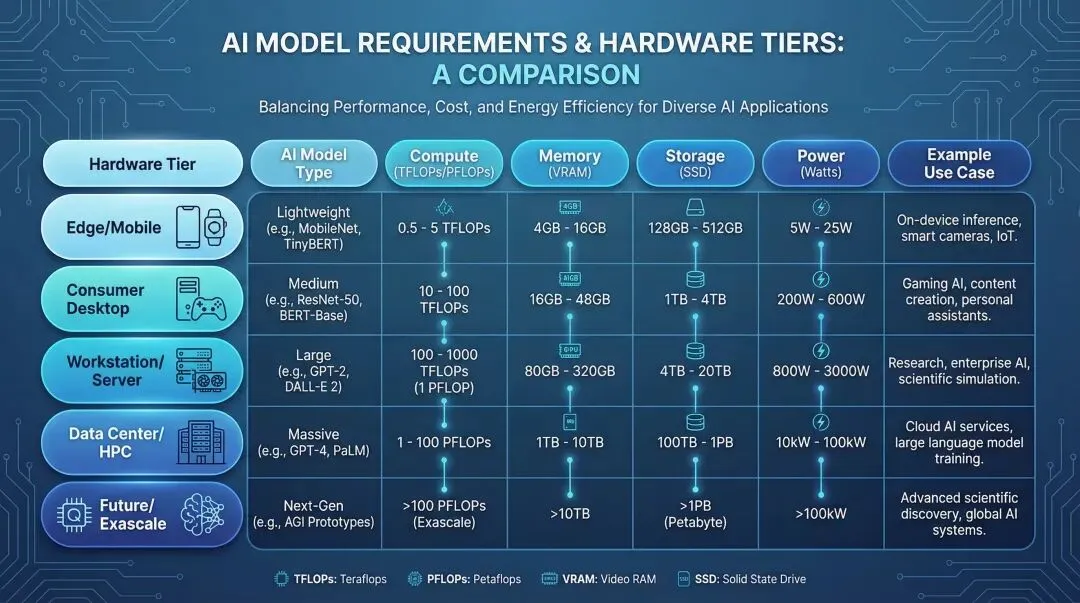

一张表看懂:你的配置能跑什么模型

|

详细解析:各配置怎么选

1. 办公本/老电脑(无独显)

典型配置:Intel集显 / AMD Vega集显 / MacBook Air M1-M3 / 8GB内存轻薄本

能跑的模型:

Qwen2.5-0.5B(最轻量,几乎任何电脑都能跑) Qwen2.5-1.5B Phi-3.5-mini Gemma-2B

体验如何:

响应速度:每秒2-5个token(一秒蹦一两个字) 适合场景:体验AI对话、简单问答、写短文案 内存占用:约2-4GB 注意:CPU会满载,风扇可能比较响

推荐工具:

Ollama(最简单,一行命令安装,macOS/Windows/Linux全支持) LM Studio(带图形界面,新手首选) LocalAI(更轻量,适合老电脑)

实操命令:

# 安装Ollama后,一句话就能跑ollama run qwen2.5:0.5b

一句话评价: 能跑,但别指望当生产力工具。用来体验AI对话、测试Prompt倒是完全没问题。

2. 普通游戏本(RTX 3060 8GB / 16GB内存)

典型配置:RTX 3060 8GB、i5-11400F / R5-5600、16GB内存

能跑的模型:

Qwen2.5-3B(原生流畅) Qwen2.5-7B(Q4量化) Llama3-8B(Q4量化) DeepSeek-R1-8B(Q4量化)

体验如何:

响应速度:每秒10-20个token 适合场景:日常问答、简单文案、辅助编程 显存占用:约3-5GB 还能同时开其他软件

推荐工具:

Ollama + OpenWebUI(最稳定) LM Studio(Windows首选,界面友好)

一句话评价: 入门级配置,能用但别期望太高。当生产力工具稍微吃力,但日常用用完全够了。

3. 游戏本主流(RTX 3060 12GB / 16GB内存)

典型配置:RTX 3060 12GB、i5-12400F / R5-7600、16GB内存

能跑的模型:

Qwen2.5-7B(流畅) Llama3-8B(流畅) Qwen2.5-14B(Q4量化) DeepSeek-R1-14B(Q4量化)

体验如何:

响应速度:每秒15-25个token 适合场景:写代码、改简历、做文案、回答专业问题 显存占用:约4-7GB

进阶玩法:

可以同时跑两个小模型 能加载更大的上下文(32K) 适合当日常AI助手

一句话评价: 主流配置,性价比之选。绝大多数普通用户这个配置就够了。

4. 游戏本进阶(RTX 4070 / 16GB显存 / 32GB内存)

典型配置:RTX 4070 Super / RTX 4070 Ti、i7-13700K / R7-7800X3D、32GB内存

能跑的模型:

Qwen2.5-14B(流畅) Qwen2.5-32B(Q4量化,流畅) Llama3-70B(Q4量化) DeepSeek-R1-14B(流畅) DeepSeek-R1-32B(Q4量化,较流畅)

体验如何:

响应速度:每秒25-40个token 适合场景:长文写作、代码开发、多轮对话、复杂推理 显存占用:约8-16GB 还能同时开浏览器、IDE等

推荐工具:

Ollama + OpenWebUI(平衡易用和性能) vLLM(追求极致推理速度,显存利用率更高)

vLLM安装和使用:

# 安装vLLMpip install vllm# 运行模型python -m vllm.entrypoints.openai.api_server --model qwen/Qwen2.5-14B

一句话评价: 性价比之王,普通人的最优解。这个配置能覆盖90%以上的使用场景。

5. 全尺寸畅玩(RTX 4090 / 24GB+显存)

典型配置:RTX 4090 / RTX 5090、i9-14900K / R9-7950X3D、64GB内存

能跑的模型:

Qwen2.5-72B(Q4量化) DeepSeek-R1-32B(流畅) Llama3-70B(流畅) 绝大多数开源模型的全尺寸版本

体验如何:

响应速度:每秒50-100+token,接近云端体验 适合场景:高强度开发、专业写作、复杂推理、微调训练 显存占用:约20-24GB 可以同时跑多个模型

推荐工具:

vLLM(高性能推理首选) llama.cpp(灵活度高) Ollama(最省心)

进阶玩法:

24GB显存可以跑Qwen2.5-72B Q4量化,体验已经非常接近云端 可以本地微调小模型 搭建多人共享的AI服务

一句话评价: 土豪选择,开发者标配。一步到位的配置。

6. 服务器/工作站级(多卡集群)

典型配置:多张A100/H100 / 多张4090、128GB+内存

能跑的模型:

任何开源模型,包括405B、460B级别的巨无霸 可以本地跑GPT-4级别模型(通过API接入)

适合场景:

企业级应用 高并发服务 模型微调和训练

一句话评价: 一般人用不到,土豪随意。

7. Mac用户特别说明

MacBook Pro M3/M4系列(统一内存32GB+):

统一内存架构很强,32GB版本可以跑Qwen2.5-14B Metal加速,推理速度比同等配置Windows本更快 实测:M3 Max 64GB跑Qwen2.5-14B约18-22 token/s

MacBook Pro M1/M2系列:

16GB内存版:能跑7B模型,16GB以上能跑14B Metal加速效果不错

MacBook Air M1-M3:

跑7B模型勉强可以,但散热压力大 推荐跑1.5B-3B轻量模型 实测:M3 16GB跑Qwen2.5-3B约8-12 token/s

iMac/Mac Studio:

M1 Max/M2 Max/M3 Max统一内存48GB以上,可以跑14B甚至32B 比MacBook散热更好,持续性能更强

Mac用户推荐工具:

Ollama(官方支持,macOS体验最丝滑) LM Studio(也有Mac版本) llama.cpp(自己编译可启用Metal加速)

特别提醒: Mac的统一内存是显存+内存共用的,所以看"统一内存"大小而不是传统意义上的"显存"。

关键概念:量化是什么?

看到表格里的"Q4_K_M"之类的标注了吗?这就是量化版本。这是让低配置电脑也能跑大模型的核心技术。

什么是量化?

简单说,模型原本用FP16(16位浮点数)存储,一个参数占2个字节。量化就是把它压缩成8位、4位甚至2位,体积成倍缩小。

量化等级一览

| FP16 | ||||

| Q8_0 | ||||

| Q6_K_M | ||||

| Q5_K_M | ||||

| Q4_K_M | ||||

| Q3_K_M | ||||

| Q2_K |

普通人怎么选?

记住一点:选Q4_K_M或Q5_K_M版本就对了。

这两个版本体积小、效果95分以上、绝大多数配置都能跑。是目前最主流的选择。

例外情况:

显存特别充裕(24GB+):可以选Q6_K_M或Q8_0,效果更好 显存特别紧张(4GB以下):只能选Q2_K或Q3_K_M,能跑但效果一般

常见问题解答

Q1:我的电脑是5年前的,还能跑吗?

能跑。试试Qwen2.5-0.5B或1.5B。只要不是太老的电脑(10年以上),跑轻量模型都没问题。

Q2:内存和显存到底看哪个?

- 有独显的电脑

:主要看显存 - 没有独显的电脑

:主要看内存(CPU推理会占用内存) - Mac统一内存电脑

:看统一内存大小

Q3:跑AI需要联网吗?

本地模型完全离线可用!这是本地部署的最大优势——数据不出本地,隐私安全。

Q4:电费会不会很高?

基本可以忽略。跑本地AI的功耗比玩游戏低多了。一台普通电脑跑一整天也就几度电。

Q5:跑起来电脑会不会很烫?

CPU或GPU会发热,这是正常的。建议:

笔记本用户准备散热底座 长时间跑准备外接散热 可以适当调低模型参数

Q6:Windows和Mac哪个跑得快?

同等配置下:

- Mac用Metal加速

:通常比Windows快10-20% - Windows用CUDA

:兼容性更好,驱动更成熟 实际体验差别不大,选自己习惯的系统就行。

怎么查自己的配置能跑什么模型?

推荐一个神器:llmfit

这是一个终端工具,能自动检测你的硬件配置,推荐适合的模型,评估运行速度。

使用方法:

# 安装pip install llmfit# 运行llmfit

它会分析你的CPU、内存、显存,然后告诉你能跑哪些模型、预估速度。非常适合不确定自己配置能跑什么模型的小白用户。

另一个选择是直接去Ollama官网的模型页面,每个模型都有标注需要多少显存。

总结与推荐

最后说几句:

本地AI的意义不只是"能跑",而是数据不出本地、零API成本、随时可用。

2026年了,别再说"我的电脑跑不了AI"——它只是需要选对模型。

你的下一台电脑,不一定要更贵,但一定要能跑AI。

夜雨聆风

夜雨聆风