创始人Peter给OpenClaw发了条语音:

“帮我看看这张图,翻译一下。” 10秒后,OpenClaw搞定了。

但Peter根本没为这个功能写过代码。

AI自己调用开源工具转换音频,自己找API转写文字,自己完成了整个流程。

一个AI,在没被明确指令的情况下,自己想办法解决了问题。

这就是OpenClaw的起点。

02 你的电脑里住着一个"员工"

OpenClaw是一个开源的个人AI Agent。它能做什么?控制你的电脑,做任何你能做的事。

写文档?没问题,它能打开Word自己写。 发邮件?它能操作邮件客户端。 预订餐厅?它可以直接调用餐厅的预订系统。 甚至—它能控制你家的智能设备:空调、灯光、Sonos音响。

关键在于:它运行在你的本地电脑上。

这和其他AI助手完全不同。以前的AI都住在云端,能做的事情有限。OpenClaw能访问你电脑上的每一个文件、每一个应用、每一个工具。它就像一个24小时待命的数字员工,永远不会累,永远不会请假。

Peter说:“80%的APP可能会消失。”

为什么还需要健康记录app?你的Agent知道你吃了什么、做了什么运动,它会自动帮你记录。为什么还需要待办事项APP?你告诉Agent一句"提醒我明天下午开会",它就记住了。

从"人找应用",变成"应用找人"。

03 一个令人警醒的事实

看数据

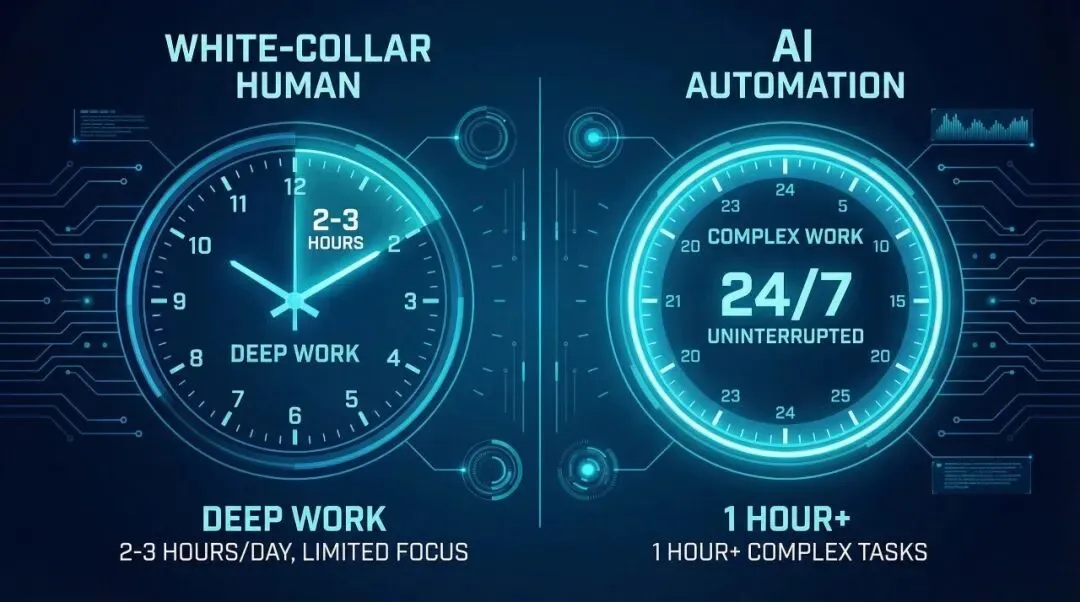

METR研究显示:GPT 5.2和Claude 4.6已经能完成超过1小时的复杂认知工作,成功率超80%。

普通白领一天能深度工作的时间是2到3小时。AI现在能做到和普通白领一样的水平,而且它可以24小时不间断。

更可怕的是能力增长的速度。AI的"工作时长"每6个月翻一倍。预计明年,一个AI能连续工作4小时以上。

这是超人的工作能力。

04 为什么这次真的不一样

AI不是第一天出现。但为什么这次是认真的?

看技术演进

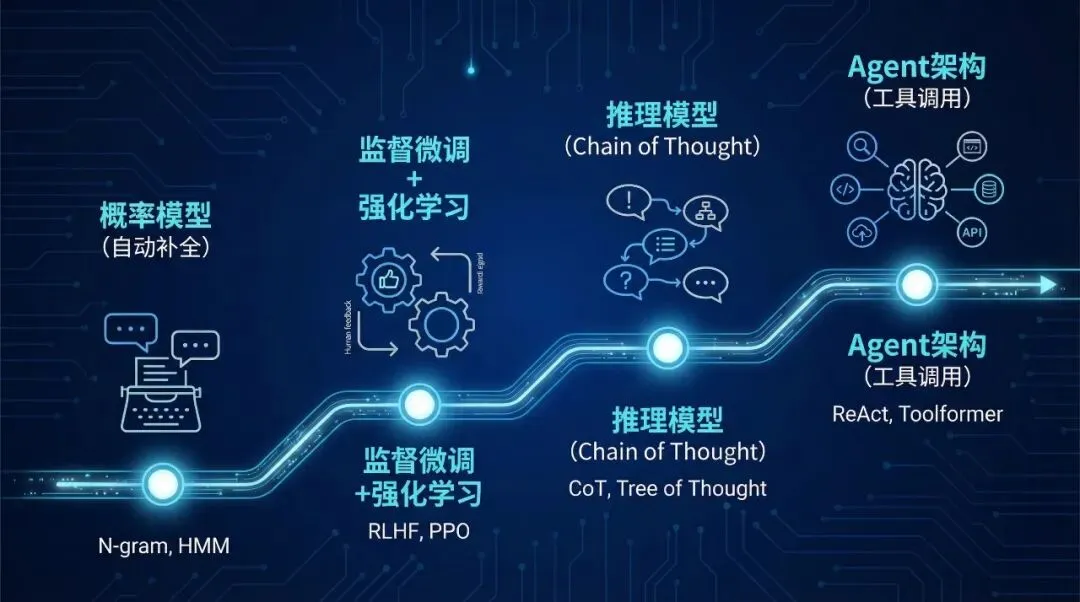

五年前的AI就是一个概率模型。你给它"Mary had a little",它猜下一个词是"lamb"。本质是个高级自动补全。

后来有了监督微调、强化学习。AI自己生成问题,自己评估答案,自己进化。人类逐步退出,AI训练下一代AI。

然后是推理模型。Chain of Thought让AI学会"分步思考"。

最后是Agent架构。AI不仅可以回答问题,还可以调用工具、规划步骤、在执行中学习。

关键跨越:从"能回答问题"到"能完成工作"。

05 Bot与Bot的协作时代

OpenClaw展示了一个更远的未来:Bot和Bot协作。

你的Agent可以给另一个人的Agent发消息、谈判、订餐。

比如我想订餐厅,我的Bot直接联系餐厅的Bot完成预订。但如果是一家老餐厅,Bot搞不定怎么办?

我的Bot可以雇一个人类来完成这个任务,然后付钱。

这就是"众包"的终极形态:AI调度人类来完成它做不到的事。

06 什么能力AI永远无法替代

说了这么多,不是为了制造焦虑。

而是让你看清:什么该交给AI,什么必须自己掌握。

Dan Koe提了一个概念叫"Swap Test":如果把创作者和作品分开,作品还能保持价值吗?

一个通用的照片,换个人拍没问题。AI也能生成。 但一个知名摄影师的作品,换个人拍,价值完全不同。

因为价值不在于"做了什么",而在于"谁做的"。

AI永远无法替代的,是这四样:

1.视角:AI可以分析"从第一人称移民视角看创意职业是什么体验",但它不能从这个视角思考。它没有信念、没有经历、没有伤口。

2.能量感:两个人写同一篇文章,读起来感觉完全不同。AI可以模仿风格,但模仿不了"在乎"。

3.意义建构:AI可以处理信息,但它不能决定什么重要。这个优先级判断,需要立场、需要 stakes。

4.轨迹:你有过去、现在、未来,有一个故事弧线。AI没有。它没有生命长度,没有"这次不同"的感觉。

07 现在该怎么办

Dan Koe说:“去上学,找个工作,65岁退休。这条路已经结束了。”

不是让你躺平。而是让你意识到:默认路径已经变了。

「用AI放大你的能力,而不是替代你的思考。

AI可以帮你写东西,但只有你知道要写什么。

AI可以帮你做研究,但只有你知道什么问题值得问。

AI可以帮你执行,但只有你知道什么是值得执行的。」

未来最值钱的,不是最会回答的人,而是最会提问的人。 不是最会做事的人,而是最知道什么值得做的人。

你的AI员工已经到位了。问题是—你知道让它做什么吗?

我们正在持续追踪OpenClaw的最新动态和实操案例。感兴趣的朋友,欢迎进群交流,一起探讨OpenClaw的实战经验。

夜雨聆风

夜雨聆风