前言

很多人都想在电脑本地运行 AI 模型,不过并不是所有人都清楚自己的电脑到底适合运行多大参数的模型。

参数太高,运行速度就会变慢;参数太低,用起来又会感觉有点“笨”。

而且很多人也不知道该怎么测试才比较准确。

如果正好被这个问题困扰,可以试试这款 llmfit 开源工具,只需要一秒,就能判断出电脑硬件适合运行哪些 AI 模型。

详细介绍

Windows 和 Mac 都可以用,而且支持市面上绝大多数开源模型。

llmfit 介绍和操作教程

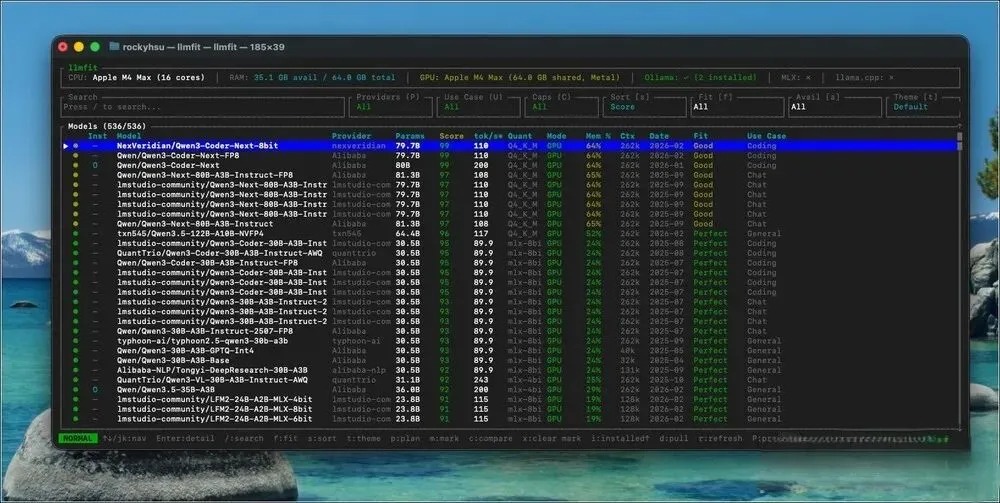

llmfit 是一款终端工具,会自动检测电脑的硬件配置,包括 CPU 核心数量、系统内存、GPU 型号以及 VRAM,然后把这些信息和数据库里的数百个 AI 模型进行比对,计算出哪些模型最适合在电脑上运行。

和普通只列出模型列表的工具不同,llmfit 会对每个模型进行多维度评分,比如模型质量、推理速度、内存使用效率以及上下文长度等,最后综合成一个评分,并按照适合程度进行排序。

这样一来,就可以很快知道应该选择哪些模型,大幅减少挑选模型所花的时间。

另外,llmfit 还提供了交互式 TUI(Terminal UI)界面,在终端里也能像操作应用一样浏览模型信息、搜索模型、排序或筛选条件,甚至可以直接下载模型。

同时它还支持 Ollama、llama.cpp、MLX 等本地 AI 运行环境,让模型管理和部署变得更方便。

主要特点

自动检测硬件环境:会自动分析 CPU、RAM、GPU 型号以及 VRAM,判断电脑能运行的模型范围。

智能推荐 AI 模型:内置数百个 AI 模型数据库,根据硬件条件推荐最适合的模型。

多维度模型评分系统:根据模型质量、速度、内存使用效率以及上下文能力进行综合评分。

交互式终端界面(TUI):在终端中提供类似 GUI 的操作体验,可以搜索、排序并查看模型详细信息。

支持多种本地 AI 运行环境:可以和 Ollama、llama.cpp、MLX 等常见本地 AI 平台一起使用。

支持模型下载与安装:可以直接在工具里下载模型,并整合到本地 AI 运行环境。

打开上方链接进入 llmfit 下载页面之后,选择适合操作系统的版本。这里使用的是 M 系列 Mac,所以选择第一个版本。

如果是 ARM 架构的 Windows,可以选择 aarch64 开头的版本;Intel 或 AMD 的电脑则选择 x86 开头的版本。

解压之后会看到三个文件,双击打开 llmfit。

Mac 版本可能会提示“无法验证开发者,因此无法打开”。

这时候可以打开“设置” → “隐私与安全性”,在右侧安全性区域里会看到“强制打开”的按钮。

接着点击“强制打开”,并输入系统登录密码。

之后就可以正常打开了。界面看起来可能有点复杂,但实际上操作起来还是很简单的。

下方列出的就是所有支持的模型,目前大约有 536 个。每个模型都会标注提供者、参数规模、评分、Tok/s、发布日期、Fit 程度以及用途(Use Case)等信息。

因为模型数量比较多,找起来可能会有点麻烦。如果已经有比较喜欢的模型,建议直接搜索会更快。

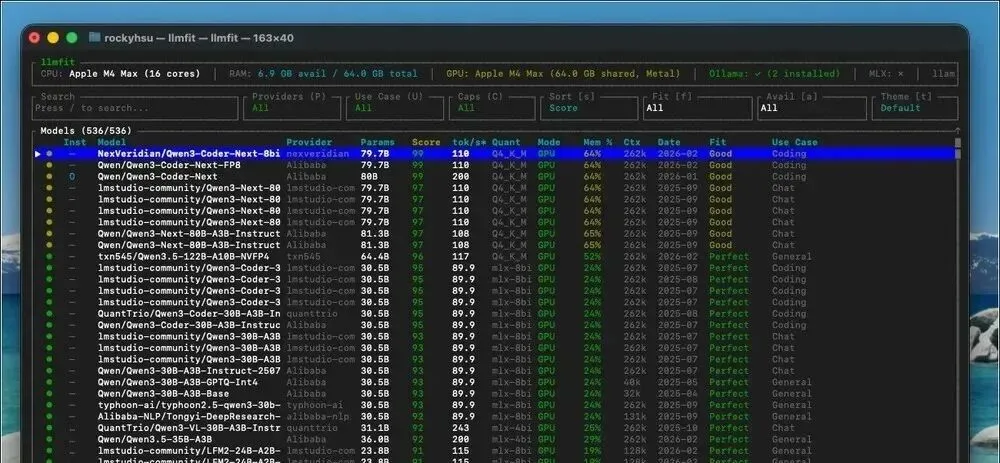

按下键盘上的 /,就可以在左上角的 Search 搜索框输入关键词。比如输入 qwen3.5,下方就会显示对应结果。

这时候就可以通过右侧的评分、Fit 程度以及用途,快速判断哪个参数规模的 AI 模型在电脑上运行更顺畅。

以 qwen3.5 为例,参数最大的 64.4B 版本也可以运行(Qwen3.5-122B-A10B-NVFP4),评分达到 96,Fit 显示为 Perfect。

而参数更大的 125.1B 版本 Qwen3.5-122B-A10B 就无法正常运行,Fit 会用红色标注为 Too Tight。

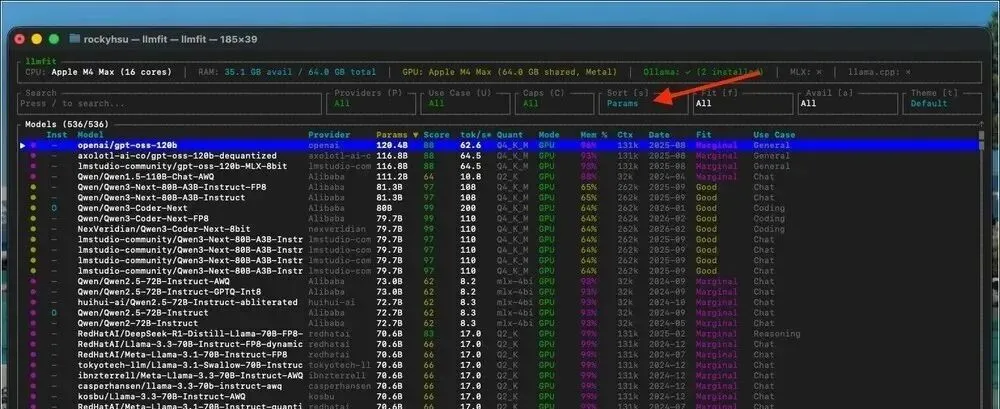

如果没有特别想找的模型,想从大参数模型开始筛选,可以按 s 切换排序方式。

切换到 Params 后,就会按照模型参数从大到小排列,同时也会自动过滤掉完全无法运行的模型。

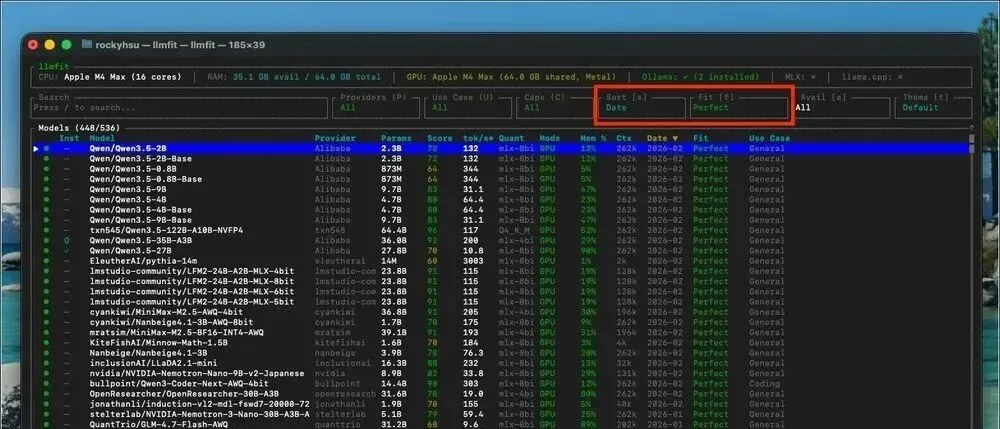

按 s 把排序方式切换为日期,然后再按 f 设置只显示 Fit 为 Perfect 的 LLM 模型。这样一来,下方就会列出所有在电脑上可以顺畅运行的模型。

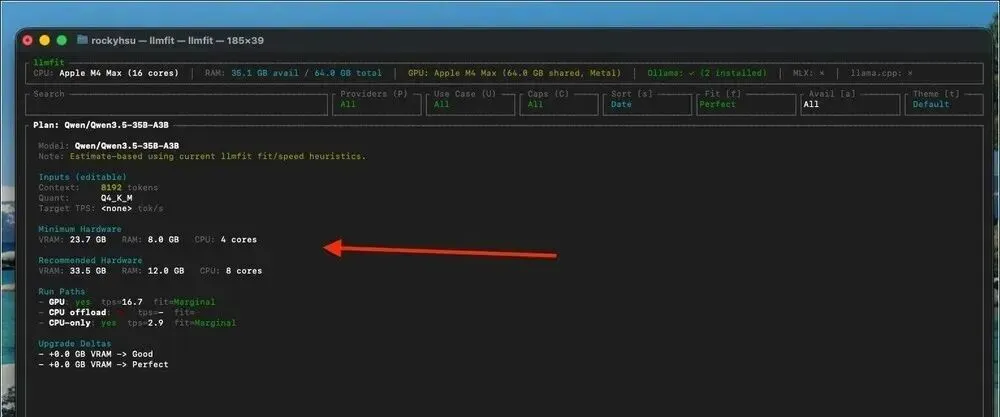

按 P 还可以查看该模型的详细信息和硬件需求。

为小妹转发和点赞

如果您喜欢小妹的分享,请点击文章末尾的点赞、分享、在看,这对您来说不会花费太多时间,但是对小妹的成长有很大的帮助,谢谢您的支持!

夜雨聆风

夜雨聆风