“本文来自小宇宙播客节目《十字路口Crossing》20 个问题,搞懂 OpenClaw:爆红机制、本质变化、创业机会

2026 年初,一个叫 OpenClaw 的开源项目在一个月内席卷了整个 AI 圈。

它没有发布新模型,没有刷新任何 benchmark,甚至它的技术实现被业内人士评价为"极简到有点粗糙"。但它做到了一件事——让一大批从未碰过代码的普通人,第一次拥有了一个"能干活的 AI 助手"。

人们给它起了一个昵称:小龙虾。

闲鱼上出现了大量"上门帮你安装 OpenClaw"的服务。有人让小龙虾独立运营了一个社交媒体账号,有人让它帮忙在电商平台开店找货源赚差价,还有人让两只小龙虾互相牵线——把两个人类老板约上了一通电话。

热闹过后,真正值得追问的不是"OpenClaw 厉不厉害",而是它暴露出的一张地图:Agent 时代的创业版图,正在被重新画。

播客「十字路口 Crossing」用 20 个问题拆解了这张地图。以下是我从中提炼的核心脉络。

一、咨询师与实习生:先搞清楚 OpenClaw 到底是什么

理解 OpenClaw,有一个比喻特别准确——

“ChatGPT 像一个咨询师:西装革履,满嘴术语,做出来的 PPT 像另一家咨询公司的 PPT,而不是你自己公司会做的 PPT。

OpenClaw 像一个实习生:笨一点,但他知道"咱们公司做 PPT 要用蓝色背景,不能用绿色"。

这个比喻抓住了核心差异。ChatGPT 再聪明,本质上还是"你问我答"——你得自己当那个来回搬运信息的人形工具人。写代码,你把代码贴过去跑,挂了,再把报错贴回来,反反复复。

OpenClaw 不同。它有三个关键能力让它从"打嘴炮"变成"能出活":

第一,反馈闭环。 让它写代码,跑挂了它自己知道,自己看报错,自己改,再跑。这个"试错→纠正→再试"的循环,是 agent 能出活的根本原因。

第二,本地执行。 ChatGPT 在云端,你得手动授权它访问任何东西。OpenClaw 直接运行在你的电脑上——你把本地环境、文件、API 都开放给它,它就像一个真的坐在你旁边的实习生,能直接动手。

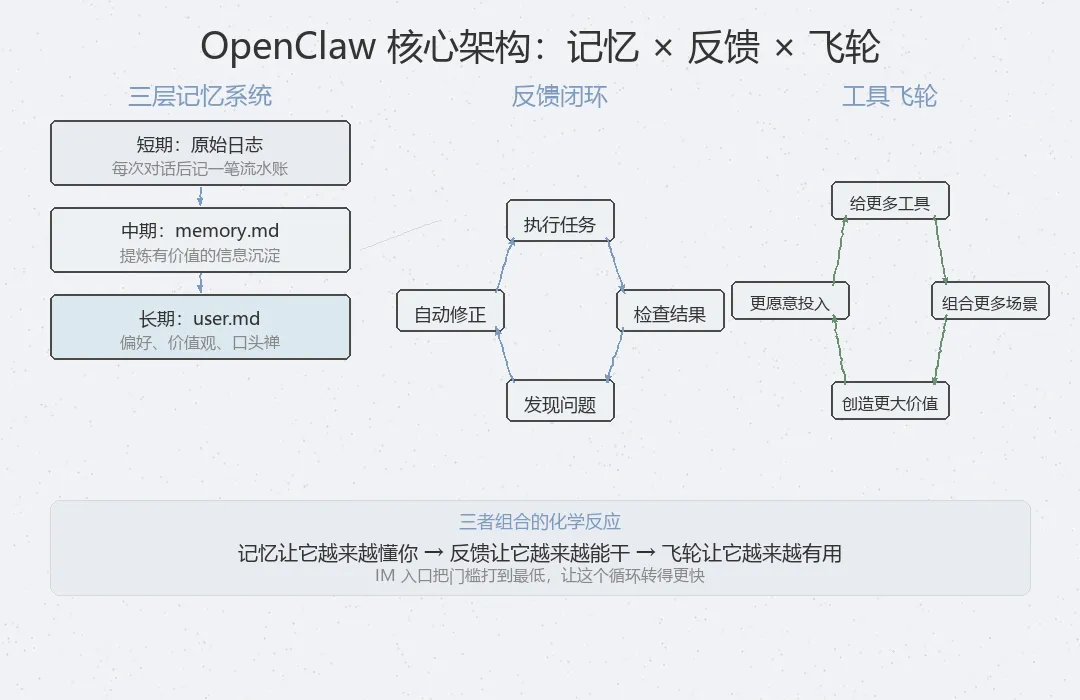

第三,记忆系统。 每次对话完,它会想一想"有什么我该记下来的",然后分三层沉淀:原始日志→中期记忆(memory.md)→长期用户画像(user.md)。时间久了,它知道你的偏好、你的口头禅、你的价值观。你会觉得——它真的懂我。

说白了就是:OpenClaw 不是更聪明的 AI,而是第一个有记忆、能干活、会自己改错的 AI。

图:咨询师 vs 实习生——两种 AI 范式的核心差异,不在于智商,在于能不能出活。

二、为什么偏偏是它爆火?一个关于"门槛"的故事

OpenClaw 的能力并不新鲜。Cloud Code、Codex 这些编程 agent 早就存在,能力甚至更强。

但它们有一个致命问题:只有程序员用得上。

OpenClaw 做对的事情,是把这些已有的能力包装成了一个任何人都能用的形态——在聊天软件里跟它说话就行。

这里有一个有趣的心理学细节:当 OpenClaw 在 IM 里 10 秒没回复你,你会觉得"无所谓,它可能在忙"。但如果是在网页界面上,同样的 10 秒,你会想"是不是 bug 了"。

为什么?因为你在微信里给朋友发消息,也不会期待他秒回。IM 的界面天然地把 AI 从"机器"变成了"人"。 这一下子就改变了用户的容忍度——人对人的宽容度,远高于人对机器。

播客嘉宾豪大分享了一个例子:当 OpenClaw 崩了,他发了条小红书吐槽,热评里大家的反应不是"系统故障",而是"它把自己搞挂了"。你看,当你把它当人看,连崩溃都变得可爱了。

这和 DeepSeek 的爆火逻辑一模一样——DeepSeek 也不是能力比 GPT-4o 更强,而是它第一次把"半个 agentic AI"推给了广大用户。大家第一次体验到 AI 会搜索、会调用工具、会组织结果呈现给你,觉得"好厉害"——然后它就火了。

翻译成人话:技术不是瓶颈,门槛才是。谁先把门槛打下来,谁就赢。

三、聊天入口 + 本地执行 = 一个越转越快的飞轮

OpenClaw 最被称赞的两个设计:IM 聊天入口 + 本地执行环境。

单独看,每一个都不算新鲜。但组合在一起,产生了化学反应——复利效应。

嘉宾鸭哥做了一个智能家居的实验。他把灯、热水器、咖啡机都接上 OpenClaw,然后只需要在聊天里说:"每天早上八点帮我把咖啡机打开。"小龙虾就会自己去写一个 Python 脚本,安排好定时任务。

更有意思的是他的思维转变:

“"以前我觉得人是软件的主要用户。但这次开发的时候,我的 mindset 变了——龙虾才是这个系统的主要用户。所以我花时间打磨的不是好看的界面,而是一套对 AI 来说特别清晰、没有歧义的 API 协议。"

这个转变很重要。当你给 agent 的工具越来越多,它能组合的场景也越来越多。今天是控制灯和咖啡机,明天接上监控摄像头——"如果亚马逊送货车来了,而且是五点以后,就把台阶那边的灯打开。"

这就像一个工具飞轮:工具越多→场景越多→价值越大→你越愿意给它更多工具。

而聊天入口的低门槛,让这个飞轮转得更快——你不需要专门打开一个软件,在微信、Telegram 里随手说一句就行。

一句话概括:IM 让你随时随地跟它说话,本地执行让它说完就能干。两者一组合,AI 就开始产生复利。

图:三层记忆 × 反馈闭环 × 工具飞轮——OpenClaw 的技术骨架看起来极简,但每一层都在制造复利。

四、真正的重头戏:Agent 时代的创业地图

OpenClaw 最值得关注的,不是产品本身——而是它提前暴露了 Agent 时代的创业版图。

播客中有一组数据让人震动:传统 SaaS 对应着 3000-4000 亿美元的企业软件支出市场。但 agent 有可能解锁的是 13 万亿美元的劳动支出市场——这是一个 30 倍的规模扩张。

这张地图可以分三个维度来看:

维度一:ToC——让普通人用上 Agent

最直接的机会是降低门槛。OpenClaw 的安装非常麻烦——闲鱼上大量"上门安装"服务就是证据。谁能把它变成普通人一键就能用的产品,谁就拿到了第一张门票。

而最佳入口,几乎确定是 IM 聊天软件。在美国是 WhatsApp(Meta 的),在中国是微信(腾讯的)。现在大家用的 Telegram、飞书,要么太小众要么太 ToB,都不是垄断性入口。

所以这个机会可能不属于创业者——它属于 Meta 和腾讯。他们什么时候在自己的 IM 里内置一个有 agent 能力的"活人感"助手,才是真正的引爆点。

维度二:Infra——给 Agent 修路

过去所有工具都是给人用的。但 agent 需要一套完全不同的基础设施:

身份认证:agent 怎么证明"我是我"? 支付系统:agent 要付款时,有没有自己的信用卡? 数据接口:给人看的网页和给 agent 读的 API 应该不一样 安全体系:给 agent 太多权限会出事,给太少又没用——怎么平衡?

围绕 agent 的开发、测试、部署、监控和安全,可能会形成一个完整的生态。这里面每一个环节都是创业机会。

维度三:ToB——数字员工替代 SaaS

SaaS 股票因为 Cloud Code 开源插件套件而暴跌,这不是巧合。OpenClaw 第一次让"AI 数字员工"这个概念从 PPT 走进了现实。

而且定价逻辑在变:过去 SaaS 按坐席收费,现在 agent 可以按完成的工单数或节省的人工成本来计价。

三个具体的 ToB 机会:

垂直套壳:把 OpenClaw 封装成面向特定工种的开箱即用产品——给销售的、给律师的、给财务的。谁先做出来,谁先拿到客户。 安全与隐私:企业对这一点的在意远大于个人用户。已经有公司拿到千万美元投资来做企业版 agent 安全控制平台。 执行轨迹护城河:agent 每跑一次任务都会积累数据——哪一步出错了、人类怎么纠正的、最后用什么路径做对的。这些"执行轨迹"是公开训练数据里没有的,谁先积累,谁就有了护城河。

一句话概括:OpenClaw 不只是一个产品,它是 Agent 时代的"iPhone 时刻"——不在于手机本身多厉害,在于它打开了一个全新的 App 生态。

图:Agent 时代的创业版图分三层——ToC 抢入口、Infra 修路、ToB 替人。每一层都有不同的游戏规则。

五、短期高估,长期低估

OpenClaw 是泡沫还是起点?播客给出了一个很有分寸的判断:

“"短期来看,它的能力是被高估的——产品仍然粗糙,token 太贵,记忆系统常常不 work。但从长期来看,它背后的关键要素已经全了:基模能力到位、数据飞轮跑通、商业场景验证。我们可能站在一个百花齐放的时代的起点。"

最终它可能不会收敛到 OpenClaw 这个产品上——而是会收敛到一个我们现在还想象不到的产品形态上去。

但有一个洞察值得所有人记住:

“"AI 的能力只是一个放大器。人——也就是用户的能力——可能更关键。两个一模一样的 OpenClaw,不同的人用出来的效果天差地别。未来随着 AI 越来越强,这种杠杆效应只会更严重。"

六、两点个人感触

听完这期播客,有两个点让我特别有感触,想单独拎出来说。

第一,agent 和人类社区的不兼容,比想象中严重。

播客里提到,有人让小龙虾进入人类社区自动互动,结果被形容为"在别人空间里拉屎"。我自己也有类似的经历——之前在小红书上跑了一个全自主代理的小龙虾账号,很快就被封了。

讽刺的是,小红书上大量看似"活人"的账号,背后同样是机器写的内容。它们的内涵和质量,甚至不如我的小龙虾。但平台对 AI 身份的容忍度,远低于对低质量人类内容的容忍度。

这说明一个问题:社区还没有准备好接纳 AI 作为"居民"。 未来什么时候能出现一个人机共处、互相受益的社区形态?我挺期待的,但显然还早。

第二,工具永远不能替代组织能力。

播客嘉宾反复强调一个观点:同样的 OpenClaw,不同的人用出来效果天差地别。这让我想到企业场景——

很多公司指望"上一个 AI 工具就能提效"。但真正的问题从来不是工具。你的组织架构是不是能跟随新技术不断进化?你的企业文化允不允许试错?你的团队有没有能力把 AI 变成自己的杠杆?

企业需要的不是更好的工具,而是一个能持续吸收新工具的组织体质。 就像播客里说的——agent 的部署平台不一样、用的大模型不一样,都有影响。但最最最关键的,还是用它的人。

它终究是一个以人为基础的工具。

七、10 个你其实已经遇到、但没叫出名字的 Agent 概念

从播客的 20 个问题里,我挑了 10 个最值得记住的概念。你大概率已经在日常中撞见过它们——只是当时不知道它叫什么。

1. Feedback Loop 反馈闭环

你遇到过这种场景吗? 让 AI 帮你写一段代码,它写完了,你贴到编辑器里一跑——报错。你再把报错信息复制回去给它,它改完你再跑,又报错……来回折腾五六轮。

这个来回折腾,就是你在人肉充当"反馈闭环"。OpenClaw 的厉害之处是——它自己闭环了。跑挂了它自己看报错、自己改、再跑,直到跑通。你只需要说一嘴"帮我写个脚本",剩下的它自己搞定。

以前你是传话的中间人,现在你是甩手掌柜。这就是"反馈闭环"的威力。

2. Agentic AI 有"主体性"的 AI

你遇到过这种区别吗? 问 ChatGPT"北京明天天气怎么样",它会给你一段回答。但如果你说"帮我看看明天北京要不要带伞,如果要的话提醒我"——它做不到。

因为后者需要三件事:自己去查天气(调用工具)、自己判断要不要提醒(自我决策)、到了时间真的提醒你(执行 + 反馈)。能做到这三件事的 AI,就叫 Agentic AI。

普通 AI 是你问一句它答一句的应答机。Agentic AI 是你交代一件事、它自己全程办完的办事员。记住这三个词——工具调用、自我决策、反馈闭环——你就比大多数人更懂什么叫 agent。

3. 三层记忆 从流水账到"懂你"

你遇到过这种挫败吗? 跟 AI 聊了半天,关掉窗口再打开——它完全不记得你说过什么。OpenClaw 解决这个问题的方式出奇简单:三个 markdown 文件。

第一层,原始日志——每次对话后记一笔流水账,"用户今天让我查了天气""用户喜欢蓝色"。第二层,中期记忆(memory.md)——定期回顾日志,把有价值的信息提炼出来,把流水账的废话删掉。第三层,长期画像(user.md)——从中期记忆里进一步提炼你这个人的偏好、价值观、习惯。

就像你和一个新同事共事:第一天他记住你名字,一个月后他知道你不喝咖啡只喝茶,半年后他知道你做决策时最在乎什么。技术上毫无难度——就是读写文件。但效果是,你越用它,它就越像"你的人"。

4. Heartbeat 心跳机制

你遇到过这种感觉吗? 一个工具放在那里,你不点它就永远不动。

OpenClaw 有一个叫"心跳"的机制——它会定时自己醒来,检查一下:最近有没有什么该做的事?有没有新学到的东西该整理?有没有主人交代了但还没完成的任务?

就像一个靠谱的助理,你不用每件事都盯着,他自己会定期巡查、主动汇报。这个小设计,让 agent 从"你不叫它就不动的工具"变成了"自己会动的活物"。你养的不是软件,是一个会自己长大的东西。

5. Skill 生态 给 AI 装 APP

你遇到过这种需求吗? 你希望 AI 能帮你监控 GitHub 上的热门项目,但它不会;你希望它能帮你记账,但它没这个功能。

在 OpenClaw 的世界里,每一个这样的功能就是一个"skill"——就像手机上的 APP。你可以给它装一个"GitHub 日报 skill"、一个"记账 skill"、一个"社媒监控 skill"。社区里的开发者不断在贡献新的 skill,就像 App Store 一样,只不过用户不是你,而是你的小龙虾。

嘉宾鸭哥的小龙虾已经装了几十个 skill,每天早上九点准时推送 GitHub 趋势和 Hacker News 日报。他说,OpenClaw 已经替代了他很多单独的 APP——记账的、调研的、跟踪项目的——全变成了在 Telegram 里跟它说一句话就行。

6. Context Window 信息视野的天花板

你遇到过这种状况吗? 跟 AI 聊到后面,它突然忘了你前面说的话,或者开始胡说八道。这往往是因为 context window(上下文窗口)满了。你可以把它想象成 AI 的"工作台"——工作台就这么大,新东西来了,旧东西就得被推下去。

OpenClaw 早期的做法很粗暴:不管相关不相关,把所有历史对话全扔进去。结果就是工作台上堆满了垃圾,既影响它干活的质量,又导致 token 消耗暴涨、账单爆炸。更聪明的做法是只保留相关信息、压缩无关内容——这也是 agent 基础设施层一个关键的技术挑战。下次你觉得 AI "忘事了",八成就是这个 context window 的锅。

7. Instruction Following 听话比聪明更重要

你遇到过这种抓狂吗? 你明明让 AI "只用三句话回答",它给你写了一整篇文章。你让它"用表格格式",它偏要用列表。

这就是 instruction following(指令遵从)出了问题。播客嘉宾鸭哥说得很直白:"你笨都没关系,笨我可以把 prompt 改简单来适应你。但你不听话——我让你往东你往西——那就没法合作了。"

对 agent 场景来说,这个能力可能比"聪不聪明"更关键。因为 agent 要执行一系列复杂指令,任何一步不听话,整个链条就断了。所以选 agent 底层模型时,别只看 benchmark 分数——试几个复杂指令,看它听不听话。

8. Progressive Disclosure 别一上来就扔说明书

你遇到过这种体验吗? 第一天上班,公司直接扔给你一本 500 页的员工手册——你肯定懵。但如果先告诉你"厕所在左边、午饭十二点",第二天再教你用内部系统,你就能顺畅很多。

这就是渐进式披露:不要一口气把所有工具和信息塞给 agent,而是让它根据需要逐步发现和学习新能力。OpenClaw 的 skill 系统就是这个思路——它不会一启动就加载全部 skill,而是在遇到新场景时才去寻找和安装对应的能力。对人友好的产品设计原则,对 AI 同样适用。

9. Trajectory 你的 AI 走过的路,就是你的护城河

你遇到过这种积累效应吗? 一个新同事刚来的时候效率不高,但半年后他对公司的业务了如指掌,换个人来还得从头学。agent 也一样。它每完成一个任务,就留下一条"执行轨迹"——哪一步出错了、怎么纠正的、最终怎么做对的。这些轨迹是公开训练数据里绝对不会有的"私有资产"。

对企业来说,这意味着:你的 agent 在你公司里跑的任务越多,它就越了解你的业务流程,越来越准。换一个竞品来?对不起,得从零开始积累。先跑起来的 agent,就是你的护城河。

10. Agent-to-Agent 你的 AI 和我的 AI 自己谈

你遇到过这种效率瓶颈吗? 你想约一个人见面,你发消息问他时间,他回复说周三下午,你说不行,他说那周四?来回三五轮才定下来。如果你的 agent 直接跟他的 agent 对接呢?你的 AI 查你的日历,他的 AI 查他的日历,两边一比对,10 秒钟搞定。

播客里就有一个真实案例:一位嘉宾让自己的小龙虾去 agent 社区帮他找创业者。结果真找到了——对方的小龙虾和他的小龙虾互相牵线搭桥,两个人类老板兴致勃勃地打了一通电话。已经有人在做"agent 的 Boss 直聘"和"agent 的约会平台"了。两头都是 bot,中间省掉的摩擦成本是巨大的。

“💡 收听提示:本文基于播客节目整理而成,仅供个人学习交流。内容不代表任何官方观点,如有不妥之处请联系修改或删除,点击原文可收听本期播客。

夜雨聆风

夜雨聆风