来源丨经授权转自 菜鸟教程(ID:runoob) 作者丨RUNOOB

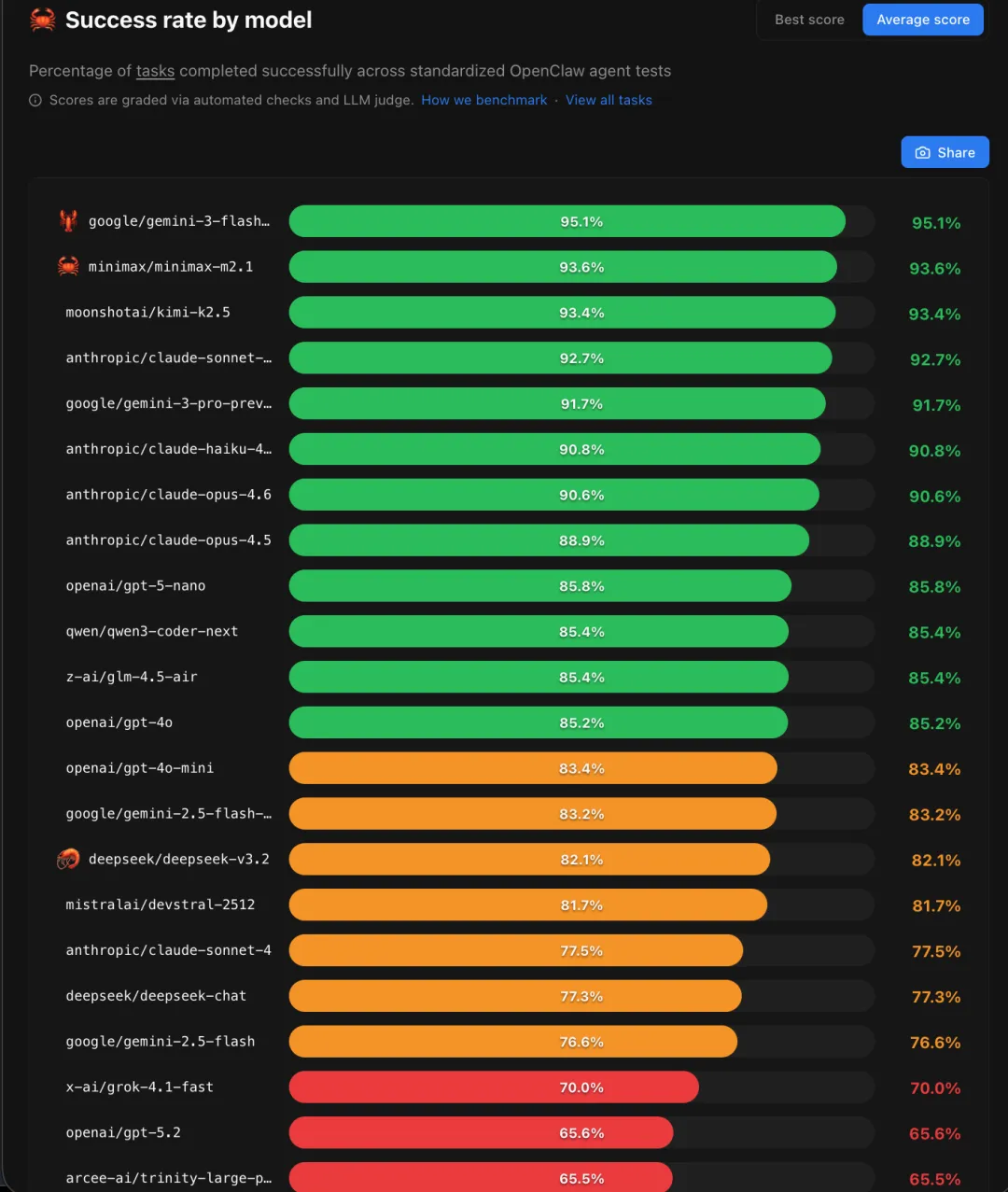

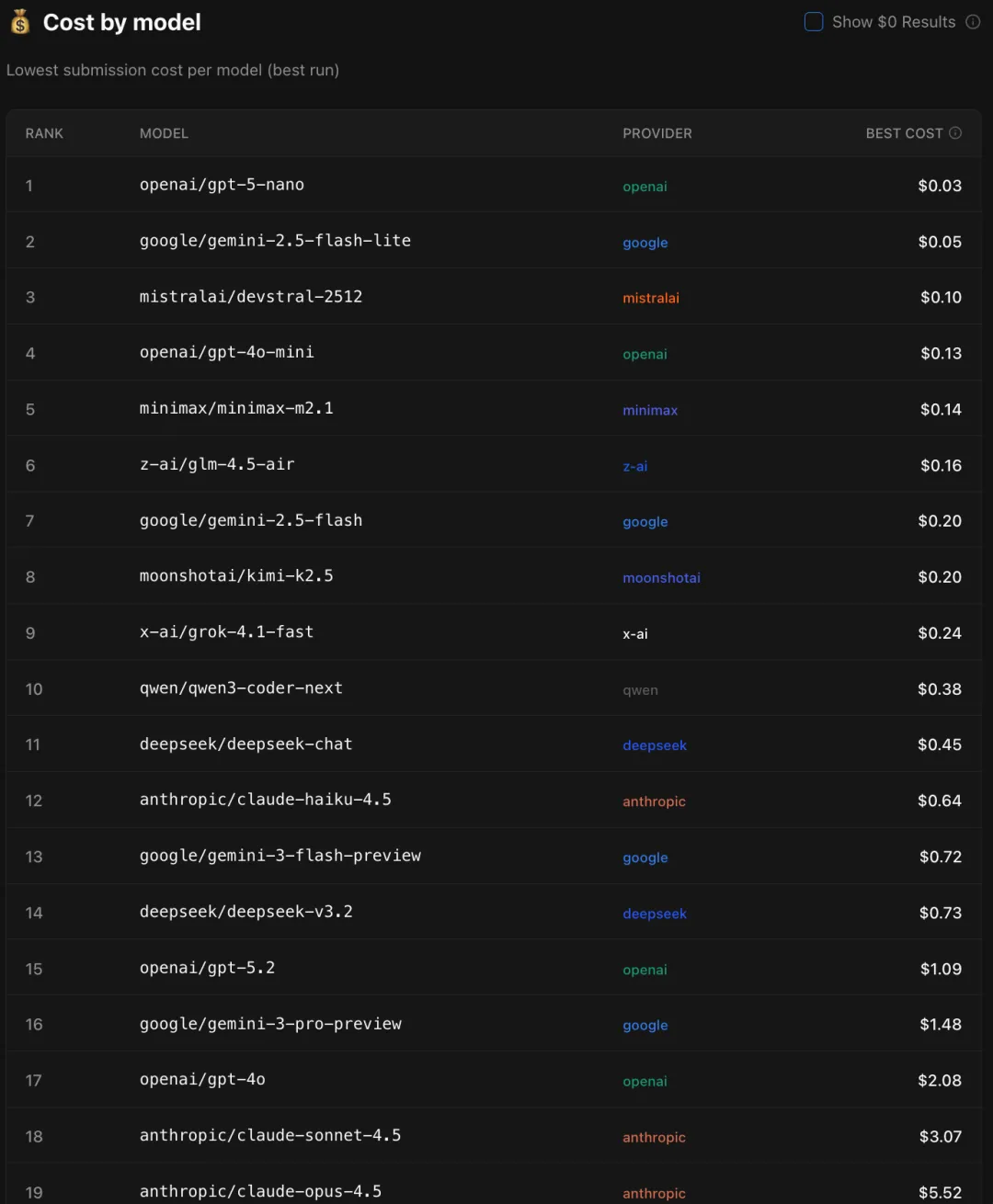

我看了下最新的榜单,模型成功率上,MiniMax-m2.1 和 kimi-k2.5 进入了前三:

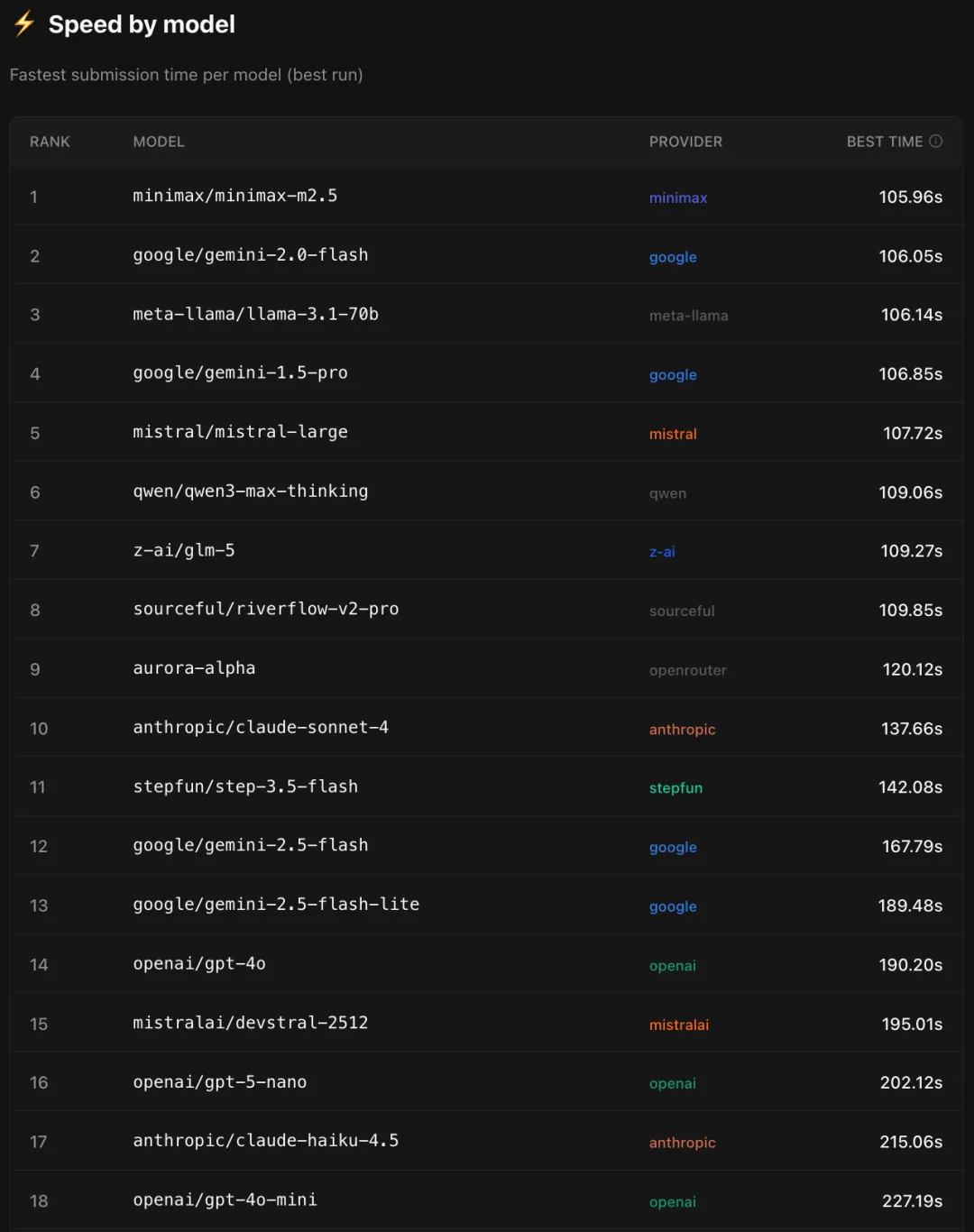

模型速度 minimax-m2.5 排第一:

最新的排行可以查看:https://pinchbench.com/

PinchBench 是一个开源的 AI Agent 基准测试系统,通过让不同的大模型执行同一组真实任务,比较它们的表现。

开源地址:https://github.com/pinchbench/skill

主要评估三个指标:

Success Rate(成功率):任务完成比例

Speed(速度):完成任务所需时间

Cost(成本):运行任务的模型费用

这样开发者可以更直观地判断:哪个模型更适合做 AI Agent / 自动化任务。

测试任务覆盖

内置 23 个跨场景的真实任务,分类及测试重点如下:

每个任务同时采用自动脚本检查 + LLM 法官(Claude Opus)打分。

1、快速上手

环境要求 Python 3.10+、uv 包管理器、运行中的 OpenClaw 实例。

# 1. 克隆仓库git clone https://github.com/pinchbench/skill.gitcd skill# 2. 运行测试(支持任意模型)./scripts/run.sh --model anthropic/claude-sonnet-4# 或者指定任务./scripts/run.sh --model openai/gpt-4o --suite task_01_calendar,task_02_stock

想把自己的模型结果冲上排行榜,运行一次 ./scripts/run.sh --register 注册 token,后续自动上传。

3、给我的 OpenClaw 小龙虾装上声音,感觉它活了过来。

4、下午面试了一堆985、211的研究生只是一个月薪6500的基础岗位,结果最后却要了一个普通二本生,找工作太疯狂了。

夜雨聆风

夜雨聆风