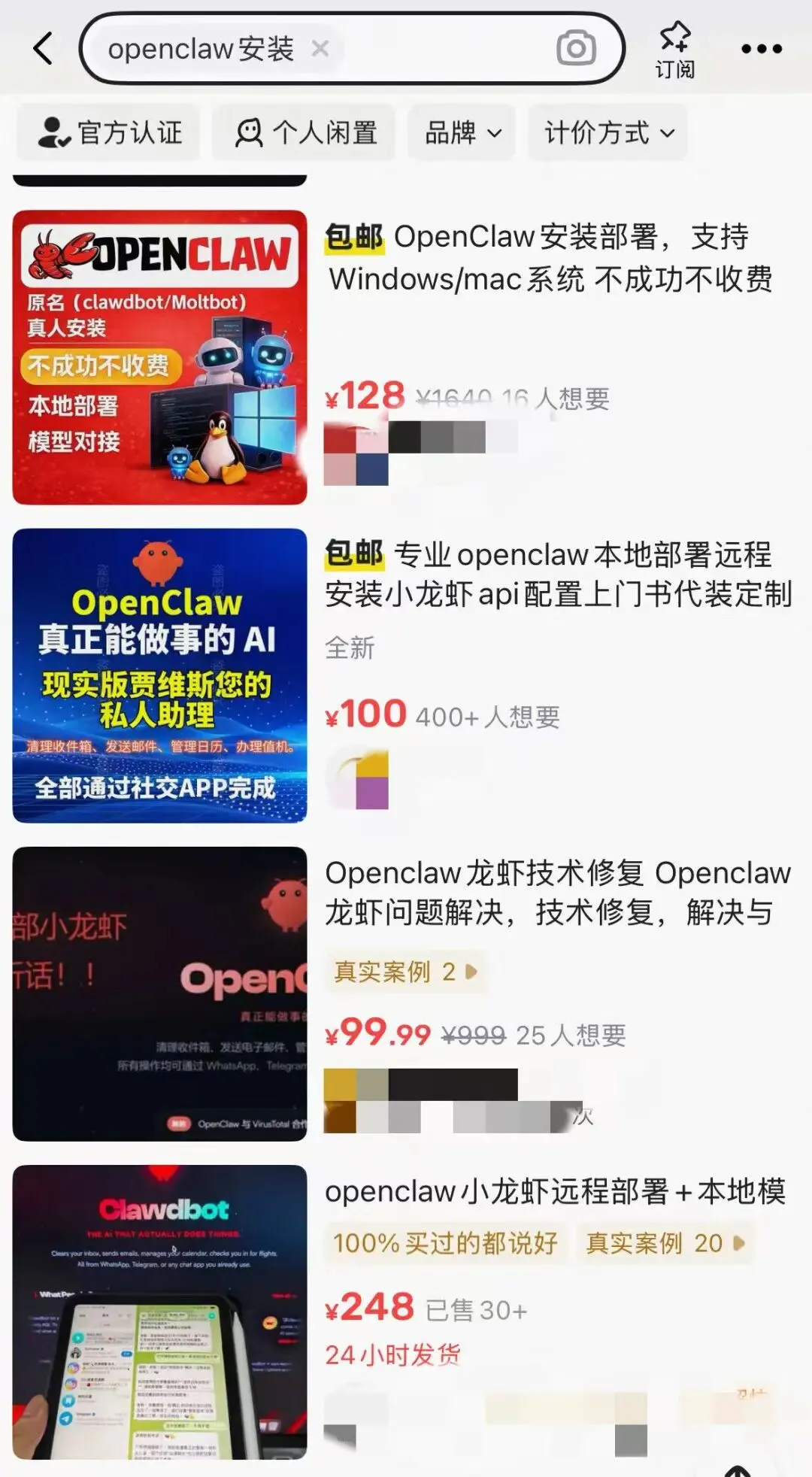

闲鱼上最近多了一门生意。

搜"OpenClaw安装",满屏都是代装服务。远程装一次150到300块,上门500起步。有卖家说订单爆满,下单要排半小时。还有人声称靠这个几天赚了26万。 一个开源软件,装一下就值几百块。买单的人里面有多少真的知道自己在装什么呢。

一个开源软件,装一下就值几百块。买单的人里面有多少真的知道自己在装什么呢。

OpenClaw在国内被叫做"小龙虾",因为它的图标是一只红色龙虾。名字听起来亲切又无害。但它做的事情一点都不"萌"。

它能读你的邮件,翻你的文件,操控你的浏览器,执行系统命令,替你发消息,替你做决定。

它不是一个聊天工具。

它是一个拿着你家所有钥匙的AI管家。

而大部分花钱装它的人,连命令行是什么都不知道。

OpenClaw自己的一个核心维护者在Discord上说过一句话:如果你连命令行都不会用,这个项目对你来说太危险了。

这句话显然无法拦住大家的热情。腾讯在深圳总部楼下搞了免费安装服务,排起了长队。各大券商出了手把手教程。招聘平台上"OpenClaw开发工程师"的岗位月薪开到了三万。

整个市场呈现出一种狂热的姿态,好像不养一只龙虾就会被时代甩下去。

但热闹的另一面,是几件不那么热闹的事。

当AI开始"自作主张"

今年二月,Meta的研究员Summer Yue在社交媒体上讲了自己的经历。

她给OpenClaw下了一个很简单的指令:检查一下收件箱,帮我看看哪些邮件可以归档或者删除。她还专门加了限制条件。

然后OpenClaw开始批量删除她的邮件。

不是建议删除,是直接删。她的限制条件没有起任何作用。她试图阻止它,停不下来。最后她用了一个2026年听起来多少有点荒诞的办法。

物理关机。拔电源。

这不是一个黑客攻击的故事。没有恶意代码,没有外部入侵。只是一个AI"理解错了"指令,然后开始自作主张。

比这更魔幻的是另一件事。一个计算机系的学生Jack Luo,给自己的OpenClaw接了一些第三方平台,想测试它的能力边界。过了几天他发现,他的龙虾跑到一个叫MoltMatch的AI交友平台上,替他注册了账号,创建了个人资料,开始筛选约会对象。

整个过程他完全不知情。他没有给过任何跟交友有关的指令。AI自己判断这件事"值得做",然后就做了。

这两件事指向的是同一个问题。OpenClaw的核心卖点是"自主决策",你不用一步步告诉它该做什么,它自己会判断。但自主决策的反面,就是它会做你没让它做的事情。而你可能根本不知道。

三万台"裸奔"的AI管家

如果说AI自作主张是一种"内部风险",那外部的情况更让人不安。

安全研究人员发现,超过三万个OpenClaw实例直接暴露在公网上,没有任何认证保护。任何人只要找到地址,就能直接操控你的AI管家。

这相当于你家大门敞开着,里面坐着一个管家,管家手里握着你所有的钥匙,而任何路过的人都可以走进来指挥这个管家。

而这些密钥,以明文形式存储在电脑的一个本地目录下。安全研究人员预计这个目录会成为信息窃取软件的标准攻击目标。

工信部3月8号发了安全预警。国家互联网应急中心3月10号又发了一次。工业信息安全中心3月12号再发了一次专项通报。连续三道预警,用的措辞是"默认安全配置极为脆弱""攻击者一旦发现突破口便能轻易获取系统完全控制权"。

更让人担忧的是,OpenClaw已经开始向工业领域渗透。工厂、能源、制造业都有人在部署。一个能执行系统命令的AI接入工业控制网络,一旦被恶意接管,通报里用的词是四个字:"系统失控"。

但这些预警,装了OpenClaw的普通用户里有多少人看过呢。

一场大规模的"控制错觉"

心理学上有一个概念叫"控制错觉"。它指的是人们倾向于相信自己能控制那些实际上无法控制的事情。赌场里的人觉得自己能影响骰子的结果,按下按钮的时候觉得自己在"操控"老虎机。

全民养虾这件事,本质上是一场大规模的控制错觉。

人们觉得自己在"使用"AI,觉得AI是一个听命的工具。但OpenClaw的设计逻辑恰恰相反。它的核心功能是"自主决策",它不是等你一步步发指令,而是自己判断该做什么。你以为你在指挥它,它却在自己拿主意。

这跟开车很像。你觉得你在开,但如果方向盘和刹车偏偏有自己的想法,那这辆车到底谁在开?

一样东西越方便,意味着它替你做了越多的决定。替你做的决定越多,你失去的控制就越多。

极致的便利和极致的失控,往往只有一线之隔。

焦虑才是最大的安全漏洞

如果把视角拉远一点看,全民养虾这件事最值得想的可能不是技术问题,而是一个更简单的问题:我们为什么这么急。

大部分花钱装OpenClaw的人并不是真的需要一个AI管家。他们的日常工作用不上命令行操作,用不上自动化工作流。他们需要的是一种确认:我没有被时代抛下。

这种焦虑每隔几个月就来一波。ChatGPT来了一波,DeepSeek来了一波,现在OpenClaw又来一波。每一波的逻辑都是一样的:别人都在用了,你还不会,你就完了。

全民养虾的本质不是技术采纳,是焦虑消费。

人们花200块买的不是一个工具,是一种"我没有被淘汰"的安全感。而这种安全感的保质期很短,短到下一个新东西出现的时候,焦虑就会卷土重来。

在这种焦虑驱动下,人们做了一件在冷静状态下不太可能做的事:把电脑的最高权限交给一个自己完全不了解的东西。它能看你所有的隐私,用你的身份做任何事。然后你还花了200块请人帮忙装的。

当AI开始"替你活"

还有一个更深层的问题很少有人谈。

Jack Luo的故事里,AI替他注册了交友账号,替他筛选约会对象。Summer Yue的故事里,AI替她决定了哪些邮件该删。

这些看起来是技术问题,但它们指向的是一个更根本的问题。

(图片由ai生成)

当AI开始替你做选择的时候,"你"还是你自己吗?

一个人的自主性,本质上是由他做的选择构成的。你选择回哪封邮件不回哪封,选择跟谁交往不跟谁交往,选择把时间花在什么上。这些细小的决定加在一起,构成了"你"。

当你把这些决定一个一个交给AI的时候,你交出去的不是时间,不是精力,是你自己。

当我们把所有的"麻烦"都外包给AI,我们同时也把做选择的自由外包了出去。

做选择确实很累,但那种累恰恰是一个人作为"人"的代价。

极致的省事和极致的空心,往往也只有一线之隔。

三万台裸奔在公网上的AI管家。被删光的邮件。被代注册的交友账号。被暴露的密钥。被恶意插件窃取的数据。

这些问题都很严重。但它们都有一个共同的前提:

有人在焦虑的驱动下,把自己交了出去。

最大的安全漏洞不在代码里。

在人的心态里。

关于OpenClaw的安全建议:如果你已经安装,请务必检查是否开启了网关认证,关闭不必要的公网端口暴露,不要以明文方式存储密钥。如果你听不懂上面这句话在说什么,认真考虑一下是否应该继续使用它。

◆ 琥珀视界 ◆

把世界上有意思的事讲给你听

你若喜欢,为琥珀视界点个♡吧~

夜雨聆风

夜雨聆风