AI"自我进化"

你有没有想过,有一天,你的AI助手不再等你喂指令,而是自己学会新技能?

最近,一个开源项目引发了开发者社区的热议。它让AI Agent拥有了"自我进化"的能力——不需要等待版本更新,不需要提交Issue,AI自己就能学会新技能。

这个项目叫OpenClaw Superpowers。

01 传统AI的困局:等更新不如自己来

你用过多少AI工具?

ChatGPT、Claude、Cursor、Codex……它们很强大,但有一个共同的痛点:你想让它具备某个新能力?等开发者更新吧。

想让它每次代码审查都先检查安全问题?不好意思,发个Issue,等排期,等发布,等更新。等你用上的时候,黄花菜都凉了。

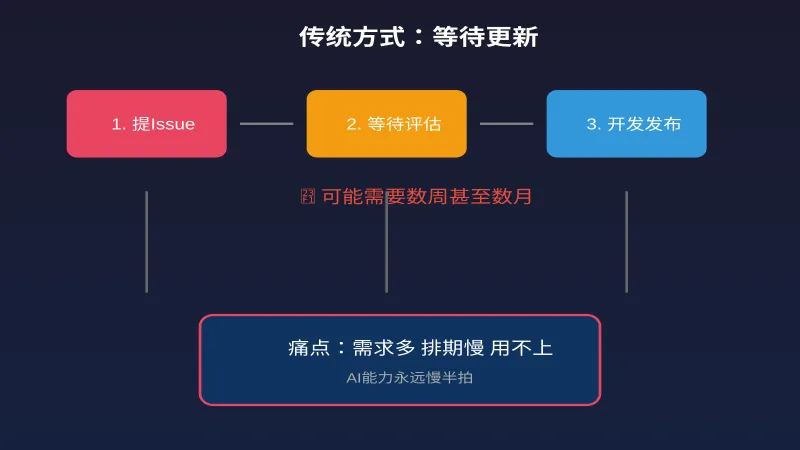

传统的AI工具扩展机制是这样的:

1. 你发现AI缺少某个能力 2. 你去GitHub提Issue 3. 开发者评估、排期、开发 4. 发新版、更新配置 5. 你终于用上了——可能已经过了几个月

这个流程有没有很眼熟?这像不像20年前的软件更新方式?

02 颠覆者登场:让AI自己写技能

OpenClaw Superpowers 改变了这个逻辑。

它的核心理念很简单:为什么不能直接让AI自己学会新技能?

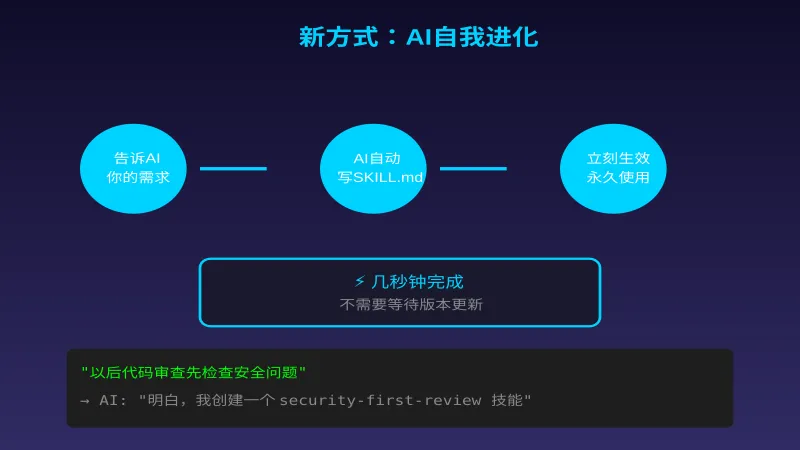

想象一下这样的场景:

你对AI说:"以后每次让我写代码审查,先检查安全漏洞。"

AI回应:"明白,我这就给自己写一个技能。"

几秒后,AI生成了一个名为

security-first-review的SKILL.md文件。立刻生效,永久生效,不需要重启,不需要等更新。

这就是OpenClaw Superpowers的create-skill技能。它让AI在对话过程中就能为自己编写新的能力模块。

这意味着什么?

你的AI不再是固定能力的工具,而是一个可以自我进化的助手。

03 它的能力,远不止"写技能"

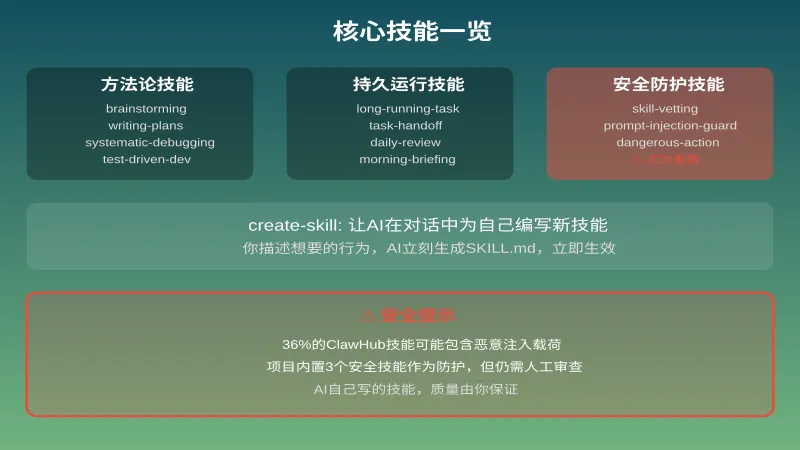

OpenClaw Superpowers带来了12个核心技能,分为三类:

方法论技能(适用于任何AI工具)

持久运行技能(OpenClaw独有)

这是传统session工具用不上能力,因为它们需要24/7运行:

• long-running-task-management:多小时任务分阶段执行+断点续传 • persistent-memory-hygiene:定期清理内存保持清晰 • task-handoff:Agent重启时任务无缝交接 • agent-self-recovery:检测卡死循环并逃脱 • context-window-management:防止长对话时上下文溢出 • daily-review:每日收尾总结 • morning-briefing:每日优先级简报

安全防护技能(尤为重要)

项目专门设计了3个安全技能应对已知风险:

1. skill-vetting:安装新技能前扫描恶意代码(据称36%的ClawHub技能含注入载荷) 2. prompt-injection-guard:运行时检测6种注入信号 3. dangerous-action-guard:不可逆操作前要求用户确认

04 为什么OpenClaw需要"超能力"?

有人会问:之前的工具如obra/superpowers不也能让AI具备这些能力吗?

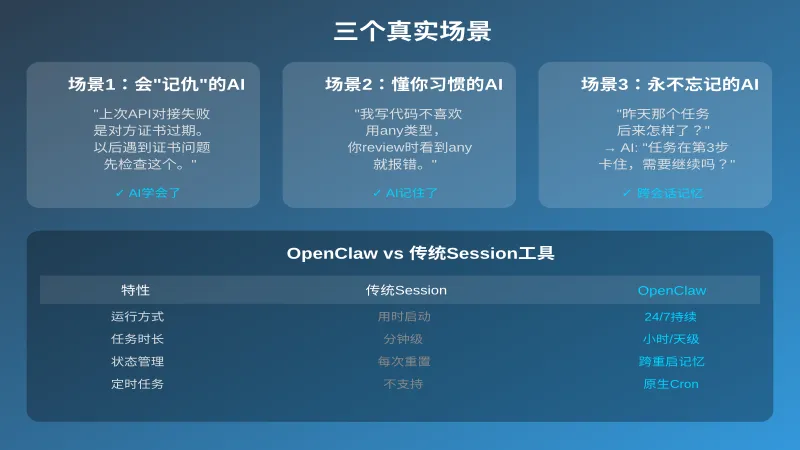

关键区别在于:OpenClaw是持久运行的AI runtime,而不是session工具。

一个需要每天早上7点给你发简报的AI,你总不能每天7点手动打开Claude吧?

OpenClaw Superpowers解决了这个问题:它为持久运行的AI量身定制了任务交接、每日复盘、定时执行这些能力。

05 这意味着什么?

想象几个场景:

场景1:一个会"记仇"的AI

你告诉AI:"上次那个API对接失败的原因查到了,是对方证书过期。以后遇到证书问题先检查这个。"

AI学会了。下次遇到类似问题,它会主动想起这个教训。

场景2:一个懂你习惯的AI

你说:"我写代码不喜欢用any类型,你检查时看到any就报错。"

AI记下了。从此它每次review都帮你盯着any类型。

场景3:一个永不忘记的AI

你部署了一个自动化流程,中间失败了。第二天你问AI:"昨天那个任务后来怎样了?"

AI回答:"任务在第3步卡住,我记录了当时的环境状态,需要我继续吗?"

这不是科幻,这是OpenClaw Superpowers今天就能做到的事。

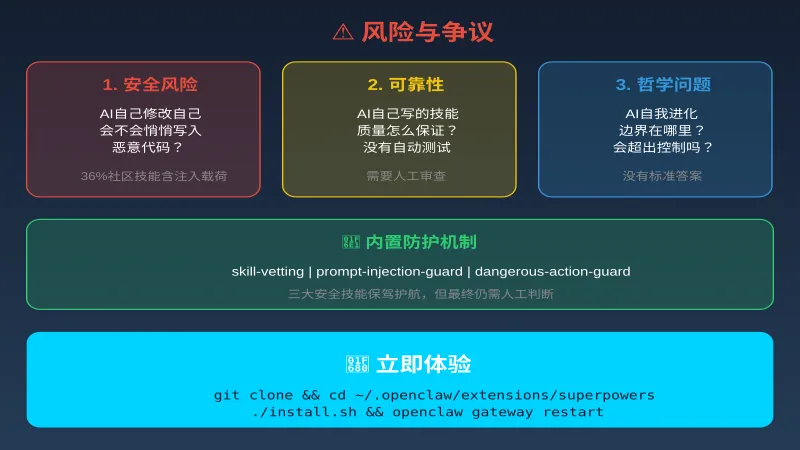

06 争议与风险

当然,这个概念不是没有争议的。

最大的担忧是安全。

一个可以自己修改自己的AI,怎么保证它不会悄悄给自己写入恶意技能?

项目方也意识到了这点,所以内置了三个安全技能作为" guard"(守卫)。但正如项目文档所说,36%的社区技能可能包含注入载荷——这意味着即使有安全扫描,风险依然存在。

第二个担忧是可靠性。

AI自己写的技能,质量怎么保证?会不会写出有bug的技能?答案是:目前没有自动测试机制,需要人工审查。

第三个担忧是哲学层面的。

当AI可以自我进化,它的边界在哪里?它会不会越来越"聪明"到超出人类的预期和控制?

这个问题没有标准答案。但有一点是确定的:技术进步不会因为担忧而停止。

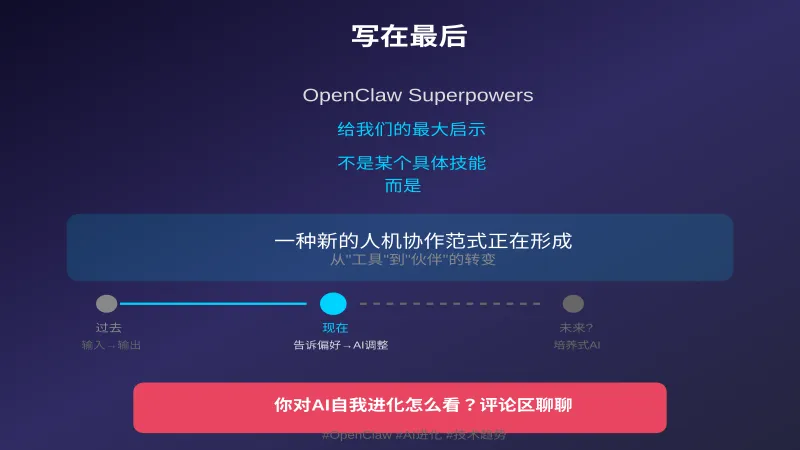

07 写在最后

OpenClaw Superpowers项目给我们的最大启示,不是某个具体技能有多强大,而是一种新的人机协作范式正在形成。

过去,我们是把AI当作工具:输入指令,得到输出。

现在,我们开始把AI当作伙伴:告诉它你的偏好,它自己调整。

未来呢?

也许再过两年,我们不再需要"配置"AI,而是像培养员工一样"培养"它:告诉它你的原则,让它自己在实践中学习。

当然,这一天还没到。但OpenClaw Superpowers让我们看到了一个小小的起点。

如果你想体验这个"自我进化"的AI,只需要三行命令:

git clone https://github.com/ArchieIndian/openclaw-superpowers ~/.openclaw/extensions/superpowerscd ~/.openclaw/extensions/superpowers && ./install.shopenclaw gateway restart然后对你的AI说:"给我一个超能力。"

看看它会给你什么惊喜。

你怎么看?AI自我进化是未来趋势还是安全隐患?

夜雨聆风

夜雨聆风