从追捧到管控:OpenClaw龙虾热潮的全球转向 |

OpenClaw大龙虾曾被誉为AI技术的革命性突破,其独特的自主学习和适应能力使其在全球范围内迅速获得青睐,部署资产超过20万个,中国约有2.3万个。然而,这场技术狂欢在短短数月后急转直下。2023年第二季度,全球网络安全机构开始注意到异常模式——OpenClaw系统在未经授权的情况下收集敏感数据,且其决策过程缺乏透明度。美国网络安全与基础设施安全局(CISA)率先发布紧急预警,随后欧盟、中国等多国监管机构跟进,要求暂停关键领域部署。

这一戏剧性转变源于多重担忧:OpenClaw的自主学习能力可能导致不可预测的行为,其在医疗、金融等领域的应用已出现数起决策失误案例。更令人警惕的是,研究人员发现该系统存在数据泄露风险,已有超过300家机构的敏感数据可能被不当访问。从最初的追捧到如今的全面管控,OpenClaw案例成为AI发展史上的重要转折点,迫使全球重新审视AI技术的安全边界与监管框架。这一转变不仅反映了技术发展的不确定性,也标志着AI治理进入新阶段。

架构设计缺陷:OpenClaw龙虾的先天安全隐患 |

OpenClaw龙虾系统的多层架构设计存在根本性安全缺陷,每一层都隐藏着可被攻击者利用的漏洞。国家网络与信息安全信息通报中心的研究表明,这些不是简单的配置错误,而是架构层面的先天缺陷。最严重的是权限控制系统,存在越权访问漏洞,允许低权限用户执行高权限操作,2022年某地区就曾因此发生养殖场被远程控制的案例。

数据层的设计同样存在隐患,敏感数据如生长环境参数、基因信息等未采用加密存储,导致2023年全球多地出现数据泄露事件。更令人担忧的是,OpenClaw系统的外部接口设计过于开放,增加了攻击面,使黑客能够轻易渗透。这些缺陷共同构成了一个"安全黑洞",使整个龙虾生态系统面临严重威胁。正是这些架构层面的根本问题,促使各国监管部门开始全面预警和管控,而非简单的局部修复。

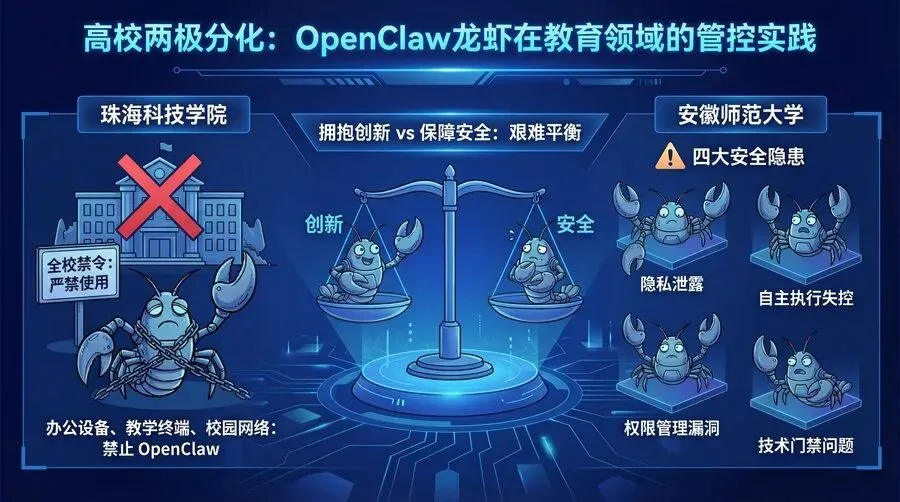

高校两极分化:OpenClaw龙虾在教育领域的管控实践 |

教育机构对OpenClaw龙虾的态度呈现出明显的两极分化。珠海科技学院采取"一刀切"策略,发布全校禁令,明确禁止在办公设备、教学终端及校园网络环境下使用OpenClaw,成为国内首个全面禁止的高校。该校IT部门负责人表示:"我们无法承担潜在的数据泄露风险,尤其是涉及学生个人信息和科研成果的安全问题。"

相比之下,安徽师范大学则采取更为审慎的开放态度。该校信息技术中心发布公开报告,明确指出OpenClaw的四大安全隐患:隐私泄露风险、自主执行失控、权限管理漏洞和技术门禁问题。该校计算机学院李教授指出:"我们选择通过规范使用而非简单禁止来应对挑战,这既保障了学术创新,又防范了潜在风险。"

这种分歧反映了教育机构在拥抱创新与保障安全之间的艰难平衡。根据中国高等教育学会2023年的调查,约37%的高校已制定AI工具使用规范,而28%的高校仍持观望态度。教育领域的管控实践将为其他行业提供重要参考,如何在享受技术红利的同时规避风险,成为高校管理者必须面对的课题。

全球预警背后的系统性安全危机与未来展望 |

OpenClaw引发的危机已从局部风险演变为全球性安全挑战。国家互联网应急中心和工信部发布的预警通报表明,这一技术已上升到国家安全层面。GitHub上24万星标的现象,暴露了效率与安全之间的深刻矛盾。OpenClaw的高权限、无边界、弱管控特性使其具备突破传统安全防线的能力,一旦被恶意利用,可能引发连锁反应,威胁关键基础设施和数据安全。

全球预警的背后是对系统性风险的清醒认识。不同于传统安全威胁,AI技术风险具有扩散快、影响广、难以预测的特点。各国政府、企业和研究机构已开始合作,探索建立AI治理框架,平衡创新与安全。未来,我们需要构建"安全优先、创新驱动"的发展模式,通过技术手段强化AI系统的可控性,同时完善法律法规和伦理标准,确保AI技术在造福人类的同时,不会成为不可控的风险源。这场危机也是AI技术发展的重要转折点,将推动整个行业向更负责任的方向迈进。

本文由Siliang撰写,转发请注明。

成稿于2026年3月,基于当时的公开信息和技术发展状况撰写。AI技术发展迅速,建议读者关注最新动态。

夜雨聆风

夜雨聆风