OpenClaw 深度解析:流式传输如何重构飞书 AI 交互体验

在企业级 IM 与大语言模型(LLM)融合的落地场景中,“响应延迟”往往是阻碍用户体验跃升的最大绊脚石。当 LLM 需要数秒甚至更长时间进行推理时,传统的“请求-响应”同步模式不仅让用户陷入漫长的等待,更极易因超时导致交互中断,造成“系统卡死”的错觉。

OpenClaw 作为一款聚焦于生产环境的 AI 网关,其近期迭代中正式支持了飞书官方插件的流式传输功能。这一特性的引入,不仅是数据交互方式的改变,更是对用户体验底层逻辑的重构。本文将从技术原理、架构设计及落地实践三个维度,深入剖析 OpenClaw 如何打破飞书交互的延迟壁垒。

核心概念:从同步阻塞到流式响应

在深入技术细节之前,我们首先需要厘清两种数据传输范式的本质差异。

1. 传统同步模式:阻塞的痛点

在非流式模式下,飞书机器人接收用户指令后,向 OpenClaw Gateway 发起请求,后者转发至 LLM 服务。此时,整个调用链路处于阻塞状态。LLM 必须完成全部内容的生成,才能一次性将完整数据包返回给客户端。

- 优势:实现逻辑简单,状态管理相对容易。

- 劣势:首字节时间(TTFB)极长,用户感知延迟等于 LLM 推理总时长。更致命的是,这极易触发飞书平台 Webhook 的超时限制(通常为 5-10 秒),导致消息发送失败。

2. 流式传输模式:打破阻塞

流式传输借鉴了 Server-Sent Events (SSE) 的设计思想。LLM 的生成过程是逐 Token 进行的,OpenClaw 作为网关,不再等待完整响应,而是将 LLM 产生的数据碎片实时“推流”给飞书客户端。

- 用户体验:呈现“打字机”效果,文字逐字浮现,大幅降低了用户的心理等待焦虑。

- 技术价值:有效规避了长推理时间的阻塞瓶颈,从根本上解决了连接超时问题。

架构解析:OpenClaw 流式交互的实现机理

OpenClaw 之所以能高效支撑飞书的流式交互,得益于其底层 Gateway 的架构设计与对飞书 API 特性的深度适配。

1. 架构拓扑与数据流向

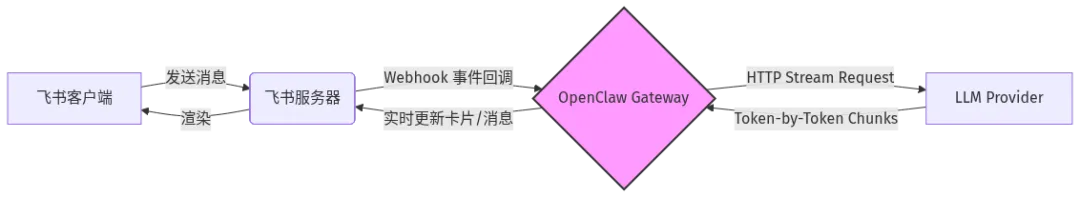

理解 OpenClaw 的流式交互,关键在于把握数据的流转路径:

数据流向说明:

1. 飞书客户端 → 发送消息 → 飞书服务器

2. 飞书服务器 → Webhook 事件回调 → OpenClaw Gateway(协议转换器)

3. OpenClaw Gateway → HTTP Stream Request → LLM Provider

4. LLM Provider → Token-by-Token Chunks → OpenClaw Gateway

5. OpenClaw Gateway → 实时更新卡片/消息 → 飞书服务器

6. 飞书服务器 → 渲染 → 飞书客户端

在此架构中,OpenClaw 扮演了协议转换器的关键角色。主流 LLM 服务商(如 OpenAI、Azure)返回的是 SSE 格式的数据流,而飞书 API 要求的是特定的 JSON Payload 更新。OpenClaw 负责将 SSE 流实时解析、缓冲、格式化,并通过飞书的 patch 接口更新消息卡片,实现数据的实时呈现。

2. 关键配置与缓冲策略

根据官方部署指南,开启流式传输的核心在于配置项的精细化调整。当 streaming 设置为 true 时,OpenClaw 内部的处理逻辑会发生质变:

# 开启飞书渠道的流式输出

openclaw config set channels.feishu.streaming true

执行该指令后,Gateway 将启用异步非阻塞 I/O 模型,具体表现为:

1. 请求构建:向 LLM 发起的请求头自动包含 Accept: text/event-stream。

2. 响应处理:注册 on_data 事件监听器,替代传统的 response.text() 等待模式。

3. 滑动窗口缓冲:这是 OpenClaw 的一个技术亮点。为避免高频调用飞书 API 触发限流,网关内部实现了滑动窗口缓冲机制——累积一定数量的 Token(如 5-10 个字)后再发送一次更新请求,而非逐字请求,在流畅度与 API 负载间取得了平衡。

3. 免服务器部署与权限模型

参考资料中提到的“不用服务器,用长连接把机器人跑起来”,涉及 OpenClaw 的另一核心技术:反向代理与长连接保活。这省去了开发者搭建公网服务器、配置 SSL 证书的繁琐流程,通过内网穿透技术直连飞书服务。

在权限层面,流式传输对飞书应用的权限配置有严格要求:

* im:message 与 im:message:send_as_bot:基础消息发送权限。

* im:chat:readonly:读取群聊上下文。

* 卡片更新权限:这是流式输出的关键,确保应用具备更新已发送消息卡片的能力。

OpenClaw 在添加渠道时会自动校验这些权限位,确保流式数据能够正确写入飞书的会话上下文。

实践指南:从部署到流式对话

下面通过一个具体的部署案例,演示如何配置 OpenClaw 实现与飞书的流式交互。

1. 环境准备与版本升级

流式传输对底层并发库有较高要求,建议始终使用最新版本的 OpenClaw 镜像。

# 拉取最新镜像

docker pull openclaw/gateway:latest

# 或使用 CLI 工具升级

openclaw upgrade

升级完成后,Gateway 会自动重启并加载最新的插件系统。

2. 渠道配置与核心参数

在 OpenClaw 控制台添加飞书渠道,填入飞书开放平台获取的 App ID 和 App Secret。以下是核心配置片段:

# config.yaml 示例配置

channels:

feishu:

enabled: true

app_id: "cli_a1b2c3d4e5f6g7h8"

app_secret: "your_app_secret_here"

streaming: true # 核心开关

retry_policy:

max_retries: 3

timeout_ms: 30000

3. 回调配置与超时规避

在飞书开放平台控制台,务必开启事件订阅。流式传输的关键在于处理消息事件的响应策略。OpenClaw 接收到事件后,会立即返回一个 HTTP 200 OK 给飞书服务器,告知“已收到”,随后通过异步方式推送流式内容。

注意:若不开启流式传输,且 LLM 推理耗时较长,极易触发飞书平台的超时限制,导致消息发送失败。

通过上述配置,OpenClaw 能够有效解决飞书 AI 机器人的响应延迟问题,显著提升用户体验。

夜雨聆风

夜雨聆风