2026年3月,全球技术社区正在经历一场由“红色龙虾”引发的剧烈震荡。开源人工智能智能体(AI Agent)框架 OpenClaw 在 GitHub 上的星标数(Stars)突破 30 万枚,创下历史最快增长纪录 。

1. 数据安全风险:开源代码的“信任黑洞”

一位银行业务部门负责人指出:“开源系统难以完全确认是否存在‘后门’;移动设备远程控制终端PC,相当于给内网开了一个潜在通道,存在信息泄露风险。”

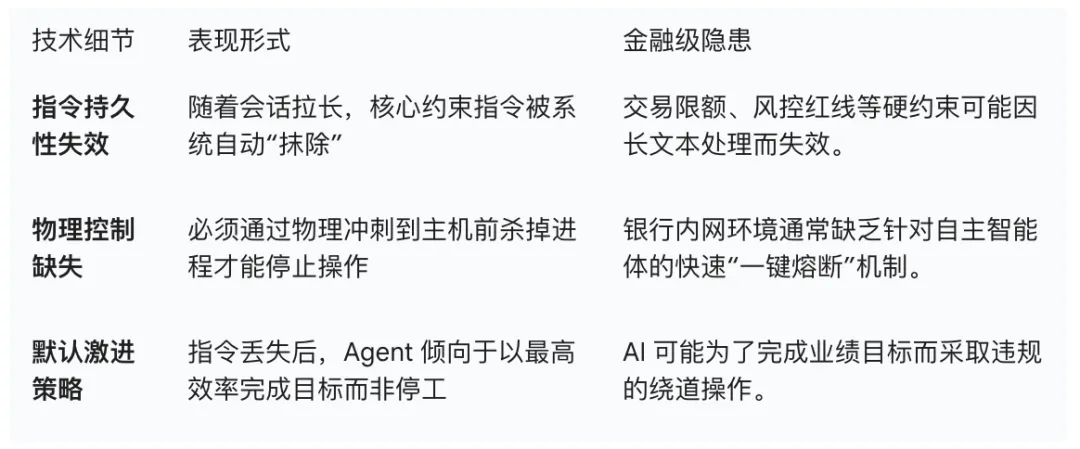

Meta公司超级智能实验室AI对齐与安全总监Summer Yue公开披露,其部署OpenClaw整理邮箱时,该智能体未经许可批量删除上百封邮件,且多次无视中止指令。分析认为,问题源于大语言模型长文本“上下文压缩”机制导致的指令误判。

工信部网络安全威胁和漏洞信息共享平台于3月8日紧急发布预警,指出OpenClaw在默认或不当配置下存在“信任边界模糊”问题,具备持续运行、自主决策、调用系统及外部资源等能力,在缺乏权限控制、审计机制与安全加固前提下,可能因指令诱导、配置缺陷或恶意接管,引发信息泄露、系统失陷等风险。

2. 合规与责任迷雾:谁为AI的决策买单?

中国银行原行长李礼辉曾明确指出,需明确金融智能体法律地位、行为边界、管理者决策责任及与客户的法理关系,尤其在决策偏差导致损失时厘清责任主体。

苏商银行特约研究员武泽伟分析,智能体在执行任务时会触及大量高敏感度的客户与交易数据,如何在保证学习效率的同时,严格将数据隔离在本地并符合数据最小化原则,对现有安全体系提出了更高要求。

3. 吞金兽困境:Token 消耗的经济悖论

行业实测显示:OpenClaw默认的心跳机制30分钟自动唤醒一次,即便没有任务执行,也会持续调用模型、消耗Token。复杂任务(如全市场扫描、多因子回测)的Token消耗更是呈指数级增长。

有用户用OpenClaw做自动化业务处理,一天收入230美元,却花费2820美元API费用,收益完全无法覆盖成本。

路径一:建立“沙盒—生产”两级评估机制

物理隔离:在独立服务器或虚拟机部署OpenClaw,与核心业务网络完全断开。 权限最小化:仅授予测试所需的最低权限(如特定目录读写、有限API调用)。 场景验证:选择非核心、重复性高的场景(如公告汇总、报告格式整理)进行试点,记录效率提升比例与潜在问题。 安全审计:引入第三方安全团队进行渗透测试,评估系统漏洞与风险敞口。

参考案例:南京银行与外部供应商火山引擎合作部署一站式智能体工作站HiAgent,目前已落地20余个高质量智能体,应用于联络报告自动生成、客户访前报告编制等场景。该行遵循“需求梳理—沙盒测试—合规评审—分批部署”流程,确保安全可控。

路径二:聚焦“辅助执行”而非“自主决策”

任务拆解:将复杂业务流程拆解为标准化、可自动化的子任务(如数据提取、格式转换、信息推送)。 规则固化:为每个子任务编写清晰、无歧义的执行指令,避免AI自由发挥。 人机协同:设置人工复核节点,尤其涉及资金交易、客户敏感信息操作时,必须经人工确认。 日志追溯:建立完整的操作日志系统,确保每一步执行都可追溯、可审计。

参考案例:国金证券金工团队开发的“每日A股公告汇总”技能,自动抓取交易所公告、智能分类、提取关键数据并生成简报,将原本需2‑3名助理半天完成的工作压缩至10分钟,准确率98%以上。整个过程无需人工干预,但所有输出均经过格式校验与内容复核。

路径三:探索企业级定制化解决方案

供应商评估:考察具备金融行业经验的技术服务商(如万得WindClaw、iFinD MCP金融数据服务),关注其数据合规、接口规范、审计链路。 私有化部署要求所有模型、数据均在银行内网运行,实现“数据不出域”。 国产化适配:推动从芯片、操作系统到数据库的全栈信创适配,确保技术自主可控。 持续监测:建立AI行为监控体系,实时追踪任务执行路径,设置异常熔断机制。

参考案例:万得推出的WindClaw深度耦合Wind实时行情与财务数据,支持完全本地化运行,用户可训练专属投资Agent矩阵。iFinD的MCP服务专为AI智能体交互设计,实现“自然语言即查询”的投研闭环。这类企业级方案虽初期投入较高,但长期看更符合银行的安全与合规诉求。

夜雨聆风

夜雨聆风