30 秒看完全文: 企业接入大模型,90% 的团队只关心"怎么调通 API",却忽略了从 Prompt 注入到 Key 泄露再到天价账单的一连串安全坑。本文从企业"裸连"AI 的六大风险说起,拆解一个叫龙虾盾的 AI 安全网关是怎么做到:双向防护 + 智能路由 + 全链路审计——关键是接入只需一行代码。

你的团队刚刚通过 OpenClaw 把大模型接进了业务系统——AI 对话跑起来了,智能体也上线了,老板很高兴。

但你有没有想过:从你的应用到 AI 模型之间的那段"网线",是完全不设防的。

员工在对话框里粘贴了一张身份证照片让 AI 识别,Prompt 被注入后系统提示词直接泄露,某个开发把 API Key 写死在前端代码里——月底账单一看,六位数。

这些不是假设,而是大模型落地过程中每天都在发生的事。

今天聊聊,EchoMind上线的一个叫**龙虾盾**的企业级 AI 安全网关,是怎么把这些坑一个一个堵上的。

01 先问一个问题:你的 AI 有几道门?

大多数企业接入大模型的架构长这样:

你的应用 → API Key → AI 模型

中间什么都没有。没有安全检查,没有审计日志,没有成本控制。所有数据明文来回跑,一旦出问题,你甚至不知道问题出在哪。

这就像你家装了一套价值百万的智能家居,可大门是敞开的——你在享受科技便利的同时,把家底也亮给了全世界。

龙虾盾要做的事很简单:在你的应用和 AI 模型之间,加一道"安检门"。 进来的请求检查一遍,出去的响应再检查一遍,中间顺手帮你省钱、记账。

02 企业"裸连"AI 的六大风险

在聊解决方案之前,先把问题摊开看看。我把企业接入大模型面临的风险分成六类:

🎯 风险一:Prompt 注入攻击

这是大模型时代最经典的攻击方式。攻击者通过精心构造的输入,让 AI "忘掉"你设置的系统提示,转而执行攻击者的指令。

后果可以很严重——系统提示词里往往包含业务逻辑、内部规则,甚至 API 调用方式。一旦泄露,你的核心业务逻辑就等于开源了。

🔓 风险二:PII 数据泄露

员工在使用 AI 助手时,经常无意输入敏感信息:身份证号、银行卡号、手机号、客户联系方式……这些数据发到第三方模型后,就不在你的掌控范围了。

GDPR、《个人信息保护法》可不管你是不是"无意的"。

💀 风险三:AI 输出不可控

AI 不只是接收数据,它还会产出数据。模型幻觉可能生成恶意代码、违规内容、不当建议。如果你的应用直接把模型输出推给用户,这些内容就代表了你的品牌。

这个风险在 OpenClaw 等 AI 智能体场景下尤其致命。 大家的 Claw 一般都拥有很高的系统执行权限——读写文件、执行命令、调用 API,几乎无所不能。一旦大模型因为幻觉或被注入攻击,返回了一条类似 rm -rf / 或者恶意数据库操作的指令,而你的"大龙虾"不假思索地直接执行了——后果不敢想象。

这不是理论风险。当 AI 拥有"手和脚"的时候,它输出的每一条指令都可能变成真实的操作。没有输出盾的拦截,就等于把系统的最高权限交给了一个"不可控的大脑"。

💸 风险四:成本黑洞

七八个主流大模型,价格从每百万 Token 几毛钱到几十块不等。没有智能路由,要么团队全用最贵的(浪费),要么固定用最便宜的(效果差)。

更可怕的是 API Key 泄露——有人拿你的 Key 疯狂调用,月底账单直接爆炸。

🕳 风险五:审计盲区

"谁在用?""用了多少?""什么时候用的?""用来干嘛了?"——如果你回答不了这四个问题,你的 AI 治理基本等于零。

合规审查、安全事件回溯、成本分摊,全都建立在可追溯的基础上。

📈 风险六:模型选择低效

不同任务适合不同模型。一个简单的翻译任务非要用顶级推理模型,就像开兰博基尼去买菜。但手动为每种场景配模型?运维成本根本扛不住。

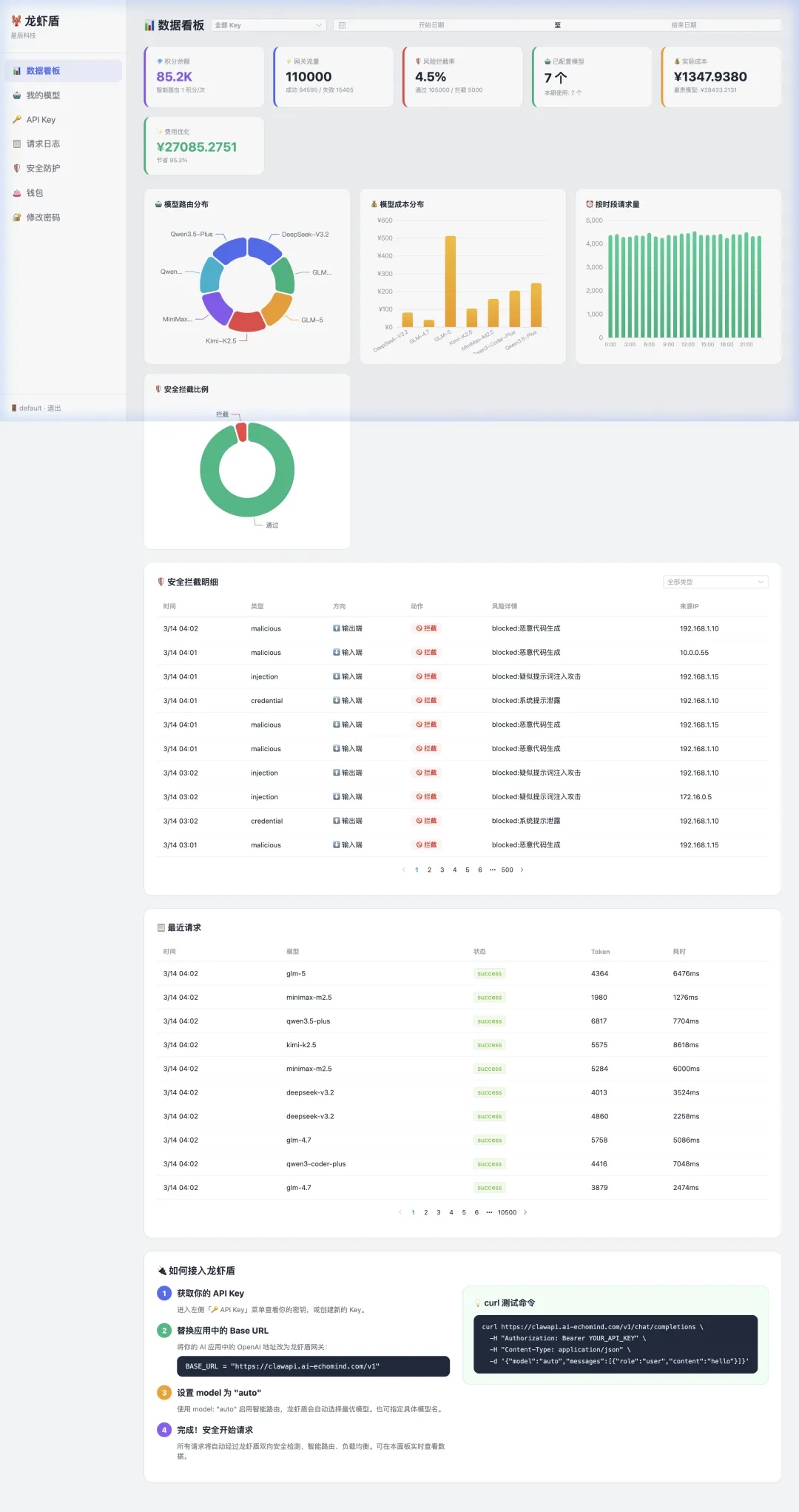

03 龙虾盾的思路:在 AI 大门口加两道安检

龙虾盾做的事情,一张图就能说清楚:

请求进来先过安全检查,再智能分配到最合适的模型;响应出去前再过一遍内容审核。全链路审计、成本优化同步完成。整个过程对你的应用完全透明,安全检测延迟 < 5ms,几乎无感。

04 四大核心能力拆解

🛡️ 双向安全防护

这是龙虾盾的看家本领。

输入盾支持三类检测:

- 注入攻击检测

— 识别 Prompt 注入、Jailbreak 尝试、指令篡改 - PII 检测

— 自动识别身份证号、银行卡号、手机号、邮箱等敏感信息 - 凭证检测

— 拦截包含 API Key、密码、Token 的请求

输出盾覆盖两大场景:

- 恶意代码过滤

— 检测模型返回中包含的危险脚本、Shell 命令 - 违规内容过滤

— 拦截色情、暴力、歧视性内容

安全等级支持三级可调:宽松、标准、严格——不同业务场景灵活配置。内部研发环境可以开宽松模式减少误拦,面向客户的产品建议开严格模式。

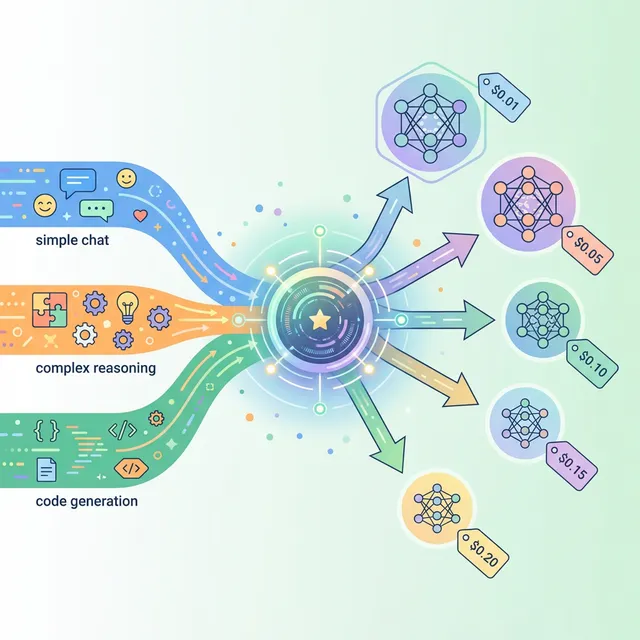

🧠 智能模型路由

龙虾盾不是简单的负载均衡,而是根据请求语义智能选模型。

使用方式很简单:把你已经开通的大模型全部配置进来,填好各模型的 API 地址和密钥,龙虾盾就会根据每个请求的复杂度和任务类型,自动帮你选择性价比最高的模型来响应。你只需要用 model: "auto" 发请求,剩下的交给网关。

工作方式:

分析请求复杂度和任务类型 从已配置的多个主流大模型中选择性价比最优的 支持 auto模式(自动选择)和手动指定模型灵活配置每个模型的权重、优先级、价格参数

实际效果:简单对话用低成本模型,复杂推理自动切换到高能力模型。你不用管模型选择的事,龙虾盾帮你"看菜下饭"。

💡 还没开通多个模型? EchoMind聚合平台支持一键接入全球顶级大模型——GPT、Claude、Gemini、Qwen、GLM、Kimi……不用一家一家去注册开通,一个平台全搞定。配置好之后,龙虾盾自动接管路由和安全防护。

费用优化对比一目了然:后台直接展示"智能路由 vs 全用最贵模型"的成本差,让省了多少钱有据可查。

📝 全链路审计

每一笔 AI 请求,龙虾盾都记录:

请求日志可查询、可导出、可追溯。出了安全事件,能精确定位到哪一笔请求、什么时间、谁发的、模型怎么回的。

💰 积分 & 成本管理

龙虾盾用积分体系管理 AI 使用成本:

- 按需充值

,用多少扣多少 - 消费流水清晰

,每笔充值和消费都有据可查 - 成本透明

,不再出现月底"惊喜账单"

对企业来说,这意味着可以把 AI 使用成本精确分摊到部门、项目、甚至个人——终于能回答"我们的 AI 花了多少钱"这个问题了。

05 安全事件分析:不只是拦截,还要看得懂

光拦截不够,还得分析。龙虾盾的安全事件看板提供:

- 趋势分析

— 攻击频次是在上升还是下降?哪个时段最密集? - 风险分类

— 注入攻击、PII 泄露、凭证暴露分别占多少? - 攻击溯源

— 每一次安全事件的完整上下文,从请求内容到检测规则

这不是一个简单的"拦了多少"的计数器,而是一个安全态势感知平台。你的安全团队可以据此调整防护策略、识别攻击模式、预判风险走向。

06 接入体验:一行代码搞定

安全产品最怕的就是"接入成本太高"。龙虾盾在这个问题上做得很克制:

🦞 通过 OpenClaw 接入(推荐)

如果你已经在用 OpenClaw,接入龙虾盾零改造。在对话配置中填入网关地址(https://clawbus.ai-echomind.com),自动启用安全防护、智能路由和审计——不改一行代码。

🔧 API 直接调用

现有代码只需替换两个参数:

# 改前

base_url = "https://api.deepseek.com/v1"

api_key = "sk-xxxx"

# 改后

base_url = "https://clawapi.ai-echomind.com/"

api_key = "sk-lb-xxxx"

就这么多。

🤝 兼容性

完全兼容 OpenAI SDK(Chat Completions API + Responses API) 支持 SSE 流式 和非流式 主流开发框架无缝衔接

如果你的应用已经在用 OpenAI 兼容的方式调用大模型,迁移到龙虾盾就是换个地址的事。

🏢 私有化部署 & 国产模型

对数据安全有严格要求的企业,龙虾盾支持私有化部署——网关跑在你自己的服务器上,数据不出内网。同时全面支持国产大模型(通义千问、智谱 GLM、百川、DeepSeek、Kimi、MiniMax 等),满足自主可控和信创合规的需求。

07 产品亮点速览

| 多个 主流大模型,灵活扩展 | |

| < 5ms,几乎无感知 | |

| 10 万+ | |

| 100% 全链路审计 | |

| 双向盾(输入 + 输出) | |

| 3 级可调(宽松/标准/严格) | |

| SSE 流式 & 非流式均兼容 | |

| OpenAI API 完全兼容 | |

| SaaS + 私有化部署,数据不出内网 |

08 最后的话

大模型落地,技术团队的注意力往往集中在"怎么用好 AI"——Prompt 怎么写、RAG 怎么搭、Agent 怎么编排。

但安全这件事,不出事的时候没人关心,出了事就是灾难级别的。一次 PII 泄露可能带来监管处罚,一次 API Key 泄露可能带来天价账单,一次 Prompt 注入可能泄露你的核心业务逻辑。

龙虾盾要做的,就是让你不用操心安全这件事。

🛡️ 双向防护 —— 进来的检查一遍,出去的检查一遍 🧠 智能路由 —— 自动选最合适的模型,省钱不费脑 📝 全链路审计 —— 每一笔请求都有迹可循 💰 成本透明 —— 花了多少钱,省了多少钱,一清二楚 🔌 一行接入 —— 改个地址就上线,零改造成本

在让 AI 跑起来之前,先给它装个"安检门"。这可能是你在 AI 安全上回报率最高的投入。

🦞 立即体验龙虾盾:https://clawbus.ai-echomind.com

如果你的团队正在或即将接入大模型,把这篇转给负责安全的同事看看。

关注公众号 AI EchoMind,后续还会写更多企业 AI 落地的深度拆解。

🎁 留言福利

在评论区留言聊聊你在 AI 落地过程中遇到的安全问题或踩过的坑,我们将抽取若干名额,赠送龙虾盾使用积分,让你免费体验 AI 安全网关的全部能力!

📌 活动说明:留言点赞前列的同学优先,具体名额以实际公布为准。

夜雨聆风

夜雨聆风