大家好,我是大刘。

用了一个月 OpenClaw 之后,我发现一个扎心的事实。

90% 的人都在用最先进的模型,做着最低效的“体力劳动”:每天花 2 小时训 AI,它却连你昨天教过的排版格式都记不住。

你有没有这种感觉?每次打开 ChatGPT,先花 5 分钟介绍自己是谁、做什么的、风格偏好是什么……好不容易聊出了一个满意的结果,关掉窗口,下次又得重来。

上周踩过的坑,这周照踩不误。上个月调好的 prompt,这个月找不到了。

这不叫用 AI,这叫重复培训一个失忆的实习生。

而我现在的 AI 代理"铅笔"🐿️,它记得我所有的写作风格、知道我踩过哪些坑、成功做过的事能一键复用——不是因为它比 ChatGPT 聪明,而是因为我给它定了两条铁律。

今天这篇,我就把这套方法掰开了讲。

先搞懂一件事:AI 代理不是工具,是"员工"

在讲铁律之前,先纠正一个认知。

大多数人把 AI 当"工具"用——打开、输入、获取结果、关闭。就像用计算器一样,用完就放下。

但 OpenClaw 里的 AI 代理,更像是你招了一个远程员工。

你得给它起个名字,定个性格,告诉它你是谁、你的做事风格是什么。这些信息写在几个关键文件里:

| 文件名 | 对应职场角色 | 核心功能 |

|---|---|---|

| SOUL.md | ||

| USER.md | ||

| MEMORY.md |

省去了你每次使用 LLM 时,要反复提供的背景信息。

举个例子,我的代理"铅笔"知道:

我是前阿里技术专家、写公众号的 我的文章风格要接地气、有数据支撑 开头必须是"大家好,我是大刘"+ 一个炸弹

这些我只说了一次。以后每次对话,它自动加载,不用我重复。

但——光有性格和记忆还不够。真正让代理越用越聪明的,是接下来这两条铁律。

铁律一:成功的事 → 封装成 Skill

什么是 Skill?

用最土的话讲:Skill 就是一份"操作手册"。

你让代理完成了一件事,效果不错——比如它帮你把文章一键发布到公众号草稿箱,步骤是:先转换格式、再上传图片、最后提交草稿。

如果你不封装,下次你还得重新描述一遍这些步骤。

但如果你让代理把这个流程封装成一个 Skill,下次你只需要说一句"发公众号",它就自动执行整套流程。

没封装的对话是消耗,封装后的 Skill 才是资产。

今天的成功,就是明天的便利。

🔥 实操演示

我给铅笔定的规则很简单,写在它的 TOOLS.md 里:

### 规则一:成功→封装

- 凡是 boss 交给我的任务,成功完成后

- 必须封装成 skill 或工具,方便下次直接调用

- 不要让相同的工作重复做第二遍

有了这条规则,每次铅笔完成一个新任务,它会主动问我:"boss,要不要把这个封装成 Skill?"

封装后的 Skill 长什么样?就是一个文件夹,里面有个 SKILL.md 说明书,告诉代理遇到什么关键词就触发、执行什么步骤。

对比一下差距:

❌ 没有 Skill 的做法:

"帮我把这篇 Markdown 文章发到公众号,先转成 HTML,图片要上传到公众号素材库,注意格式要适配微信的渲染……"(每次都说一遍)

✅ 有 Skill 的做法:

"发公众号"(三个字搞定)

这就是复利效应。你在代理身上投入的每一次"培训",都会变成未来的效率提升。

铁律二:失败的事 → 写进记忆库

比成功封装更重要的,是失败只错一次。

AI 代理有个天然缺陷:它没有"疼痛记忆"。同一个坑,它可以反复踩,毫无心理负担。

所以你得帮它建立"伤疤记忆"。

我的做法:在 TOOLS.md 里加了第二条铁律:

### 规则二:失败→复盘

- 凡是执行过程中踩过的坑、犯过的错

- 必须写进 MEMORY.md 的"教训库"板块

- 下次遇到类似场景,先翻记忆

🔥 实操演示

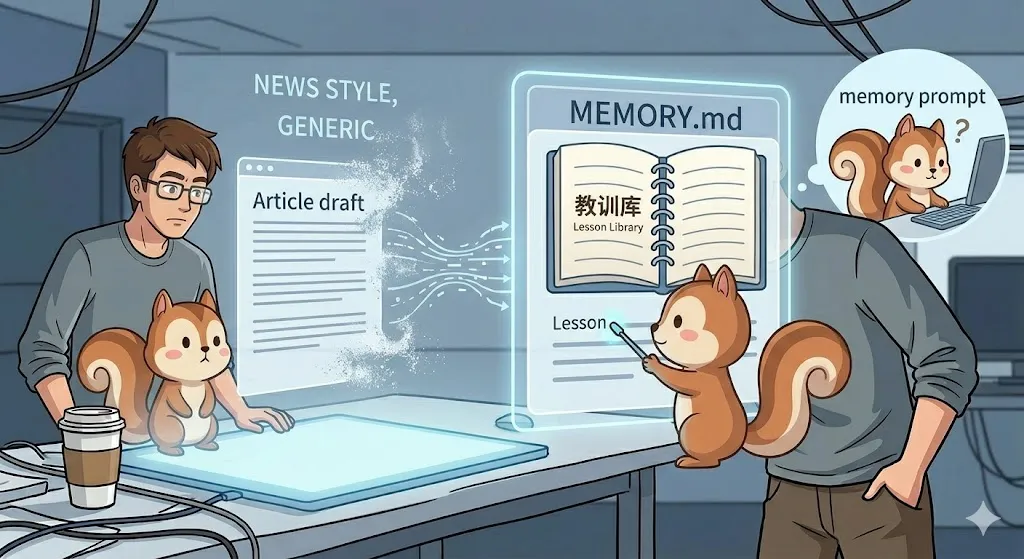

铅笔有一次帮我写文章,写出来的东西四平八稳、没有灵魂,像新闻稿。我直接告诉它:"写得乏味,什么都写但都不透彻。"

它立刻把这个反馈存进了 MEMORY.md:

### 2026-03-15

- 反馈:文章写得乏味,没有真实内容,什么都写但都不透彻

- 教训:聚焦一个点写透,比泛泛而谈更有价值

- 改进方向:只选一个核心点,深挖+案例+细节,不要贪多

从那以后,铅笔再写文章时,会主动聚焦一个核心点,而不是面面俱到地堆砌信息。

失败的事情只错一次——前提是你得让 AI 记住它失败过。

再看对比:

❌ 没有记忆的 AI:

你:"这篇写得太散了。" → AI 改好了。 下次写新文章 → 又散了。→ 你又骂一遍。→ 循环往复。

✅ 有记忆的 AI:

你:"这篇写得太散了。" → AI 改好了 + 存进记忆。 下次写新文章 → 自动翻记忆 → 不再犯同样的错。

一个会犯错但能记住教训的 AI,比一个聪明但每次从零开始的 AI,有用一万倍。

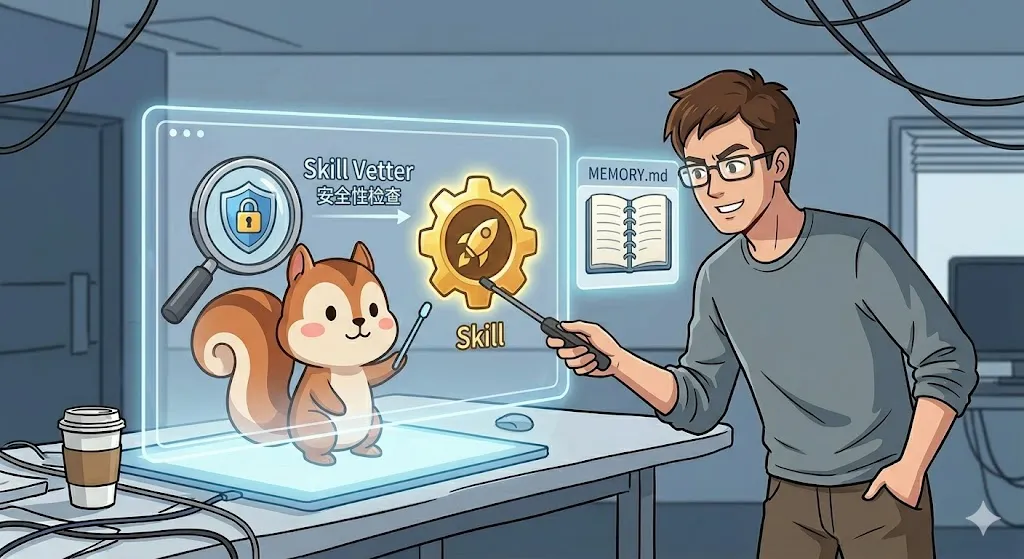

进阶玩法:安装 Skill 前自动安全审查

当你的代理能力越来越强,你会开始给它安装各种社区 Skill——就像给手机装 App 一样。

但问题来了:你怎么知道这个 Skill 安全不安全?

我的做法是,让铅笔在安装任何新 Skill 之前,自动调用 Skill Vetter 进行安全扫描。这个规则也写进了它的记忆文件里。

不需要我每次提醒"先检查一下安全性"——它自己就会做。

这就是"培训新员工"的威力:规则定一次,执行无数次。

大厂迭代了怎么办?重新养?

有人会担心:大模型一更新,之前的"培训"不就白费了?

说实话,恰恰相反,模型是引擎,数据才是资产。

当你把性格(SOUL)、偏好(USER)、技能(Skill)和教训(Memory)都沉淀在本地,你养出的不只是一个工具,而是一个懂你所有隐喻和习惯的数字分身。

模型可以换,但你和“铅笔”共同成长的这一个月,谁也带不走。

别再让你的 AI 每天失忆了。今天就给它定下这两条铁律,把你的“实习生”培养成最懂你的“合伙人”。

Skill 不是关键,龙虾的角色、性格和记忆才是。

这就像一个老员工换了家公司,经验和性格还在,换个环境照样能干活。

写在最后

回到开头那个问题:为什么大多数人用 AI 是"消耗型"的,而少数人用 AI 是"复利型"的?

答案就两条铁律:

🔥 成功 → 封装 Skill → 下次一键复用🔥 失败 → 存进记忆 → 同样的错只犯一次

不需要你懂什么 prompt engineering,不需要你会写代码。你只需要像培训新员工一样,定好规则,持续反馈。

慢慢养,慢慢扩大它的能力边界。一周后,它是实习生;一个月后,它是老员工;三个月后,它比你还懂你自己。

别再让你的 AI 每天失忆了。今天就给它定两条铁律,开始养一只属于你的"龙虾"。

告诉你一个小秘密,这篇文章你看出来,90%都是“铅笔”写的吗?

夜雨聆风

夜雨聆风