最近 OpenClaw 简直火得一塌糊涂,朋友圈里好像每个人都在折腾,都希望自己能在电脑里养一只无所不能的“赛博宠物”。

但结果呢?现实往往很骨感。大多数人费了九牛二虎之力装完之后,对着输入框大眼瞪小眼,不知道该让它干嘛。

新鲜劲一过,每天也就是让它汇总一下新闻,跑个小脚本,硬生生把一台超级大脑用成了自动服务器。

我们到底该如何在 AI 时代,真正有效地配合这类强大的工具一起工作?

今天我读到科技博主 George 的一篇文章,刚好直击了这个痛点。他提出了一个非常有意思的概念:Harness 工程就是控制论。

这句话背后的潜台词是:未来最重要的能力,可能不再是“亲手做”,而是“设计一个系统,让 AI 稳定地替你做”。

Harness 、工程、控制论,听起来有点绕口?别急,我们一点点掰开揉碎了聊。

什么是 Harness?

先说这个很多人第一次看到都会卡壳的词:Harness。它的原意是马的“挽具”或者“缰绳”。

在 AI 时代,如果把 OpenClaw 这种强大的 AI 智能体比作一台马力全开的 V8 发动机,那 Harness 就是专门为它打造的“底盘、方向盘、刹车和仪表盘”。

所以,Harness 到底是什么?

它不是某一句神奇的提示词,也不只是一个命令行工具。它更像是 AI 的“工作框架”。

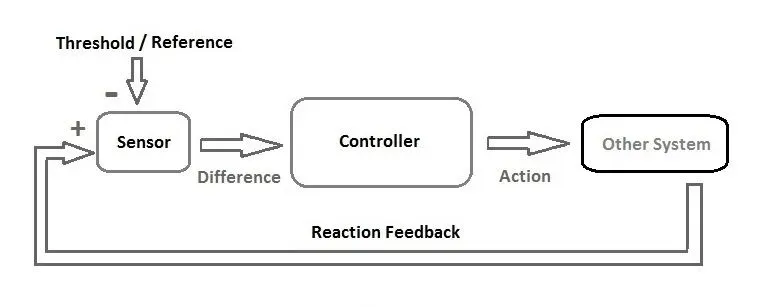

你给它什么运行环境?它能调用什么外部工具?出了错以后,系统怎么自动反馈给它?什么算对,什么算错?走偏了怎么拉回来?

这些东西加在一起,才叫 Harness。

很多人以为,AI 用得好不好,取决于模型够不够强。

其实在很多真实工作场景里,决定上限的不是模型本身,而是你有没有给它一套能跑通闭环的工作系统。

为什么说“程序员先感受到了寒风”?

春江水暖鸭先知。大家都觉得自己的工作早晚会被 AI 取代,而最先感受到这阵凛冽寒风的,正是程序员群体。

前阵子有个很火的案例,Claude 的研究员 Carlini 让 16 个 AI 智能体并行工作,硬生生写出了一个极其复杂的 C 语言编译器。

你猜他用了什么魔法?其实,他给 AI 的提示词(Prompt)简单得令人发指。他真正下血本的地方,是花大量时间为 AI 搭建了一套极其严密的“测试基础设施”。

他自己原话说:“我大部分精力,都花在了围绕 AI 搭建环境上——写测试、配环境、做反馈机制。”

无独有偶,OpenAI 最近也发文谈到了这种“Harness 工程”。在他们的实践中,人类工程师已经不再亲自敲代码了。短短五个月内,AI 自动生成了一百万行代码,人类全程零手工编写。

这意味着什么?这就意味着,人类工程师的工作重心彻底转移了。

读到这里,你可能会觉得这是一种前所未有的颠覆。但 George 提醒我们:等等,这种模式历史上重演过好几次。

从“拧阀门”到“掌舵”

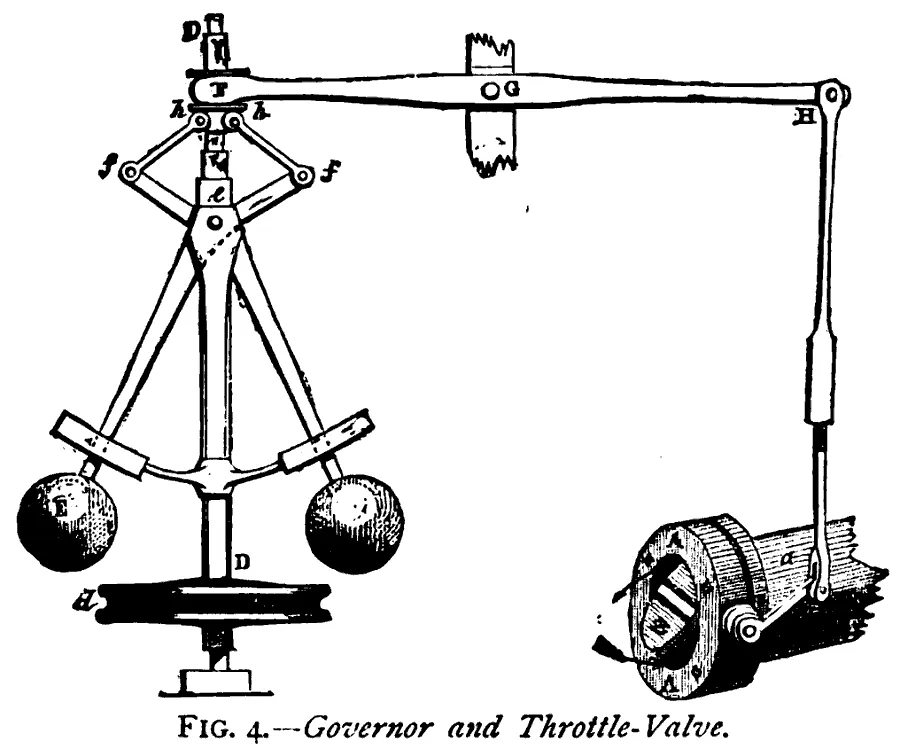

我们要穿越回 18 世纪 80 年代。那时候,詹姆斯·瓦特发明了蒸汽机的离心调速器。

在这个小玩意儿诞生之前,工人必须大汗淋漓地守在蒸汽机旁,死死盯着仪表,靠双手一点点地调节阀门。

调速器发明之后,一个带重锤的飞球装置就能自动感知转速:转快了关小阀门,转慢了开大阀门。

结果工人失业了吗?并没有。只是他们的工作性质变了:从“手工拧阀门的人”,变成了“设计调速器的人”。

1948 年,著名的数学家诺伯特·维纳为这种模式正式命名为:控制论(Cybernetics)。这个词源自希腊语,意思正是“舵手”。

你不再是底舱里满身机油、手动拧阀门的船员了。你要走到甲板上,开始掌舵。

这意味着在 Agent 时代,最值钱的能力,不再是“我会不会写一段牛逼的提示词”,而是“我会不会搭一个让 AI 能稳定做对事情的系统”。

说得更直白一点:以后会不会用 AI,不再只是“会不会提问”,而是“会不会当教练、当裁判、搭训练场”。

为什么我们总是吐槽 AI“瞎搞”?

其实,以前我们在软件开发里也有反馈机制。比如编译器查语法、测试套件查功能、代码检查工具查排版格式。但这些“调速器”太低级了,只能检查死板的规则。

一旦遇到高级别的问题,比如“这次修改符合系统整体架构吗?”、“这是最优解吗?以后会不会埋下大坑?”。

过去我们没有传感器,也没有执行器。只能靠人类老司机一边盯着代码,一边亲自上手敲键盘改 Bug。

现在,大语言模型(LLM)的出现打破了僵局。AI 第一次拥有了在“高级架构和逻辑”层面上感知和行动的能力。

这就形成了真正的闭环:系统不仅会犯错,还能看到错误、理解错误、并不断修正错误。

一旦这件事发生在代码这一层,整个软件工程的分工就会开始变化。

把你的“判断力”写出来

但是,会干活的 AI 有了,如果你不给它立规矩,它一样会闯大祸。

很多人试用完 AI 后大失所望,疯狂吐槽:

“它老是瞎搞!”、“它根本不懂我们的业务逻辑!”。

这种判断其实大错特错。AI 搞砸了,不是因为它笨,而是你从来没把“什么叫懂”说清楚。

比如你们公司认为什么是“好代码”,你们团队的架构鼓励什么模式、排斥什么写法——全都锁在你的脑子里!你没把它说出来,AI 又不会读心术,它怎么可能懂?

如果你不把这些潜规则白纸黑字写下来,它运行一百次,就会犯一百次一模一样的错误。

这就是为什么,真正困难的工作,从来不是“把 Agent 跑起来”,而是“把你的判断力外化出来”。

所以,我们现在最重要的工作,就是要把脑子里的“判断力”,翻译成机器能读懂的规则。

比如,把架构文档写清楚;在代码报错里附上“修复指引”;把团队对设计的“品味”变成黄金准则固化在系统里。

偷懒的代价被放大了成千上万倍

这种转变逼着我们必须去做“正确但痛苦”的事。

过去三十年,无数软件工程的书籍都在苦口婆心地劝大家:要写好文档,要做自动化测试,要把规则代码化。

但大多数人都选择了偷懒,因为以前偷懒的代价是温水煮青蛙,技术债务只是悄悄积累,一时半会儿死不了人。

但在 AI 时代,偷懒的代价被放大了成千上万倍!

如果你不写文档、不写测试,AI 就会以机器的光速,没日没夜、不知疲倦地为你批量制造垃圾代码。

最致命的是:如果 AI 根本不知道“正确的代码”长什么样,你连让它自己收拾烂摊子的机会都没有。

未来的生存法则:比机器更会“验证”

所以,未来人的核心价值到底在哪?

文章里提到了一个非常深刻的洞察:生成与验证的不对称性(Generation-verification asymmetry)。

这也涉及到著名的数学难题 P/NP 问题。听不懂没关系,简单说就是:“自己解一道超级数学难题极度困难,但拿着正确答案去验证别人做得对不对,却非常容易。”

这正是大模型时代的生存法则。AI 生成复杂解决方案的速度是人类无法比拟的,这意味着,我们不需要在“亲自实现”这件事上跟机器死磕。

你真正要练就的绝世武功,是“评估能力”。

未来,最核心的竞争力,不是“比机器更会生成”,而是“比机器更会验证”。

你要能清晰地定义什么是“正确”,要在 AI 给出方案时一眼看穿它的破绽,要能准确判断这艘船的大方向到底对不对。做那个站在系统之上,负责校准、评估、掌舵的人。

这也是作者把这件事和“控制论”联系起来的核心原因。控制论这个词,说白了,就是一件事:系统如何感知自己、调整自己、朝目标持续靠近。

以前,人是系统里那个手动调节的零件。现在,人越来越像系统的设计者和舵手。

当年设计了瓦特调速器的工人们,再也没有回到锅炉旁去手动拧过阀门。不是因为他们老了拧不动了,而是因为时代变了,那样做已经毫无意义。

所以,别再把你的 OpenClaw 当成汇总新闻的玩具了。去思考一下你的业务流程,去搭建你的“方向盘和刹车”,去设计你的 Harness。

你准备好,成为新时代的舵手了吗?

最近文章列表:

[4] Claude 控诉中国 AI 组团“偷家”?到底什么是“大模型蒸馏”?

[5] 价值 3000 元的 AI 内部培训课,今天我把它“开源”了

[7] 日均30万亿!拆解 AI 时代的“计量单位” Token

[8] 2 分钟讲透:为什么 AI 会胡说八道?(附避坑指南)

[9] AI 的回复怎么完美转 Word?只要看懂这个格式 Markdown,效率翻倍

[12] Vibe Coding 提示词指南(内附编程提示词速查表)

[13] 为什么你的 AI 用得没别人好?AI 真正的核心不是提示词,而是逆向工程

[14] AI 时代最危险的幻觉:90% 的人都在用 AI “假装”变强

夜雨聆风

夜雨聆风