近期,开源智能体框架 OpenClaw 在行业内迅速走红,因其具备系统级操作权限、可自主执行任务,并支持长期运行与多平台交互,目前已成为 GitHub 上关注度最高的智能体框架之一。OpenClaw为智能体的发展带来了新的发展机遇,但其全自动运行带来的高 Token 成本,以及主要依赖纯文本索引的记忆体系等问题,也为智能体的发展带来了不少挑战。

在这一背景下, 联想 CTO 组织技术战略与平台人机交互团队将OpenClaw完整部署并运行在端侧——联想个人AI中心概念机Project Kubit 上。

Project Kubit个人AI中心概念机

基于Kubit的本地高性能算力与全链路私有存储能力,团队对 OpenClaw 的运行形态进行了系统级重构,还把OpenClaw的记忆系统升级为多模态个性化记忆,大幅提升了OpenClaw和个人智能体解决复杂问题的能力。近日,这一架构在 OSWorld 基准测试中取得 74.5% 的单次运行成功率,首次稳定超越人类平均表现,充分展示了联想在下一代个人智能体技术发展中的创新实力。

端侧系统级重构 降低长链路任务 Token 开销

在端侧,团队使OpenClaw形成了模型—记忆—推理—执行的完整闭环。这并非简单地“把模型搬到本地”,而是在保持原有决策能力与行为一致性的前提下,通过对模型形态与推理路径的深度优化,显著降低长链路任务中的 Token 开销与执行不确定性。

优化后的 OpenClaw 不再是一次性响应请求的实例,而是成为了一个可以长期驻留、持续学习,并与个人记忆共同演化的本地智能体。在实现层面,这一能力依托于端侧模型与推理引擎的协同优化:模型侧通过量化与混合精度策略降低显存与内存占用;推理引擎侧通过数据布局与算子融合等手段,系统性压缩访存开销与冗余计算,使“长期记忆 + 长时任务”成为可持续运行的工程现实。

多模态个性化记忆:让 OpenClaw 的记忆真正“可追溯”

在端侧稳定运行的基础之上,我们又将OpenClaw的记忆系统升级为多模态个性化记忆。区别不在于记得“更多”,而在于记忆是否具备“看见真实世界”的能力。在引入多模态记忆之前,OpenClaw 的记忆体系主要依赖纯文本索引:它可以记录对话内容、任务描述与推理结论,但在真实的场景中,面对大量视频画面与操作路径构成的信息时,往往只能命中零散的语义片段,难以准确还原任务发生的完整过程。这种记忆方式在跨应用、长链路任务中尤为脆弱,容易出现“记得结论,却忘了依据”“能复述描述,却无法复现操作”等问题,进而导致上下文断裂与决策漂移。例如,当用户向 OpenClaw 上传视频时,系统无法直接完成视频理解与记忆构建;即使引入解码工具的有限支持,也只能对视频进行单帧抽取,从而获取局部信息,难以形成完整、可用的记忆表示。

引入多模态个性化记忆后,OpenClaw 的记忆对象发生了根本变化。系统不再只存储“被描述过的信息”,而是直接将音视频关键帧等多模态信息,与时间戳、任务意图和操作步骤进行统一建模,形成可查询、可回溯的视觉记忆(Visual Memory)。这使智能体不仅能够回答“发生了什么”,还能够明确回答“当时看到的是什么画面、基于哪一步操作、在什么界面下做出的判断”,从而首次具备了对信息来源与演化路径进行溯源式理解的能力。

基于多模态个性化记忆优化后的 OpenClaw 在实际使用中表现出色:在仅有纯文本记忆的情况下,智能体往往只能模糊找到相关内容,却难以定位真正决定任务成败的关键步骤;而在多模态记忆增强后,记忆检索不仅更加准确,而且具备可验证性,既能找到正确的记忆片段,也能清楚说明该记忆来自哪一次操作、哪一帧画面。这种能力上的变化,使 OpenClaw 从“记得差不多”跃迁为“记得准确、记得可追溯”。

比如,当用户上传一段视频,记录其从冰箱中取出一瓶牛奶并倒入杯中,随后发现牛奶已空时,我们的记忆插件会对视频进行分析,识别出用户存在采购牛奶的需求,并在检测到用户下班这一情境时,自动提醒其进行采购。此外,当用户询问自己此前是否喝过某种饮料时,记忆系统可以基于过往的视频记忆,给出对应的饮用时间以及具体发生的场景。

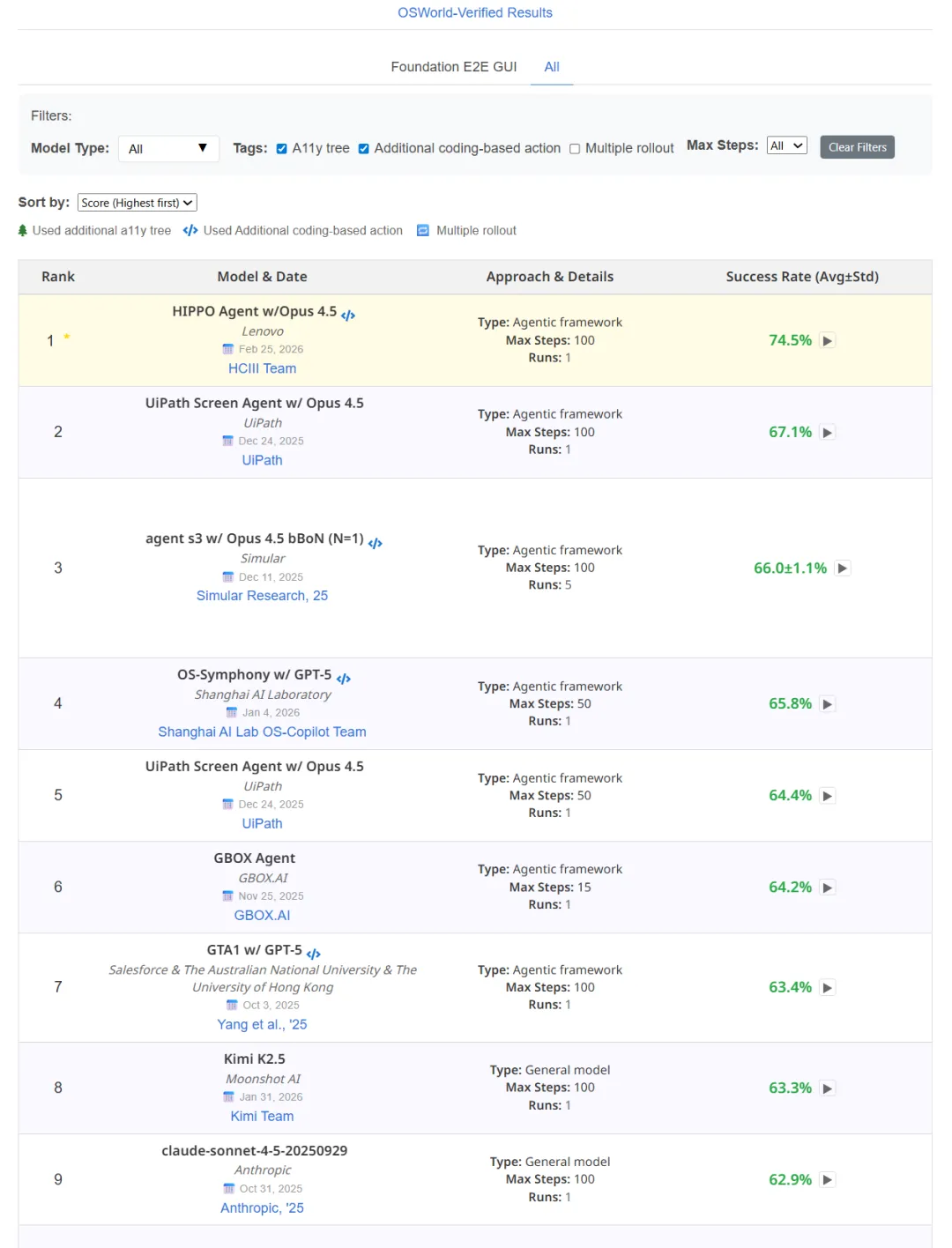

OSWorld:检验记忆驱动架构有效性的关键试金石

真正检验这套记忆技术体系含金量的,是 OSWorld。作为当前计算机操作领域最具权威性与区分度的基准测试之一,OSWorld 覆盖 369 个真实世界的电脑桌面与网页任务,采用基于执行结果的自动验证机制,要求智能体在真实系统环境中完成完整交互并生成可复现的执行轨迹。这意味着,任何依赖提示工程或“看起来像对的输出”的方式,几乎都无法在该基准上奏效。OSWorld 对能力层级的区分极为清晰:人类操作者的平均成功率约为 72%。也就是说,人类操作者在单次执行、不允许反复尝试或回退的评测条件下,平均约有 72% 的任务能够一次性将系统状态正确推进到预定义的目标终态。而即便是近期最先进的智能体,其单次运行成绩也长期停留在 67% 左右。这一差距并非源于模型“不够聪明”,而是暴露了大模型在长程、复杂系统交互中普遍存在的工程瓶颈——对隐式上下文的过度依赖,导致状态遗忘与行为方差持续放大。

针对上述问题,我们采用的正是前文所述、在 Kubit 上为 OpenClaw 引入的记忆技术。在 OSWorld 场景中,智能体更像是一匹动力充足却极易脱缰的“算力野马”,而真正决定成败的,是能否通过外部架构为其提供稳定的“缰绳”。为此,我们将记忆能力从模型内部的隐式上下文,提升为显式、非易失、可控的系统级能力:通过外部过程记忆保存关键中间状态,避免长链路推理中的信息遗忘;通过前瞻性意图记忆对任务焦点进行动态锚定,显著收敛执行过程中的行为方差;并结合记忆友好的工具与执行环境设计(Harness Engineering),系统性降低交互过程中的认知负载与熵增。

基于上述记忆驱动架构,团队在 OSWorld 的单次运行中取得了 74.5%的成功率,首次实现稳定超越人类平均水平。这一结果并非源于模型规模的简单提升,而是来自对长程任务中状态遗忘与行为漂移问题的系统性解决。消融实验进一步表明,在引入显式记忆与低熵执行环境后,任务成功率与执行稳定性均显著收敛,验证了:在复杂系统交互中,记忆系统能够显著提升大模型在长链条任务上的整体能力。以具体任务为例,在去除图片背景的场景中,缺乏记忆机制的智能体往往在背景尚未完全清除时便提前结束任务,而基于记忆驱动的 智能体 能够持续跟踪任务完成状态,直至整张图片被完整处理后才终止执行;在将 PPT 中某一图片设置为背景的任务中,传统智能体常在执行过程中迷失目标,反复重新选择图片甚至陷入循环操作,而引入记忆机制后,智能体能在完成图片选择后稳定保持该决策,并顺利完成后续背景设置流程。

从个人AI中心概念机Project Kubit到 OSWorld 的实证结果,联想CTO组织技术战略与平台人机交互团队始终围绕一个核心方向展开探索:让 AI 能够长期、稳定地跟随个人一同成长。当个性化记忆成为系统底座,AI 才能逐步从一次性响应的工具,演化为真正理解用户、与个人经验共同成长的智能体。

夜雨聆风

夜雨聆风