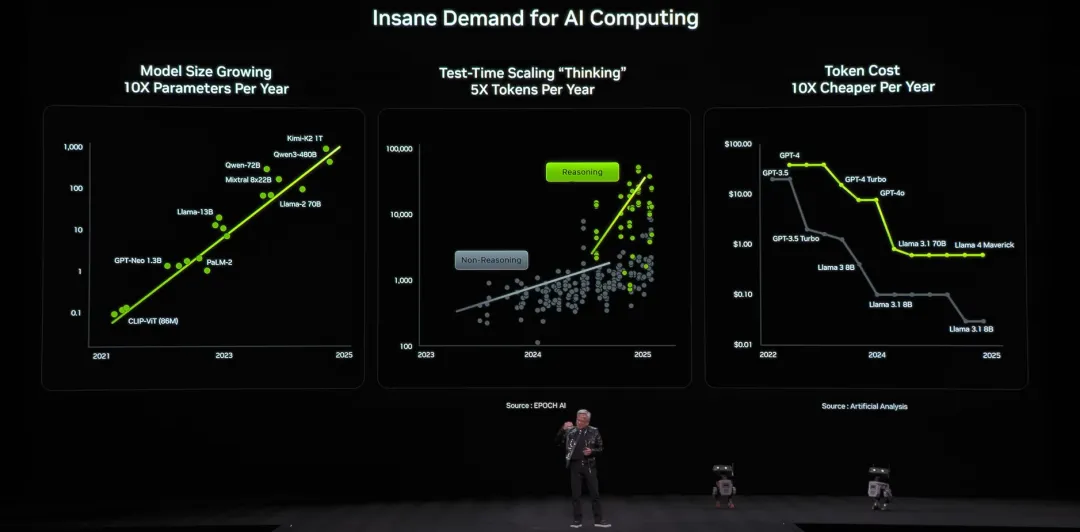

推理模型让每个问题消耗更多Token

Agent系统会持续调用模型,Token变成“流量”

长任务、多步骤,Token像电一样持续计费

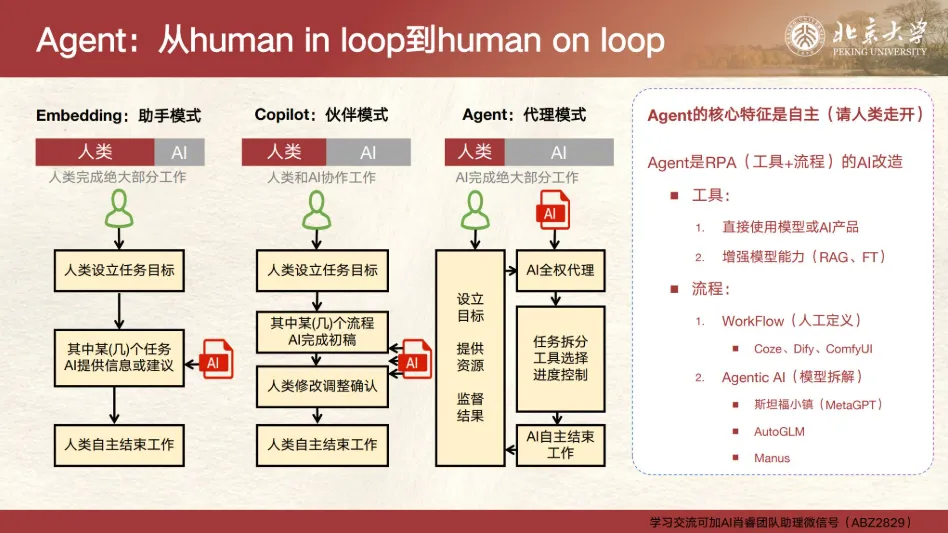

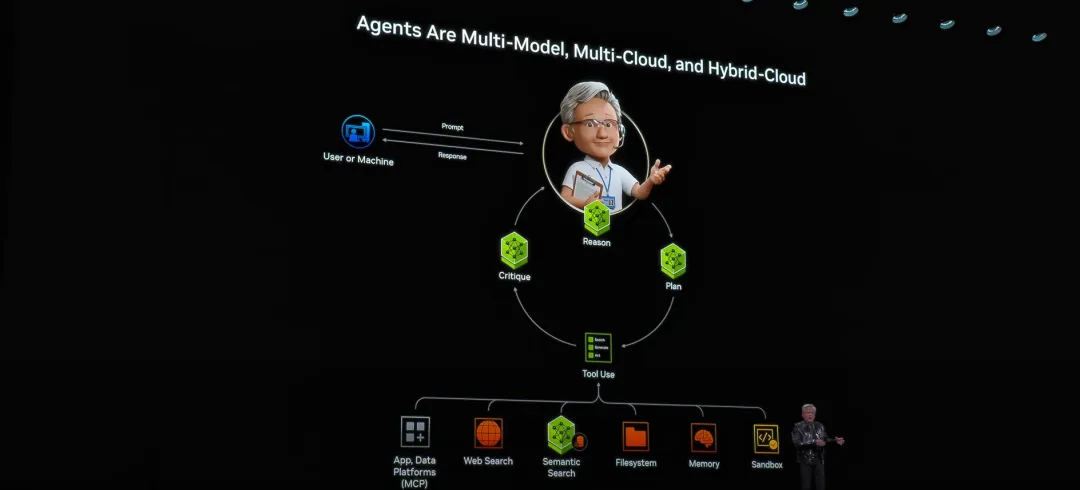

传统的软件交互模式是人点击按钮 → 软件执行固定逻辑 → 返回结果。

现在的模式正在重塑为人下达一句话指令 → Agent拆解任务 → 协同调用多个工具、模型与数据源 → 最终交付成果。

这中间的差别是软件从功能集合变成任务执行者。

多模型(语言、视觉、语音)

多工具(搜索、数据库、软件接口)

多环境(本地、云、多云)

持续上下文(记忆)

OpenAI:持续深耕工具调用(function calling),最新GPT-5.4已经原生支持「computer use」,直接能看屏幕、操作鼠标和键盘。 Anthropic:重点强化Agent长循环,能安全跑好几天,同时推出Claude Computer Use和多代理协作。 开源社区

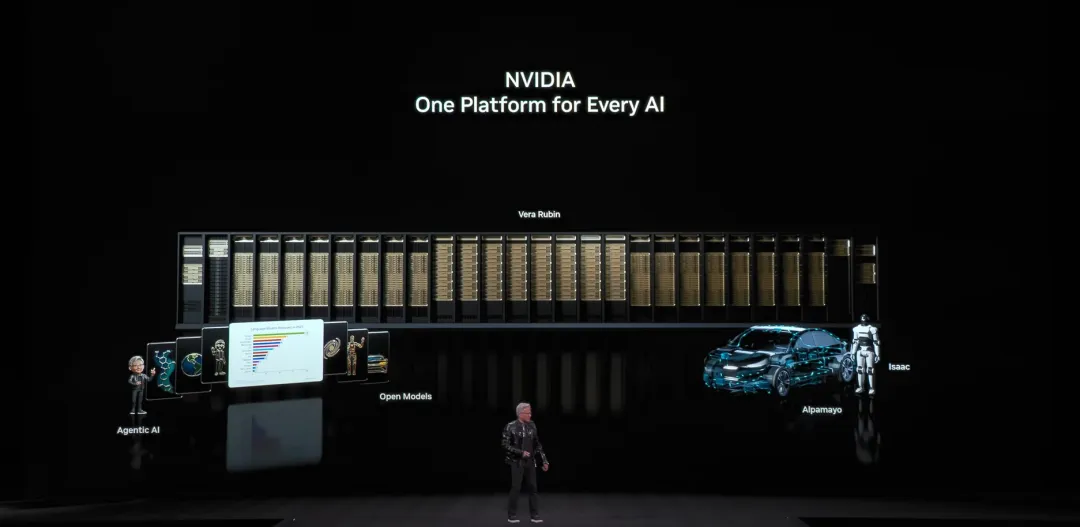

训练(赋予学习能力) 推理(执行决策判断) 模拟(验证现实世界)

Omniverse: 构建可高度模拟的数字孪生世界。

Cosmos: 专注训练探索现实规律的“世界模型”。

Isaac / 自动驾驶平台: 让机器人在仿真环境中率先掌握行动逻辑。

芯片底层(GPU、CPU、DPU)

系统架构(整机、互联网络、超级计算机)

软件生态(CUDA、AI框架、推理系统)

应用平台(Agent、物理AI、数字孪生)

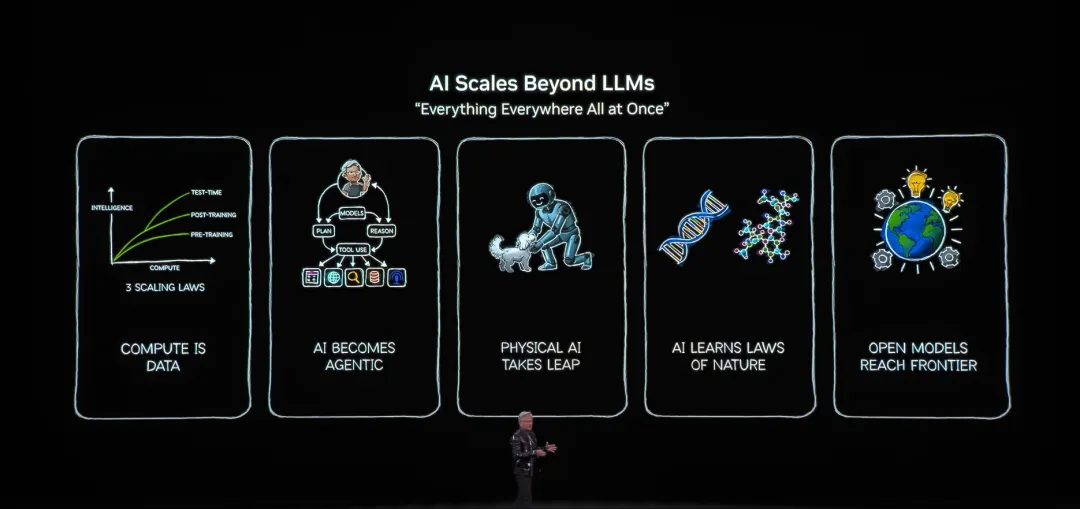

上半场: 主攻生成(赋予AI“说”的能力) 中场: 深耕推理与Agent(赋予AI“做”的能力) 下半场: 决胜物理AI(推动AI全面融入现实世界)

往期推荐

手把手教你养一只龙虾🦞(OpenClaw)安装教程AI肖睿团队

「AI肖睿团队」由北京大学博士肖睿老师作为发起人、领头人。输出技术正确、有独立洞察、有落地价值的内容,用开源模式免费传播。

✅不定期分享北京大学内部研讨资料

✅不定期分享产业级落地方案

✅ 深度解析行业趋势

✅ 随时解答你的AI疑惑

关注我们,和10W+AI从业者一起进阶!

夜雨聆风

夜雨聆风