OpenClaw作为开源AI智能体框架,正在从对话工具向执行工具演进。本文从投研应用角度出发,介绍了OpenClaw的部署方案、数据源接入以及投研应用场景实践。

OpenClaw部署与使用

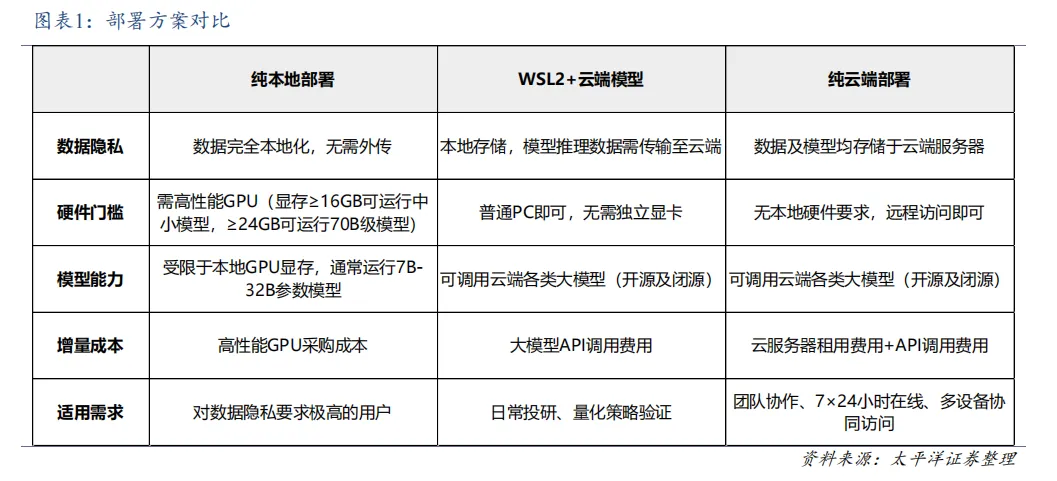

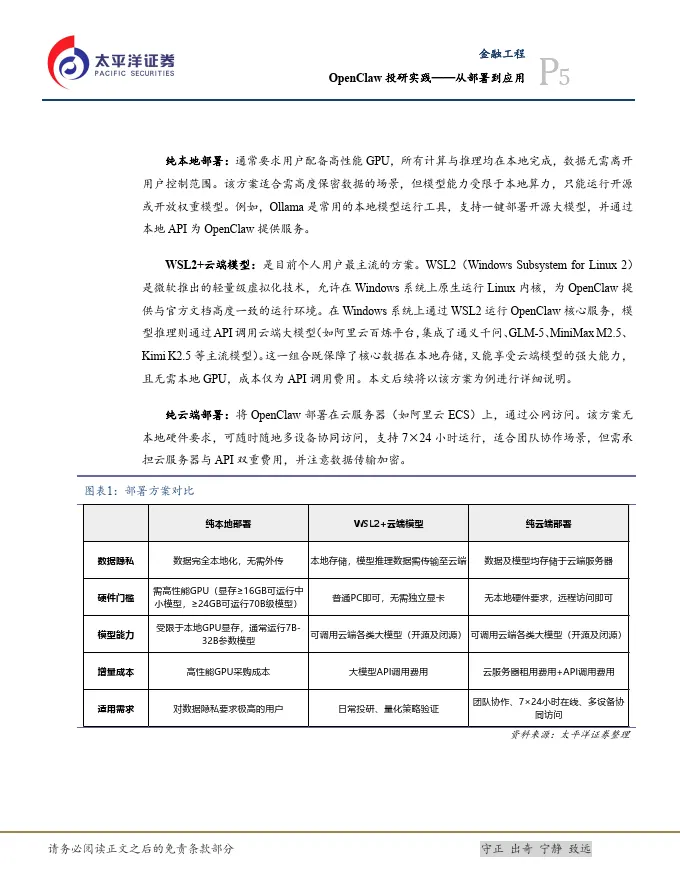

(一)部署方案对比

OpenClaw 的部署方式可划分为三类主流方案,分别是纯本地部署、WSL2+云端模型、纯云端部署,分别适用于对数据隐私、计算资源、网络依赖及成本有不同需求的用户场景。三类方案在数据存储位置、硬件要求、模型能力及成本结构上存在显著差异,用户可根据自身需求选择,不同方案将影响后续应用的边界与使用体验。

纯本地部署:通常要求用户配备高性能GPU,所有计算与推理均在本地完成,数据无需离开用户控制范围。该方案适合需高度保密数据的场景,但模型能力受限于本地算力,只能运行开源或开放权重模型。例如,Ollama 是常用的本地模型运行工具,支持一键部署开源大模型,并通过本地API 为OpenClaw 提供服务。

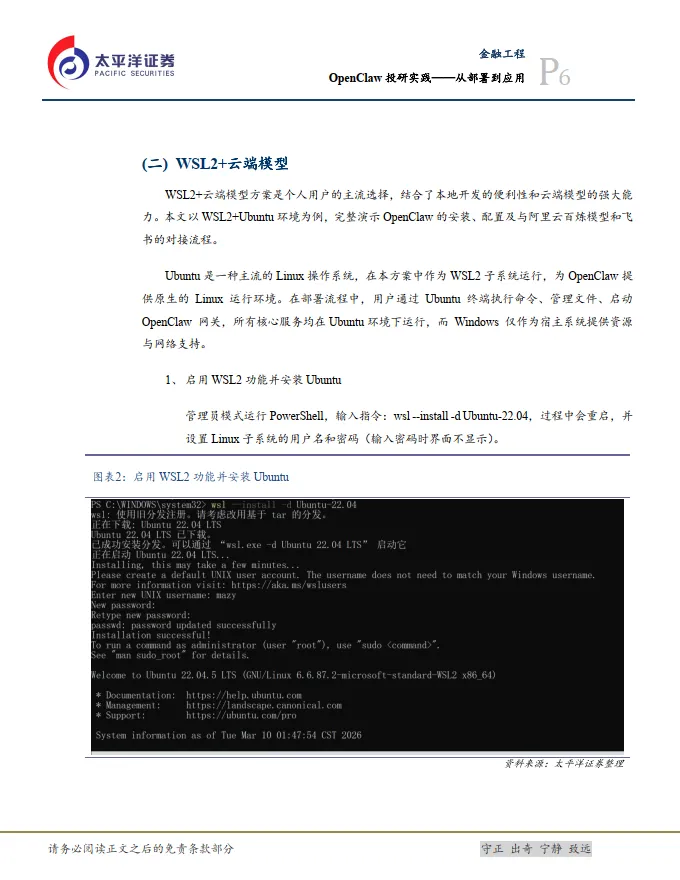

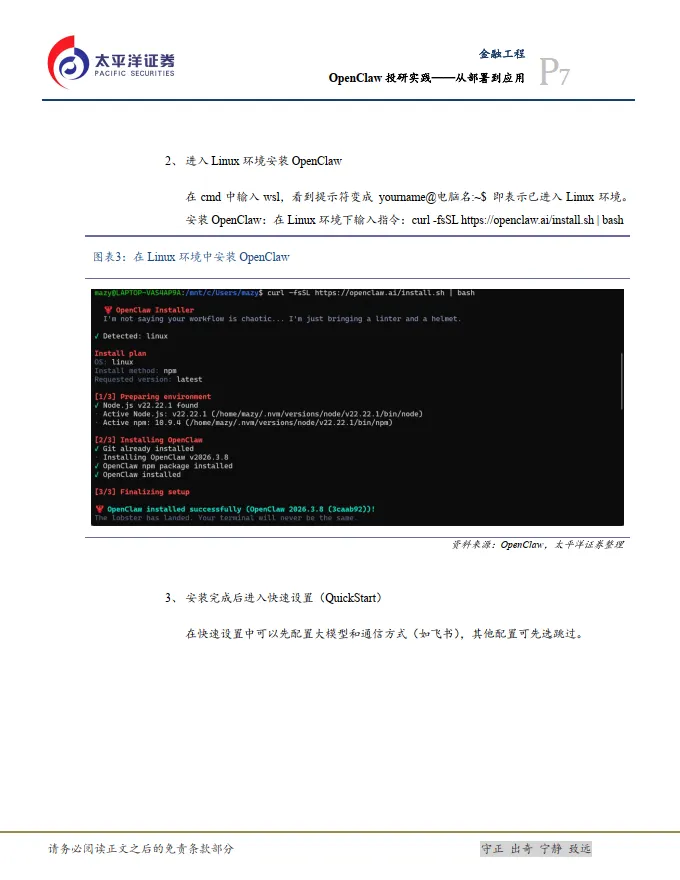

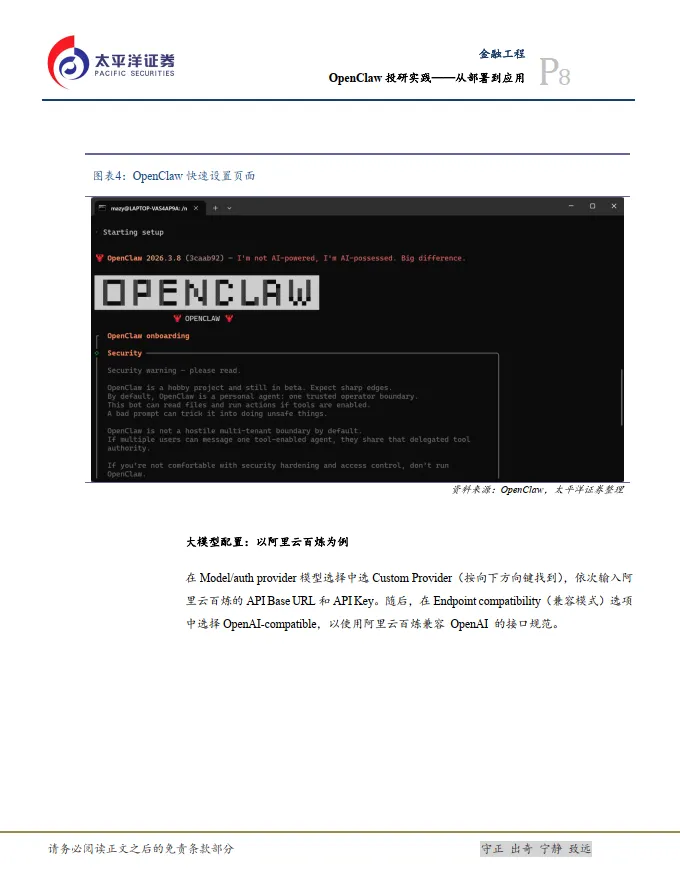

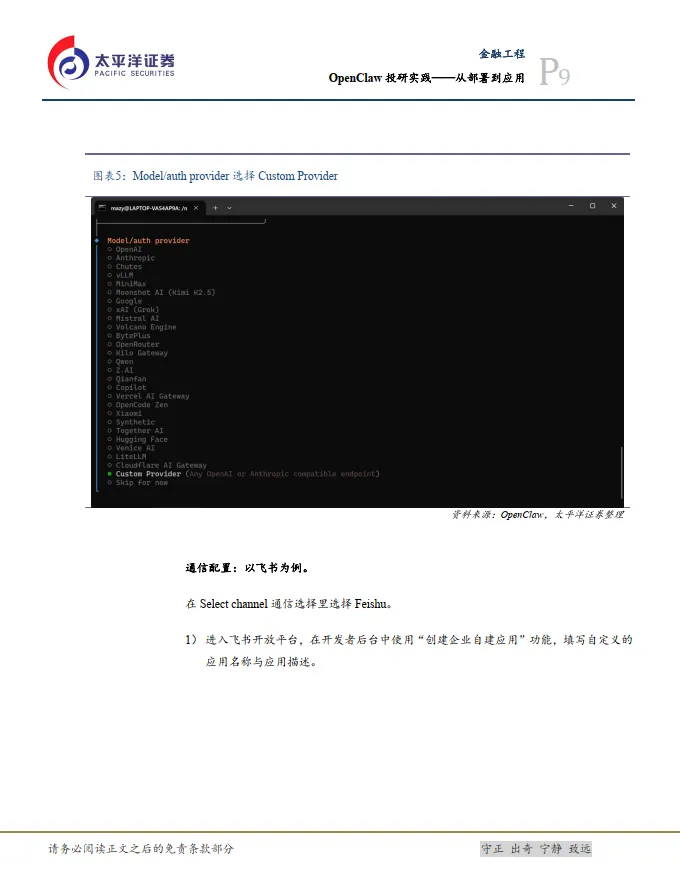

WSL2+云端模型:是目前个人用户最主流的方案。WSL2(Windows Subsystem for Linux 2)是微软推出的轻量级虚拟化技术,允许在Windows 系统上原生运行Linux 内核,为OpenClaw 提供与官方文档高度一致的运行环境。在Windows 系统上通过WSL2 运行OpenClaw 核心服务,模型推理则通过API调用云端大模型(如阿里云百炼平台,集成了通义千问、GLM-5、MiniMax M2.5、Kimi K2.5 等主流模型)。这一组合既保障了核心数据在本地存储,又能享受云端模型的强大能力,且无需本地GPU,成本仅为API 调用费用。本文后续将以该方案为例进行详细说明。

纯云端部署:将OpenClaw 部署在云服务器(如阿里云ECS)上,通过公网访问。该方案无本地硬件要求,可随时随地多设备协同访问,支持7×24 小时运行,适合团队协作场景,但需承担云服务器与API 双重费用,并注意数据传输加密。

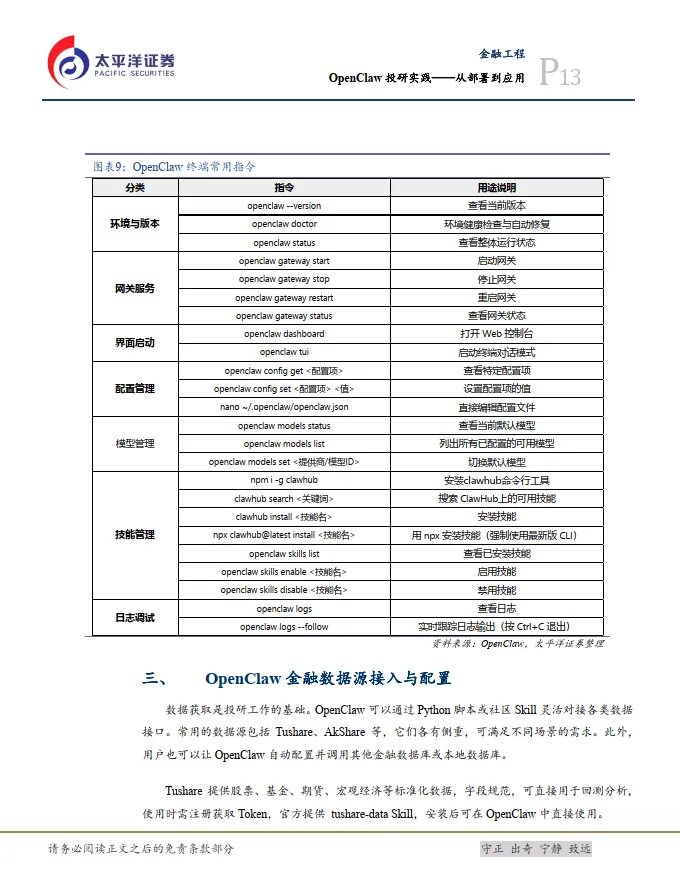

(二)常用指令

OpenClaw 提供丰富的命令行工具,以下按功能分类列出常用指令。部分关键配置变更操作执行后,需重启网关才能使修改生效。

幻影视界整理分享报告原文节选如下:

戳“阅读原文”下载报告。

戳“阅读原文”下载报告。 夜雨聆风

夜雨聆风