AI应用进展和演化

1-1 清华团队养出了一只「龙虾老师」!教育版OpenClaw震撼开源

清华团队近日开源了全球首个多智能体AI课堂系统OpenMAIC,被誉为“教育界的OpenClaw”。它不再只是单点工具,而是能一键生成完整教学闭环的AI教室:从课件制作、语音授课、白板互动、AI同学举手讨论,到随堂测验与个性化答疑——全部自动完成。

项目已在清华真实课堂运行两年,服务超1万名师生,支撑10余篇顶会论文,并于2025年接入国家智慧教育平台,累计访问超2000万次。更关键的是,它已深度对接OpenClaw,用户在飞书对“龙虾”说一句“生成一节AI新闻课”,即可全自动执行搜索、备课、讲解全流程。

1-2 藏语 AI 时代正式开启:全球首个藏语大语言模型 DeepZang 发布

全球首个藏语大语言模型“DeepZang”在拉萨正式发布,标志着我国在民族语言人工智能领域实现历史性突破——从过去的技术“跟跑”跃升为“领跑”。该模型由西藏觉罗数字产业管理有限公司自主研发,是我国首个通过国家生成式AI算法与模型备案的藏语大模型,也是全球首个获世界纪录认证(WRCA)的藏语大模型。

DeepZang App支持藏、汉、英三语智能交互,具备AI对话、实时翻译和语音转写等实用功能。目前,模型已积累高质量藏语平行语料近7000万条,覆盖卫藏、安多、康巴三大方言的语音数据超3.05万小时,为藏语理解与生成提供了坚实基础。

1-3 科技CEO用ChatGPT+基因数据定制癌症疫苗!肿瘤缩小50%

面对传统治疗无效、无现成药物的困境,零生物学背景的Paul借助ChatGPT学习免疫疗法知识,完成基因测序,并用AlphaFold预测突变靶点;再联合新南威尔士大学RNA研究所,仅用数周就设计出专属mRNA疫苗。

2025年底起两针接种后,Rosie腿部肿瘤缩小50%,精神与行动力显著恢复——如今能跳栅栏、追兔子。整个过程通过3个月严格伦理审批,100多页材料层层把关,确保安全合规。这是全球首例为犬类定制的个性化AI-mRNA癌症疫苗(获OpenAI总裁确认)。它不单是“AI救狗”的奇迹,更印证了:当技术能力、跨学科思维与人文关怀结合,普通人也能在生命科学前沿撬动希望。

AI大模型算法、赛事和会议

2-1 突破万次连续编辑极限!中科院提出首个理论保稳的知识保留方法

LyapLock是一项突破性的AI模型编辑技术,首次为大语言模型装上了“终身学习锁”。传统方法在单次知识更新上很准,但连续编辑时会“越改越忘”——实验显示:编辑1万次后,所有主流方法在GLUE六大任务上性能归零,而LyapLock稳守底线,通用能力几乎不降。

它创新性地将连续编辑建模为带长期约束的随机规划问题,融合排队论与李雅普诺夫优化,用“虚拟队列”实时监控遗忘风险,动态平衡新旧知识。理论证明其能长期稳定,实验验证其编辑效果比当前最优方法提升11.89%,在LLaMA-3等模型上成功支撑超2万次编辑。更妙的是,它可即插即用——赋能现有编辑器,使下游任务表现最高提升41.11%。

2-2 UIUC清华微软联合提出PlugMem:当Agent记忆告别「经历」,开始存储「经验」

PlugMem 是一项面向大语言模型(LLM)Agent 的新型长期记忆设计,由清华、UIUC 和微软研究院联合提出。它直击当前Agent记忆的痛点:在聊天中好用,换到网页浏览或多跳问答就失效。

PlugMem另辟蹊径,不存“做过什么”,而存“学会了什么”,将记忆单元抽象为三类可决策知识:语义知识、程序性知识(如“登录需先点‘我的账户’”)和情境处方(如“比价时应打开新标签页”)。这些知识以命题和行动规则形式组织成“知识图”,而非文本或实体图。实验覆盖三类差异极大任务(长对话、Web导航、多跳问答),未做任何任务适配,却在全部任务中提升成功率,同时平均减少37%的记忆token消耗。

2-3 天下苦「调参」久矣!MIT师生推出全新RandOpt算法

MIT师生最新研究提出了一种颠覆性思路:大模型“调参”可能根本不需要复杂优化!他们发现,像Qwen2.5这样的优质预训练模型周围,其实密布着大量“偏科专家”——即在数学、编程、化学或写作等特定任务上表现优异的参数变体,论文形象称之为“神经丛林”。

实验显示:对32B大模型施加1000次高斯噪声扰动后,超60%的扰动能提升至少一项任务性能;而小模型(如0.5B)该比例不足20%。基于此,他们推出极简算法RandOpt。结果表明,在数学、编程等任务上,RandOpt准确率媲美甚至超越PPO/GRPO;视觉-语言模型准确率更从56.6%跃升至69.0%。

AI基础设施方面(硬件、系统和数据)

3-1 龙虾GPU来了!老黄杀入OpenClaw战场,全新Rubin算力狂飙35倍

GTC 2026上,英伟达发布两大革命性产品:Vera Rubin超算平台和NemoClaw操作系统。Vera Rubin由7颗芯片集成,单机架达15 exaFLOPS FP4推理算力,是前代Blackwell的14倍;首次引入Groq LPU后,高价值推理性能狂飙35倍,Token生成率两年提升350倍。

功耗效率图显示:同等电力下,Vera Rubin比Hopper提升超100倍吞吐。与此同时,NemoClaw作为“个人AI操作系统”,内置安全沙箱、本地Nemotron模型与隐私路由,让企业可放心部署Agent——推动SaaS向GaaS(Agentic as a Service)升级。

3-2 喂饱OpenClaw!北大中科院95后打造星际超算,硬刚马斯克

中科天算与炎和科技联合发布全球首个“太空超算原型系统”,并成功完成与钙钛矿能源系统的全流程联调。原型机实现10POPS级AI算力,采用国产多核CPU+GPU+NPU+FPGA异构架构,具备强辐射耐受、-100℃~120℃宽温运行能力;配套的“星云”钙钛矿太阳翼光电转化效率超20%,质量比功率达500W/kg(约为传统晶硅电池3倍),在轨寿命超8年。

相比SpaceX计划2030年部署百万颗卫星的远期构想,我国已率先实现算力与能源双系统真实联调验证。按规划,“天算一号”实验星将于2026年下半年发射,2030年建成10颗以上、总算力10EOPS的万卡级太空超算中心。

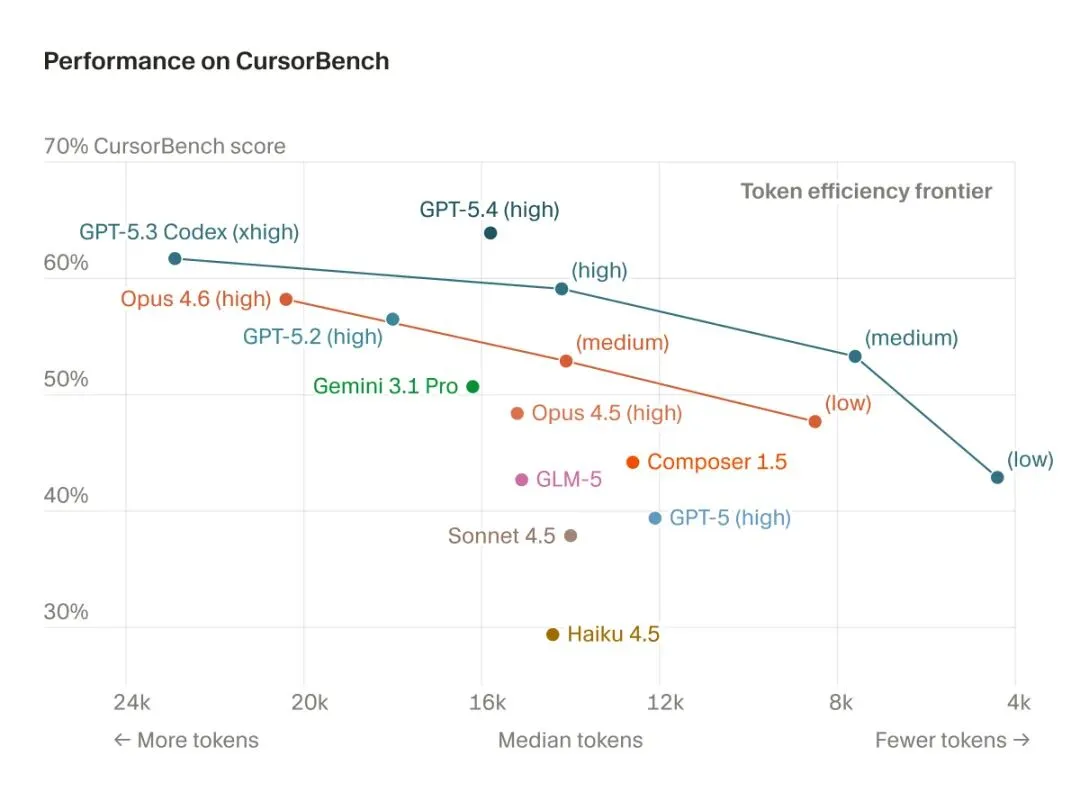

3-3 拜拜了SWE-Bench!Cursor刚发了个AI Coding评测基准,难哭Claude

Cursor近日推出全新AI编程评测基准——CursorBench,直击当前主流基准的三大短板:任务不真实、评分太死板、数据已污染。关键数据显示:Claude Haiku 4.5得分从SWE-Bench的73.3暴跌至CursorBench的29.4,Sonnet 4.5也从77.2骤降至37.9——差距凸显“能解题”不等于“会干活”。

CursorBench采用线上+线下双轨评测:线下用真实用户请求构建任务,从正确性、代码质量、效率、交互等维度打分;线上则通过A/B测试追踪用户真实行为(如接受率、任务完成率)。结果表明:其排名与用户体验高度一致,且对前沿模型区分度更强。

AI人才和资本动态

4-1 又一家10亿级美元"新实验室",Anthropic工程师创办Mirendil,融资1.75亿美元

前Anthropic科学家Behnam Neyshabur和Harsh Mehta联合创立AI新创公司Mirendil(估值10亿美元),正洽谈融资1.75亿美元。该公司专注用AI加速生物学、材料科学等前沿科研,目标是打造能进行长期科学推理的“AI工程师”模型。

团队背景雄厚:CEO曾领导Google DeepMind推理研究超5年;CTO在Anthropic主导AI自动化研发,此前在Google工作10年;另两位联合创始人分别来自xAI和OpenAI。Mirendil是近期涌现的“新实验室”代表之一,这类机构不追求通用大模型,而是聚焦垂直科研场景或开源/物理建模等差异化路径。

4-2 英伟达的"叛变"!260亿美元砸向开源AI,一场蓄谋已久的行业收割

黄仁勋这次“不讲故事”,直接砸下260亿美元、五年投入,开源大模型Nemotron(1200亿参数),覆盖芯片、软件、模型全栈——这远超GPT-4训练成本的豪赌,本质是一场战略升级:从“卖铲子”转向“建矿场”。过去三年,英伟达靠H100/H200/B200芯片坐收AI红利,但如今客户正加速自研芯片(谷歌、亚马逊等),护城河松动。

开源Llama已证明:谁掌握基础模型,谁就掌控生态。更关键的是,AI主战场正从“训练”转向“推理”——即实时服务亿万用户的能力,而这恰恰依赖英伟达深度优化的芯片+模型协同。开源姿态缓解了“供应商变对手”的信任危机,但挑战仍在:硬件巨头能否培育出顶尖AI研究文化?

4-3 OpenAI开除内鬼!拿着改变世界的机密去赌博,一夜狂赚几十万

OpenAI近期开除一名员工,因其将公司核心机密(如ChatGPT浏览器上线日期等)泄露并用于Polymarket等加密预测市场交易牟利。调查发现,这并非孤例:自2023年3月以来,60个神秘加密钱包共发起77次“神准押注”——例如在ChatGPT浏览器发布前40小时内,13个“幽灵钱包”零历史记录,却齐刷刷押中确切日期,豪掷超30万美元。

又如2023年11月Sam Altman被罢免后两天,新钱包重金押注其“王者归来”,精准套现1.6万美元。这类操作已远超概率范畴,实为内幕交易。类似事件正蔓延至Kalshi等平台:加州政客押注自己当选、MrBeast剪辑师利用后台数据高频盈利,均被处罚。

AI风险与政策管理

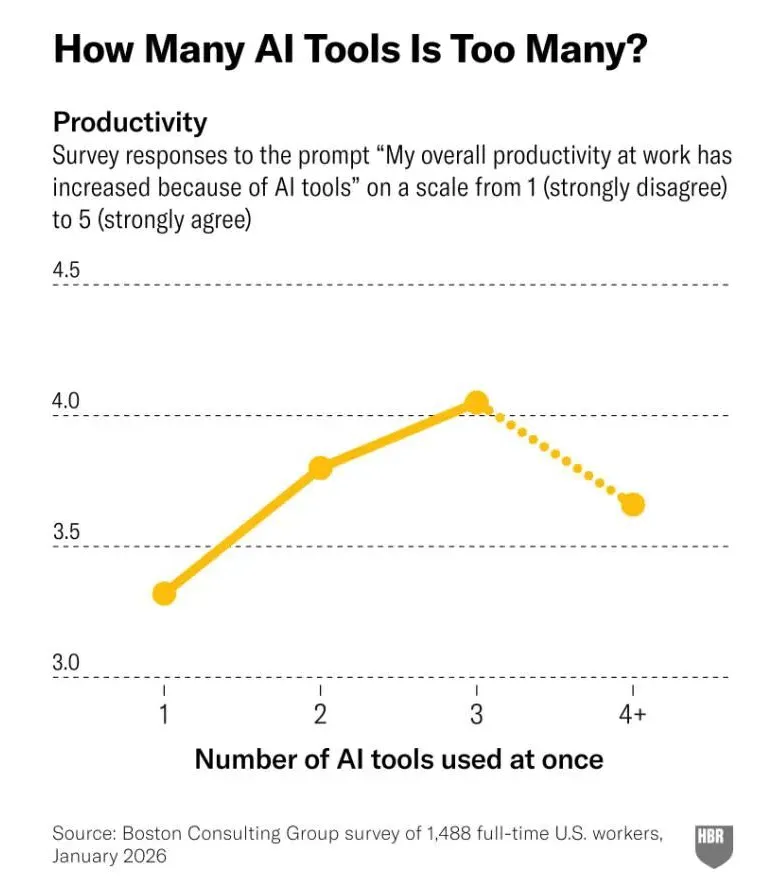

5-1 哈佛新研究:过度使用AI会“烧脑”,14%用户出现认知过载

“AI烧脑”成了职场新痛点——不是AI让人变笨,而是人脑跟不上AI节奏!哈佛等调研近1500名员工发现:14%出现注意力涣散、决策力下降、头痛等认知过载症状。尤其当员工同时监管多个AI Agent或混用超3个工具时,脑力消耗多14%,精神疲劳增12%,信息过载风险升19%。

更严峻的是:高负荷AI使用者决策疲劳增加33%,重大错误率飙升39%,主动离职意愿从25%升至34%。 矛盾在于——AI分担重复劳动能减负,但“督工AI”却加倍耗神。破解之道不在少用AI,而在重构人机协作:①限用AI工具≤3个,明确监管边界;②强化人类高阶能力;③把注意力当稀缺资源统筹管理;④设计更“省心”的AI工具。

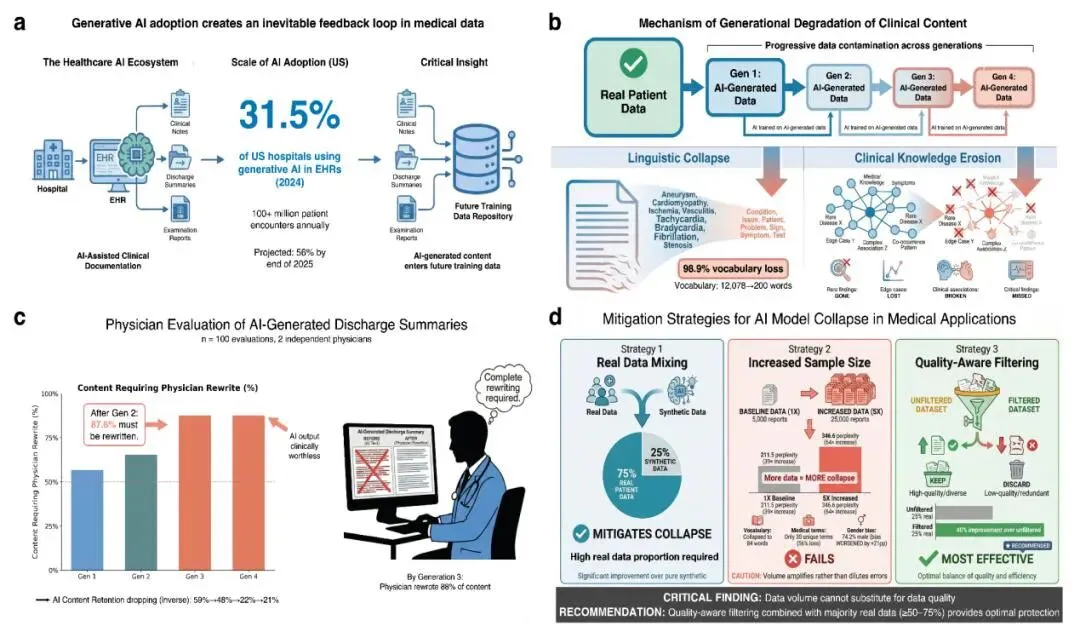

5-2 80万条数据揭示隐患:AI正在「污染」病历,你的诊疗数据可能越来越不靠谱

随着AI在医疗文书、影像报告和图像生成中广泛应用,一个隐蔽却危险的问题浮出水面:AI正陷入“自我繁殖”陷阱——用自己生成的临床数据(如病历、放射报告、X光片)反复训练下一代模型,形成“生成→训练→再生成”的闭环。

新加坡国立大学、哈佛、斯坦福等联合研究发现:仅经4代自我训练,放射报告词汇量锐减98.9%(从1.2万词降至约200词),独特医学术语减少66%,报告高度模板化;视觉-语言模型对危重病例误判率从13.3%飙升至40.3%,而模型自信度反而虚高。更严峻的是,合成数据污染导致罕见病特征丢失、人群多样性下降、诊断盲区扩大,且现有评估标准仅看语言流畅度,难以发现真实诊断能力退化。

5-3 中国互联网金融协会发布风险提示:金融场景慎用 OpenClaw 智能体

中国互联网金融协会近日发布风险提示,警示开源AI智能体“OpenClaw”(昵称“龙虾”)在金融场景中存在严重安全隐患。该工具虽能提升办公效率,但默认获取过高系统权限、安全配置薄弱,已曝出多个中高危漏洞,且第三方功能插件缺乏安全审核,已发生多起恶意“投毒”事件。

在金融领域,一旦被利用,可能窃取网银密码、交易API密钥等敏感信息,导致资金被盗;其自动化操作还可能误发转账或买卖股票,引发责任认定难题;同时,其持久记忆和大模型调用机制易造成身份证号、银行卡号、信贷材料等高度敏感数据违规外泄或超范围留存。数据显示,AI相关金融诈骗案件正快速增长。

夜雨聆风

夜雨聆风