吃了算力苦中苦,方知没算力的苦。当全球开发者都在疯狂“养虾”,你手里的锄头,够用吗?

这几天圈里像过年,不,比过年还热闹。一边是阿里平头哥GPU宣布大规模投产,朋友圈锣鼓喧天,民族芯片崛起;另一边,我的微信炸了,全是问同一件事:“兄弟,B300有现货吗?64台起收,三天内能搞到不?”

“都说忍一时风平浪静,可这算力市场,退一步就真的没货了。”

故事还得从前天的明天,也就是昨天说起。英伟达GTC2026的余温还没散,一个叫OpenClaw的智能体操作系统,把整个AI圈变成了“养虾塘”。你不养几只“AI龙虾”,出门都不好意思打招呼。

这“虾”胃口多大?重度用户一天能吃掉30万+ Token,算力消耗从“人机对话”的线性模式,直接飙到“机器自循环”的指数模式。

全球开发者瞬间患上“算力饥渴症”。而就在这个节骨眼,伊朗甩出一张清单,把谷歌、微软、英伟达这些硅谷大佬在中东的数据中心,全划进了“合法打击目标”。

数字时代的弹药库,在和平年代是科技图腾,在非常时期,就成了首轮瞄准的十字准星。

冰与火之歌:撕裂的算力大陆

美国大厂在思考如何给AI装上“机器手”(OpenClaw),让它从工具变成能感知世界的智能体。而我们的一众大厂,还在跑马圈地的基建阶段。

“西大追求‘不能错’的精英技术,东大信奉‘容错’的创新饱和。”

安全意识是另一道分水岭。当“发展才是硬道理”遇上复杂的地缘政治,自主可控不再是选择题,而是生存题。阿里平头哥的投产,华为昇腾的引领,寒武纪、壁仞的追赶,是一场关乎国运的“算力长征”。

但现实很骨感。2026年开春,最火的是“养虾”,最缺的是“喂虾的粮”——算力。

H200,B300都要靠抢。朋友圈里,采购老哥们急得像热锅上的蚂蚁:“超微、戴尔、华硕、技嘉…只要是B300现货,统统收!”

交付节点到了,可货从哪来?上午的讯息,下午库存就标红。市场,已经癫狂。

开荒需要时间,而时代只争朝夕。对于无数AI实验室、冲刺上市的创业公司、押注大模型的巨头而言,等待国产链条完全成熟的风险,他们赌不起。

于是,一个撕裂的“缝隙市场”悄然形成:黑色幽灵”——Blackwell架构的B300。

为什么是B300?因为它站在了当下人类算力的巅峰,是攻克千亿参数模型、驾驭超长上下文、喂养“AI龙虾”的最强武器。而它,恰好被摆在了货架最顶端,对中国标着“非卖品”。

这种“得不到的永远在骚动”,让每一片漂洋过海而来的B300,都成了硬通货。

硬核拆箱:这头“性能怪兽”凭什么让人疯狂?

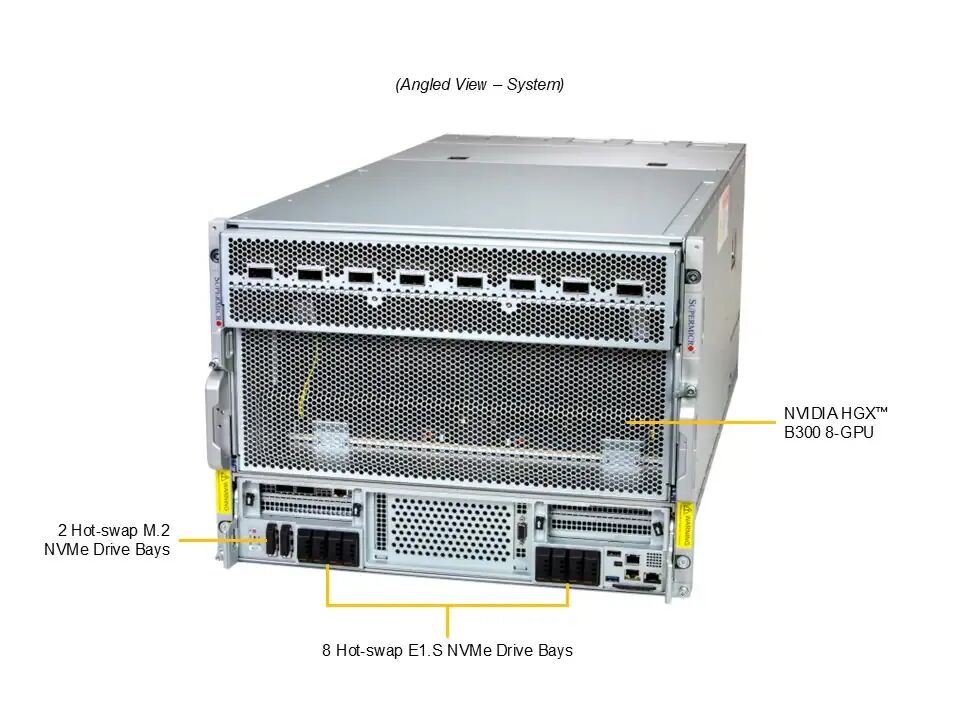

好了,不卖关子。今天,就带大家拆箱一台能让你在算力荒年里“挺直腰杆”的硬货——SYS-822GS-NB3RT(B300 原装整机)。

先上硬核配置表,参数党请接好:

| 准系统 | |||

| GPU板卡 | |||

| CPU | |||

| 内存 | |||

| 系统盘 | |||

| 数据盘 | |||

| 网络/DPU | |||

| 其他服务 |

看不懂?没事,我用人话给你提炼三个让你晚上睡不着觉的亮点:

第一,288GB 显存,巨无霸中的巨无霸。单卡288GB HBM3e显存,8卡就是2.3TB!这意味什么?意味着你跑超大规模模型时,能把更多参数“塞”进显存,减少在慢吞吞的系统内存和硬盘之间来回折腾的次数。好比拉货,别人用小皮卡一趟趟运,你直接开上重型卡车,一次拉完。训练效率?呈指数级提升。

第二,Blackwell Ultra 架构,算力怪兽觉醒。别被FP4、FP8这些术语吓到。你只需要知道,在支持的低精度计算下,它的FP4算力最高能达到18 PFLOPS。相比之前的卡皇,推理性能直接飙出4.5倍。喂“AI龙虾”时,别人家的虾苗按条算,你家的按亩算。

第三,第五代NVLink + DPU,构建“高速公路网”。单卡之间互联带宽高达1.8TB/s,8卡如同一个整体。再加上BlueField-3 DPU智能网卡,把网络、存储、安全这些杂活全包了,让GPU专心“炼丹”。这条数据高速公路,让千亿参数模型在集群间狂奔时,不再有“堵车”的烦恼。

“吃得苦中苦,方知有B300不用苦。”

趋势很清晰:AI正在从“能用”走向“好用”,从“玩具”变成“工具”。这个历史性拐点上,算力密度和能效比就是王道。B300凭借翻倍的显存、怪兽级的算力和革命性的互联,在训练超大规模MoE模型和进行超长上下文推理时,其总体拥有成本(TCO)实际上更低。

生态层面更不用担心,NVIDIA的CUDA帝国依然稳固,社区对Blackwell架构的优化正快马加鞭。

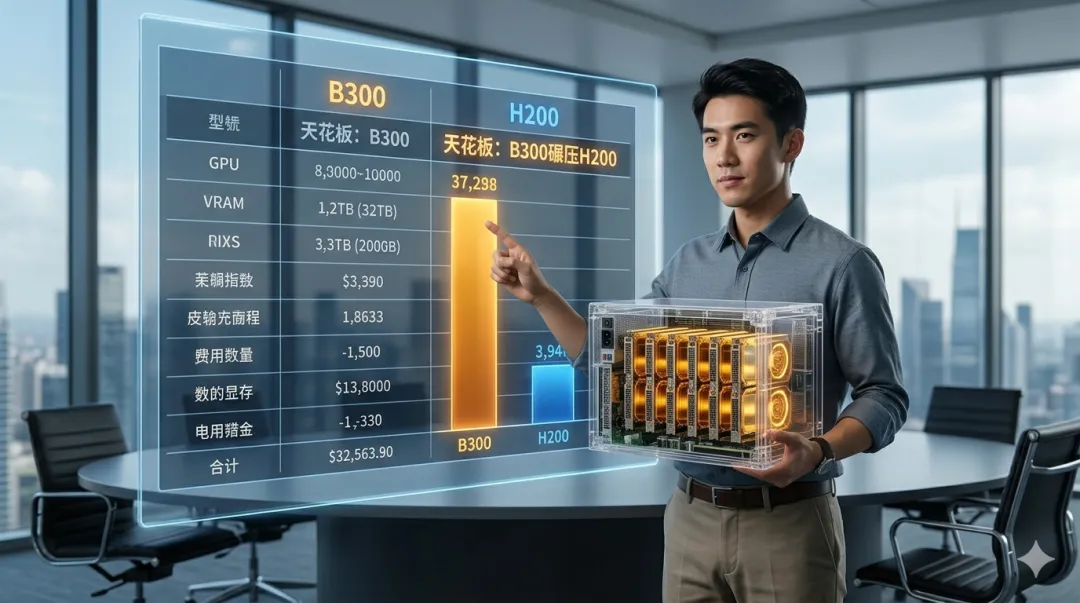

技术规格对比:一目了然的“碾压局”

光说不练假把式,一张表看清B300在食物链的位置:

| B300 (Blackwell Ultra) | ||||

| 架构 | Blackwell Ultra | |||

| 8卡总显存 | 2.3 TB | |||

| 单卡内存带宽 | 8.0 TB/s | |||

| 单卡NVLink带宽 | 1.8 TB/s | |||

| 最大TDP | ||||

| FP16 算力 | 4.5 PFLOPS | |||

| FP8 算力 | 9 PFLOPS | |||

| FP4 算力 | 最高18 PFLOPS |

结论扎心却真实: 对于追求极致、志在千亿模型乃至AGI的团队,B300是当前唯一的选择。H200是优秀的“实力派”,但B300是开启下一个时代的“钥匙”。

你的场景,它的战场

手握这样的“核弹”,你能干什么?

1. 喂养“AI龙虾”,制霸智能体时代:OpenClaw智能体日均狂吞30万Token?来,用B300集群搭个本地化平台,连接你的千问大模型。让“龙虾”们在你私有的、安全的算力池里疯狂进化,成本可控,数据无忧。 2. 千亿参数“炼丹”,提速上市进程:还在为训练一个模型等上数月?B300的巨量显存和超高带宽,能将训练时间大幅压缩。时间就是估值,效率就是生命线。 3. 筑牢“数字弹药库”,掌握战略主动权:无论是分析卫星影像,还是处理无人机数据,强大的本地算力集群就是新时代的“国防工事”。B300这样的顶级算力,是和平时期的研发引擎,也是非常时期的定海神针。

行动指南:如何搞到这片“硬通货”?

我知道你在想什么:“说这么好,哪儿买?” 问对了,这才是最现实的环节。目前市场如同烈火烹油,但并非无路可走。

“让我们一起等,等到春暖花开——但前提是,你得先占个坑位。”

基于目前的行情,提供几条“上岸”路径:

• 方案一:持币待现(闪电战)从某些大单的期货中,偶尔能分割出极少量现货。操作窗口期以小时计,拼的是信息差和决策速度。适合急需解燃眉之急的客户。 • 方案二:准现货(短跑冲刺)锁定已经发货在途的货物,签订正式合同,通常一周左右交付。这是平衡速度与确定性的优选。 • 方案三:远期期货(战略布局)签订合同并完成验资,货期约6-8周。这是成本最优、最适合大规模批量采购的方案,用时间换空间和价格。

【天若有情天亦老,人有算力日子好。】

刷到的父老乡亲、兄弟姐妹们,AI的巨轮已驶入深水区。这场竞赛,不再是简单的技术比拼,而是系统工程能力、战略定力和资源储备的全面较量。

脚下有路,是国产自研的筚路蓝缕;远方有光,是全球智能的星辰大海。而举步之时,你需要最锋利的工具。

算力如粮,早囤早心安。

📢 互动与行动时间:

1. 免费领资料:关注 【鑫思沃】 公众号,后台私信“参数”,免费获取我整理的 【英伟达全系高端GPU核心参数速查表(2026最新版)】,帮你一眼看透所有算力芯片的底牌。 2. 百份干货等你:在公众号后台点击菜单栏“GPT&DS”,百余份关于大模型开发、部署、优化的实战资料包,直接拿走。 3. 立即咨询/下单:对B300整机或其它AI服务器(H200,国产方案等)有需求?立刻扫码添加我们资深顾问微信:lieversong 或 AI-xsw2024。

备注“B300咨询”,获取最新报价、现货情况及专属方案。

最后: 你觉得,在国产芯片狂飙突进与顶尖算力一卡难求的撕裂中,企业的最优解到底是什么?评论区聊聊,每一条我都会看。

免责申明:文章信息来源于产品方官网/网点/客户经理或第三方公开信息平台,最终数据以产品方发布为准,本文中价格及数据和图片仅作参考,最终以实际发生为准。本公众号只做信息整合免费分享,如涉及侵权等问题,请与我们公众号联系删除,非常感谢!

夜雨聆风

夜雨聆风