能不能不依赖云端 API,在本地运行一个真正可用的 AI 助手?

答案是:可以。

通过 OpenClaw + Ollama + GPT-OSS:20B 的组合,你可以在本地构建一个完整的 AI Agent 系统:

不依赖 OpenAI API

不需要 Token 费用

支持接入 Telegram / Discord / 微信等聊天平台

可以执行代码、自动化任务、调用工具

这套架构目前被很多开发者称为:

“最接近 Jarvis 的开源方案”

本文将从 原理、架构、安装部署、配置接入、实际使用 五个方面详细讲解。

一、什么是 OpenClaw?

OpenClaw 是一个本地 AI Agent 框架,可以把 AI 接入各种聊天工具,让 AI 帮你执行任务。

简单理解:

OpenClaw ≈ AI 大脑 + 自动化执行系统

它的核心能力包括:

AI 对话

自动执行脚本

调用工具

访问本地文件

远程控制系统

与聊天平台集成

例如:

你可以在FeiShu里给 AI 发一句话:

帮我整理今天的邮件

OpenClaw 可以:

打开邮箱

分类邮件

总结内容

输出报告

整个过程无需人工操作。

二、为什么要用 Ollama?

OpenClaw 只是 Agent 框架,它需要一个 LLM 模型作为大脑。

常见选择:

| Ollama 本地模型 |

Ollama 是目前最流行的本地大模型运行环境,可以在本机运行各种开源模型。

例如:

llama3qwen2.5deepseekmistralgpt-oss

特点:

一行命令运行模型

支持 GPU / CPU

本地 API 调用

完全离线

OpenClaw 可以直接调用 Ollama API。

三、为什么选择 GPT-OSS:20B?

GPT-OSS 是 OpenAI 发布的开源权重模型,在 Ollama 中可以直接运行。

模型特点:

能力:

推理能力强

支持 Agent 工具调用

可调 reasoning 强度

支持结构化输出

因此它非常适合:

AI Agent

自动化任务

编程助手

本地 AI 助手

四、整体架构

OpenClaw + Ollama 的工作结构如下:

用户 │聊天平台(Telegram/飞书) │OpenClaw Gateway │Agent 调度 │Ollama API │GPT-OSS:20B │返回结果

流程:

1 用户发送消息2 OpenClaw 接收3 Agent 分析任务4 调用 Ollama 模型5 模型生成结果6 执行工具7 返回结果

整个过程:

全部在本地运行

五、硬件配置建议

运行 GPT-OSS:20B 需要一定硬件。

最低配置:

推荐配置:

如果没有 GPU:

也可以 CPU 跑,但速度较慢。

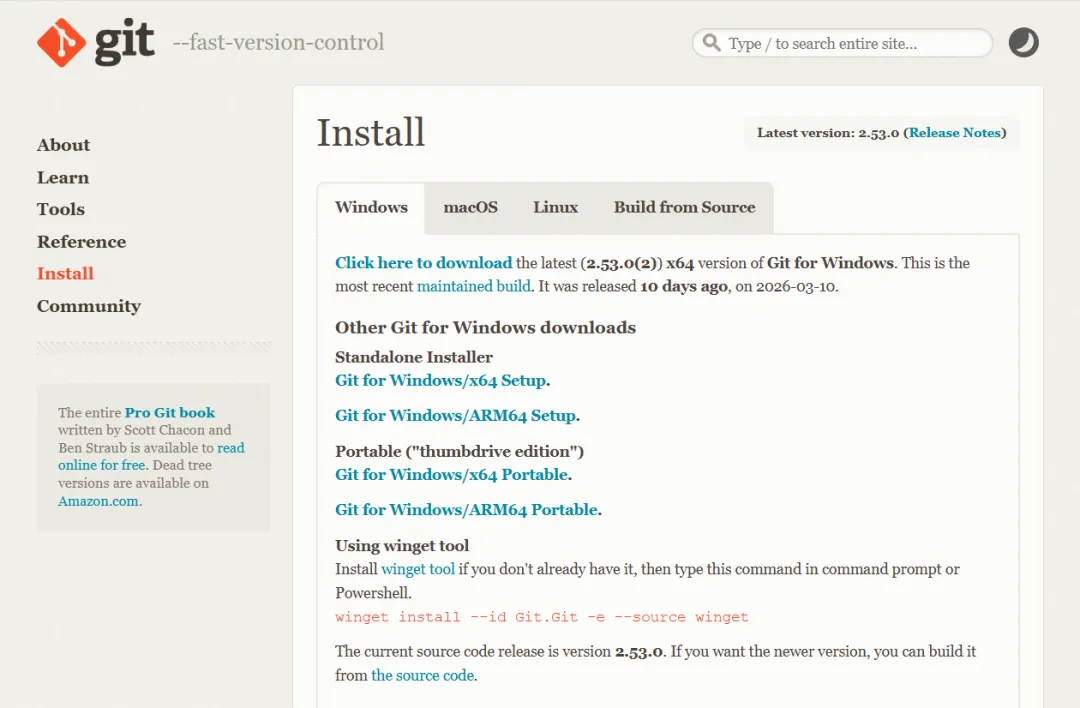

六、下载并安装 Git

🔗 https://git-scm.com/install/windows

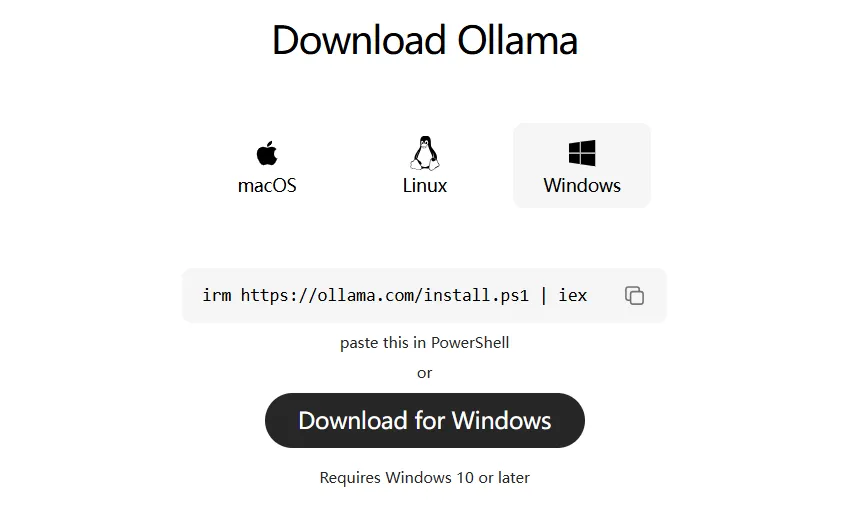

curl -fsSL https://ollama.com/install.sh | shWindows:

下载官方安装包

irm https://ollama.com/install.ps1 | iex安装完成后验证:

ollama -v

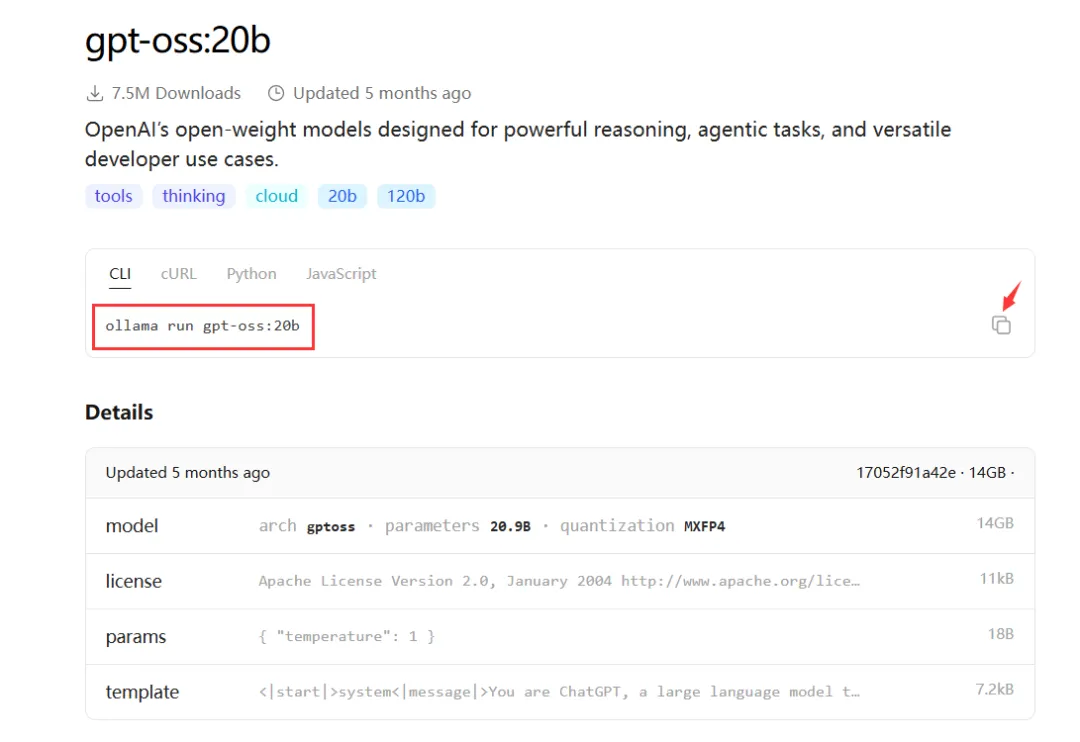

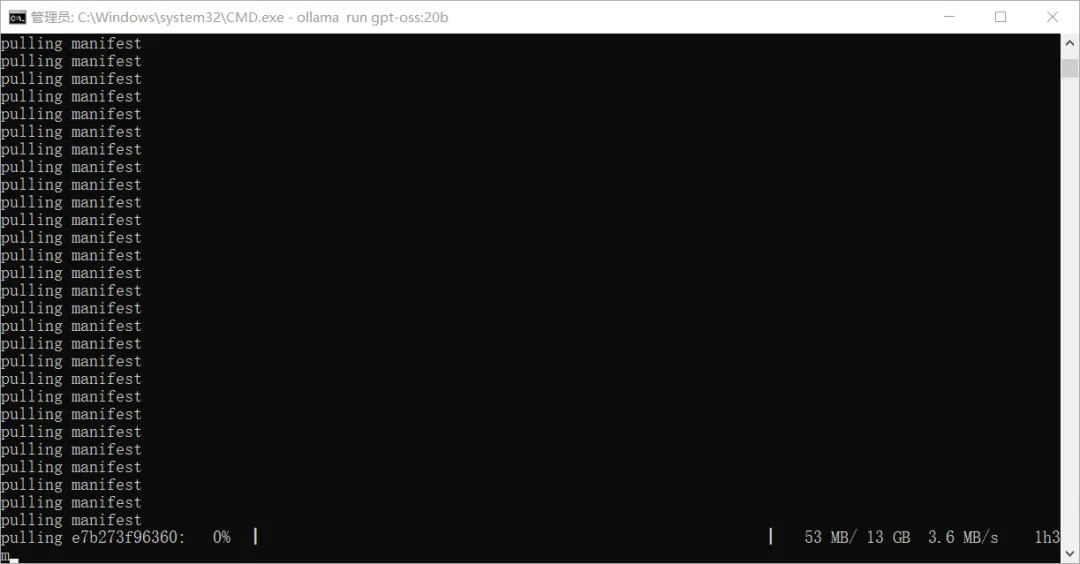

八、下载 GPT-OSS:20B 模型

执行:

ollama pull gpt-oss:20b

或者直接运行:

ollama run gpt-oss:20b

模型大小:

约 14GB。

下载完成后:

ollama list

可以看到模型。

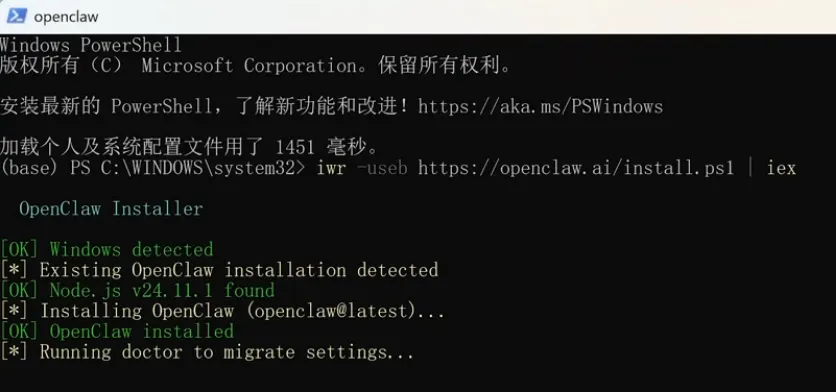

九、安装 OpenClaw

Linux / Mac:

curl -fsSL https://openclaw.ai/install.sh | bash

Windows:

iwr -useb https://openclaw.ai/install.ps1 | iex

安装完成后执行:

openclaw

十、连接 Ollama

OpenClaw 默认支持 Ollama。

只需要设置环境变量:

export OLLAMA_API_KEY="ollama-local"

虽然 Ollama 不需要 API Key,但 OpenClaw 需要这个变量来识别服务。

然后查看模型:

openclaw models list

十一、配置 OpenClaw 使用 GPT-OSS

修改配置文件:

~/.openclaw/config.json

示例配置:

{"models": {"providers": {"ollama": {"baseUrl": "http://localhost:11434","apiKey": "ollama-local","api": "ollama","models": [{"id": "gpt-oss:20b"}]}}},"agents": {"defaults": {"model": {"primary": "ollama/gpt-oss:20b"}}}}

重点:

primary: "ollama/gpt-oss:20b"

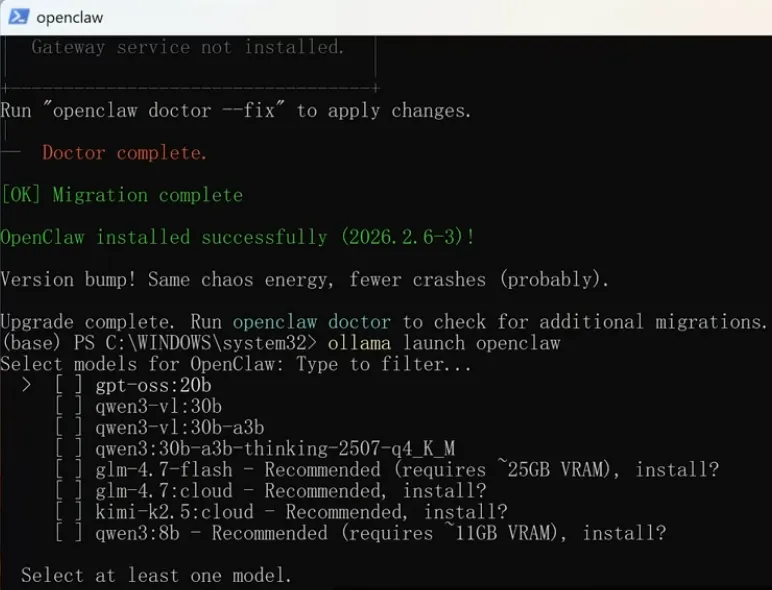

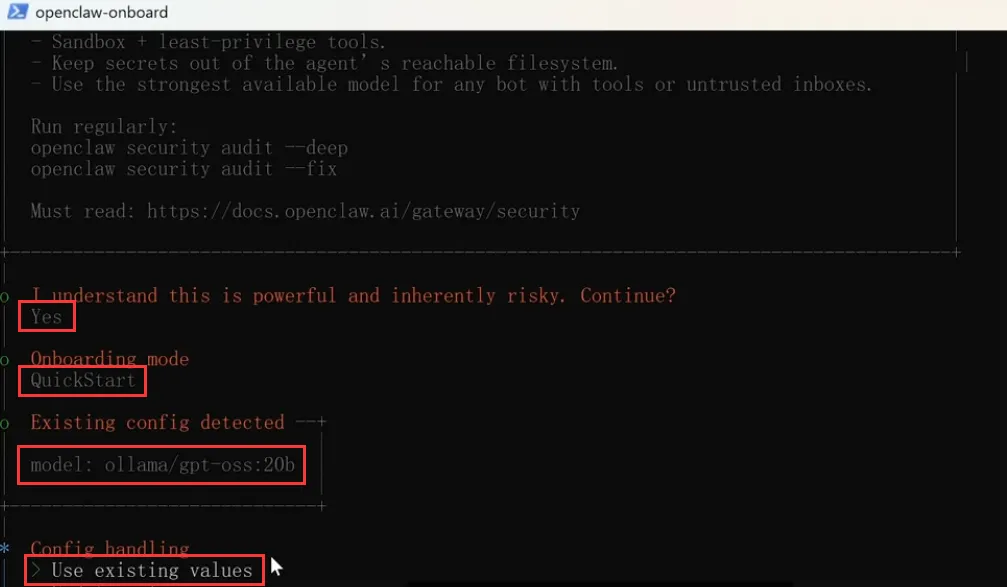

十二、启动 OpenClaw

执行:

openclaw onboard或者:

ollama launch openclawOllama 会自动:

检测 OpenClaw

启动 Gateway

连接模型

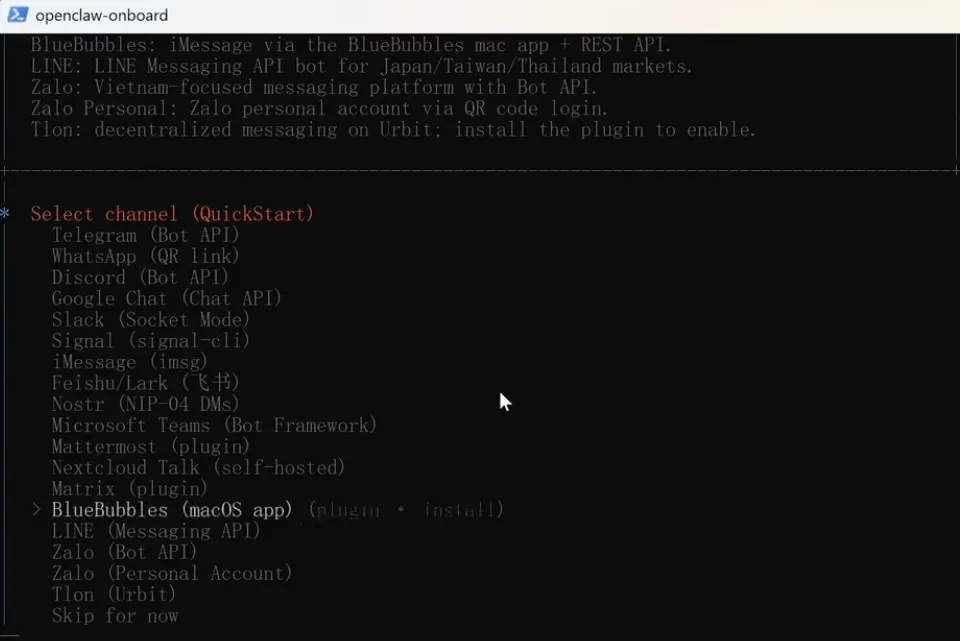

用键盘上下键和Tab键选择确认需要的模型如选择gpt-oss-20b模型确认后,是否选择对接第三方客户端国内便于使用对接飞书客户端如果不对接可以选最后一项跳过

十三、测试 AI Agent

启动后可以直接聊天:

openclaw chat

测试:

帮我写一个Python脚本

GPT-OSS 会返回代码。

如果启用工具能力:

OpenClaw 可以:

执行 Shell

写文件

调用 API

自动化任务

十四、接入聊天平台

流程:

1 创建 Bot2 获取 Token3 填写 OpenClaw config

十五、安全问题必须注意

OpenClaw 的能力非常强:

它可以:

执行 shell

修改文件

调用 API

安全专家警告:

错误配置可能导致系统被控制。

建议:

1 不要开放公网2 限制 shell 权限3 不要随便安装社区工具4 使用 sandbox

十六、为什么这套方案火爆

原因只有三个:

1 完全免费

不需要:

OpenAI API

Claude API

Token费用

2 完全本地

数据不会上传云端。

适合:

隐私场景

企业内部部署

3 真正的 AI Agent

不是聊天机器人,而是:

自动执行任务的 AI

十七、未来的发展

OpenClaw 正在快速发展:

未来可能支持:

自动学习

Agent 协作

多模型协同

自动化工作流

随着本地模型性能提升:

未来可能实现:

真正的本地 AI 助手生态。

总结

OpenClaw + Ollama + GPT-OSS:20B 组合可以实现:

本地 AI Agent

免费 AI

自动化任务

多平台聊天接入

架构关系:

OpenClaw = AgentOllama = 模型运行环境GPT-OSS = 大模型

三者结合,就能构建一个:

完全本地的 AI 助手系统。

夜雨聆风

夜雨聆风