OpenClaw 本地部署 Qwen3-8B 保姆级教程,不烧Token,一次安装,完全永久免费

全程免费、全本地、无 API 费、无服务器费、隐私全在你电脑,按步骤复制粘贴即可,新手也能搞定。

一、部署前准备(先看,避免踩坑)

1. 电脑最低要求(满足就能跑)

系统:Windows 10/11(64 位)、macOS 10.15+

内存:≥8GB(推荐 16GB+,模型更流畅)

硬盘:预留15GB+空间(Ollama + 模型 + OpenClaw)

网络:仅安装时需要,部署后可完全离线使用

2. 核心工具(全免费)

Ollama

本地运行大模型的免费工具(零 API 费)

OpenClaw

MIT 开源,免费部署、使用、商用

二、Windows 系统详细步骤(新手优先)

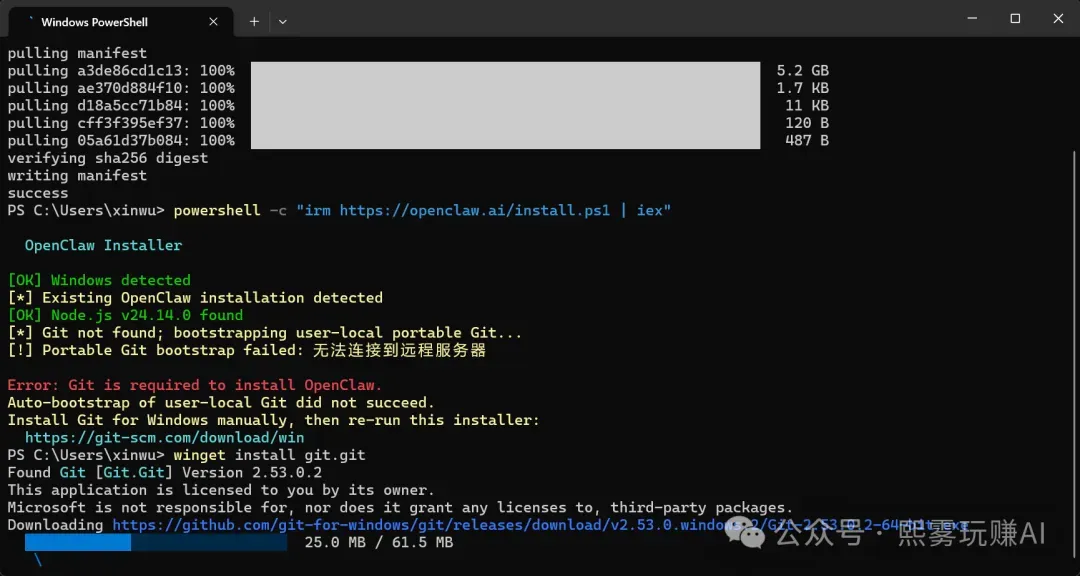

安装git,输入指令:winget install git.git,等待安装完成

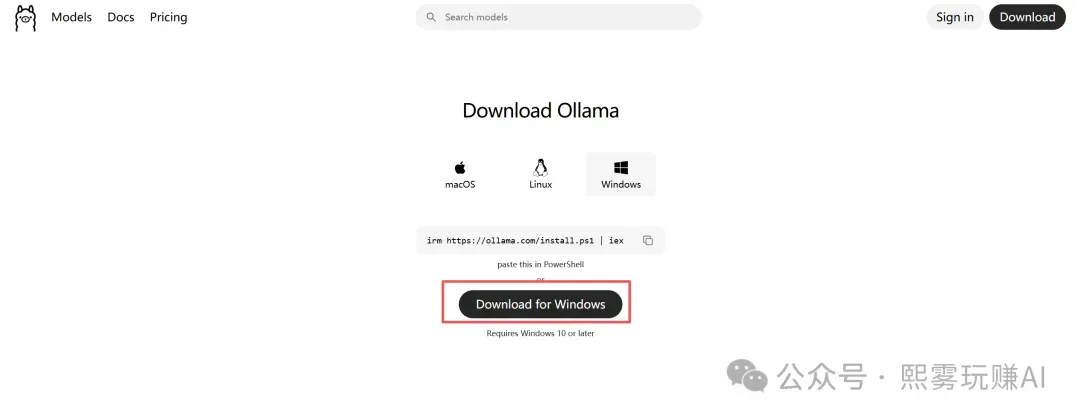

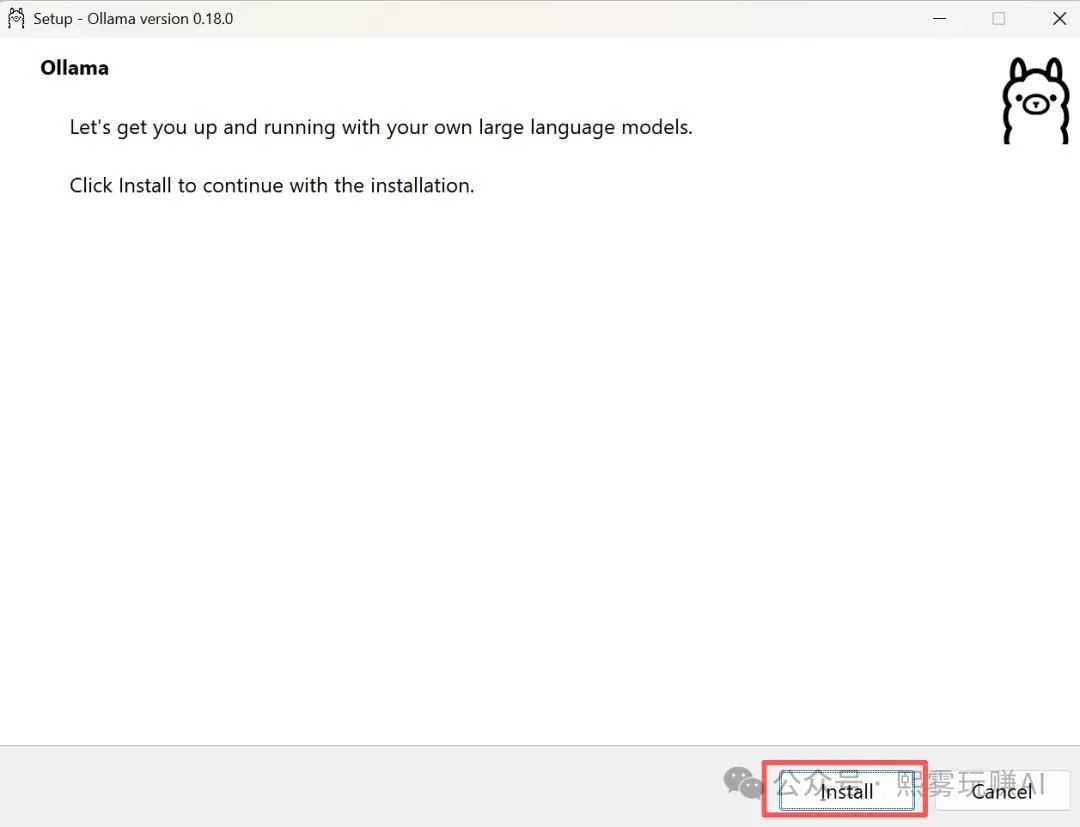

步骤 1:安装 Ollama(本地模型运行器,5 分钟)

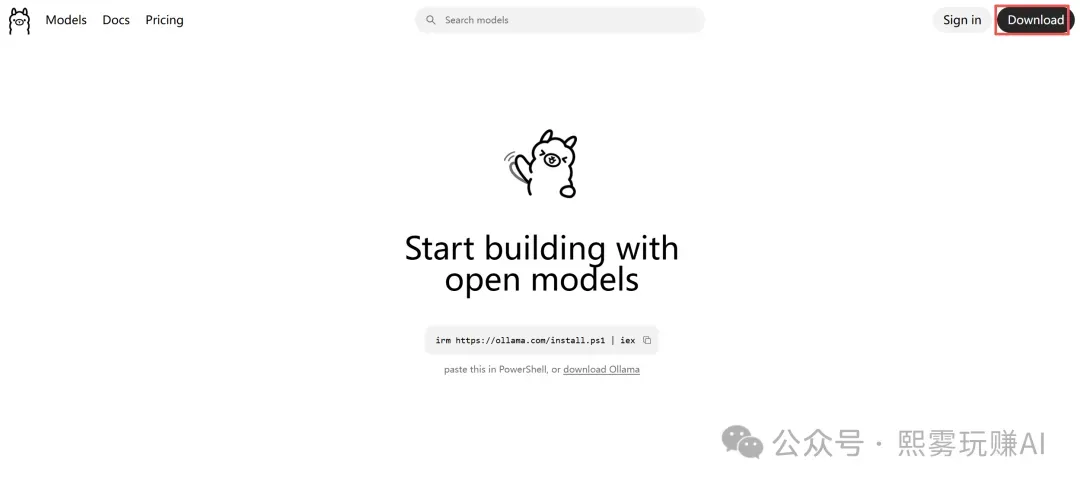

打开浏览器,访问:https://ollama.com/

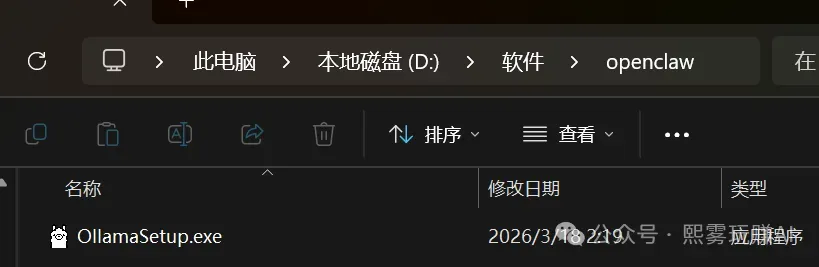

点击Download for Windows,下载安装包

双击安装包

一路下一步,默认安装即可

验证安装:

以管理员身份打开 PowerShell,输入:ollama --version

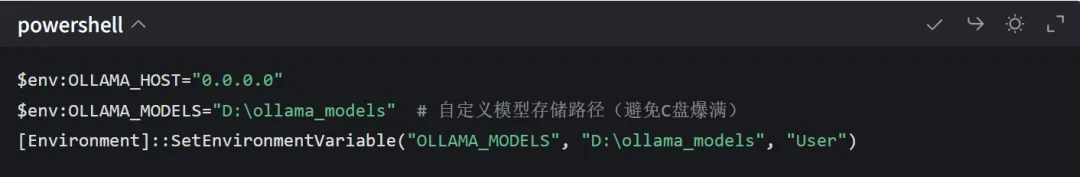

(可选)设置国内镜像(加速下载)

$env:OLLAMA_HOST="0.0.0.0"$env:OLLAMA_MODELS="D:\ollama_models" # 自定义模型存储路径(避免C盘爆满)[Environment]::SetEnvironmentVariable("OLLAMA_MODELS", "D:\ollama_models", "User")

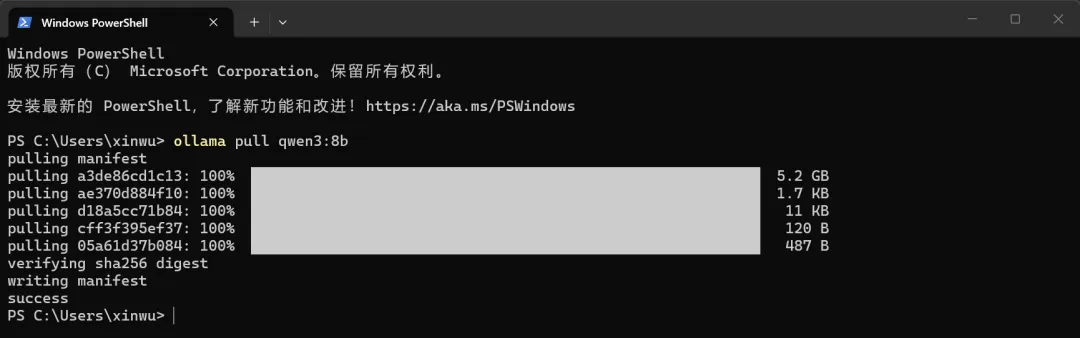

三、第二步:拉取 Qwen3-8B 模型(核心步骤)

Ollama 一键拉取,无需手动下载权重文件。

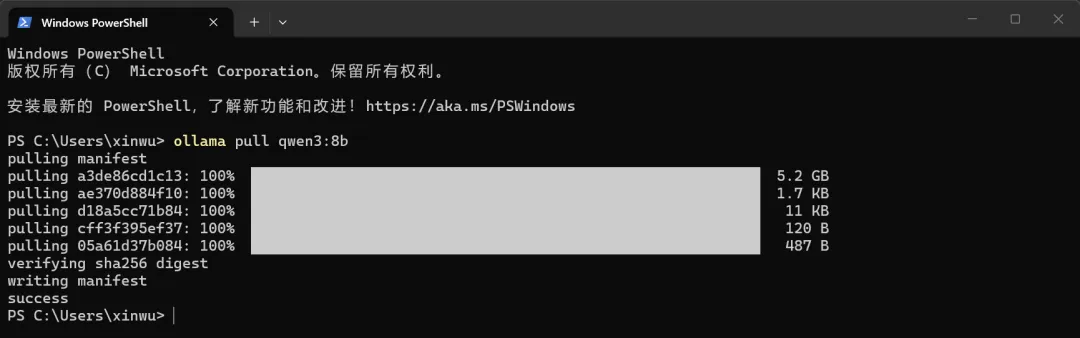

管理员 PowerShell 执行:

复制以下命令,粘贴后回车(下载轻量中文模型,8GB 内存可跑):

# 拉取Qwen3-8B(推荐量化版,显存占用更低)ollama pull qwen3:8b# 显存≤8GB,拉取4-bit量化版(速度更快,显存仅需约6GB)# ollama pull qwen3:8b-q4_K_M

等待下载(约 10-30 分钟,取决于网速),出现「Success」即完成。 验证模型

ollama list

四、第三步:安装 OpenClaw(AI 交互面板)

OpenClaw 提供可视化界面,对接本地 Ollama 模型,实现聊天、工具调用等功能。

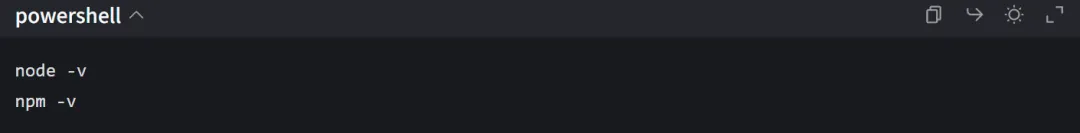

安装 Node.js(OpenClaw 依赖)官网:https://nodejs.org/ → 下载 LTS 版(如 22.x),双击安装(勾选「Add to PATH」)。 验证 Node.js

node -vnpm -v

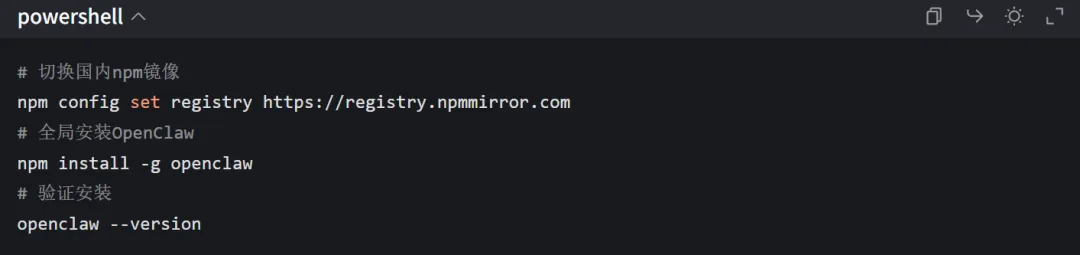

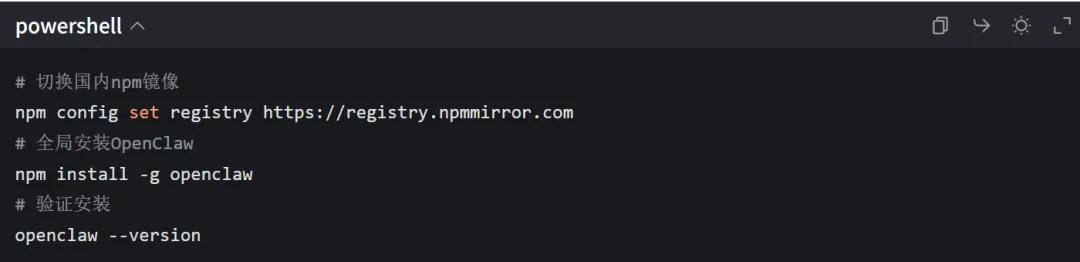

安装 OpenClaw(国内镜像加速)

# 切换国内npm镜像npm config set registry https://registry.npmmirror.com# 全局安装OpenClawnpm install -g openclaw# 验证安装openclaw --version

验证安装:输入openclaw --version,出现版本号即成功

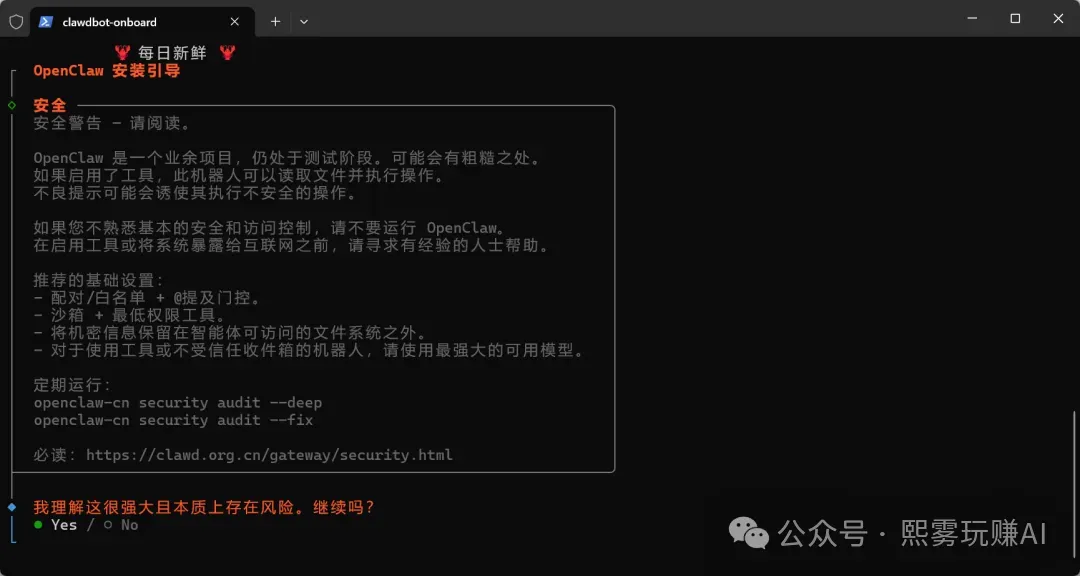

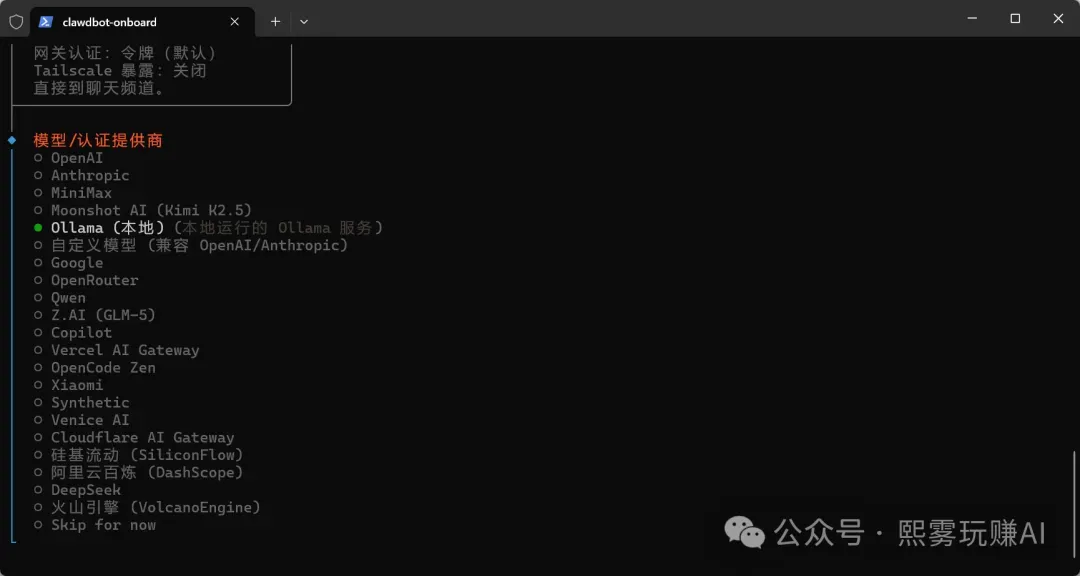

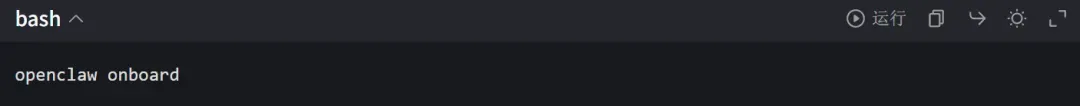

步骤 4:配置 OpenClaw 对接本地 Ollama(核心,3 分钟)

在管理员 PowerShell 中,运行配置向导:

openclaw onboard

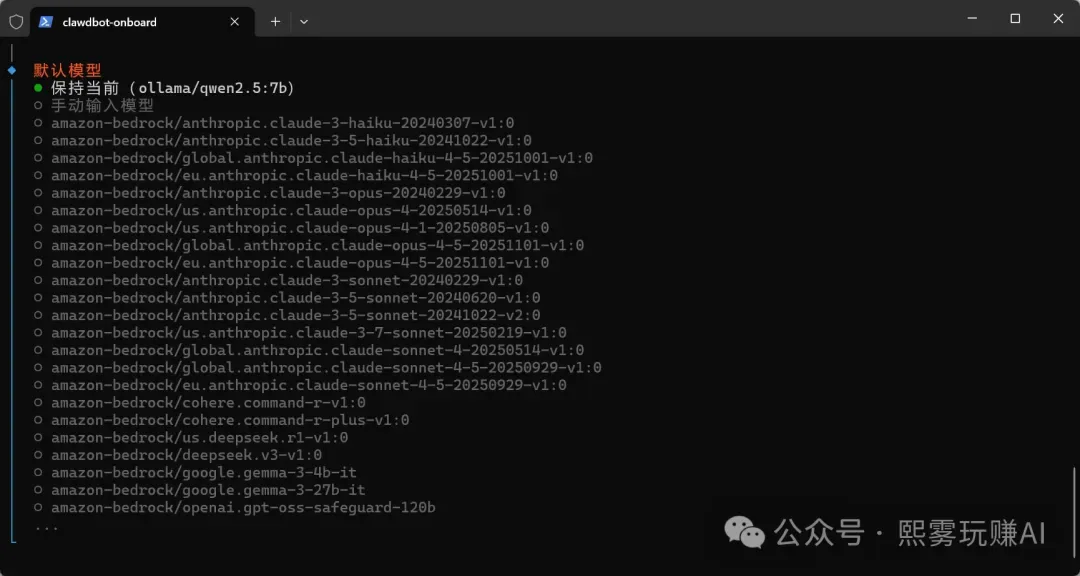

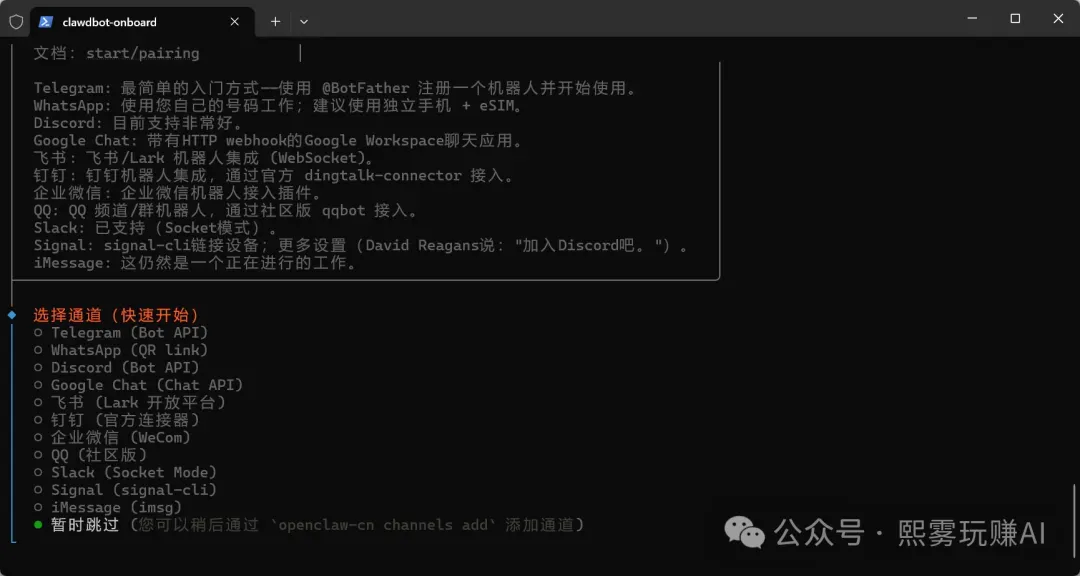

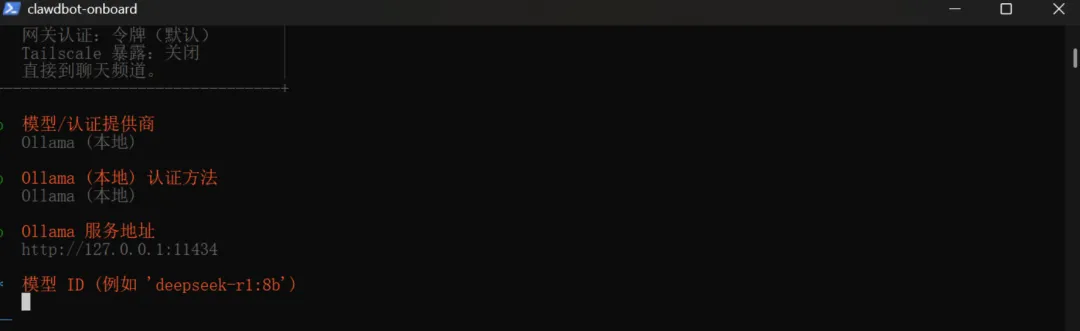

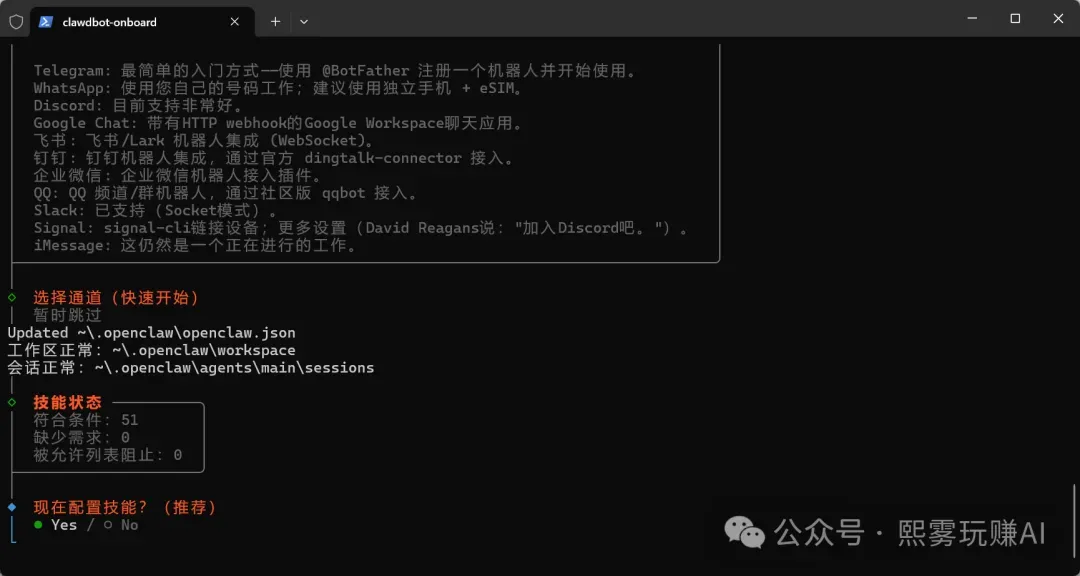

按提示选择(严格按以下操作):

表格

QuickStart(快速开始) | |

Custom Provider(列表最后一项) | |

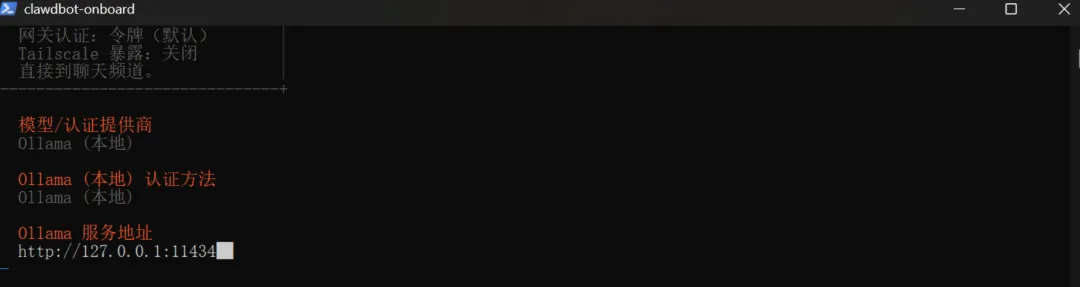

http://127.0.0.1:11434/ | |

ollama-local(任意字符,不可空) | |

OpenAI-compatible | |

qwen3:8b(你拉取的模型名) | |

Skip for now(跳过) |

对接本地 Ollama 模型,实现完全免费部署

回车键

这里直接按回车确认即可!

这个地址 http://127.0.0.1:11434 是 Ollama 本地服务的默认地址,完全正确,不需要修改

选第一个就行

回车键

这一步是选择聊天通道,你现在只需要本地免费使用 OpenClaw 的网页版,不需要对接任何外部聊天平台,所以直接选择暂时跳过✅。

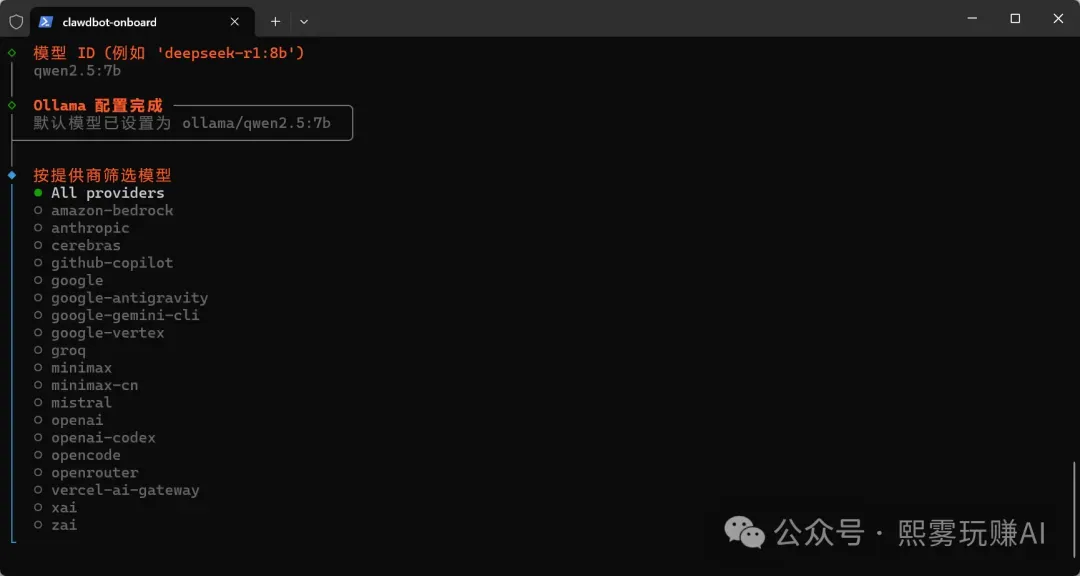

模型ID:qwen3:8b

回车No,跳过,以后需要可以在配置技能

若出现下面这个页面,直接跳过

选中第1个后,先回车,在按空格确认选中,最后在按一次回车提交配置

步骤 5:启动 OpenClaw 并访问(1 分钟)

配置完成后

向导结束后,启动服务,先查看可用命令,在终端输入:

openclaw --help

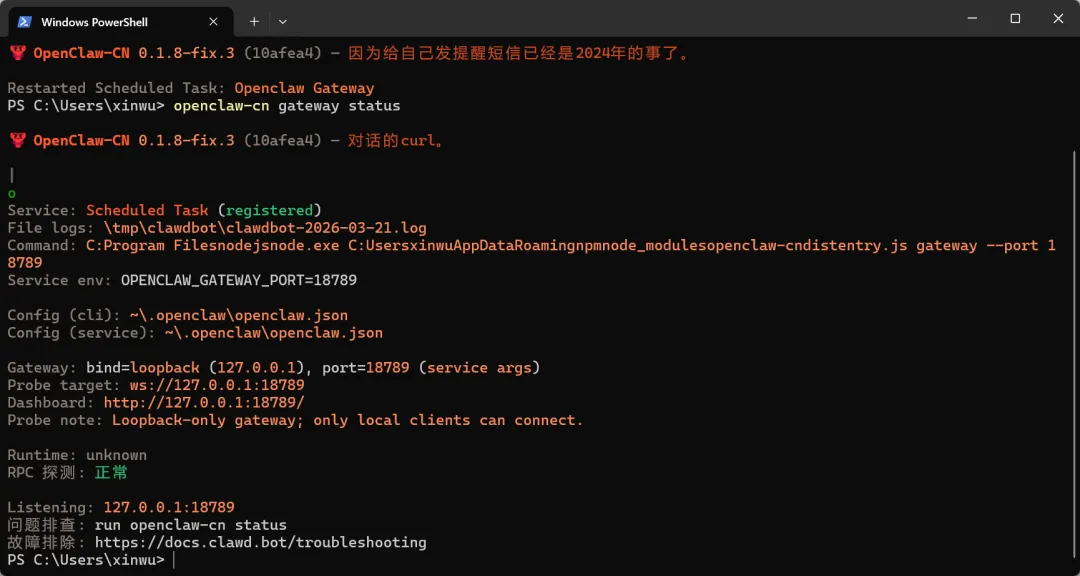

使用正确的启动命令

openclaw-cn gateway start

如果需要指定端口(默认 18789):

openclaw-cn gateway status

浏览器会自动打开http://127.0.0.1:18789,打开后就能免费聊天了。(仅本地使用,无云端)

或手动打开浏览器,访问:http://127.0.0.1:18789

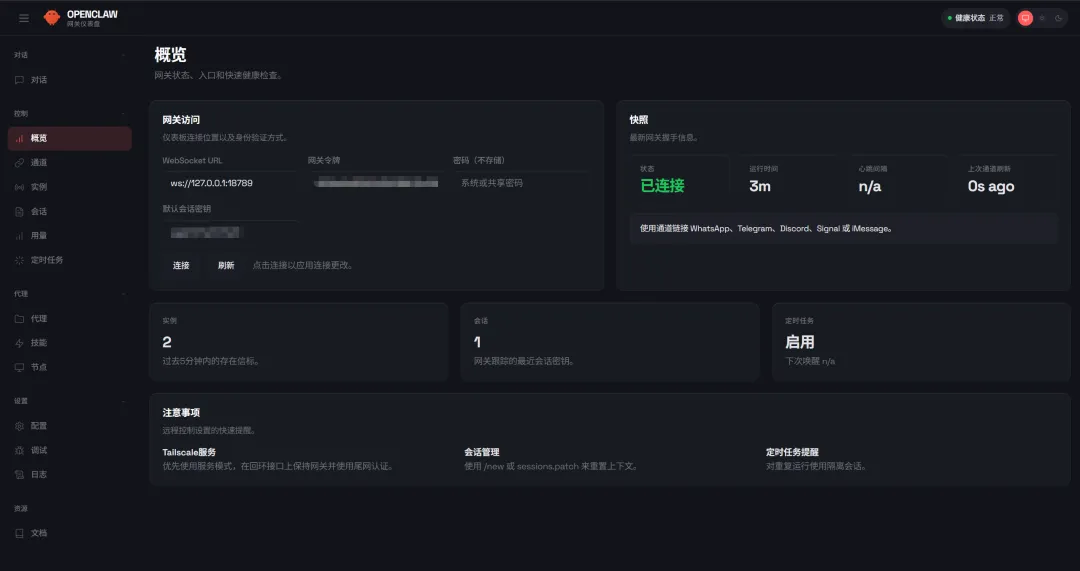

进入OpenClaw 概览,界面右上角显示「健康状态 正常」,说明服务已经正常运行,不需要额外注册本地账号,可以直接开始使用。

可聊天、使用工具,全程免费、全本地

📌 聊天入口位置

直接对话

🎯 下一步操作

在对话底部输入框输入问题,比如:

在我的桌面上创建一个名为“测试.xlsx”的文件,内容写上“图片,名称,链接,描述

然后点击「发送」,等待处理完成,就能看到本地模型的回复了

桌面自动创建了一个表格文件,测试成功,全部免费

想获取更多openclaw安装部署和应用与变现教程,👇点击文章底部阅读原文获取

或复制下面链接直达

https://mbd.baidu.com/ma/s/azPSY6Mz

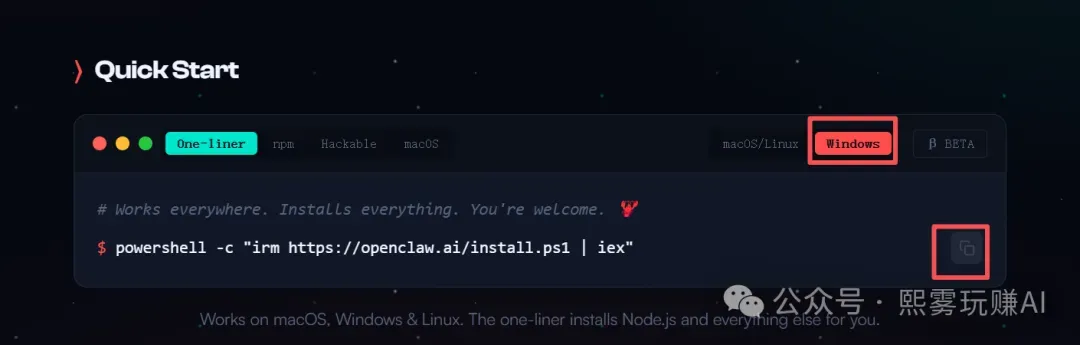

也可以在官网下载:https://openclaw.ai/

选择你的系统,复制到Windows PowerShell安装

三、macOS 系统详细步骤(和 Windows 逻辑一致)

步骤 1:安装 Ollama

访问 https://ollama.com/,下载 macOS 安装包

打开安装包,将Ollama拖入「应用程序」

打开终端(Launchpad → 其他 → 终端)

验证:ollama --version,出现版本号即成功

步骤 2:拉取免费模型

终端输入:

ollama pull qwen3.8b

# 拉取Qwen3-8B(推荐量化版,显存占用更低)ollama pull qwen3:8b# 显存≤8GB,拉取4-bit量化版(速度更快,显存仅需约6GB)# ollama pull qwen3:8b-q4_K_M

等待完成,验证:ollama list

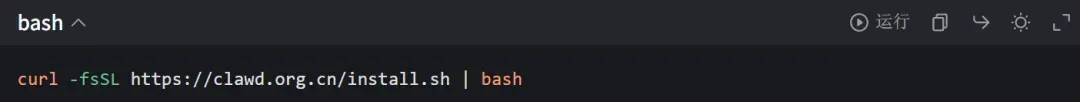

步骤 3:安装 OpenClaw

打开终端,复制国内镜像命令,粘贴回车:

curl -fsSL https://clawd.org.cn/install.sh | bash

输入电脑开机密码(sudo 权限),等待安装

验证:openclaw --version

步骤 4:配置对接 Ollama

终端运行:

openclaw onboard

按 Windows 步骤 4 的表格选择,参数完全一致

步骤 5:启动并访问

启动:openclaw start

浏览器访问:http://127.0.0.1:18789,注册本地账号使用

四、常见问题(必看,解决 90% 报错)

Windows 脚本执行报错

Ollama 下载模型慢

OpenClaw 连不上 Ollama

模型运行慢 / 卡顿

五、一句话总结

用自己电脑部署 OpenClaw + Ollama = 100% 免费、全离线、隐私可控、永久使用,按以上步骤操作,30 分钟内搞定。

【AI教程】资料领取方式在文章底部👇

找到文章底部的“阅读原文”,解锁隐藏模板👇

关注不迷路,3秒星标,不错过每一期福利 |  |

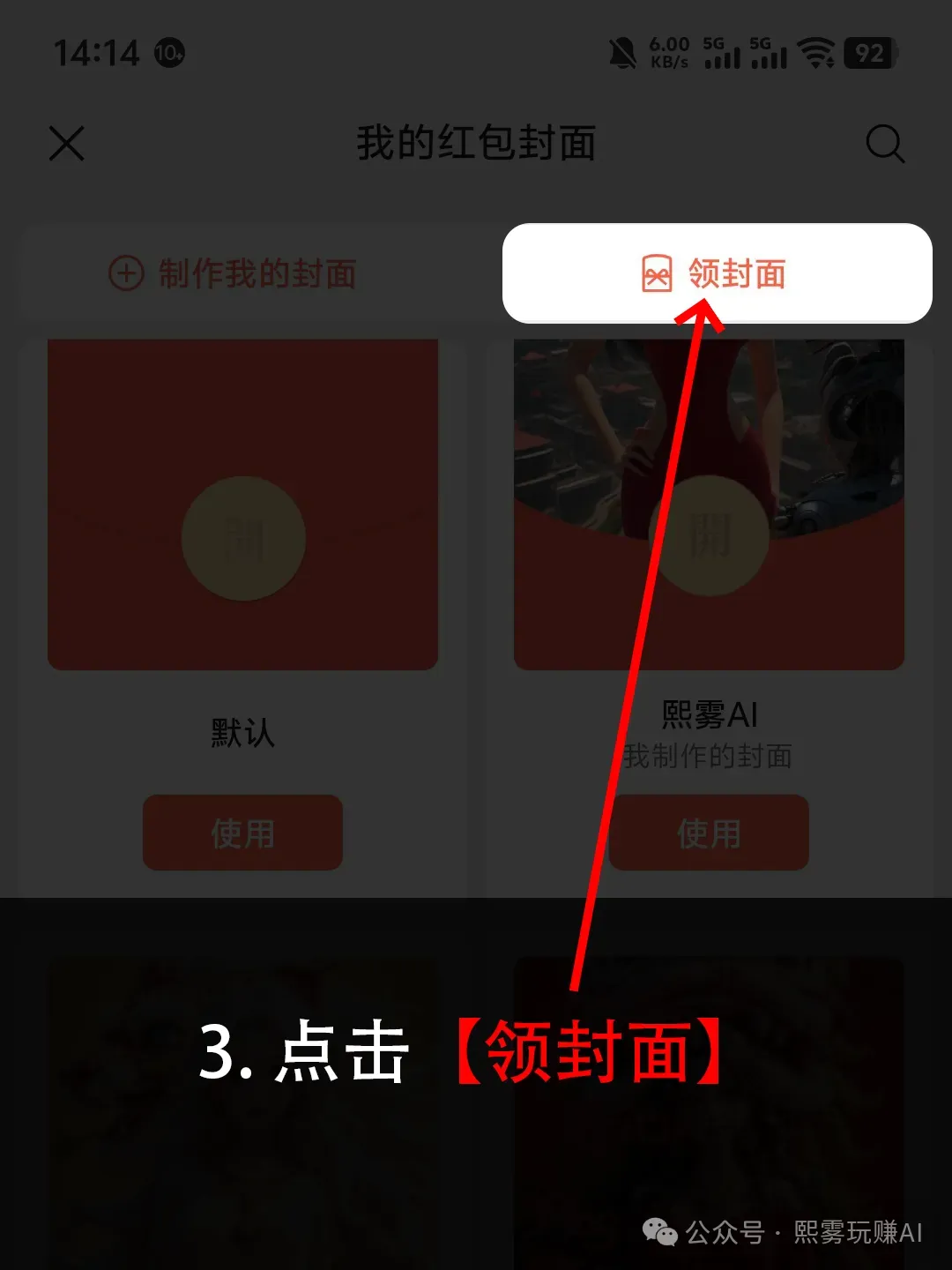

👻这里拥有全网最新最全的红包封面哦,而且每天都在更新,红包封面抢购快速通道~

获取方式

点击公众号菜单栏【AI百宝箱】-【红包封面】

点击公众号菜单栏【AI百宝箱】-【红包商城】

微信红包封面

一键就能拥有,传递祝福更有仪式

更多使用方法

|  |

|  |

AI图片生成定制,AI视频生成定制,AI智能体定制,AI工作流定制,AI应用定制

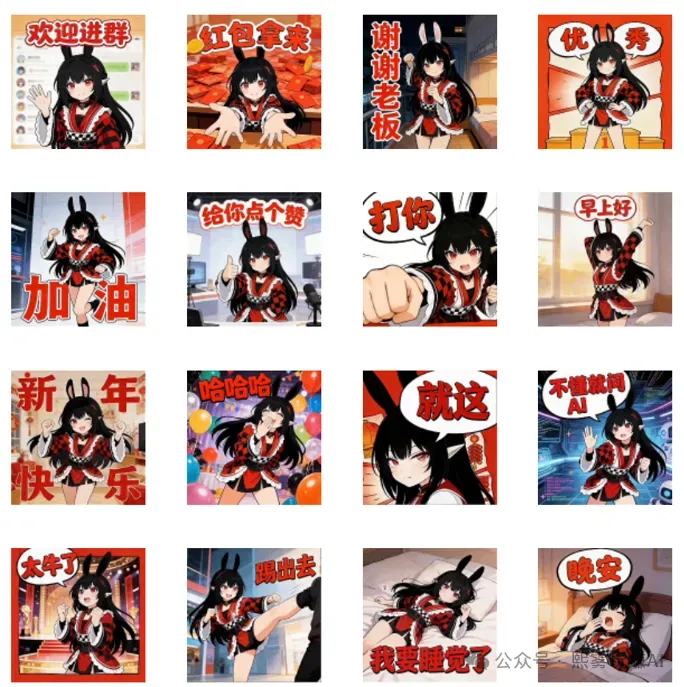

表情包

—

|

| 【红衣少女日常】-专辑16张动态表情包 点击公众号菜单栏【AI百宝箱】-【AI表情包】 |

资料分享

—

以下是闲鱼小程序虚拟产品,可直接拍,24小时自动发货,无需等待,自动秒发

资源在文章底部👇

#AI风向标#AI副业 #AI自媒体 #AI绘画 #AI视频 #AI超级个体 #AI创业者#AI教程 #AI智能体 #AI学习 #做同款 #ai教程 #教程#创业 #创业项目 #AI创业 #创业项目 #超级个体 #资料包 #ai教程 #ai变现教程 #ai赚钱教程 #ai变现 #ai赚钱 #睡后收入 #ai睡后收入 #被动收入 #ai被动收入 #赚钱 #ai赚钱 #ai赚钱秘籍#ai赚钱技巧 #ai赚钱方法 #搞钱 #AI工具箱#分享#下载#安装包#资源包#文件下载#无偿分享#网盘下载#网盘分享#下载地址#夸克网盘下载#副业项目资料#资料下载#资料分享#躺赚 #用AI躺赚 #失业 #失业逆袭 #失恋 #失恋搞钱 #红包封面

最后,感谢你看到这里👏

如果喜欢这篇文章,不妨顺手给我

更多的AI教程正在不断集成中……

获取入口

点击公众号菜单栏【AI智库】👉【AI教程】

获取资源在文章底部:阅读原文👇

复制🔗获取

夜雨聆风

夜雨聆风