最近被各个大模型的价格刺客背刺得够呛,特别是跑代码生成的时候,几万个 token 跑下来钱包直呼吃不消。本来想自己写个简单的代理,结果发现 OpenClaw 配合API平台能直接搞定智能模型路由和成本控制。昨晚花了两小时把配置拉通了,这里把过程和大家分享一下。

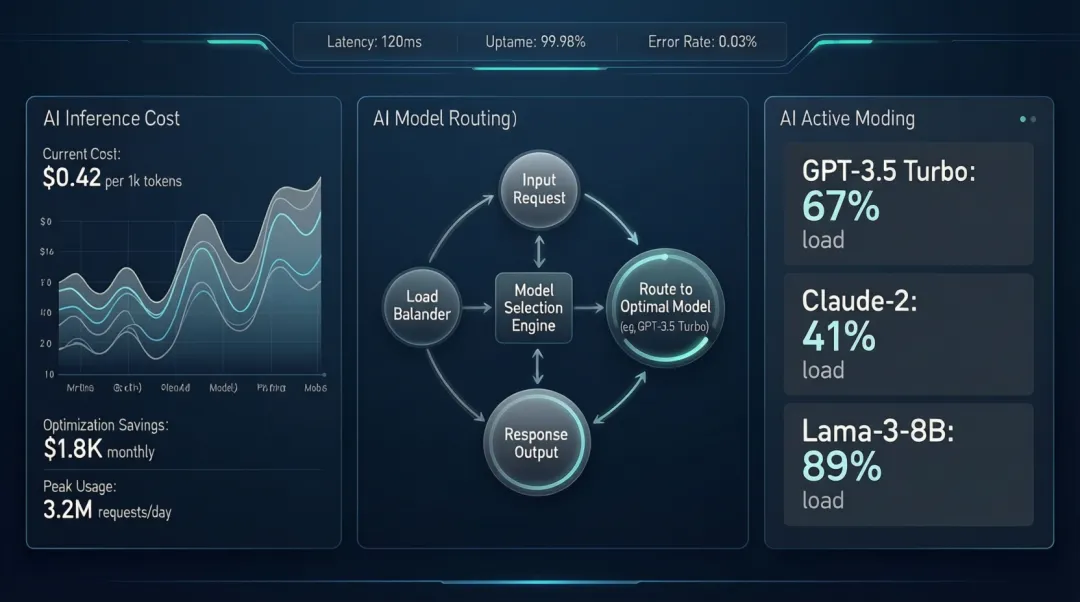

🔥 为什么要用聚合 API 和智能路由?

如果你和我一样,平时既要用 Claude 写代码,又要用 Gemini 跑总结,还要用 GPT 做数据分析,你肯定懂来回切 API 的痛。每个平台充钱不说,稍微不注意用错模型,成本就上天了。

我跑通的方案是:用API平台(为避免广告嫌疑,私信我告诉你)作为统一后端,然后在 OpenClaw 里按任务配置路由。

最核心的代码逻辑其实就是模型映射,比如:

# ============== 路由配置 ==============

routing:

# 默认路由策略

default_provider: claude

# 任务特定的路由

routes:

# 代码生成任务 - 选最强的

code_generation:

provider: claude

model: claude-opus-4-6

# 内容创作 - 选最便宜的

content_creation:

provider: gemini

model: gemini-2.5-flash

只要配置好了,在 OpenClaw 里发请求,它就会自动把简单的总结任务丢给 Gemini,把需要强逻辑的代码活儿交给 Claude Opus。

🌐 行业怎么玩:降本增效的最新实践

最近看了一些相关的讨论,大家在 AI 降本增效上基本有三个共识:

缓存是第一生产力:很多重复的问题(比如相同的系统 prompt 或者常见代码块)完全可以做语义缓存。 多模型级联回退(Fallback):主模型如果报错或者超时,立马切到备用模型,保证业务不断。 基于复杂度的动态路由:不是所有任务都需要用最顶级的模型。

在我这套配置里,成本控制策略是这样落地的:

cost_optimization:

strategies:

simple_tasks:

use_model: gemini-2.5-flash-lite

cost_threshold: 0.001 # $/request

complex_tasks:

use_model: claude-opus-4-6

🔍 深度拆解:坑在哪儿?

配这套东西不是一帆风顺的,有两个坑特别容易踩:

提供商(Provider)映射问题:各个模型的命名经常变,比如,Gemini 模型对应的是 GeminiHy提供商,Claude 对应OClaude。在写 OpenClaw 的路由逻辑时,一定要确保映射关系准确,不然就会报模型找不到的错。API 超时与重试机制:聚合 API 容易受网络影响。一定要在配置里加上超时和指数退避重试(Exponential Backoff)。如果你的应用对延迟敏感,可以考虑优先用 Gemini Flash 这类速度极快的模型。

✅ 优化指导:下一步怎么做

如果你也想给自己的 AI 助手上个智能路由,可以从以下几步开始:

第一步:盘点你目前最常用的 3-4 个场景,明确每个场景对智力、速度和成本的底线要求。 第二步:选一个靠谱的聚合 API(能提供健康检查、缓存和多节点负载的)。 第三步:在应用层(如 OpenClaw)写好 try-catch回退机制:主选 Claude Opus -> 备选 Claude Sonnet -> 保底 GPT/Gemini。第四步:一定要加上成本告警!比如设置每小时超过 $10 就自动切到便宜模型。

AI 的能力越来越强,但不意味着我们要盲目撒钱。把好刀用在刀刃上,才是最舒服的使用姿势。

夜雨聆风

夜雨聆风