银河麒麟高级服务器操作系统 V10 SP3 安装 OpenClaw 图文教程

手把手教你在银河麒麟服务器上部署 OpenClaw AI 助手

一、NPM 安装(推荐)

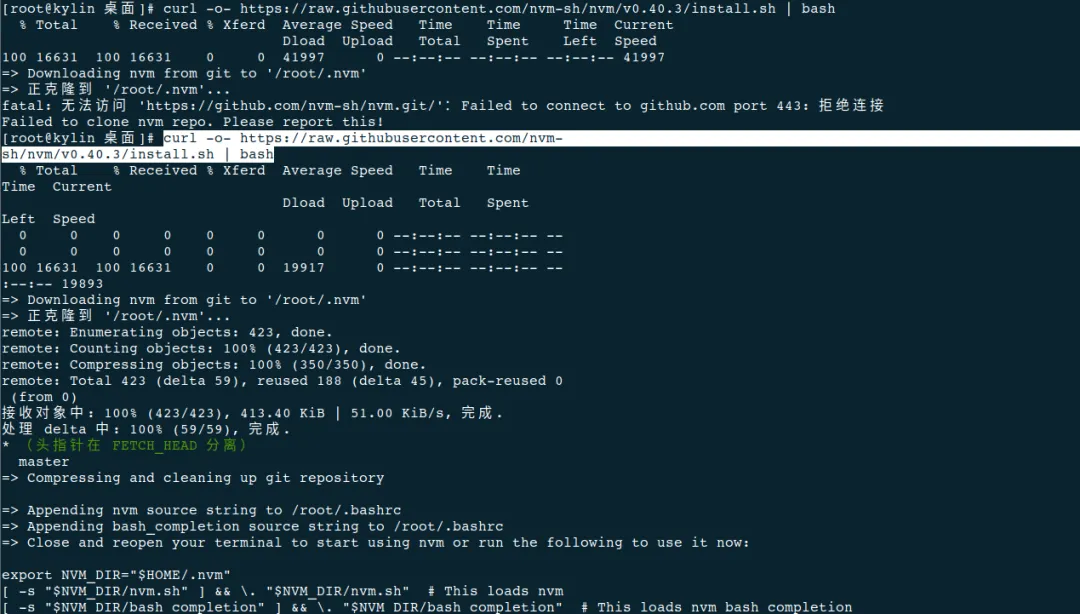

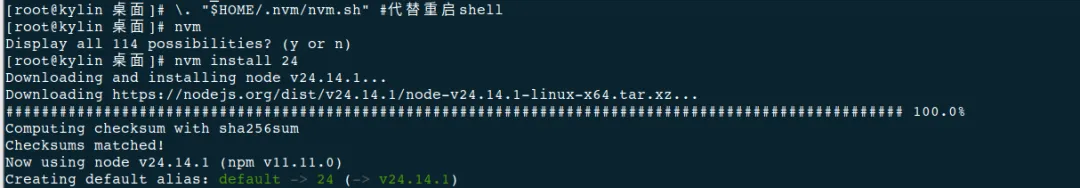

1. 安装 Node.js

安装新版本 nodejs(网络不稳定多试几次或手动执行脚本):

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.40.3/install.sh | bash 按提示配置变量代替重启 shell,执行:

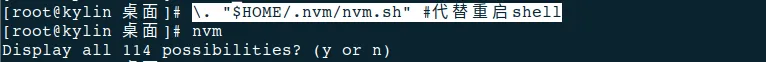

按提示配置变量代替重启 shell,执行:

\. "$HOME/.nvm/nvm.sh" 安装 nodejs 24 版本:

安装 nodejs 24 版本:

nvm install 24 验证 nodejs 和 npm 版本:

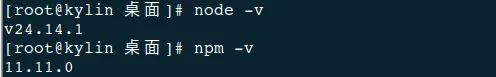

验证 nodejs 和 npm 版本:

node -v # 查看 nodejs 版本npm -v # 查看 npm 版本

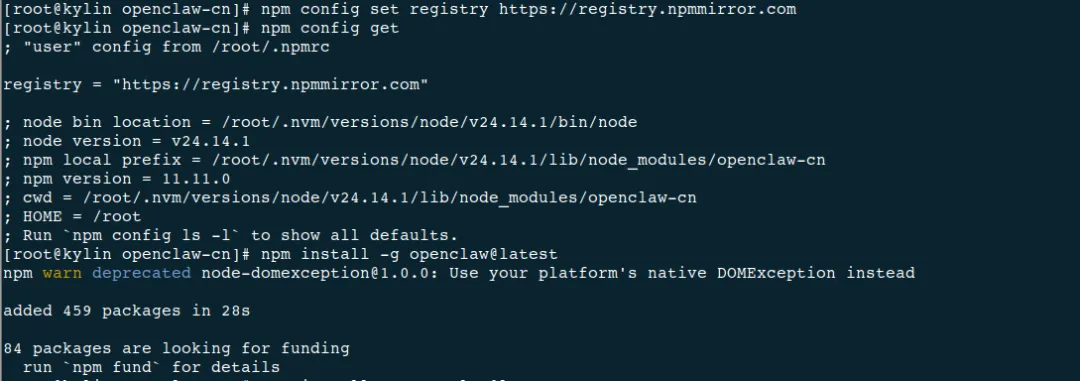

2. 配置 npm 镜像

使用 npm 安装 openclaw 最新版本并验证安装成功:

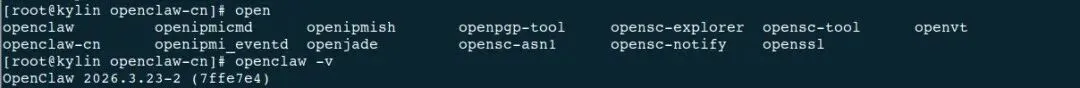

npm config set registry https://registry.npmmirror.com# 配置 npm 使用国内淘宝镜像站npm config get# 验证镜像站配置成功,输出 registry = "https://registry.npmmirror.com" 则成功npm install -g openclaw@latest# 安装 openclaw 最新版本openclaw -v# 验证查看 openclaw 版本3. 基本配置命令

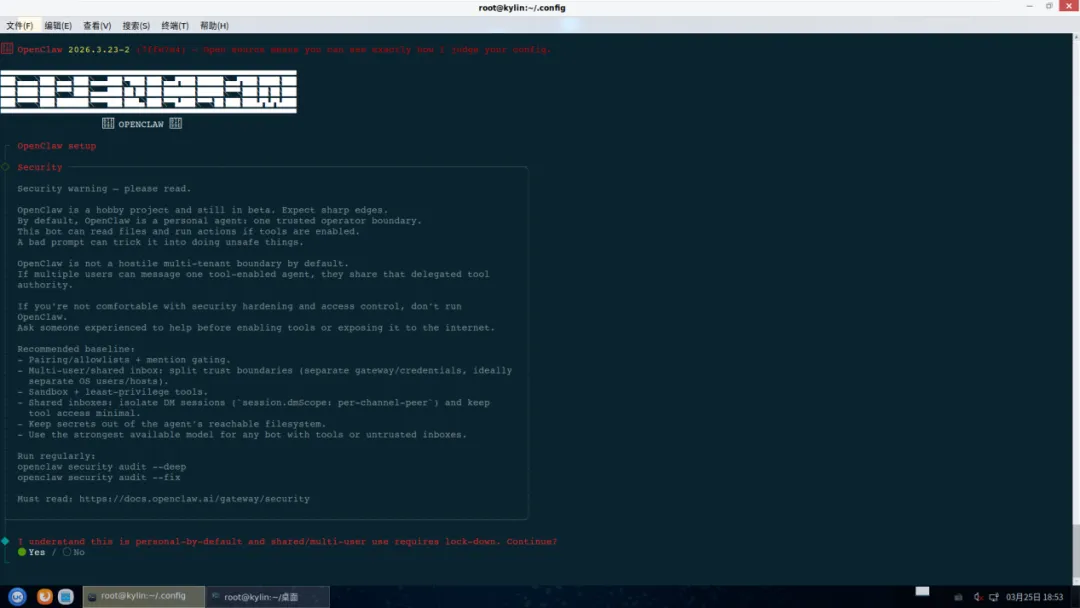

openclaw onboard --install-daemon# 初始化,新手引导二、初始配置步骤

① 新手引导

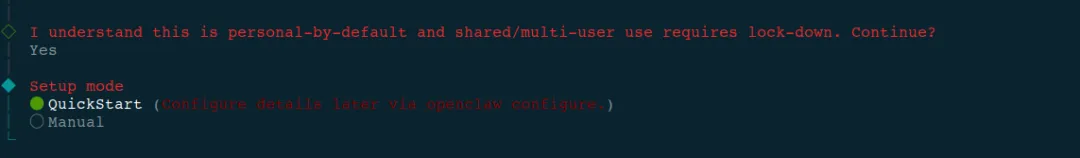

执行openclaw onboard --install-daemon后出现以下第一个界面,选 yes 然后回车:

然后选第一个 QuickStart:

然后选第一个 QuickStart:

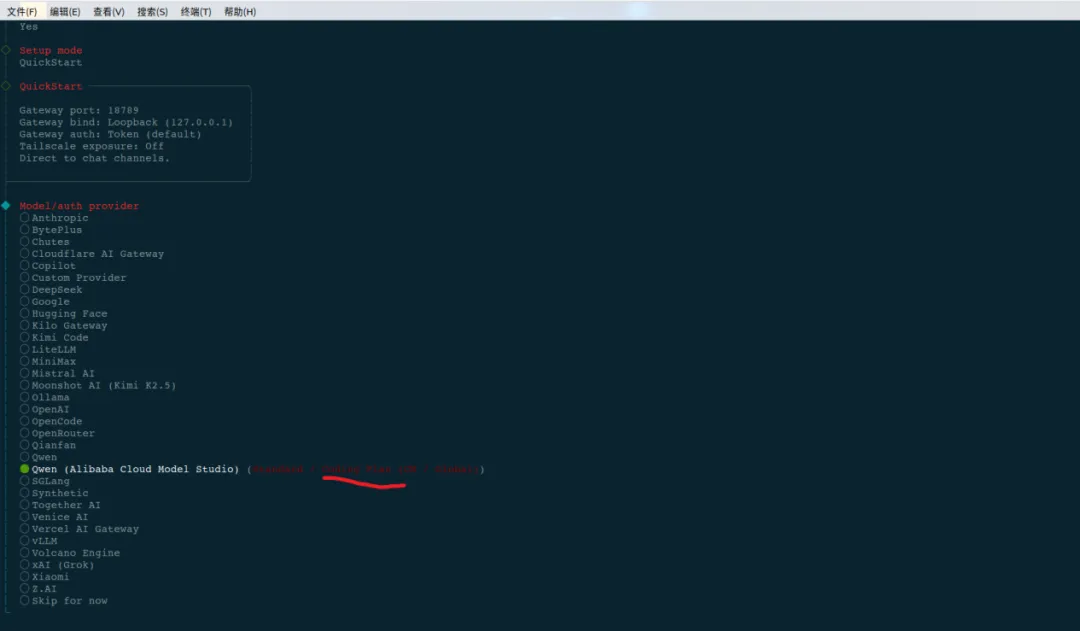

② 配置模型

然后选择你已有的模型,最新版已经支持在这里配置国内模型(也可以随便选一个先不填信息,后边手动修改 openclaw.json 文件去配置)。

这里我买了阿里 coding plan 就选择 qwen:

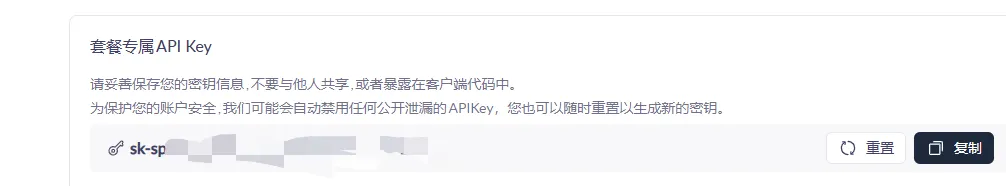

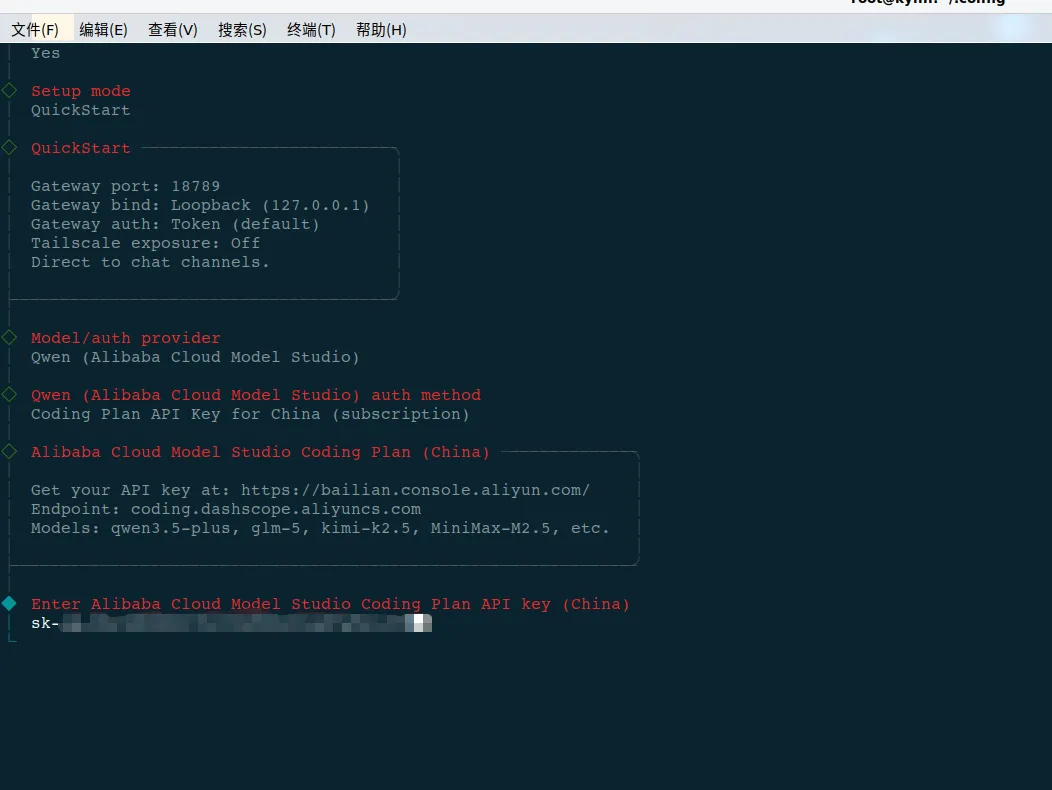

选对应模型的选项填入你的 api key 就行(sk 开头的):

选对应模型的选项填入你的 api key 就行(sk 开头的):

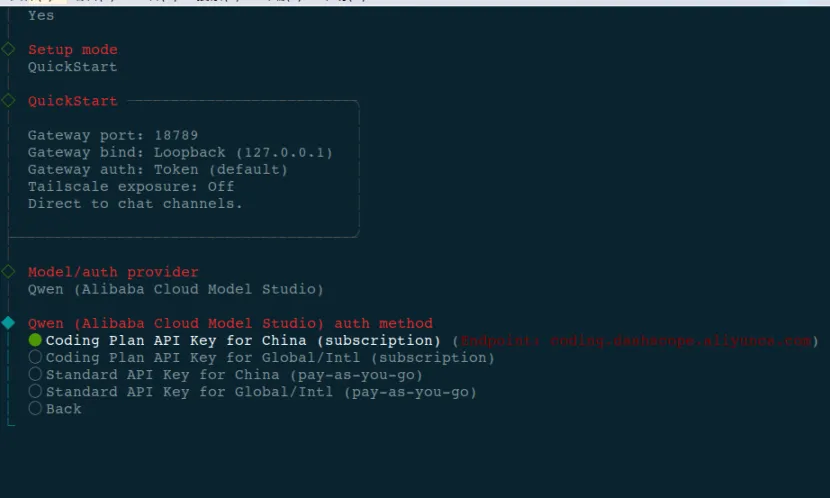

这里四个选项是:

A:coding plan 国内 B:coding plan 国外 C:按模型计费 国内 D:按模型计费 国外

因为我买的国内阿里 coding plan,选第一个,从阿里云复制api key即可

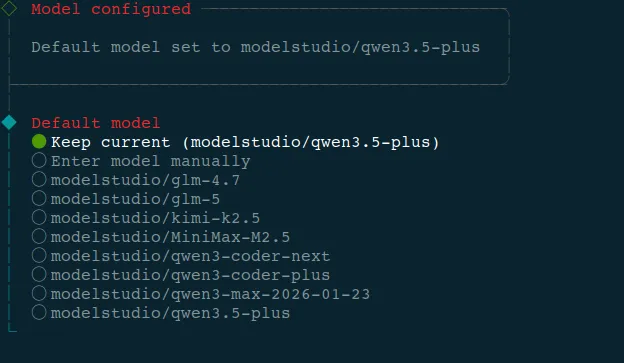

③ 选择模型

coding plan 支持多个模型,选择要使用的模型,我选的第一个默认:

可选模型列表:

Keep current (modelstudio/qwen3.5-plus) ← 这是当前默认 Enter model manually ← 手动输入 modelstudio/glm-4.7 modelstudio/glm-5 modelstudio/kimi-k2.5 modelstudio/MiniMax-M2.5 modelstudio/qwen3-coder-next modelstudio/qwen3-coder-plus modelstudio/qwen3-max-2026-01-23 modelstudio/qwen3.5-plus

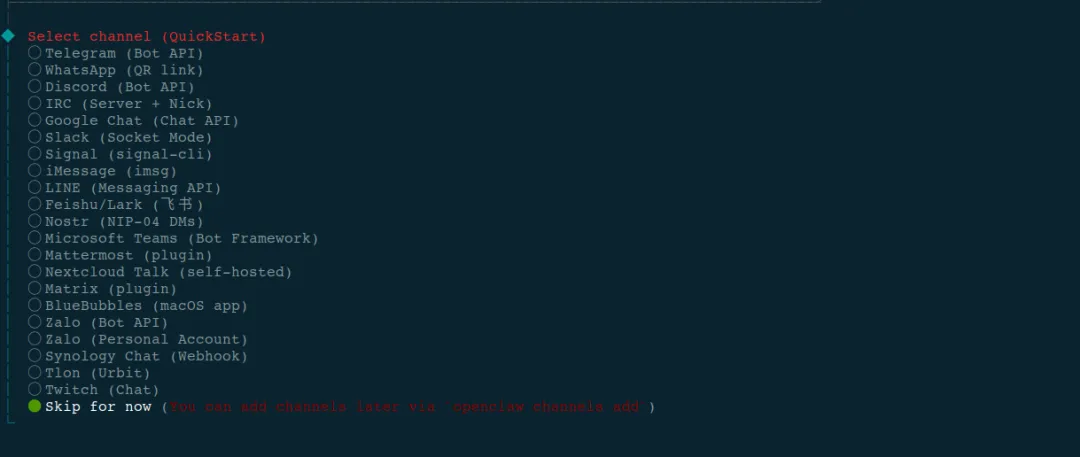

④ 配置频道插件

选择频道插件,这里可以先不设,有需要后边从各插件官网复制配置到 openclaw.json 更好:

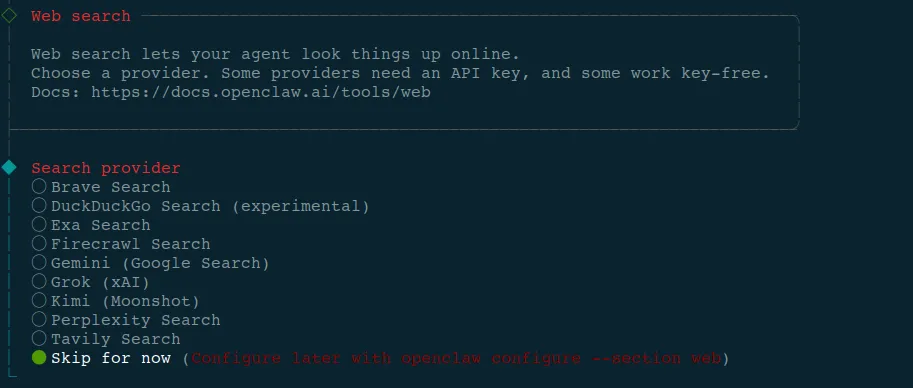

网页搜索和技能,可以先不设(大部分要么国内不可用,要么需要技能单独 API),后边让 openclaw 自己安装国内可用的技能也可以,我选的 skip for now 跳过。

网页搜索和技能,可以先不设(大部分要么国内不可用,要么需要技能单独 API),后边让 openclaw 自己安装国内可用的技能也可以,我选的 skip for now 跳过。

⑤ 配置初始钩子

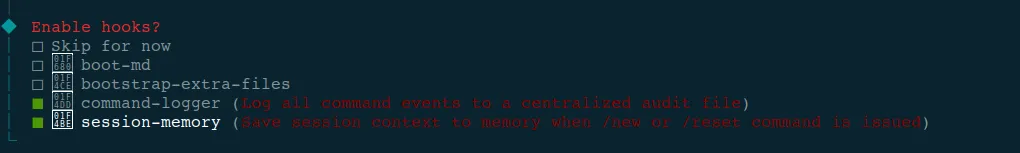

下一步配置初始勾子,按需选择即可(按空格键选中选项,选完回车即可),暂时不选后边在 openclaw 单独配也行:

可选钩子:

可选钩子:

boot-md:在启动时自动加载并执行指定的 Markdown 文件 bootstrap-extra-files:在启动时加载额外的配置文件或脚本 command-logger:记录用户输入的命令或对话 session-memory:启用会话记忆,让代理在对话中保持上下文连续

⑥ 选择打开方式

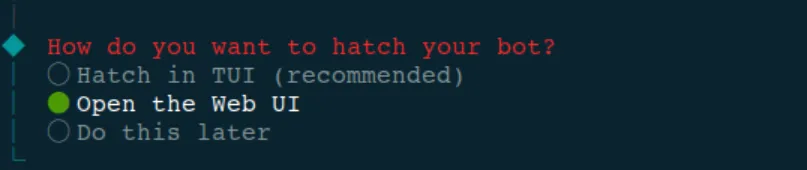

是否现在打开 openclaw 界面:

三个选项:

终端命令界面(tui) Web 浏览器界面 暂不打开

推荐选择第三个:暂不打开,后续通过飞书/企业微信等官网配置手册接入飞书/企业微信等后再通过飞书/企业微信等对话(tui终端命令对新手不友好,麒麟服务器版本没有高版本浏览器用不了 web ui)。

三、Docker 安装

① 在线安装

拉取 OpenClaw 官方镜像:

docker pull ghcr.io/openclaw/openclaw:latest② 离线安装

在有网机器上:

保存 docker 镜像为 tar 文件:

docker save ghcr.io/openclaw/openclaw:latest -o openclaw-offline.tar可选压缩:

gzip openclaw-offline.tar# 生成 openclaw-offline.tar.gzls -lh openclaw-offline.tar*# 查看大小在离线机器上:

解压:

gunzip openclaw-offline.tar.gz加载镜像:

docker load -i openclaw-offline.tar查看镜像:

docker images | grep openclaw运行:

docker run -d \ --name openclaw \ -p 18789:18789 \ -v /path/to/workspace:/workspace \ ghcr.io/openclaw/openclaw:latest验证:

docker logs openclaw自定义配置

如果需要自定义配置:

在有网机器上:

docker run -d --name openclaw-test openclaw/openclaw:latestdocker exec openclaw-test cat /app/config.json > openclaw-config.json修改配置后重新打包:

docker commit openclaw-test openclaw-custom:latestdocker save openclaw-custom:latest -o openclaw-custom.tar四、参考文档

OpenClaw 官网:https://docs.openclaw.ai/zh-CN/install[1] Docker 安装文档:https://docs.openclaw.ai/zh-CN/install/docker[2] 飞书官网:https://www.feishu.cn/content/article/7602519239445974205[3]

五、验证安装

安装完成后验证:

openclaw --versionopenclaw gateway status💡 提示:如遇问题,可访问 OpenClaw 官方文档或加入 Discord 社区获取帮助。

引用链接

[1]https://docs.openclaw.ai/zh-CN/install

[2]https://docs.openclaw.ai/zh-CN/install/docker

[3]https://www.feishu.cn/content/article/7602519239445974205

夜雨聆风

夜雨聆风