What's up, 大家!这是我的第 24 篇原创文章。

最近 OpenClaw 火得不得了,朋友圈、技术群、公众号几乎天天都有人在讨论。但实话说,我身边真正把 OpenClaw 跑通的朋友并不多——大部分人卡在了安装部署这一步:Linux 环境配置、模型认证、Gateway 自启动、代理验证……每一步都有坑。

我自己折腾了整整两周,才把三大模型(OpenAI/Codex、Claude、Gemini)接进 OpenClaw。过程中我发现一件事:OpenClaw 最值钱的,不是那个壳子本身,而是它背后的三角色协作思路。

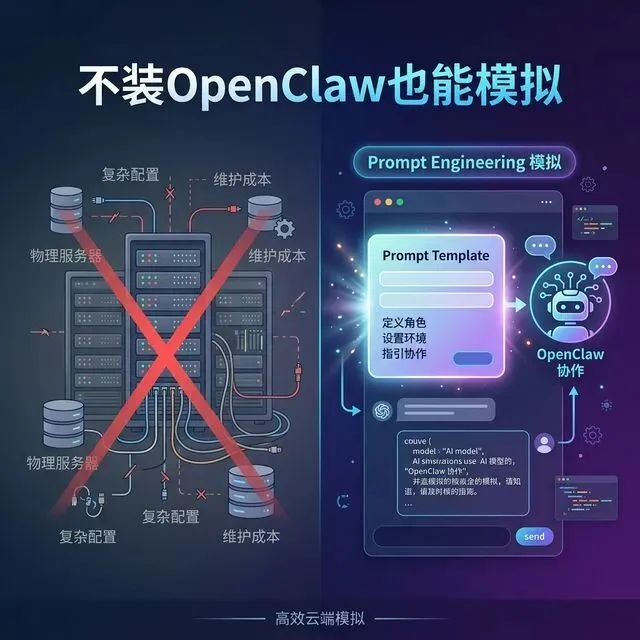

这个思路你就算不装 OpenClaw,今天用 Claude Code、Antigravity、甚至 OpenCode + 一段 Prompt 就能跑起来。

这篇文章就讲这件事:我怎么把 OpenClaw 的三角色协作提炼出来,变成一套不依赖 OpenClaw 也能用的实战方法。

问题出在哪:OpenClaw 到处推荐,但大多数人卡在第一步

先说现状。OpenClaw 的宣传材料会让你觉得这东西很简单——"一行命令安装,三分钟上手"。但真正动手你会发现:

| 卡点 | 具体表现 | 影响 |

| 环境依赖 | Node.js 版本、Python 环境、npm 全局包冲突 | 安装失败或运行异常 |

| 模型认证 | OAuth 回调、设备码确认、Token 交换失败 | 看到登录成功但实际调不通 |

| 网络代理 | 国内环境需要代理,代理配置因网卡切换失效 | Gateway 起来了但模型请求超时 |

| 自启动 | 重启后服务没起来,systemd 配置不对 | 每次开机都要手动拉起 |

| 多角色协作 | 装完了不知道怎么用,照着教程操作但不理解为什么要这样分工 | 用成了高级聊天窗口 |

最后一条才是核心问题:就算你装好了 OpenClaw,如果不理解它背后的协作模式,你也只是在用一个昂贵的对话框。

反过来说,如果你理解了协作模式的精髓,你不需要 OpenClaw 也能实现 80% 的价值。

我试过的三条路

方案1:直接装 OpenClaw——踩坑两周

**操作流程:**准备 Linux 环境 → 安装 OpenClaw CLI → 配置 Gateway → 接入模型认证 → 验证 Agent 可用

我用 Ansible 自动化脚本在 Ubuntu 服务器上做了一键部署。听起来很顺对吧?但实际上:

- • Gateway 自启动折腾了三天:systemd 服务配置、用户权限、端口占用,每次重启都要手动拉起

- • OpenAI/Codex 认证看到

probe ok以为成功了,结果真正跑 Agent 的时候超时——logged_in=true不等于"可用" - • Gemini 认证更离谱:C-1 路线(google-gemini-cli)token exchange 失败,只好切 C-2 路线(Antigravity 反代),到现在还没完全验通

- • 代理配置因为 WiFi 切换导致 IP 变化,每次都要重新验证

# 这是我实际跑的部署命令——看起来简单,但每一步都可能卡住

ansible-playbook -v openclaw_deploy.yml

ansible-playbook -v openclaw_deploy.yml -e deploy_scope=auth_openai_codex

ansible-playbook -v openclaw_deploy.yml -e deploy_scope=gateway结果:两周后终于跑通了基本流程,但 Gemini 认证还在折腾。更重要的是,我发现真正让我效率提升的不是 OpenClaw 本身,而是我在部署过程中被迫建立的三角色协作规则。

方案2:只看教程不动手——知道了但没用上

**操作流程:**搜索教程 → 阅读安装文档 → 看别人的使用分享 → 点赞收藏 → 关掉

这是大多数人的状态。你知道 OpenClaw 可以让多个 AI Agent 协作,知道它有 CC、Codex 的概念,但:

- • 你没有 Linux 服务器,或者有但不想折腾

- • 你看不懂 Ansible,也不想学

- • 你觉得"等它稳定了再用"

结果:知识停留在"听说过"层面,完全没有实操能力。

方案3:不装 OpenClaw,用 Prompt 模拟核心协作——这才是我要讲的

**操作流程:**提炼核心协作规则 → 写成角色约束提示词 → 在任意 AI IDE 中运行 → 用交接模板保持连续性

这个方案的核心思路是:把 OpenClaw 三角色协作中最有价值的部分提取出来,用 Prompt 工程的方式在任何 AI 编程助手中复现。

你不需要 Linux 服务器,不需要配网络代理,不需要折腾 Gateway。你只需要一个能用的 AI 编程助手(Claude Code、Antigravity、OpenCode 都行)和一份精心设计的提示词。

结果:我在 Windows 上用 Antigravity + 这套提示词,实现了和 OpenClaw 类似的效果——角色分工清晰、任务可追溯、交接不断线。

| 对比维度 | 方案1:直接装 | 方案2:只看不练 | 方案3:Prompt 模拟 |

| 门槛 | 高(Linux+Ansible+代理) | 零 | 低(任意 AI IDE) |

| 投入时间 | 2周+ | 0 | 2小时 |

| 核心价值获取 | ✅ 完整 | ❌ 零 | ✅ 80% |

| 适合人群 | 运维背景/有服务器 | 围观群众 | 所有 AI 编程用户 |

最终方案:用 Prompt 模拟 OpenClaw 三角色协作

下面是完整的实操步骤。你可以直接复制到你正在用的 AI IDE 里跑起来。

第一层:定义三角色分工

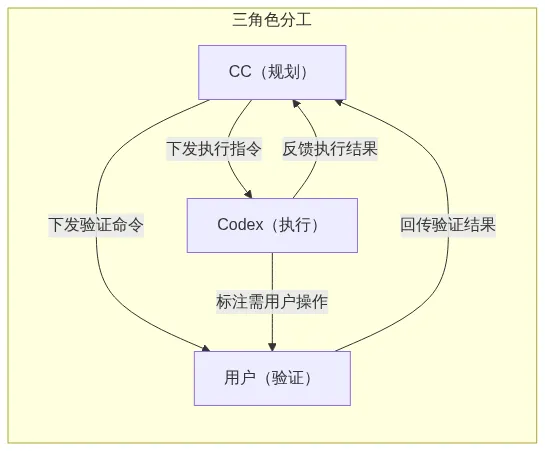

OpenClaw 的核心是把一个复杂任务拆成三个人的活:

| 角色 | 职责 | 红线(绝对不做) |

| CC(规划者) | 分析需求、制定方案、修订文档、统筹全局 | 不执行任何代码或命令 |

| Codex(执行者) | 写代码、改文件、跑脚本、调试问题 | 不修改方案文档 |

| 用户(验证者) | 验收结果、确认功能符合预期、做最终决策 | 不调试中间过程 |

详细步骤:

| # | 操作 | 说明 |

| 1 | 在你的 AI IDE(如 Claude Code)中新建一个会话 | 这个会话扮演 CC(规划者) |

| 2 | 在提示词中写入角色定义 | CC 负责规划统筹、制定方案、修订文档 |

| 3 | 明确 CC 的红线 | CC 不执行任何代码或命令,不直接操作文件系统 |

| 4 | 如有第二个 AI IDE(如 Codex CLI),让它扮演执行者 | Codex 负责写代码、改文件、跑脚本 |

| 5 | 你自己扮演验证者 | 验收最终结果,确认功能是否符合预期 |

验证检查: 三角色各自的职责边界是否清晰——CC 不碰代码、执行者不碰方案文档、你不调试中间过程。

如果你只有一个 AI IDE,也能跑。方法是在同一个会话中用提示词强制 AI 区分"规划阶段"和"执行阶段":

# 你可以在 AI IDE 的系统提示词或 AGENTS.md 中写入这段

你当前有两个工作模式:

- 规划模式:分析需求、制定方案、写文档。不写代码、不执行命令。

- 执行模式:按方案写代码、改文件、跑脚本。不修改方案。

每次切换模式时,必须先声明"进入 XX 模式"。

用户负责验证最终结果。第二层:建立越界约束(这是最难守住的)

OpenClaw 的 43 条硬约束,本质上就是在说一件事:各干各的,别越界。

把这些规则提炼成最小可用版本:

# 越界约束(红线规则)——贴进你的提示词

## 三条红线

1. 规划阶段不执行:分析需求时不要顺手改代码

2. 执行阶段不改方案:写代码时发现方案有问题,先反馈,不要自己改方案

3. 遇到需要用户操作的事,标注【→ 用户】:不要替用户做决定

## 消息标注规则

- 给执行者的消息标注【→ 执行】

- 给用户的消息标注【→ 用户】

- 给规划者的消息标注【→ 规划】⚠️ 故障排除: 如果 AI 在规划阶段就开始写代码,你要立即打断:"你现在是规划模式,不要写代码,先把方案写完。"

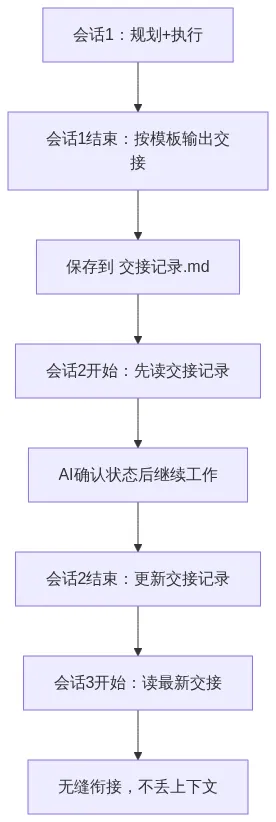

第三层:用交接模板保持跨会话连续性

这是整个方案中最值钱的一层。OpenClaw 原版交接模板有七段,我提炼出最小可用版本:

# 交接模板(每次会话结束时填写)

## 一、这轮完成了什么

- (列出实际完成的具体事项)

## 二、当前有效结论

- (仍然成立的技术结论和状态)

## 三、下一步优先动作

- 【→ 执行】需要做什么

- 【→ 用户】需要验证什么

## 四、当前卡点

- (阻塞进展的具体问题)

## 五、不要重复做的事

- (已经试过失败的路,别再走)详细步骤:

| # | 操作 | 说明 |

| 1 | 每次会话结束前,要求 AI 按模板输出交接内容 | 直接说"按交接模板输出" |

| 2 | 把交接内容保存到一个固定文件 | 比如 reference/prompt.md 或 交接记录.md |

| 3 | 下次会话开始时,让 AI 先读取交接文件 | "先读取 交接记录.md,了解上次进展" |

| 4 | AI 读完后确认当前状态再开始工作 | 避免从零开始或重复已做的事 |

验证检查: 新会话能准确回忆上次的进展和卡点,不需要你重新解释背景。

这个流程解决了 AI 编程最大的痛点之一:上下文丢失。不管你用什么 AI 工具,只要坚持用交接模板,就能实现跨会话的连续协作。

真正容易返工的地方

用了一段时间,我总结出以下避坑清单:

| # | 踩坑点 | 具体表现 | 避坑建议 |

| 1 | AI 在规划阶段偷偷执行 | 你让它分析需求,它直接把代码写了 | 在提示词里加硬约束:"规划模式禁止输出代码" |

| 2 | 交接模板写了但不读 | 新会话开始没让 AI 先读交接文件 | 养成习惯:每次新会话首条消息固定为"先读交接记录" |

| 3 | 越界约束漂移 | 用着用着就忘了角色分工 | 每 3-5 轮对话手动检查一次:AI 有没有做不该做的事 |

| 4 | 交接文件越来越长 | 历史交接堆积,AI 读取效率下降 | 定期精简:只保留当前有效结论和卡点,完成的事移入归档 |

| 5 | 只有一个 AI 时模式混乱 | 规划和执行在同一个会话里来回切 | 严格标注模式切换:"现在进入执行模式" |

⚠️ 注意:最常犯的错误是第1条。AI 特别喜欢在你让它"分析一下"的时候直接把代码塞给你。你必须在提示词里明确说"你在规划模式下输出代码会被视为错误"。

经验总结:三角色协作的核心不是技术实现,而是纪律。OpenClaw 用代码强制执行这些纪律,我们用 Prompt 约束来模拟。效果差不多,但前提是你要严格遵守自己写的规则。

💡 关于 OpenClaw 三大模型认证的具体部署过程,可以看我之前同项目、同类型、同系列的一篇文章:你真的相信网上说的OpenClaw很简单吗?而我折腾了两周才把三大模型接进来!

历史文章,请看这里:

2026-03-25:Claude Code 真正拉开差距的,不是模型更新,而是你有没有把它组织成生产线

2026-03-20:OpenClaw 真正要普及,得先把模型选择、安全层和入口三件事补齐

夜雨聆风

夜雨聆风